利用阿里巴巴 WAN 2.6 解鎖下一代影片創作 - 现已登陆WaveSpeedAI

隨著AI視頻生成的快速演進,阿里巴巴的WAN 2.6 模型成為當今最先進的開源解決方案之一。現已在WaveSpeedAI上推出,WAN 2.6為創作者提供了更強的敘事能力、更聰明的參考驅動生成和更長、更富表現力的輸出。

在本文中,我們重點介紹了定義WAN 2.6的三大核心功能,並解釋為什麼它們對現代創作者和開發者至關重要。

功能1:多鏡頭敘事生成

大多數開源視頻模型生成單一連續片段,往往缺乏結構或一致性。WAN 2.6通過直接從簡單提示生成多鏡頭敘事 的能力引入了重大突破。

該模型可以:

- 智能地將提示分解成多個攝影機鏡頭

- 維持鏡頭間的視覺一致性

- 保留關鍵元素,如角色外觀、環境、光線和色彩

- 在沒有手動場景控制的情況下製作電影般的連貫敘事

這使WAN 2.6對於想要更富表現力、敘事性更強的視頻輸出而無需微調每個片段的創作者來說是理想選擇。

功能2:基於參考的視頻生成

WAN 2.6支持視頻參考生成,允許用戶使用輸入視頻來引導模型。

它可以提取:

- 角色外觀和面部特徵

- 服裝、風格和視覺細節

- 適用時的語音特性

它支持:

- 人類或任何物體作為主角

- 單人 參考生成

- 雙人 共同創作場景

這種能力解鎖了許多實際應用:

- 身份一致的影響者內容

- 外觀穩定的產品演示視頻

- 物體、玩具或風格化角色的動畫

- 具有視覺連貫性的角色驅動敘事

在WaveSpeedAI上,通過我們簡化的參考上傳和身份保留生成管道,這個工作流變得更加順暢。

參考1:

參考2:

最終結果:(“角色1與角色2在餐廳裡吃晚餐”)

功能3:15秒長視頻生成

許多開源模型被限制為生成非常短的視頻,通常只有2–5秒,限制了敘事深度。WAN 2.6通過支持長達15秒 的視頻打破了這一限制。

更長的時長使:

- 更完整的故事弧線成為可能

- 更豐富的時間和空間內容

- 更順暢的動作序列

- 單次生成內的多鏡頭過渡

這種擴展容量使WAN 2.6適合電影片段、廣告概念、短故事、產品展示和創意原型設計。

通過WaveSpeedAI優化的基礎設施,即使是最長的輸出也保持穩定、連貫和高質量。

專家提示:在WaveSpeedAI上獲得WAN 2.6的最佳效果

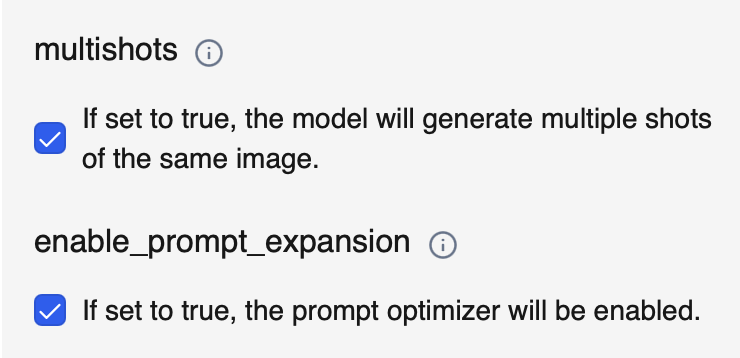

1. 啟用”multishots”以獲得更豐富的敘事

開啟multishots 允許模型根據您的提示自動生成多個鏡頭。這提升了敘事深度,改進了場景變化,並創建了更電影化的序列,無需複雜的提示工程。

在以下情況下使用: 多場景敘事、動態視角或更多電影化變化。

2. 使用”enable_prompt_expansion”獲得更詳細的輸出

當enable_prompt_expansion 開啟時,我們的系統通過添加相關的描述性細節來增強您的輸入提示。這幫助模型更好地理解您的意圖,並產生更精緻、連貫和視覺豐富的結果。

在以下情況下使用: 清晰的構圖、強大的風格一致性或當您認為您的提示過於簡單時。

最後的想法

阿里巴巴WAN 2.6為開源視頻生成帶來了強大的進步,從多鏡頭敘事到參考驅動創作和擴展的15秒視頻。通過WaveSpeedAI優化的工作流,這些功能對創作者來說變得更易於獲得和有效。

訪問我們的平台,親自嘗試WAN 2.6,輕鬆將您的想法轉變為驚人的AI生成視頻。