HappyHorse-1.0 vs Seedance 2.0:誰更勝一籌?

HappyHorse-1.0 在無音訊的文字生成影片與圖片生成影片方面領先 Seedance 2.0,但在音訊功能上有所不足,且尚無穩定的 API。以下是這對開發者意味著什麼。

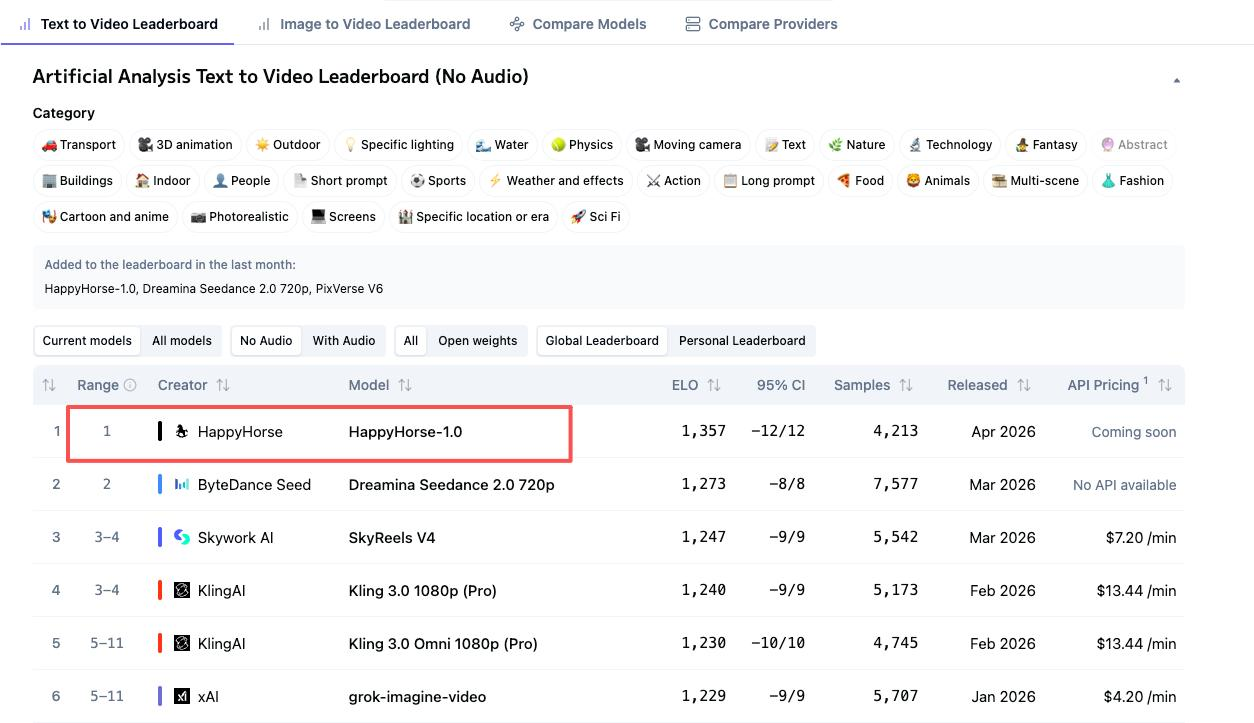

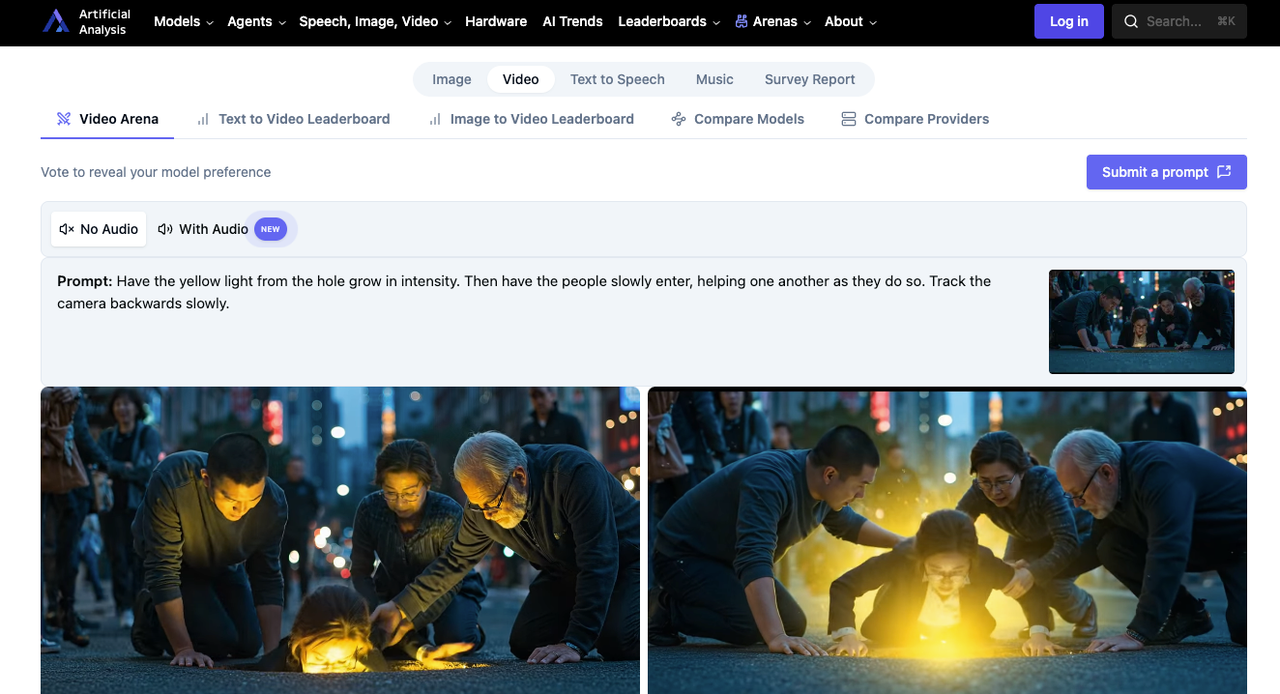

我花了很多時間重新整理 Artificial Analysis Video Arena 排行榜。嗨,我是 Dora!一個我從未聽說過的模型——HappyHorse-1.0——在週末悄然出現,並在四個主要排名中的兩個把 Seedance 2.0 擠下了榜首。沒有人知道是誰開發了它。Artificial Analysis 本身稱其為一個「匿名」參賽者。我的時間線上充滿了一半興奮、一半困惑。

於是我拉出了數據,追蹤了訪問路徑,試圖找出當下對所有使用這些模型的開發者來說唯一真正重要的問題:你今天能用哪個來上線?

答案並不像排行榜呈現的那麼清晰。

四個重要的排行榜數字

HappyHorse 和 Seedance 2.0 分別佔據了 Artificial Analysis 四個獨立排名的頂端。但它們的排名會根據評估是否包含音訊而互換。這個區別比大多數比較所承認的更為重要。

無音訊 T2V:HappyHorse 第 1 名(Elo 1333)vs Seedance 2.0 第 2 名(Elo 1273)

這是 HappyHorse 表現最強的類別。在盲測投票競技場中,60 分的 Elo 差距是有意義的——大致換算為用戶在一對一比較中約 59% 的情況下偏好 HappyHorse 的輸出。這裡的投票捕捉的是視覺動態品質、提示詞遵循度和場景連貫性,不受任何音訊影響。

有音訊 T2V:Seedance 2.0 第 1 名(Elo 1219)vs HappyHorse 第 2 名(Elo 1205)

一旦音訊加入評估,Seedance 以 14 分之差取得領先。字節跳動的雙分支擴散 Transformer 在單一步驟中同時生成影片和音訊——一個分支處理影片幀,另一個處理音訊波形,透過交叉注意力機制連接。當同步音效和對話成為評判標準時,這種架構設計就體現出其價值。

無音訊 I2V:HappyHorse 第 1 名(Elo 1392)vs Seedance 2.0 第 2 名(Elo 1355)

HappyHorse 在所有四個類別中 Elo 最高。在無音訊圖生影片類別中領先 37 分,表明該模型在遵循參考圖像構圖方面特別強大——在生成動態時保持主體身份、構圖和視覺風格的一致性。對於從事產品動畫或概念轉動態工作的團隊來說,這是最重要的數字。

有音訊 I2V:Seedance 2.0 第 1 名(Elo 1162)vs HappyHorse 第 2 名(Elo 1161)——幾乎持平

僅差一分。 這在任何合理的誤差範圍內。兩個模型在這個類別都沒有真正的優勢。在累積更多投票之前,把這個類別視為平局。

Elo 的實際衡量內容——及其對生產決策的局限性

這些 Elo 分數來自並排比較中的盲測用戶投票,使用改編自西洋棋排名的 Bradley-Terry 模型。用戶看到兩個由相同提示詞匿名生成的影片,然後選擇他們更喜歡的那個。這是我們目前最接近大規模「感覺測試」的方式。

但 Elo 不衡量 API 可靠性、生成速度、每個片段的成本、訪問穩定性,或者你是否能夠以程式方式調用該模型。排行榜排名是品質信號,而非上線決策的依據。

核心比較表

| 維度 | HappyHorse-1.0 | Seedance 2.0 |

|---|---|---|

| T2V Elo(無音訊) | 1333(第 1) | 1273(第 2) |

| T2V Elo(有音訊) | 1205(第 2) | 1219(第 1) |

| I2V Elo(無音訊) | 1392(第 1) | 1355(第 2) |

| I2V Elo(有音訊) | 1161(第 2) | 1162(第 1) |

| 音訊生成 | 有,但落後於 Seedance | 更強——原生雙分支同步 |

| 已知提供商 | 否——匿名 | 是——字節跳動 |

| 架構(聲稱) | 單流 40 層 Transformer | 雙分支擴散 Transformer |

| 開放權重 | 聲稱「即將推出」 | 否 |

| 穩定 API | 無公開 API | 消費者透過 Dreamina 訪問;官方 API 暫停 |

| 今日訪問方式 | 僅限示範網站 | Dreamina、CapCut Pro、中國應用程式 |

HappyHorse 的優勢所在

無音訊視覺動態品質:盲測投票捕捉到了什麼

無音訊排名中的 Elo 差距——T2V 差 60 分,I2V 差 37 分——並非微不足道。在盲測比較中,用戶持續選擇 HappyHorse,理由是其更自然的鏡頭移動、更流暢的身體動作和更強的場景氛圍。如果你的使用場景是靜默產品循環、配合獨立音樂剪輯的社群片段,或在後期配樂的 B-roll,這個數字就至關重要。

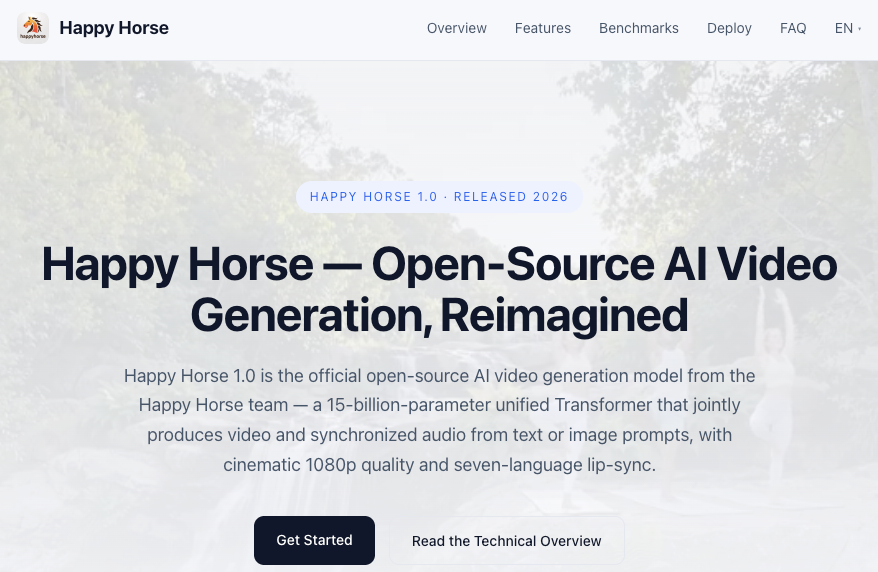

單流 Transformer 架構(聲稱)vs 多流流水線

HappyHorse 的行銷材料描述了一個統一的 40 層自注意力 Transformer,在單一序列中處理文字、影片和音訊 token——分支之間沒有交叉注意力。如果屬實,這在架構上與 Seedance 的雙分支方法截然不同。據稱前四層和後四層使用模態特定的投影,而中間 32 層在所有模態之間共享參數。我目前無法獨立驗證這些聲明。GitHub 和模型庫均顯示為「即將推出」。

多語言音訊聲稱

HappyHorse 聲稱原生支援七種語言——英語、普通話、粵語、日語、韓語、德語和法語——並具有低詞錯率的唇形同步。Seedance 2.0 支援 8 種以上語言的音素級唇形同步。在紙面上,它們勢均力敵。實際上,我沒有能夠對 HappyHorse 的多語言輸出進行足夠的壓力測試以確認同等水準。

Seedance 2.0 維持優勢的地方

音訊生成:在兩個有音訊排行榜上仍然領先

Seedance 在有音訊的 T2V 和 I2V 上均排名第一。其雙分支架構——一個分支生成影片幀,另一個生成音訊波形,透過交叉注意力實現毫秒級同步——正是為此目的而設計的。當你的輸出需要對話、環境音效或幀精確的音效時,Seedance 將音訊視為生成過程中的一等公民(而非後處理步驟)的架構決策賦予了它結構性優勢。

已知提供商:字節跳動,穩定身份,成熟生態系統

你知道是誰製造了 Seedance 2.0。字節跳動的 Seed 研究團隊由吳永輝(前 Google Fellow,在 Google 工作 17 年,包括 Google Brain)領導,有從 Pixeldance 到 Seedance 1.0、1.5 Pro 再到 2.0 的有據可查的發展脈絡。HappyHorse?截至發佈時,沒有任何人公開確認是誰製造了它。Artificial Analysis 將其作為匿名參賽者添加。在競技場亮相後數小時內出現了多個第三方包裝網站,但沒有任何一個聲稱是原始開發者。

對於生產決策,出處至關重要。你需要知道你在模型更新、合規性和連續性方面依賴的是誰。

訪問路徑:Dreamina 有公開入口點

Seedance 2.0 今天可以透過字節跳動的 Dreamina 平台 在國際上訪問,付費方案起價約 18 美元/月。CapCut Pro 整合於 2026 年 3 月下旬在特定市場推出。中國用戶可以透過即夢訪問,方案起價約 69 人民幣/月(約 9.60 美元)。

話雖如此——官方 Seedance 2.0 API 自 2026 年 3 月中旬起因報告的版權糾紛而暫停。消費者訪問是可行的。在生產規模上以程式方式訪問 API,在你建立依賴此功能的流水線之前需要驗證。第三方提供商透過 API 提供 Seedance v1.5;官方渠道的 Seedance 2.0 API 可用性需要預生產確認。

訪問差距才是真正的決策因素

HappyHorse:截至發佈時無穩定 API、無公開權重、僅限示範

儘管聲稱將開源發布,HappyHorse 的 GitHub 和模型庫都顯示為「即將推出」。存在多個示範和包裝網站,但沒有任何一個提供帶有 SLA、速率限制或定價的有文件記錄的 API 端點,讓你能夠以此為基礎建立產品。我找不到任何一個第三方 API 提供商目前透過穩定、有文件記錄的端點提供 HappyHorse-1.0。

如果你在評估生產可用性,這是最關鍵的因素。一個你無法可靠調用的模型,就不是你能上線的模型。

Seedance 2.0:可透過 Dreamina 訪問——詳情需要驗證

透過 Dreamina 的消費者訪問是可用的。該平台支援完整功能集,包括 @ 參考系統、多鏡頭編輯和音視頻生成。但如果你的工作流程需要 API 級別的整合,情況就不那麼穩定了。Seedance 2.0 的官方 BytePlus API 自三月起已暫停。fal.ai 和 PiAPI 等第三方提供商已提供 Seedance 1.5;Seedance 2.0 程式訪問及其相關定價結構應在建立生產依賴之前直接確認。

為什麼「排行榜第一」和「生產就緒」是不同的問題

我一直在思考這個問題。Elo 告訴你在受控比較中用戶更喜歡哪個模型。它不告訴你下週二能否讓 10,000 個生成請求通過而不出現 503 錯誤。HappyHorse 確實可能產生更好的靜默影片。但如果你無法可靠地調用它,那麼品質優勢只存在於競技場中,而不在你的流水線裡。

決策框架

音訊品質是不可或缺的 → Seedance 2.0。 它在兩個有音訊排行榜上均領先,其雙分支架構原生生成同步音效。如果你的片段需要對話、環境音訊或幀精確的音效,Seedance 是今天更強的選擇。

視覺動態保真度是你的優先考量,且你願意等待 → 持續關注 HappyHorse。 無音訊 Elo 領先是真實的。如果開放權重和 API 訪問如承諾般實現,HappyHorse 可能對靜默優先的工作流程極具吸引力。但「即將推出」不是 SLA。

你今天需要生產 API → Seedance 2.0 是更安全的選擇。 不是因為它完美——官方 API 暫停是真實的限制——而是因為 Dreamina 提供了帶有文件定價的功能性訪問路徑,第三方提供商也在積極準備 Seedance 2.0 端點。HappyHorse 目前還沒有同等的基礎設施。

常見問題

HappyHorse-1.0 真的比 Seedance 2.0 好嗎?

取決於你的衡量標準。HappyHorse 在無音訊比較中的視覺品質上領先(T2V 的 Elo 1333 vs 1273,I2V 的 1392 vs 1355)。Seedance 在音訊納入評估時領先。沒有哪個模型在所有四個類別中都佔主導地位。「更好」只有在相對於你的特定使用場景以及音訊是否重要的情況下才有意義。

為什麼 HappyHorse 在無音訊時領先,但在有音訊時落後?

可能是架構原因。HappyHorse 聲稱使用單一統一 Transformer 在一個序列中處理所有模態。Seedance 2.0 使用專門設計的雙分支設計,其中獨立的影片和音訊分支透過交叉注意力連接。當音效品質和同步與視覺一起被評判時,那個專門的音訊分支似乎給了 Seedance 優勢。

我今天能透過 API 訪問 HappyHorse-1.0 嗎?

截至 2026 年 4 月 8 日,我無法透過任何穩定、有文件記錄的端點驗證。多個包裝網站提供基於瀏覽器的示範訪問,但沒有任何一個發佈 API 文件、速率限制或生產級 SLA。官方 GitHub 和模型庫都顯示為「即將推出」。

Artificial Analysis 排行榜對生產決策有多可靠?

它是感知影片品質最可信的眾包信號——盲測投票、基於 Elo 的排名、真實人類偏好。但它衡量的是一件事:用戶並排比較時更喜歡哪個輸出。它不考慮生成速度、成本、可靠性、API 正常運行時間或訪問穩定性。將其作為品質輸入使用,而非完整的採購決策。

HappyHorse-1.0 在未來版本中會有音訊改進嗎?

目前沒有公開路線圖。該模型在一週前以匿名身份出現在競技場中。如果「即將推出」的開源發布成真,社群貢獻可能會提高音訊品質。但目前沒有時間表、沒有確認的開發團隊、也沒有宣布的 v2 計劃。任何超出排行榜目前顯示內容的都是猜測。

排行榜所說的與開發者實際能使用的之間存在一個有趣的差距。HappyHorse 的數字確實令人印象深刻——但沒有訪問途徑的數字只是數字。我會持續關注那個 GitHub 倉庫何時上線。在那之前,這個比較其實並不是關於哪個模型更好,而是關於哪個模型是可用的。

在 WaveSpeedAI 上試用 HappyHorse-1.0

HappyHorse-1.0 現已在 WaveSpeedAI 上提供:

往期文章: