GPT Image 2 API 生成与编辑开发指南

面向开发者的实用 GPT Image 2 API 指南,涵盖图像生成、编辑、工作流设计及常见实现注意事项。

上周我交付了一个小型产品功能,需要在按钮背后实现图像生成。开发进行到第二天,我意识到第一天做出的集成选择将决定我在接下来六个月里要承担多少技术债。这正是没人会提前告诉你的关于 GPT Image 2 API 的部分。Hello world 很简单,难的是生产环境的落地姿势。

我是 Dora。我习惯在交付功能之后写工作笔记,而不是之前。以下是我将 OpenAI 的 gpt-image-2 接入真实产品时学到的东西,以及我会建议其他开发者或 AI 工程团队在发出第一个请求之前思考的问题。

使用 GPT Image 2 API 之前你需要准备什么

模型访问权限、端点与关键文档

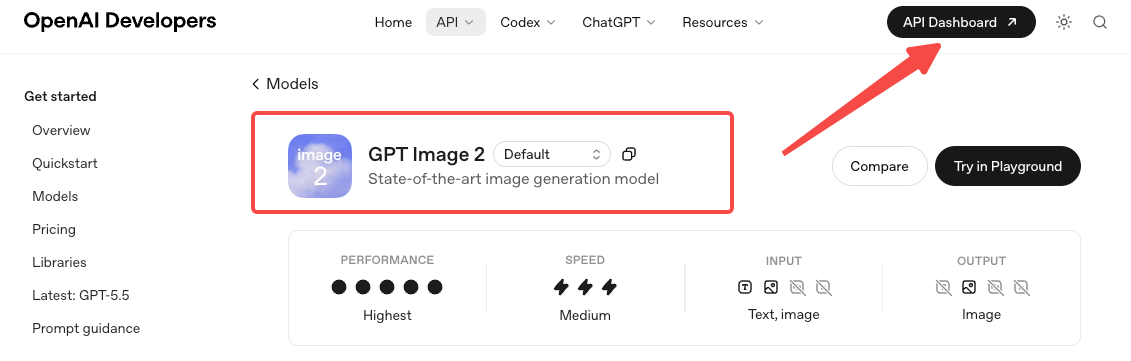

GPT Image 2 于 2026 年 4 月 21 日发布,模型 ID 为 gpt-image-2。在发出第一个调用之前,你可能需要在开发者控制台完成 API 组织验证——OpenAI 对 GPT Image 系列设有访问门控。

你有三个调用面可以选择。Image API 暴露了两个端点:images.generate 用于文生图,images.edit 用于通过提示词和可选蒙版修改现有图像。第三个调用面是 Responses API,它将图像生成作为内置工具暴露给对话式或多步骤流程。

按需求选择,而非追新。 如果你的产品是”用户输入提示词,获得图像”,就用 Image API。如果你的产品是”用户进行多轮对话,期间有时产出图像”,就用 Responses API。因为某个看起来更高级就混用两者,是一个维护陷阱。

GPT Image 2 目前支持什么

有两件事要尽早内化。

不支持透明背景。 带有 background: "transparent" 的请求会失败。如果你需要透明 PNG,将这些任务路由到 gpt-image-1.5,并接受你现在要维护两条模型路径的现实。

输入保真度已锁定。 input_fidelity 参数在旧模型上存在,但 gpt-image-2 始终以高保真度处理输入。省略该参数,否则请求会失败。成本影响:带有参考图像的编辑请求消耗的输入 token 比你从 gpt-image-1 时代预期的要多。

如何使用 GPT Image 2 生成图像

基本请求结构与输出选项

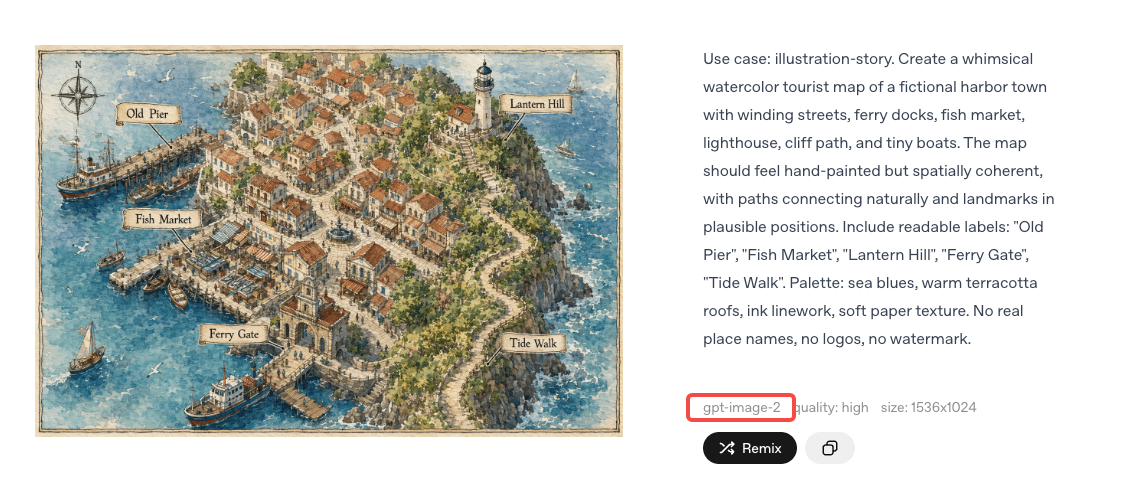

生成请求需要提示词、尺寸、质量和输出格式。格式默认为 PNG;你可以请求 JPEG 或 WebP,当延迟敏感时 JPEG 比 PNG 更快。尺寸接受预设值或自定义尺寸,约束条件为:两条边都必须是 16 的倍数,单边最大 3840px,宽高比不超过 3:1,总像素在 655,360 到 8,294,400 之间。

n 参数允许你在一个请求中生成多张图像,在需要比较变体时很有用。但当你按输出 token 付费时——你确实是这样付费的——它的用处就没那么大了。

管理尺寸、质量与工作流的权衡

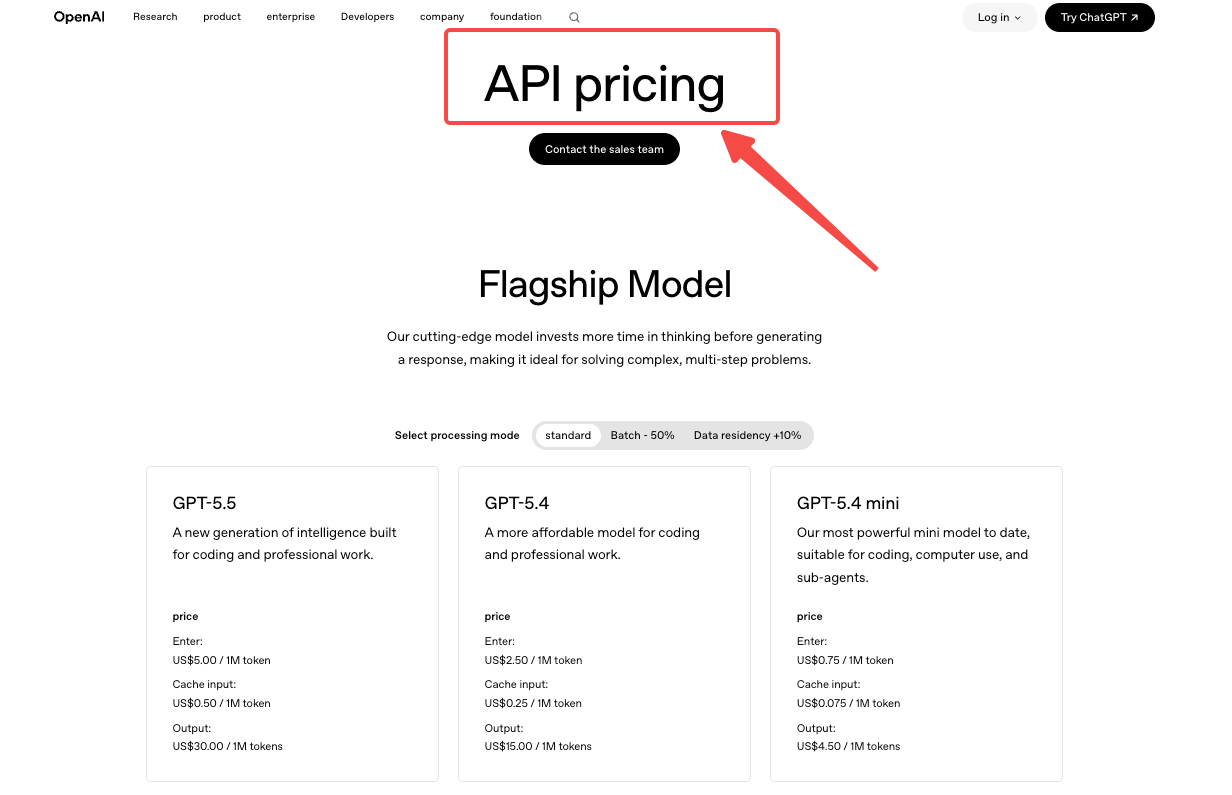

这是大多数团队在不知不觉中烧钱的地方。GPT Image 2 按 token 计费,而非按图像:图像输入 $8/百万 token,图像输出 $30/百万 token,文本输入 $5/百万 token。缓存输入更便宜,批量处理将标准费率减半。

实际数字意味着什么:在 1024x1024 尺寸下,OpenAI 的计算器估算低质量约 $0.006,中质量 $0.053,高质量 $0.211。1024x1536 等矩形尺寸稍便宜,分别为 $0.005、$0.041 和 $0.165。这些是仅输出的估算,还需在此基础上叠加输入 token 和编辑参考图 token。

所以权衡的问题不是哪种质量看起来最好,而是:在我的使用量下,中质量和高质量的成本差异是多少,我的用户真的能感知到吗?对于缩略图场景,低质量通常够用;对于用户会仔细审视的主图,高质量物有所值。我将中质量设为默认值,并将高质量作为可选项。这个单一决策让我预估的月账单变化了约 4 倍。

图像编辑的工作原理

输入要求与常见编辑场景

编辑端点接受一张图像、一个可选蒙版,以及描述变更的提示词。传入一张图像来编辑它,传入多张图像来将主体、风格或参考内容合并为一个输出。模型支持局部重绘和扩图,并在应用提示词修改其余区域的同时保留未遮罩区域。

我已验证的常见编辑:产品照片换背景、物体移除、两张参考图之间的风格迁移,以及图像内的文字翻译。角色一致性主张——在多个生成场景中保持同一角色——对简单主体来说对我有效,但随着场景复杂度增加,可靠性会下降。

会增加成本或降低一致性的错误

发送过大的输入。 由于 GPT Image 2 以高保真度处理每个图像输入,一张 4K 参考照片消耗的输入 token 不论你的输出是缩略图还是海报都相同。将参考图缩小到任务实际需要的尺寸。

模糊的编辑提示词。 “让它更好看”会产生不可预测的变化,而且往往让你付钱重试。“将红色帽子改为淡蓝色丝绒”会保留图像的其余部分,通常一次就能成功。

无限制的 n。 请求 n=4 来”看看效果”听起来无害,直到你意识到你为一个只会用到一个输出的请求支付了 4 倍费用。

用生成成本来估算编辑成本。 编辑通常比相同输出尺寸的生成成本更高,因为参考图像会增加输入 token。在发布之前而不是之后,将这一点纳入你的定价模型。

团队的生产环境注意事项

重试、内容审核与运营护栏

有三件事在生产环境中不可或缺。

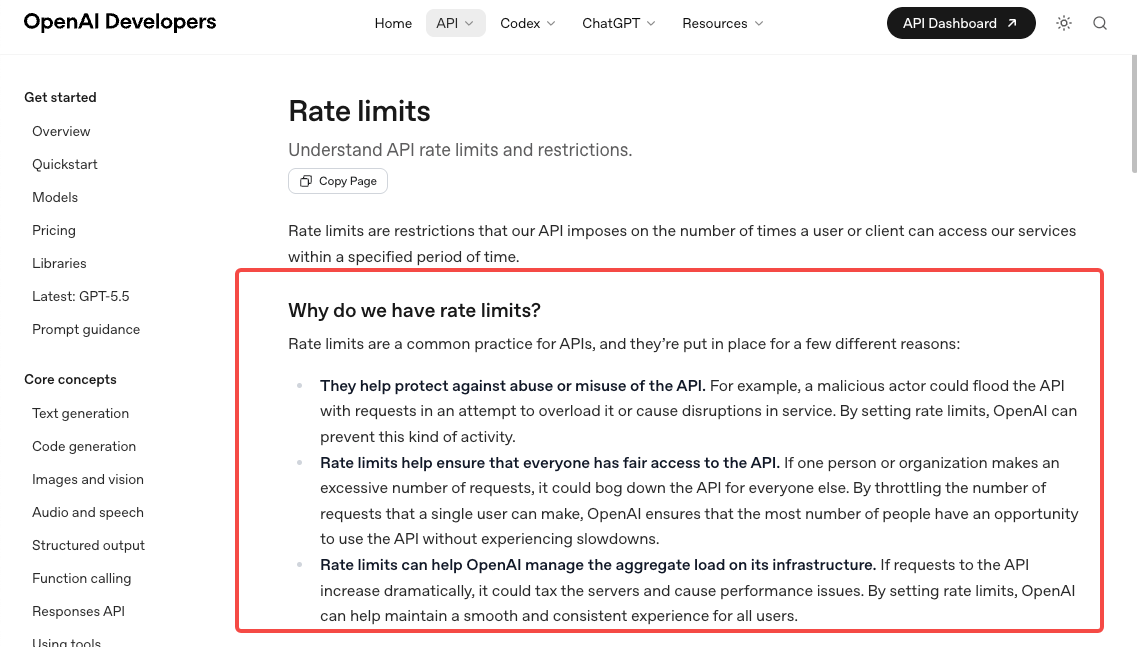

指数退避重试。 图像生成对于复杂提示词可能需要长达 2 分钟,你也会遇到速率限制。OpenAI 的建议是使用带抖动的指数退避重试——抖动很重要,因为来自集群的同步重试会在同一时间触达同一速率上限。

两层内容审核。 图像生成端点有内置的 moderation 参数(auto 为默认;low 较宽松但仍有过滤)。对于用户提交的提示词,在发送给 gpt-image-2 之前,先通过免费的 omni-moderation-latest 端点进行过滤——它同时接受文本和图像,能在你为生成付费之前阻止大多数违反政策的请求。内容审核 API 参考文档中有确切的请求格式。

以合适粒度进行日志记录。 记录每个请求的模型 ID、尺寸、质量、提示词 token 数、输出 token 数、延迟、请求 ID 和最终估算成本。当大规模出现问题时,这些数据能让你诊断问题;当一切运转良好时,这些数据能让你决定是否进一步扩展。在生产环境中固定到特定的模型快照而非浮动别名,这样行为就不会在你不知情的情况下漂移。生产最佳实践指南涵盖了密钥轮换、监控以及其他运营层面的内容。

何时保持直接集成的简洁性,何时添加平台层

这是我思考最久的问题。

直接 OpenAI 集成是正确答案的情况:你的产品只使用一个图像模型、你的团队有 API 运营经验,以及你的流量足够可预测,使得速率限制管理和第一方计费比便利性更重要。

平台层——是的,我在 WaveSpeedAI 参与构建了一个——在不同情况下体现其价值:你在多个图像模型之间路由(gpt-image-2 用于文字排版,另一个模型用于透明 PNG,再一个用于视频);你需要固定的按调用定价以确保预算可预测性,而非 token 数学;你希望有一个集成界面,能在提供商变更时保持稳定,无需重写调用代码。

两种答案都不是普适的。诚实的检验方法:统计你的产品今天调用了多少个模型提供商,乘以十二个月后你将调用的数量,然后问问自己是否愿意自己维护那么多集成。

常见问题

开发者应该使用 GPT Image 2 的哪个端点?

文生图使用 images.generate,用提示词和可选蒙版修改现有图像使用 images.edit,当生成需要存在于多轮对话中时使用 Responses API 图像工具。

GPT Image 2 支持图像编辑吗?

支持。images.edit 端点接受一张或多张参考图像加上提示词,支持带蒙版的局部重绘和扩图。所有图像输入都会自动以高保真度处理。

团队在生产环境中应该记录和监控什么?

最低要求:模型快照 ID、尺寸、质量、输入和输出 token 数、延迟、请求 ID、重试次数、内容审核结果,以及每个请求的最终估算成本。这些数据能让你还原任何事故并预测支出。

简单的 API 集成什么时候开始不够用?

当你调用多个图像提供商时,当故障模式需要跨提供商故障转移时,或者当财务部门要求可预测的按调用定价而非基于 token 的可变费用时。低于这些阈值,直接集成仍然是更简洁的选择。

如何防止提示词注入和不安全的输出泄漏到生产环境?

在生成之前通过内容审核端点过滤用户提示词,将 image API 的 moderation 参数设为 auto,记录每个被标记的请求,并遵循 OpenAI 的安全最佳实践——包括对高风险场景进行人工审核,以及在上线前进行红队测试。

结语

GPT Image 2 API 并不难接入,第一个请求花一个下午就能完成。真正重要的决策——质量默认值、编辑成本建模、内容审核分层、重试行为、是否添加平台层——是那些在你交付后悄悄复利数月的决策。请有意识地做出选择,先跑小规模试点,其余的自然水到渠成。