Godmod3 AI 详解:无门槛的多模型对话

Godmod3 让你只需一个 OpenRouter 密钥即可并行运行 50 多个 AI 模型——无需安装、无需服务器、无需账号。以下介绍这在实际中意味着什么。

我在完全理解它是什么之前就已经围绕它构建了一套工作流程。通常都是这样的。

上周我同时打开了三个标签页——一个是 Claude,一个是 GPT-5,另一个是 Gemini——把同一个提示词复制粘贴到每一个里面,试图弄清楚哪个模型在处理细微的技术比较时表现最佳。摩擦显而易见:三个登录会话、三个参数面板、三个账单账户,零标准化输出格式。我是 Dora,做过几十次这种跨模型评估,在工作日志里有一条持续更新的备注:“切换成本是隐形的,直到你一周做五十次才会变得非常明显。”

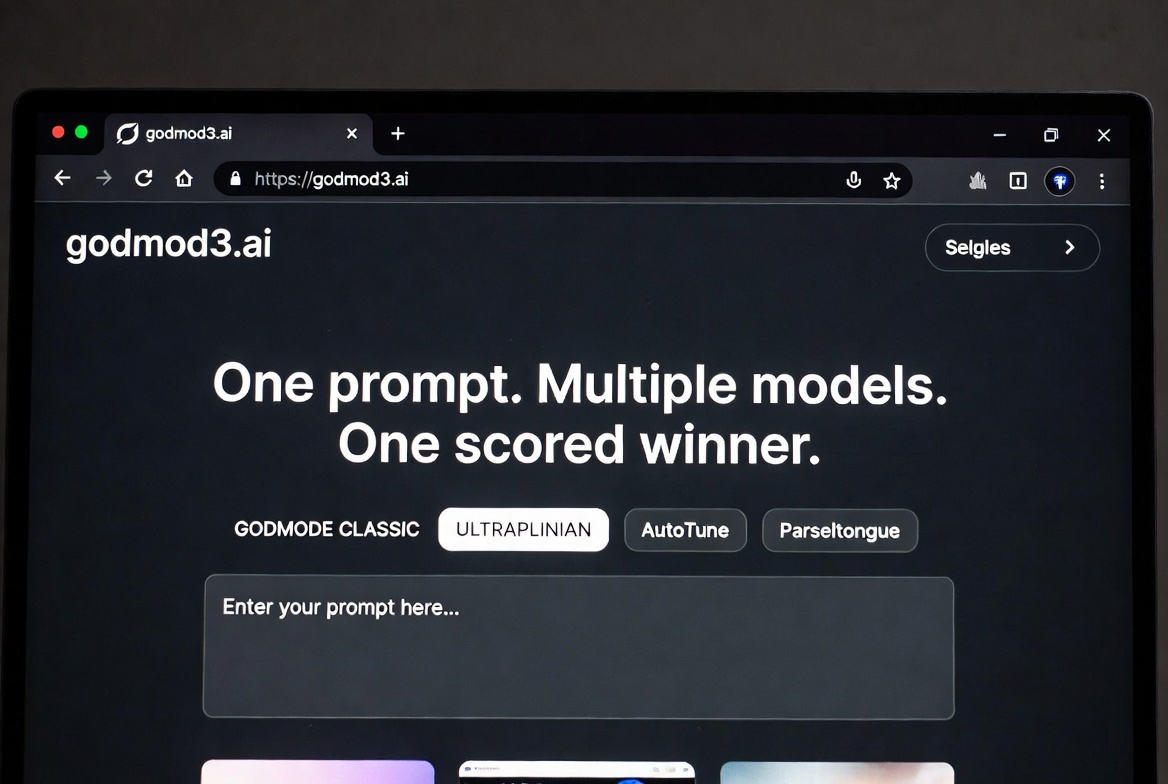

这就是 godmod3.ai 要解决的问题。一个提示词。多个模型。一个得分最高的赢家。以下是在你决定它是否适合你的工作流程之前真正需要了解的内容。

Godmod3 与你当前的 AI 聊天设置对比

单模型问题:为什么在 ChatGPT 和 Claude 之间切换标签页还不够

问题不在于 ChatGPT 或 Claude 不好。问题在于一次只使用一个模型,迫使你在没有比较参照的情况下信任该模型的判断。你输入提示词,得到回复,要么接受,要么重新措辞。你不知道另一个模型是否第一次就能答得很准。

切换标签页来找答案很慢。每个平台都有自己的参数设置、自己的上下文窗口行为、自己对同一指令的解读方式。等你比较完三个输出,在这个过程上花的时间已经超过了实际任务本身。

godmod3.ai 给你的:一个提示词,多个模型,一个赢家

Godmod3 将你的提示词同时发送给多个模型,并排返回结果。在其 ULTRAPLINIAN 模式下,它以 100 分制复合指标对回复进行评分,并自动呈现排名最高的答案。你不需要浏览五个标签页——你直接看结论。

整个界面是一个由 Pliny(elder-plinius)在 AGPL-3.0 许可证下构建的单页浏览器应用。基础托管版本不需要后端服务器。你的 API 密钥保存在浏览器的 localStorage 中。Godmod3 不会在任何服务器上存储你的对话——关闭标签页,它们就消失了。

OpenRouter 依赖关系简单解释

Godmod3 不直接连接 OpenAI、Anthropic 或 Google。它通过 OpenRouter 路由所有请求,这是一个统一的 API 网关,用单个密钥即可访问来自多个提供商的 300 多个模型。你按 token 向 OpenRouter 付费,而非向 godmod3。工具本身是免费的。OpenRouter 同时充当计费层、模型目录和路由基础设施。

访问 Godmod3 的三种方式

托管版本 godmod3.ai——无需安装,带上你的 OpenRouter 密钥即可

前往 godmod3.ai,在设置中粘贴你的 OpenRouter API 密钥,然后开始提问。就这么简单。无需下载、无需 Docker、无需 npm install。托管版本完全去掉了可选的数据集收集功能——它是一个纯客户端聊天界面。

我在落地页面后 60 秒内就开始使用了。摩擦几乎为零,这对开源 AI 工具来说相当罕见。

自托管单文件——克隆并打开 index.html

整个应用程序装在一个 index.html 文件里。克隆 GitHub 仓库,在浏览器中打开 index.html,完成。或者运行 python3 -m http.server 8000 如果你想要本地服务器。无需构建步骤、无需安装依赖、无需配置文件。

如果你想在粘贴 API 密钥之前检查运行的到底是什么代码,这一点很重要。AGPL-3.0 许可证——被开源倡议组织认可为自由软件许可证——意味着源代码完全可审计。

静态部署——5 分钟内部署到 GitHub Pages、Vercel 或 Netlify

因为它是单个 HTML 文件,部署到任何静态托管平台都非常简单。推送到 GitHub 仓库,启用 GitHub Pages,你的个人 godmod3 实例就上线了,URL 由你控制。Vercel 或 Netlify 同理——导入仓库并部署。无需 Serverless 函数,无需环境变量(除了你的 API 密钥,它保留在客户端)。

我测试了 GitHub Pages 路线。从 fork 到上线大约花了三分钟。

四种模式详解

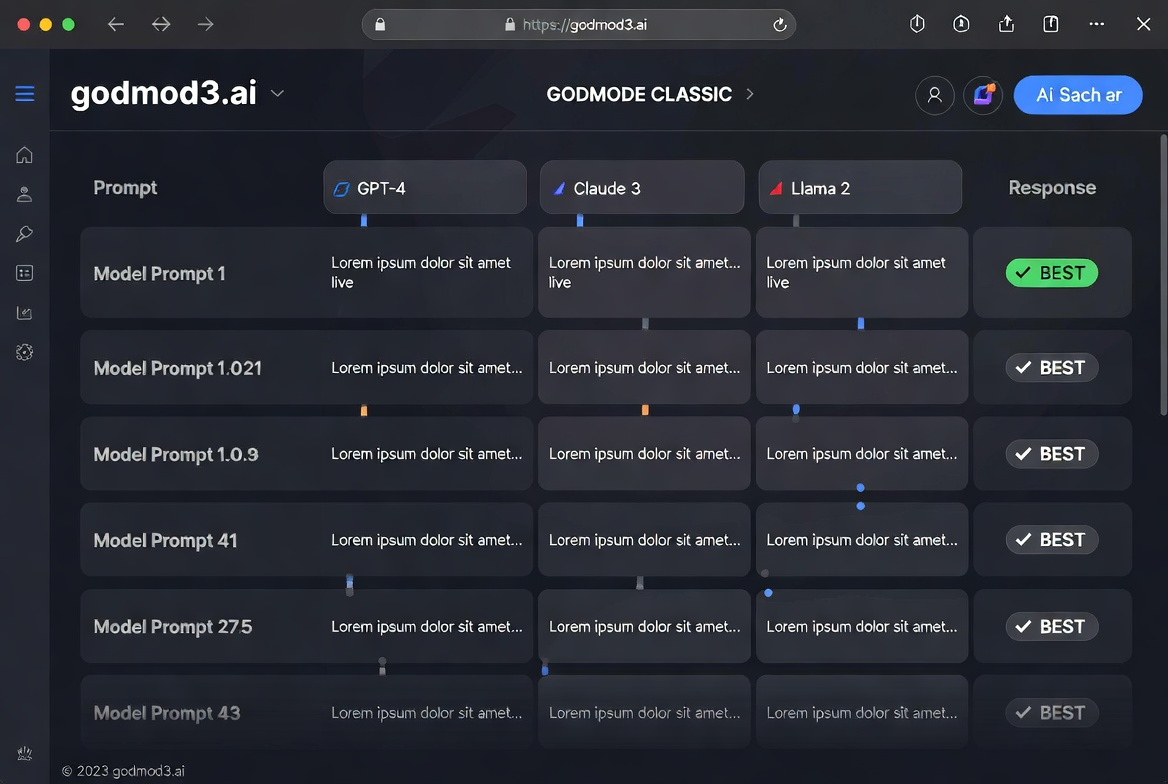

GODMODE CLASSIC——并行竞速模式

原始模式。五个模型-提示词组合并行运行,每个配对一个特定模型与调优后的系统提示词。回复竞速,界面自动呈现最佳结果。它快速且有主见——你信任预设配置,而非自己选择模型。

适合不想考虑参数调整时的快速比较。当你需要特定模型控制时用处不大。

ULTRAPLINIAN——用于严肃比较的深度多模型评估

这是让我停下来认真思考的模式。它可以同时查询多达 51 个模型,以复合指标对每个回复评分并排名。评分考虑相关性、连贯性和回复质量。对于测试不同模型如何处理同一指令的提示词工程师来说,真正的价值就在这里。

但不便宜。并行运行 51 个模型意味着 51 个单独的 API 调用,每个都通过 OpenRouter 计费。我用 10 个模型配置运行了一个中等复杂度的提示词,成本不高——几美分。在 51 个模型下,费用会累积起来。

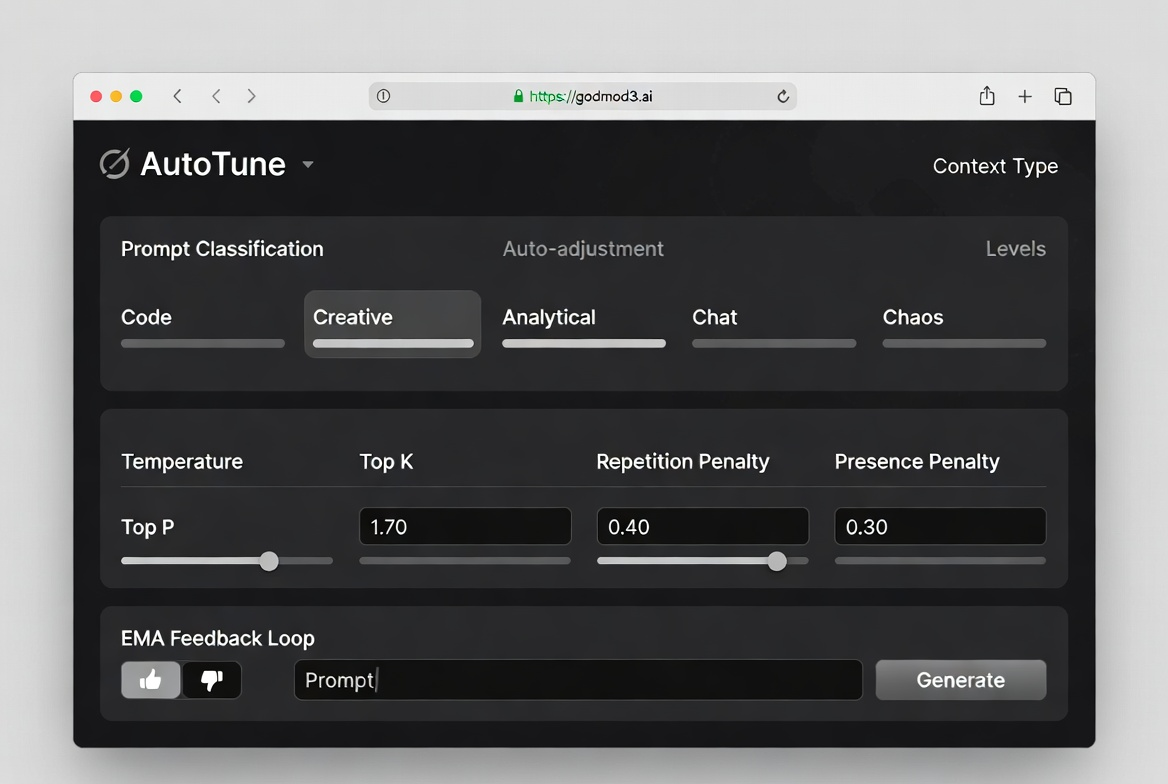

AutoTune——为什么你不再需要手动设置 temperature

AutoTune 将你的提示词分类为五种上下文类型之一——代码、创意、分析、聊天或混沌——并自动调整 temperature、top_p、top_k 和惩罚参数。它使用基于 EMA 的反馈循环:对回复点赞或踩会优化未来的参数选择。

我仍然不完全确定这比手动将 temperature 设置为 0.7 并保持不变有多大区别。使用一周后,参数选择感觉合理,但并没有比我的默认值好多少。这个结论有失效日期——反馈循环需要更多数据才能收敛。

Parseltongue——面向安全研究人员的输入扰动(及其用途说明)

Parseltongue 是一个红队研究模块。它检测触发词并应用字符级别的转换——leet 语、Unicode 替换、语音编码——来研究模型如何响应对抗性输入。项目研究论文明确将其定位为用于测试推理时模型鲁棒性的 AI 安全评估工具。

这不是内容绕过工具。 它专为在受控条件下研究安全层如何响应输入扰动而设计。区别很重要。如果你的使用场景是”我想诱骗 AI 说它不该说的话”,这不是该模块的用途,项目文档直接说明了这一点。

通过 OpenRouter 访问模型

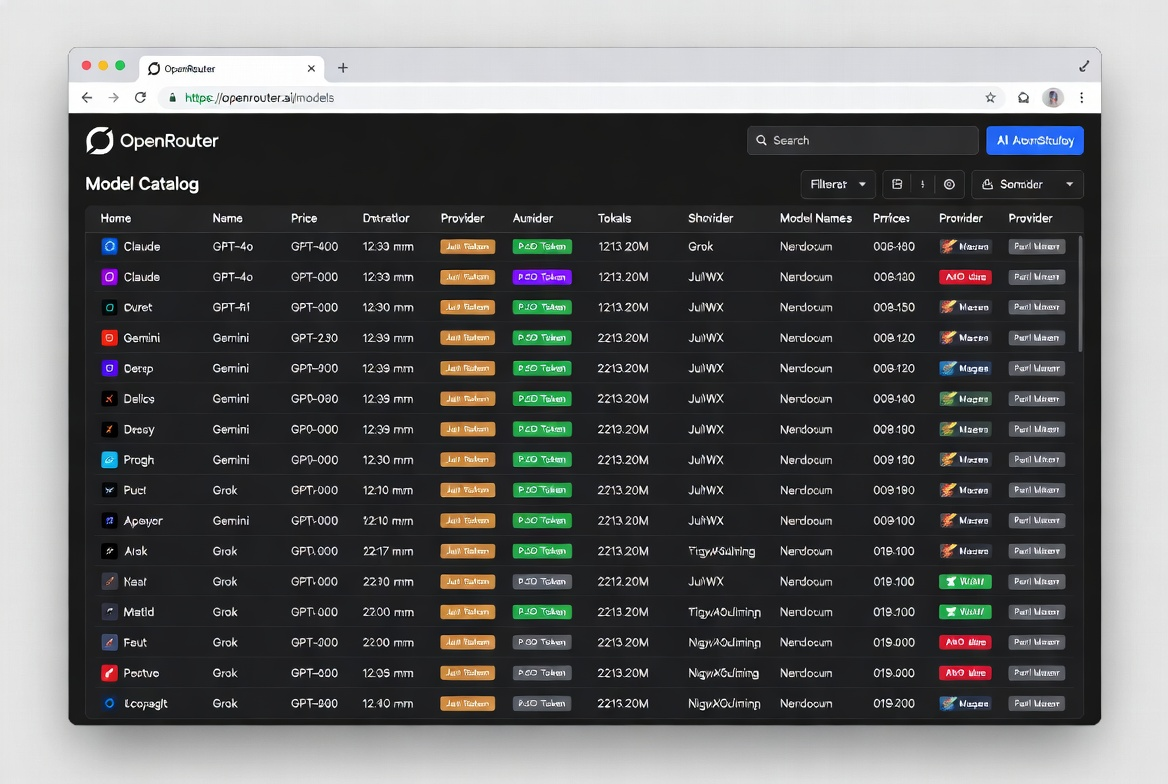

哪些模型可用

通过 OpenRouter,godmod3 可以访问 Claude、GPT-4o、Gemini、Grok、Mistral、Llama、DeepSeek、Qwen 等数十个模型。截至 2026 年 4 月,OpenRouter 模型目录列出了来自 60 多个提供商的 300 多个选项。并非所有模型都适合每项任务,但广度意味着你不太可能碰到”模型不可用”的墙。

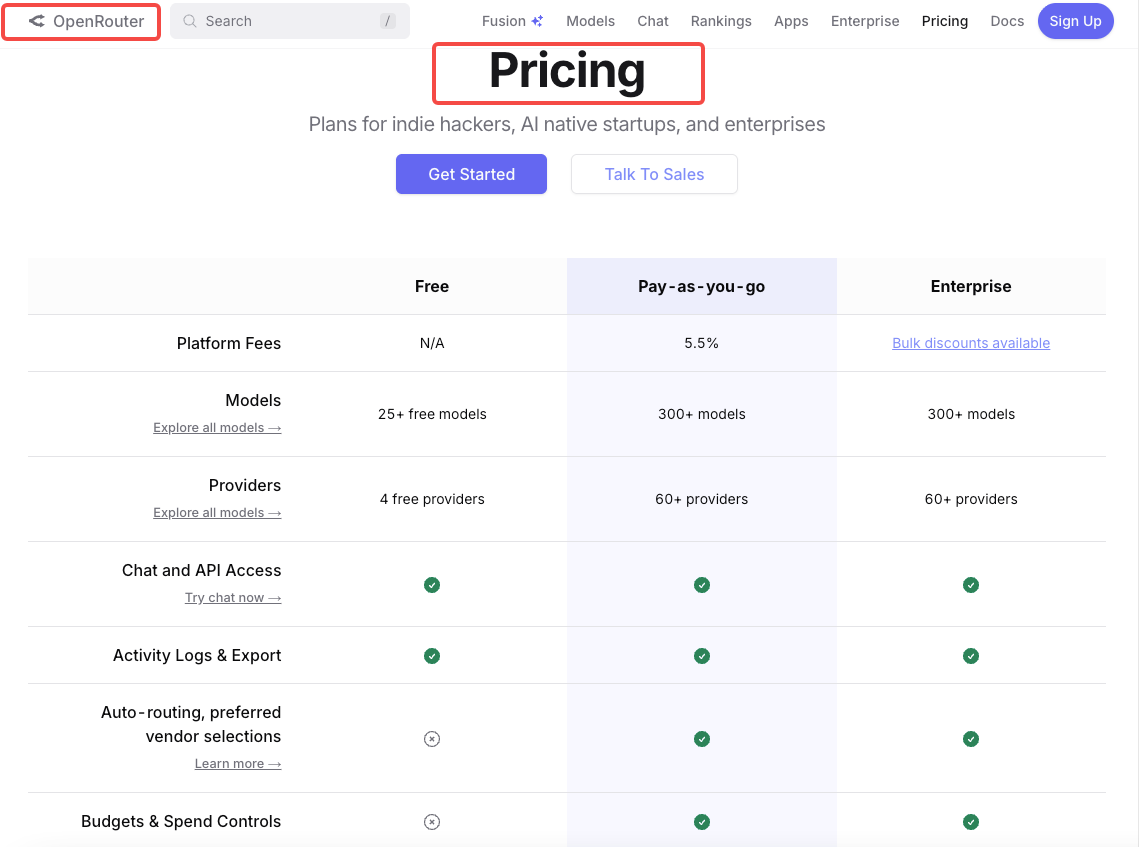

定价现实:你按 token 向 OpenRouter 付费,而非 godmod3

Godmod3 本身免费。你的费用来自 OpenRouter 的按 token 计费,该计费以接近或等于直接 API 费率的价格转嫁每个提供商的定价。通过一个模型运行提示词的成本与直接调用该模型的 API 相同。通过十个模型运行则是十倍成本。

OpenRouter 定价页面按模型列出了每 token 的费率。没有月费,没有最低消费。你添加额度,使用时扣除。

今天就可以在 godmod3 上使用的 OpenRouter 免费模型

OpenRouter 维护着一个免费模型集合——目前约有 29 个选项,包括 DeepSeek R1、Llama 3.3 70B、Qwen3 Coder 和几个 Gemma 变体。免费模型有速率限制(通常每分钟 20 个请求,每天 200 个),但不需要额度。

在投入任何资金之前,用免费套餐测试 godmod3 是否适合你的工作流程已经足够形成判断。

Godmod3 不是什么

不是后端——聊天记录只存在于你的浏览器中

没有账户、没有云同步、没有服务器端存储。清除浏览器数据,你的对话将永久消失。 切换设备,什么都不会跟随你。隐私浏览模式在窗口关闭时丢弃所有内容。

这是一个隐私特性,而非限制——但这意味着 godmod3 是一个草稿本,而不是知识库。

不是生产 API 的替代品

如果你在构建一个调用 LLM 的产品,你需要直接的 API 集成,包含重试逻辑、错误处理和速率限制管理。Godmod3 是一个研究和评估界面,不是生产基础设施。项目自身的文档对此很明确。

不是绕过工具——Parseltongue 在 AI 安全研究中的用途

值得重申:Parseltongue 的存在是为了在受控条件下研究模型鲁棒性。该项目将自己定位在更广泛的 AI 安全研究领域中,与宪法 AI 和 RLHF 等框架并列。它提供推理时评估工具——而非训练时修改。文档中承认了双重用途风险,用户有责任遵守当地法律。

谁能从 Godmod3 中获得最大价值

需要快速多模型比较的提示词工程师

如果你在提交到某个模型之前,正在测试一个提示词在 Claude、GPT-4o 和 Gemini 上的表现,godmod3 将这个工作流程从”三个标签页、三次登录、手动比较”压缩为”一个提示词、一个屏幕、排名结果”。这是核心价值。

在承诺使用某个 API 之前评估哪个 LLM 适合其用例的开发者

在你集成某个 API 并围绕其特性进行构建之前,你想知道:这个模型能很好地处理我的用例吗?并行运行相同的测试提示词通过 5-10 个模型,几分钟内就能得到比较矩阵,而不是几天。

进行受控 LLM 行为研究的研究人员

AutoTune(参数变化)、Parseltongue(输入扰动)和 ULTRAPLINIAN(跨模型评分)的组合创建了一个结构化的评估流程。对于研究模型在不同条件下如何响应的学术或行业研究人员来说,这是一个现成的工具包,无需构建自定义基础设施。

常见问题

godmod3.ai 和 GitHub 上的 G0DM0D3 是同一个东西吗?

是的。“Godmod3”和”G0DM0D3”指的是同一个项目。godmod3.ai 上的托管版本运行的代码与 GitHub 仓库相同。主要区别在于托管版本不包含可选的数据集收集功能——该功能仅在使用完整基于 Docker 的 API 服务器自托管时可用。

使用 godmod3 需要付费吗?

工具本身免费。你需要 OpenRouter API 密钥,使用付费模型时 OpenRouter 按 token 收费。你可以在 OpenRouter 上免费使用免费模型,但受速率限制。godmod3 没有订阅费,没有平台费。

我的 API 密钥在 godmod3.ai 上安全吗?

你的 OpenRouter 密钥存储在浏览器的 localStorage 中,直接发送到 OpenRouter 的 API。它从不接触 godmod3 的服务器。话虽如此,你在信任客户端代码不会泄露它——这就是为什么开源代码库很重要。你可以自己审计,或者自托管以获得完全控制。

我可以不用 OpenRouter 账户使用 godmod3 吗?

不行。OpenRouter 是所有模型访问的路由层。你需要一个 OpenRouter 账户和一个 API 密钥。如果只使用免费模型,账户创建是免费的,不需要信用卡。

如果我关闭浏览器,我的聊天记录会怎样?

它保留在 localStorage 中,直到你清除浏览器数据。但没有备份、没有同步、没有恢复。如果你需要保留对话,请在关闭标签页前手动复制出来。

我已经使用 godmod3 大约十天了。它没有取代我的直接 Claude 或 GPT 订阅——对于需要上下文连续性的长对话工作流程,这些订阅仍然重要。但对于”哪个模型最能处理这个提示词”这个特定任务,它将我的比较时间从几分钟缩短到了几秒钟。

这是我能确认的全部。其余的你需要自己验证。

往期文章: