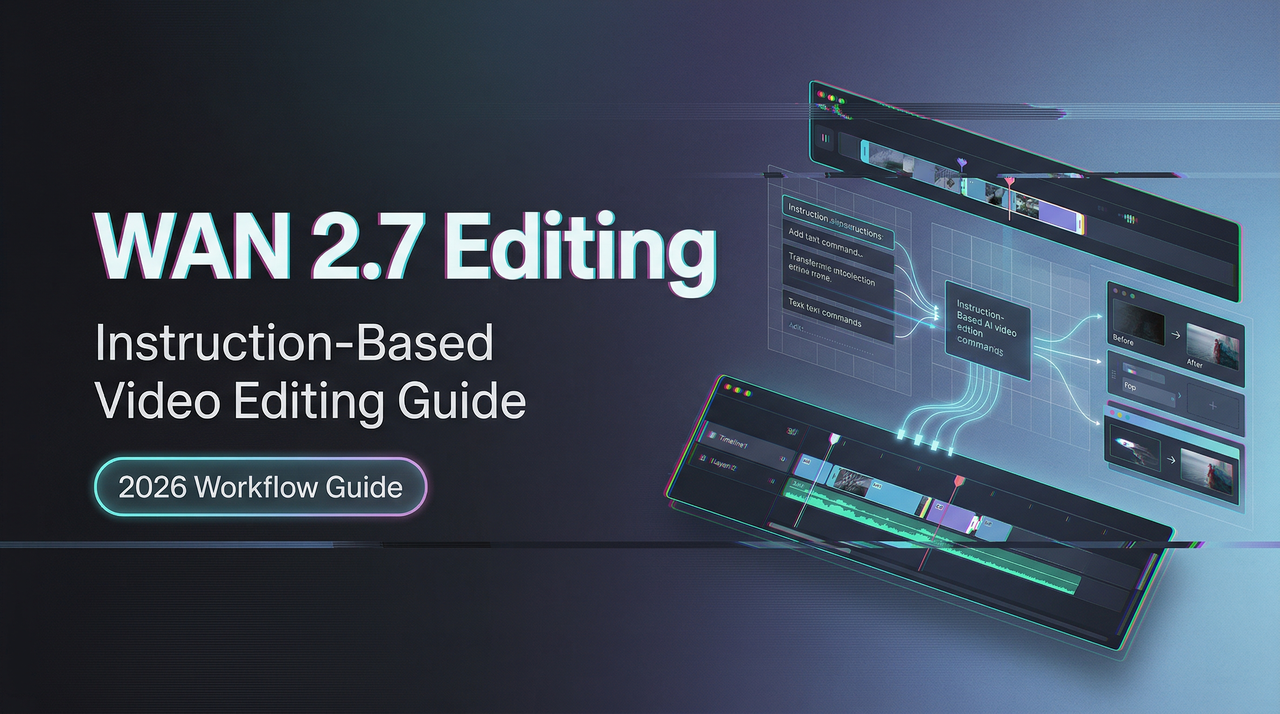

Руководство по редактированию видео на основе инструкций в WAN 2.7

WAN 2.7 добавляет редактирование видео на основе инструкций. Что это такое, что можно редактировать, как это вписывается в производственный конвейер и что нужно знать разработчикам.

Привет всем. Меня зовут Дора. Я работаю с инструментами AI-видео уже некоторое время, и когда впервые услышала о функции редактирования по инструкциям в WAN 2.7, я не была сразу убеждена, что это изменит что-то существенное. Редактирование видео с помощью текстовых команд звучало как одна из тех функций, которые хорошо выглядят в демо, но разваливаются, когда они действительно нужны.

Признаю, что была отчасти неправа.

Что означает редактирование по инструкциям в WAN 2.7

Вы берёте существующий видеоклип, пишете, что хотите изменить, и модель корректирует именно этот элемент, сохраняя всё остальное нетронутым. Не перегенерация. Редактирование.

Чем это отличается от стандартной генерации текст-в-видео

Текст-в-видео начинается с нуля. Вы пишете промпт и получаете то, что получается.

Редактирование по инструкциям начинается с того, что уже существует. Клип есть. Тайминг задан. Вы просите модель изменить одну деталь — поменять фон, сдвинуть освещение, перекрасить наряд — не затрагивая остального.

В анализе WaveSpeedAI отмечается, что это имеет операционное значение: циклы итераций, которые ранее требовали перегенерации клипов с нуля, теперь можно выполнять как лёгкие правки. Перегенерировать из-за неправильного цвета пиджака казалось расточительным. Отредактировать только пиджак — правильным.

Чем это отличается от воссоздания видео

Воссоздание берёт структуру движения из референсного видео и применяет её к новым объектам или стилям. Перенос движения.

Редактирование по инструкциям изменяет. Исходный клип остаётся; меняется только тот элемент, который вы указали.

Что получает модель на вход

Два элемента: исходное видео (до 15 секунд в разрешении 1080P) и инструкция на естественном языке.

Что меня удивило: никаких масок, никакой изоляции слоёв. Только клип и предложение.

Что можно и нельзя редактировать с помощью инструкций

Поддерживаемые категории редактирования

По результатам тестирования и документации платформы Dzine, редактирование по инструкциям поддерживает:

- Замену фонов (с интерьера на улицу, с солнечного на дождливый)

- Изменение освещения (с золотого часа на синий час)

- Корректировку объектов (изменить цвет рубашки, добавить реквизит)

- Изменение стиля (из реалистичного в иллюстративный)

Это работает, потому что изменения ограничены. Модель понимает, что такое фон, что делает освещение.

Что не поддаётся редактированию по инструкциям

Сложные пространственные перестановки работают плохо. «Переместить персонажа влево» не давало чистых результатов. Персонаж оставался на месте или композиция смещалась неловко.

Сцены с высокой идентификационной нагрузкой — конкретные выражения лица, мелкие детали логотипов — сопротивляются редактированию. Модель может менять освещение, но с трудом сохраняет точные черты при изменении выражения или возраста.

Физические изменения непредсказуемы. «Сделать воду более быстрой» иногда работало, иногда выглядело артефактно.

Гранулярность редактирования

Все правки осуществляются на уровне промпта. Вы описываете, что меняется; модель сама определяет, к какой части это относится. Целевого выделения объектов пока нет.

Я научилась писать очень конкретные инструкции. «Изменить пиджак на красный» работало лучше, чем «сделать наряд в более тёплых тонах».

Составление эффективных инструкций для редактирования

Что делает инструкцию хорошей

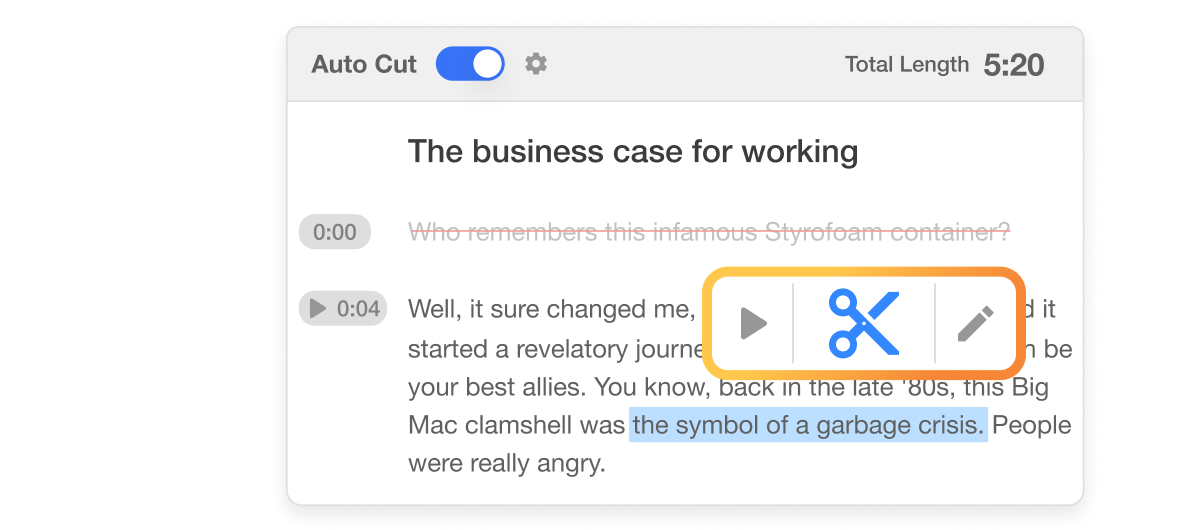

Хорошие инструкции конкретны, направленны и ограничены. Этот подход перекликается с философией инструментов вроде Descript, где можно редактировать видео просто редактируя текст — без масок и изоляции слоёв.

«Изменить небо на пасмурное с тёмными облаками» работало стабильно. Указывается, что меняется, на что меняется, и добавляется детализация.

«Сделать это более драматичным» — нет. Слишком расплывчато. Модель каждый раз интерпретировала это по-разному.

Что делает инструкцию плохой

Инструкции, противоречащие исходному клипу, тихо проваливаются. «Убрать человека из сцены» на кадре с персонажем в фокусе либо игнорировалось, либо давало сломанные кадры.

Инструкции с несколькими конфликтующими элементами дают сбои. «Изменить пиджак на синий, фон на лес и добавить дождь» — три правки сразу. Одна правка на инструкцию работала лучше. Этот чёткий паттерн промптинга — указать, что меняется, и описать целевое состояние — совпадает с лучшими практиками в текстовом редактировании видео Visla, где вы уточняете видеоматериал, напрямую редактируя транскрипт.

Паттерн промпта

Паттерн, который сработал:

- Указать, что меняется

- Описать целевое состояние

- Уложиться в 15 слов

«Заменить городской фон на горный пейзаж» — чёткий объект, чёткая цель, чистый результат.

Требования к входным данным

Спецификация исходного видео

Исходные видео: от 2 до 15 секунд, до 1080P. Я тестировала 5-секундные клипы в 1080P и 10-секундные в 720P. Оба варианта работали.

Соответствие референса

Если в исходном видео есть сильное размытие движения, резкие монтажные склейки или экстремальная экспозиция, качество правок ухудшается. Модели нужны чёткие кадры.

Кадры с быстрой панорамой давали смазанную замену фонов. Статичные или медленно движущиеся кадры давали чистые правки.

Место редактирования по инструкциям в производственном пайплайне

Я не ожидала использовать это как основной инструмент. Думала, это будет что-то новенькое. Ошиблась.

Цикл полировки после генерации

После генерации клипа с помощью стандартного текст-в-видео я часто получала 80% от того, что хотела. Движение было правильным, кадрирование было правильным, но цветокоррекция казалась неудачной или фон не соответствовал брифу.

До редактирования по инструкциям это означало перегенерацию с изменёнными промптами в надежде на успех. Процент попаданий: около 40%. Каждая перегенерация занимала 60-90 секунд, и я нередко тратила три-четыре попытки, прежде чем получить что-то пригодное.

Теперь я генерирую один раз, затем редактирую конкретный элемент, который не так. Процент попаданий ближе к 70%, и итерации быстрее. Вместо трёх полных перегенераций по 90 секунд каждая (итого 4,5 минуты), я делаю одну генерацию плюс одну правку (примерно 2,5 минуты). Экономия времени накапливается по нескольким проектам.

Итерация стилей без полной перегенерации

Я проверила это, сгенерировав один базовый клип с персонажем, идущим по городской улице, а затем создав три стилевых варианта с помощью инструкций:

- «Переключиться на киберпанк-неоновую эстетику»

- «Изменить на стиль акварельной живописи»

- «Сделать чёрно-белый нуар»

Все три правки сохранили оригинальное движение и композицию. Изменился только визуальный стиль. Цикл ходьбы персонажа остался идентичным. Движение камеры не сдвинулось.

Это полезно для презентаций клиентам, когда нужно показать варианты концепций без трёхкратной перегенерации всей сцены. Также полезно для A/B-тестирования рекламных креативов без расхода кредитов на генерацию.

Я попробовала тот же рабочий процесс с перегенерацией вместо редактирования — написала три разных промпта со стилевыми ключевыми словами. Два из трёх вернулись с немного другим таймингом движения, что нарушило сравнение. Редактирование сохранило всё сопоставимым, кроме той стилевой переменной, которую я тестировала.

Сравнение стоимости: редактирование vs перегенерация

Согласно анализу затрат WaveSpeedAI, редактирование по инструкциям, вероятно, будет иметь иной профиль стоимости по сравнению со стандартной генерацией, но точные цены ещё не опубликованы.

С точки зрения рабочего процесса, даже если редактирование стоит столько же за секунду, что и генерация, на практике оно всё равно дешевле, потому что вы не выбрасываете неудачные попытки. Одна генерация плюс одна целевая правка лучше трёх полных перегенераций.

Расчёт: если генерация стоит $0,12/секунду для 1080P (цены WAN 2.6 от PiAPI), 5-секундный клип стоит $0,60. Три перегенерации стоят $1,80. Одна генерация плюс одна правка — даже если правка стоит те же $0,60 — обойдётся только в $1,20. Это экономия в 33% только за счёт сокращения потерь.

Если редактирование окажется дешевле генерации (что вероятно, учитывая, что оно изменяет существующие кадры, а не создаёт новые с нуля), экономия умножается.

Последствия для доступа через API

Отдельный эндпоинт или флаг параметра?

Анализ WaveSpeedAI предполагает, что редактирование по инструкциям потребует новых полей в пейлоаде — вероятно, параметра edit_instruction и, возможно, отдельного эндпоинта.

Жду официальной документации API перед интеграцией в продакшн.

Стоимость токенов и вычислений

Многовходовой инференс тяжелее, чем однотиповая генерация. Редактирование по инструкциям обрабатывает и исходное видео, и инструкцию, что означает более высокую вычислительную стоимость.

Планируйте бюджет соответственно, но не финализируйте прогнозы до публикации цен.

Соображения об асинхронных задачах

Все операции WAN выполняются асинхронно. Отправить запрос, получить ID задачи, опрашивать до завершения.

Ожидаемое ожидание по моим тестам: от 30 секунд до 2 минут для 5-секундной правки в 1080P.

Часто задаваемые вопросы

Доступно ли редактирование по инструкциям через WaveSpeed API при запуске?

WAN 2.7 запускается в течение марта 2026 года. Доступность API для редактирования по инструкциям пока не подтверждена. WaveSpeedAI обычно добавляет новые эндпоинты в течение нескольких дней после официальных релизов.

Какой может быть длина исходного видео для редактирования?

До 15 секунд в 1080P. Более короткие клипы (2-5 секунд) обрабатываются быстрее и дают более чистые правки.

Сохраняет ли редактирование оригинальный звук? Зависит от правки. Замена фона сохраняет звук. Изменения стиля, затрагивающие визуальную эстетику, иногда влияют на синхронизацию. Стоит тестировать в каждом конкретном случае.

Предыдущие публикации:

- Узнайте, как работает редактирование по инструкциям на естественном языке в WAN 2.7

- Изучите ключевые различия между WAN 2.7 и WAN 2.6, особенно для лёгких правок по инструкциям

- Узнайте практические способы сочетания редактирования по инструкциям с управлением первым/последним кадром

- Изучите новые возможности WAN 2.7, включая редактирование по инструкциям и путь обновления API

- Поймите реальные производственные сценарии использования и преимущества итераций с редактированием по инструкциям в WAN 2.7