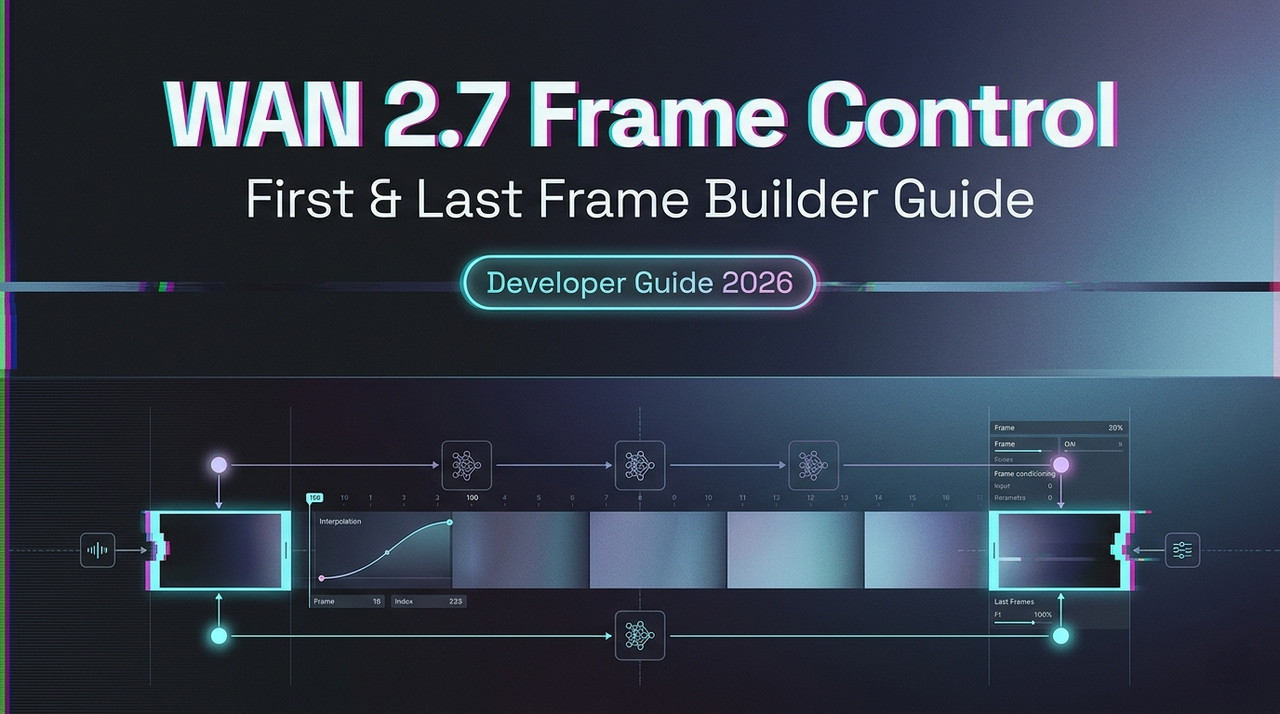

WAN 2.7: Управление первым и последним кадром — руководство разработчика

Как использовать управление первым и последним кадром в WAN 2.7 для предсказуемой генерации видео — подготовка входных данных, параметры API и советы по производственному процессу.

Привет, ребята, Дора приближается. Я постоянно видел, как команды описывают управление первым/последним кадром как «просто загрузи два изображения». Это всё равно что описывать асинхронные очереди задач как «просто подожди». Механика не сложна — но именно решения по проектированию входных данных незаметно разрушают большинство производственных рабочих процессов.

Это руководство для разработчиков, которым нужен воспроизводимый результат, а не просто демо, которое сработало один раз.

Что на самом деле делает управление первым и последним кадром

Проблема, которую оно решает, по сравнению со стандартным I2V

Стандартный image-to-video (I2V) привязывает начальный кадр, а затем модель импровизирует. Результатом является то, что сообщество часто называет «дрейфом» — субъект, положение камеры или освещение постепенно отклоняется от любого целевого состояния, которое вы имели в виду. Для демонстрации продуктов или нарративных последовательностей с требуемой конечной точкой это дорого исправлять в постобработке.

Подход FLF2V от WAN использует дополнительный механизм управляющей корректировки: первый и последний кадры обрабатываются как условия управления, а семантические признаки обоих изображений внедряются в процесс генерации. Это обеспечивает согласованность стиля, содержания и структуры, пока модель динамически трансформируется между ними.

Как оба кадра используются в процессе генерации

Модель не просто интерполирует значения пикселей. Она использует семантические признаки CLIP и механизмы cross-attention для стабилизации видео — эта конструкция, как было показано, снижает дрожание видео по сравнению с однокадровыми подходами. Ваш первый кадр определяет начальное состояние; последний кадр ограничивает пункт назначения. Траектория движения между ними выводится, а не задаётся явно — и это одновременно сила и главный режим сбоя.

Что модель выводит о пути между кадрами

Ваш текстовый промпт направляет как происходит переход — а не только что он происходит. Если в промпте сказано «продукт медленно вращается и открывает свою переднюю сторону», это описание движения формирует выводимую траекторию. Без промпта модель всё равно попытается выполнить правдоподобный переход, но у вас будет гораздо меньше контроля над сменой направления, движением камеры или темпом.

Подготовка входных данных

Требования к характеристикам изображений

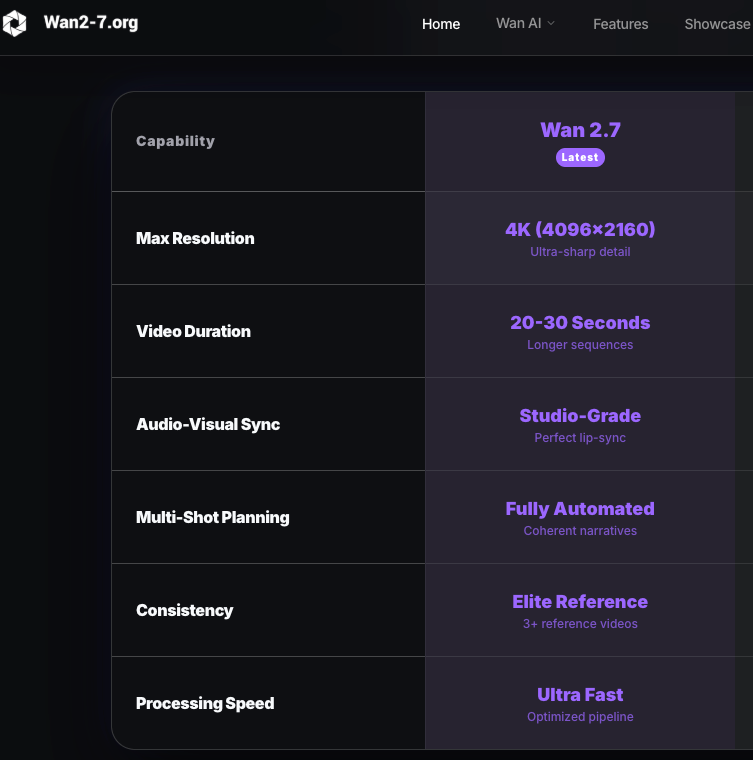

Модель использует соотношение сторон вашего первого кадра как можно ближе к целевому выводу. Для входного изображения 3:4 (750×1000) настройка вывода 720P произведёт что-то около 816×1104 — не точно 3:4. Если вам нужны точные соотношения, планируйте кадрирование или letterbox в постобработке. Для серии WAN в целом 720p (1280×720 или портретный эквивалент) является рекомендуемым разрешением для качественного вывода; использование меньших разрешений — допустимая стратегия для тестовых итераций, но не для финальных версий.

Формат: PNG или высококачественный JPEG. Избегайте сжатых миниатюр в качестве первого/последнего кадров — артефакты сжатия вносят шум, который модель вынуждена интерпретировать как намеренную визуальную информацию.

Стратегии сочетания кадров, которые работают

Наиболее сильные пары разделяют три вещи: согласованное направление источника света, соответствующие характеристики глубины резкости и субъект, который пространственно правдоподобен в обоих положениях. Снимок продукта в рассеянном студийном свете в паре с конечным кадром, показывающим тот же продукт под немного другим углом, работает хорошо. Снимок упаковки с переходом к рекламному lifestyle-снимку работает, если условия освещения схожи.

Для нарративных последовательностей думайте о паре как об определении глагола: открыто → закрыто, до → после, сборка → завершено. Чем чище семантическое отношение, тем более когерентной будет выведенная траектория.

Что делает пару кадров плохой

Три распространённых виновника:

Несогласованное направление освещения. Если в вашем первом кадре ключевой свет под 45° слева, а последний кадр снят с верхним освещением, модель попытается перейти между двумя разными световыми средами. Результатом обычно является скачок источника света в середине клипа, который выглядит как ошибка рендеринга.

Пространственное несоответствие. Широкий общий план в паре с крупным планом заставляет модель придумывать движение камеры. Иногда это намеренно; как правило, нет. Сохраняйте фокусное расстояние примерно одинаковым, если только вы явно не задаёте zoom или отъезд камеры.

Конфликтующие глубинные подсказки. Боке в первом кадре и всё в фокусе в последнем — модель интерпретирует это как изменение глубины резкости и попытается его анимировать. Это не всегда неправильно, но редко соответствует тому, что вы задумывали.

Реализация через API

Следующее отражает задокументированный паттерн FLF2V для серии WAN. Перед использованием в продакшене проверьте актуальные имена параметров и пути эндпоинтов в документации Alibaba Cloud Model Studio. Специфику WAN 2.7 API следует подтвердить на момент запуска.

Структура полезной нагрузки

Основной паттерн включает два изображения на входе — одно через публичный URL или путь к локальному файлу — передаваемые как first_frame_url и last_frame_url, вместе с текстовым промптом и настройкой разрешения.

Паттерн запроса на Python (псевдокод)

# Проверьте имя модели и эндпоинт на момент запуска — имена меняются между версиями

import os

from dashscope import VideoSynthesis

response = VideoSynthesis.async_call(

model="wan2.x-flf2v-<verify-at-launch>", # подтвердите точную строку модели

first_frame_url="https://your-cdn.com/start.png",

last_frame_url="https://your-cdn.com/end.png",

prompt="Fixed camera. Begin from first image, end at last image. [describe motion]",

negative_prompt="flicker, warping, blur",

resolution="720P", # проверьте допустимые значения

# параметр seed: зафиксируйте его, когда получите хороший результат

)

task_id = response.output.task_idАсинхронная обработка длительных задач

Задачи генерации image-to-video обычно выполняются 1–5 минут. API использует двухшаговый асинхронный паттерн: отправьте задачу, получите ID задачи, затем опрашивайте результат. Встройте опрос в свой конвейер с самого начала. Не предполагайте синхронного поведения даже для тестовых вызовов — тайм-ауты будут молча отбрасывать результаты в наивных реализациях.

Производственный процесс: метод от черновика к финалу

Шаг 1 — Создайте эталонную пару и запустите тест

Начните с одной пары. Не запускайте пакетную обработку, пока не увидите один вывод от начала до конца. Используйте ваш целевой контент — не заготовленные стоковые изображения — поскольку пространственные характеристики и освещение должны соответствовать вашей фактической библиотеке ресурсов.

Шаг 2 — Проверьте траекторию движения перед пакетной обработкой

Просмотрите полный клип один раз на скорости 0.5x. Ищите: дрожание в середине клипа, дрейф идентичности субъекта в районе 50–70% клипа (именно здесь концентрируется большинство артефактов) и разрыв освещения. Если вы видите что-либо из этого, исправьте входную пару, прежде чем трогать промпт.

Шаг 3 — Зафиксируйте лучший seed для согласованности

Когда у вас есть чистый вывод, запишите значение seed. Модель FLF2V принимает опциональный промпт для управления промежуточным действием и логикой трансформации. Зафиксированный seed плюс зафиксированный промпт дают воспроизводимую единицу генерации, которую можно применять к схожим входным парам. Именно это делает пакетное производство предсказуемым, а не вероятностным.

Шаг 4 — Масштабируйте до пакетной генерации

Структурируйте пакет так: одна канонческая «тестовая пара», служащая якорем качества, затем варианты пар, сгенерированные из той же контролируемой съёмочной установки. На странице модели WAN FLF2V на Hugging Face задокументирована версия с открытыми весами для команд, использующих локальный инференс вместе с вызовами API.

Где эта функция подходит (и где нет)

Лучше всего для: демонстрационных последовательностей продуктов, где конечная точка важна (снимок упаковки → раскрытие функции), съёмок нарративной непрерывности с определённым «до/после», управляемых траекторий камеры, где вам нужна пространственная стабильность в нескольких клипах серии.

Не идеально для: высокодинамичного движения с резкими сменами направления (модель сгладит их, часто теряя динамику), неоднозначных пространственных переходов, где первый и последний кадры не имеют чёткого семантического отношения, или сценариев, требующих точного по кадрам тайминга — темп контролирует модель, а не вы.

Типичные паттерны сбоев и их устранение

Двигательный артефакт в середине клипа. Обычно вызван пространственным несоответствием во входной паре. Модель «берёт обязательство» перед траекторией интерполяции рано, и несоответствие проявляется в районе середины. Исправление: укрепите связь между кадрами, прежде чем менять промпт.

Несоответствие стиля кадров. Если ваш первый кадр — стилизованный рендер, а последний — фотография, модель попытается смешать визуальные стили. Это редко даёт чистый результат. Подбирайте одинаковую обработку изображений — оба рендера, обе фотографии, обе иллюстрации.

Модель игнорирует последний кадр. Это происходит, когда промпт описывает движение, которое логически не может завершиться на вашем последнем кадре. Модель отдаёт приоритет когерентности промпта над соответствием кадру при конфликте. Пишите промпт так, чтобы прийти к последнему кадру, а не просто уйти от первого.

Часто задаваемые вопросы

- Можно ли использовать первый/последний кадр с text-to-video или только с I2V? Режим FLF2V является расширением I2V. Оба входных кадра обязательны. Стандартный T2V не принимает ограничения конечного кадра по замыслу.

- Какой формат изображения лучше всего подходит для входных кадров? PNG для всего, что требует чистых краёв или обработки прозрачности. Высококачественный JPEG (>90 качества) подходит для фотографий. Избегайте WebP, если ваша платформа не подтвердила поддержку.

- Стоит ли это дороже стандартного I2V? Ценообразование зависит от разрешения — 720p стоит примерно вдвое больше 480p за генерацию. FLF2V сам по себе не несёт отдельной надбавки в задокументированном ценообразовании, но уточните это на вашей конкретной платформе.

- Как мне обрабатывать движение, требующее резких смен направления? Разбейте последовательность на несколько клипов с промежуточными кадрами в качестве конечных точек. Соедините их в постобработке, вместо того чтобы пытаться получить от одной генерации прерывистое движение.

- Можно ли совместить это с режимом ввода 9-сетки? Это отдельные режимы ввода. WAN 2.7 поддерживает управление первым/последним кадром и image-to-video с 9-сеткой как отдельные функции. В настоящее время они не объединены в одном вызове — проверьте на момент запуска, изменится ли это.

Заключение

Интересное пространство для проектирования при управлении первым/последним кадром — это не вызов API, а входная пара. Именно здесь находится реальный производственный рычаг, и именно здесь большинство команд недоинвестируют. Хорошо спроектированная пара кадров с чётким семантическим отношением будет стабильно превосходить идеальный промпт, сочетающийся с несоответствующими входными данными.

Для команд, создающих пакетные конвейеры: относитесь к библиотеке входных пар как к первоклассному ресурсу, а не как к второстепенному. Когда у вас есть зафиксированный seed и проверенный формат пар, сторона генерации становится рутинной. Сообщество ComfyUI подробно задокументировало конфигурации рабочих процессов WAN FLF2V, если вы также используете локальный инференс вместе с вызовами API — стоит прочитать для понимания на уровне узлов того, как на самом деле работает кондиционирование кадров.

Я продолжаю возвращаться к одной тихой мысли: ограничение и есть функция. Указание модели пункта назначения заставляет вас быть точными в том, чего вы действительно хотите. Это не ограничение — это дисциплина, которая, как правило, даёт лучший результат, чем открытая генерация когда-либо даёт.

Продолжайте исследовать рабочие процессы AI-видео:

- Посмотрите, как управление первым/последним кадром сравнивается с другими моделями генерации видео

- Узнайте, как поддерживать согласованность персонажей в сгенерированных видеоклипах

- Изучите реальные сценарии использования генерации AI-видео в производственных рабочих процессах

- Узнайте, как мульти-изображенческие входные данные улучшают контроль генерации

- Посмотрите, как конвейеры image-to-video используются в различных инструментах