WAN 2.7: Новые функции, доступ к API и путь обновления

WAN 2.7 — крупное обновление от Alibaba: управление первым/последним кадром, сетка 9 изображений для I2V, голосовые референсы и редактирование по инструкциям. Всё, что нужно знать разработчикам.

Привет всем. Это Дора! Я внимательно слежу за семейством моделей Wan начиная с версии 2.1 — в основном потому, что как только модель начинает набирать популярность в production-пайплайнах с открытым исходным кодом, она развивается быстрее, чем успевают выходить обзоры. WAN 2.7 всё ещё готовится к выходу — запуск запланирован в пределах марта 2026 года, — так что это не рецензия на релиз. Это предстартовый чеклист для команд, уже работающих с версией 2.5, которым нужно решить: перестраивать инфраструктуру или подождать.

Без хайпа. Только то, что подтверждено, что ещё туманно и …что это значит для вашей очереди сборок. Если вы ещё разбираетесь, где такие модели, как Wan, вписываются в production-стек, этот обзор использования инструментов генерации AI-видео в реальных рабочих процессах поможет принять взвешенное решение, прежде чем углубляться в технические характеристики.

WAN 2.7 за 60 секунд (краткая версия)

Если вы оцениваете с точки зрения продукта или разработки: WAN 2.7 выглядит скорее как функциональное расширение, нежели чисто качественный скачок. Главное — не «лучшее видео», а «больше точек управления». Улучшения охватывают визуальное качество, генерацию аудио и динамику движения, но более интересны структурные дополнения: управление первым и последним кадром, мультивходной I2V в формате сетки 3×3, референс субъекта плюс голоса, а также редактирование по инструкциям.

Разница с версией 2.5 — не в базовом разрешении. Это количество якорных входов, которые модель теперь принимает в одном вызове.

Что нового в WAN 2.7

Управление первым и последним кадром

Подход с первым и последним кадром позволяет пользователям задать начало и конец видео с помощью двух изображений, а модель автоматически генерирует промежуточный контент. В более ранних версиях серии Wan это существовало как отдельная модель (см. Wan2.1-FLF2V-14B), но в 2.7 функция встроена непосредственно в модель, а не вынесена в отдельный чекпоинт.

Для production-команд: это важнее всего, когда у вас есть чёткие ключевые кадры — например, снимок продукта в покое и снимок продукта в движении — и вы хотите, чтобы модель интерполировала переход без полного ручного прохода по анимации. Конечные точки детерминированы. Промежуток остаётся стохастическим, но композиционные ограничения заданы.

I2V по сетке из 9 изображений (мультивход 3×3)

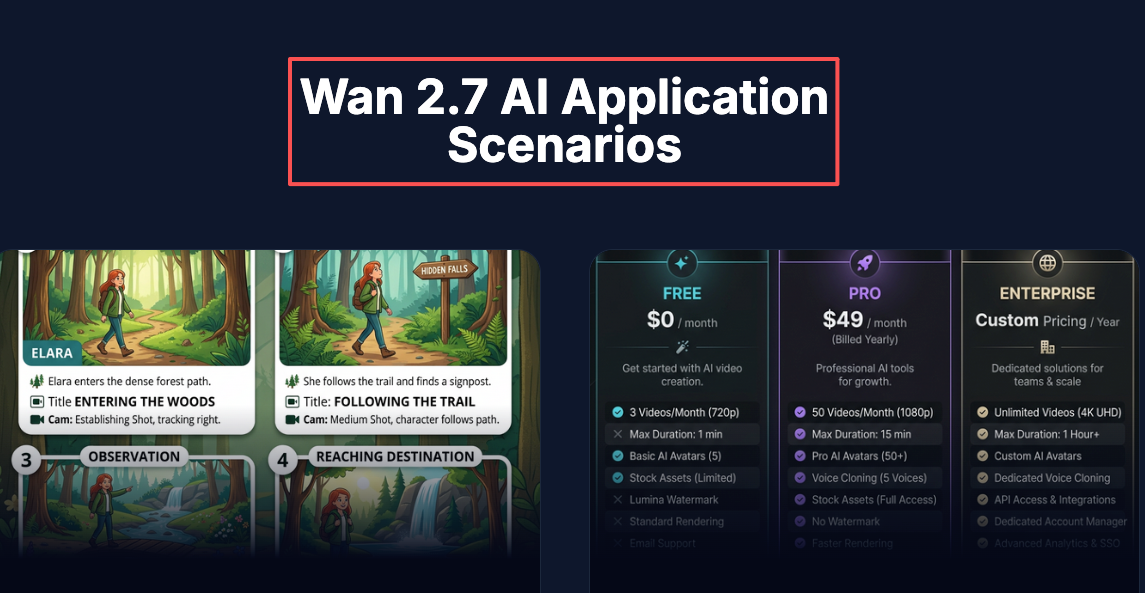

WAN 2.7 поддерживает синтез по сетке 3×3, то есть до девяти референсных изображений можно передать как структурированный вход для одной задачи генерации видео. Это принципиально отличается от однокадрового I2V.

Практическое применение: если вы генерируете контент с согласованным персонажем под разными углами или при разных условиях освещения, теперь можно предоставить референсную сетку …вместо одного якорного кадра. Если вам интересно, как разные инструменты справляются с согласованностью при нескольких референсах, руководство по лучшим инструментам замены лиц в видео с поддержкой нескольких лиц и нескольких входов показывает, где текущие решения всё ещё дают сбой. Это снижает фактор удачи с одного снимка, из-за которого пакетные I2V-задачи дорого обходятся при контроле качества. Уточните точную структуру параметров API на момент запуска — схема эндпоинта для сеточных входов на момент написания этой статьи официально не опубликована.

Референс субъекта + голоса

WAN 2.7 позволяет объединить визуальный референс субъекта с голосовым референсом для генерации видео, в котором внешность и голос персонажа соответствуют вашим входным данным. Это расширение того, что Wan 2.6 представил в своей модели R2V, — она позволяла загружать референсное видео персонажа с внешностью и голосом и использовать текстовые подсказки для генерации новых сцен с тем же персонажем.

В версии 2.7 ожидается более тесная интеграция, а не отдельный эндпоинт модели. Для команд, создающих короткометражный контент с персонажами или пайплайны локализации, …это функция с наиболее очевидной production-окупаемостью — при условии, что обработка голосового референса стабильна при повторяющихся пакетных вызовах. Для контекста: именно здесь пайплайны замены лиц в AI-видео начинают давать сбой при масштабировании, особенно когда требуется согласованность и личности, и голоса.

Редактирование видео по инструкциям

WAN 2.7 поддерживает редактирование существующих видео с помощью инструкций на естественном языке — смена фона, изменение освещения или наряда персонажа: просто опишите изменение, и модель сделает всё сама.

Это значительный сдвиг от генерации к редактированию. Для продуктовых команд, занимающихся циклами постпродакшн-коррекции, это открывает более лёгкую альтернативу ручной ротоскопии и композитингу при небольших правках. Главная неизвестность — как модель справляется с временно́й согласованностью в более длинных клипах, когда правки затрагивают элементы, связанные с движением (например, одежда на движущемся субъекте). Именно здесь аналогичные инструменты исторически деградировали.

Официальная документация Alibaba Cloud Model Studio уже охватывает связанные эндпоинты редактирования в текущей линейке Wan, что даёт базовое представление о паттерне API, который, вероятно, будет использоваться в 2.7.

Воссоздание / репликация видео [требует проверки]

Эта функция — воссоздание или репликация существующих видео с изменением стиля или субъекта при сохранении структуры движения — упоминается в сторонних обзорах WAN 2.7. На момент написания этой статьи она не подтверждена независимо в официальной документации Alibaba. Не стройте зависимостей рабочего процесса на этой возможности, пока официальные примечания к релизу Alibaba не подтвердят её. Пометьте как экспериментальную, если сейчас описываете объём проекта по обновлению.

Что остаётся прежним (архитектурная преемственность с версии 2.6)

Базовая архитектура DiT (Diffusion Transformer) сохраняется. Серия Wan использует компонент Transformer на основе mainstream-архитектуры video DiT с механизмом Full Attention для точного захвата долгосрочных пространственно-временных зависимостей, обеспечивая высокую временну́ю и пространственную согласованность.

Это важно для команд, работающих с локальным inference: профиль памяти GPU и подход к квантизации кардинально не изменятся. Если ваш inference-стек для версии 2.6 оптимизирован (операции FP8, многопроцессорное шардирование), эти инвестиции сохраняются. Не ждите принципиально новой архитектуры развёртывания.

Доступ через API и доступность — что подтверждено, что ещё неизвестно

Официальные каналы доступа (DashScope / Wan.video)

Два подтверждённых официальных канала для предыдущих версий Wan — это платформа DashScope от Alibaba Cloud (управление API-ключами и доступом к моделям) и Wan.video для рабочих процессов, ориентированных на создателей контента. Оба ожидаются с поддержкой версии 2.7 на момент запуска, хотя региональную доступность (особенно для международных аккаунтов в сравнении с аккаунтами материкового Китая) следует уточнить на момент релиза.

API-ключ DashScope загружается из переменной окружения DASHSCOPE_API_KEY, а международные пользователи обращаются к dashscope-intl.aliyuncs.com — почти наверняка тот же паттерн применится к версии 2.7, учитывая устоявшуюся инфраструктуру.

Доступность через сторонние API

На момент написания статьи WAN 2.7 ещё не подтверждён на сторонних API-агрегаторах. Исходя из паттерна начиная с версии 2.2 — где нативная поддержка ComfyUI появилась в день запуска открытых весов модели — ожидайте быстрого появления интеграций от сообщества, если 2.7 выйдет с публичными весами.

Будет ли 2.7 с открытым исходным кодом — само по себе не подтверждено. См. раздел FAQ ниже.

Кому стоит уделить приоритетное внимание WAN 2.7 прямо сейчас

Команды, работающие с референсно-насыщенным видеопроизводством

Если ваш пайплайн уже опирается на согласованность персонажей между кадрами — и вы компенсировали это несколькими проходами генерации или обходными путями через ControlNet, — референс субъекта + голоса и мультикадровый сеточный вход — это два функционала, которые наиболее непосредственно снижают эти накладные расходы. Стоит оценить возможность обновления.

Разработчики, которым нужен мультивходной I2V

Однокадровый I2V работает до тех пор, пока не нужна согласованность. Сеточный вход из 9 изображений значительно расширяет референсную поверхность. Если вы использовали обходные пакетные решения для имитации этого, версия 2.7 может объединить несколько API-вызовов в один.

Творческие команды, которые могут подождать с переходом с WAN 2.5

Если ваши рабочие процессы на версии 2.5 стабильны и новые функции не устраняют активные производственные узкие места, спешить некуда. Модель всё ещё выходит. Дайте сообществу первые две недели на обратную связь, чтобы выявить крайние случаи, прежде чем что-либо перестраивать.

FAQ

- Когда WAN 2.7 будет официально доступен через API? Запуск запланирован в пределах марта 2026 года. Точная дата доступности API по регионам: пока не подтверждена.

- Является ли WAN 2.7 open-source, как WAN 2.2? Не подтверждено. Wan 2.2 вышел под лицензией Apache 2.0, что допускало коммерческое использование и интеграцию с ComfyUI. Использует ли 2.7 ту же лицензию — в предрелизных материалах не указано.

- Поддерживает ли WAN 2.7 ComfyUI? Подтверждённой интеграции пока нет. Учитывая предыдущие релизы — Wan 2.1 и 2.2 оба имели поддержку ComfyUI в день запуска или около него — ожидайте быстрого появления узлов от сообщества, если веса модели будут публичными.

- Какова цена по сравнению с WAN 2.5? Цены не объявлены. Серия моделей Wan традиционно тарифицируется посекундно или за видео через DashScope. Уточняйте цены в Alibaba Cloud Model Studio на момент запуска.

- Могу ли я сегодня получить доступ к WAN 2.7 через сторонних API-провайдеров? Пока нет. Модель ещё не запущена. Следите за официальным GitHub Wan и документацией DashScope для подтверждения релиза, затем проверяйте поддержку платформ.

На что обратить внимание после запуска

Несколько вещей, за которыми стоит следить по мере стабилизации версии 2.7 в первые недели:

— Временна́я согласованность при редактировании по инструкциям: редактирование по инструкциям — функция, которая с наибольшей вероятностью будет вести себя иначе на практике, чем в превью-демонстрациях. Внимательно следите за результатами сообщества.

— Релиз открытых весов: если веса выйдут публично, ожидайте рабочих процессов ComfyUI, интеграции с Diffusers и квантизованных вариантов в течение нескольких дней. Если нет — API DashScope остаётся основным путём доступа, и региональная задержка становится реальной переменной рабочего процесса.

— Статус функции воссоздания видео: для этого нужен официальный источник. Не включайте её ни в какие спецификации, пока Alibaba явно не подтвердит.