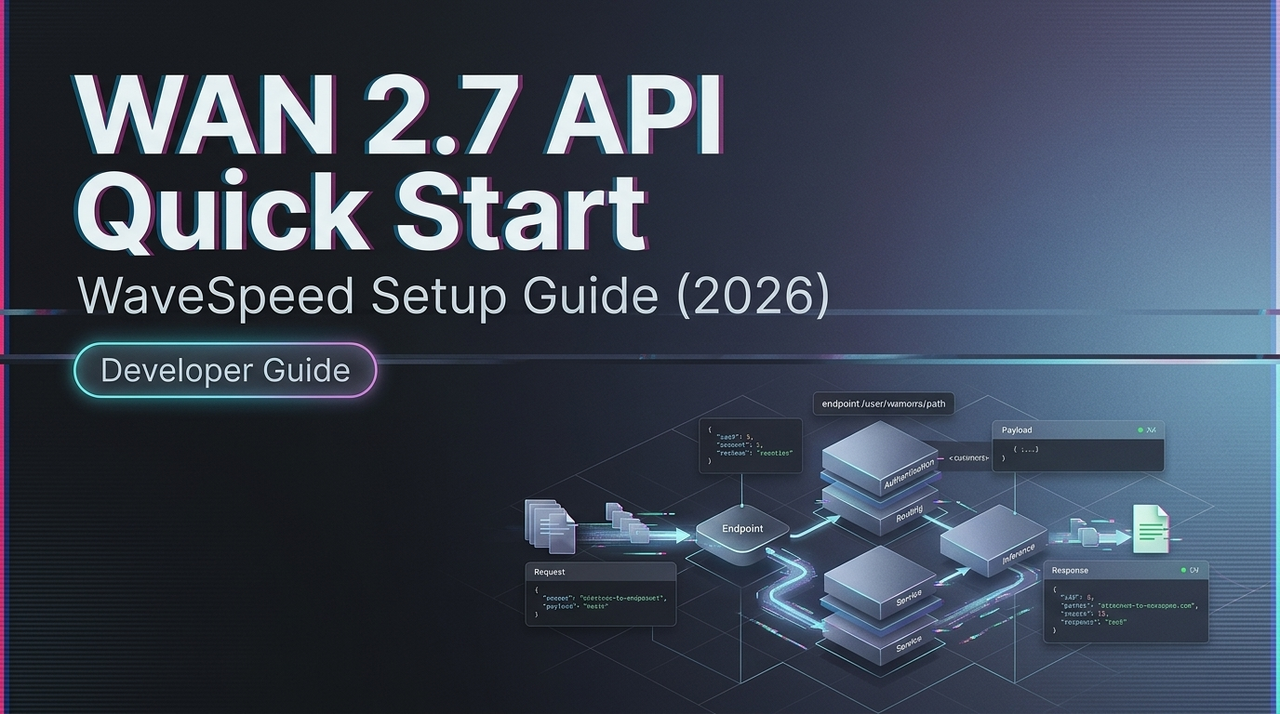

Быстрый старт с WAN 2.7 API на WaveSpeed (2026)

Запустите WAN 2.7 через WaveSpeed API: аутентификация, идентификатор модели, основные параметры, первые запросы для задач T2V, I2V и генерации по первому/последнему кадру.

Привет, ребята. Меня зовут Дора. Я всё откладывала это. WAN 2.7 вышел. У меня был проект, которому это было нужно, и я говорила себе, что подключу его «когда всё устоится». Обычно это неправильный инстинкт. API-поверхность понятна, как только разберёшься с именованием версий — и большинство трудностей возникает из-за одного-двух решений, принятых в самом начале, которые незаметно влияют на всё последующее.

Это не обзор функций. Это то, что мне действительно было нужно в первый день.

WAN 2.7 на платформе: ID модели и доступность

Прежде чем написать хоть строчку кода, я потратила десять минут только на то, чтобы подтвердить строку модели. Звучит очевидно, но у WAN есть паттерн именования, который сбивает людей с толку — wan2.5-i2v, wan2.6-i2v, wan2.7-flf2v — и использование устаревшего ID возвращает чистый 404 без полезного сообщения об ошибке.

Каталог моделей — первое место для проверки. Перейдите в раздел генерации видео, отфильтруйте по версии 2.7 и скопируйте точную строку ID модели. Не вводите её по памяти.

Время доступности тоже имеет значение. WAN 2.7 вышел в марте 2026 года с существенным набором новых возможностей — управление первым/последним кадром, синтез image-to-video по сетке 3×3, до пяти видеоссылок и редактирование на основе инструкций. Согласно обзору генерации видео Alibaba Cloud Model Studio, размещённые конечные точки инференса для новых версий WAN обычно становятся доступны в течение нескольких дней после официального релиза — но не всегда в тот же день, поэтому проверьте страницу статуса платформы, прежде чем строить что-то критичное по срокам.

Аутентификация и настройка API-ключа

Этот шаг быстрый. API-ключ помещается в заголовок Authorization как Bearer-токен. Базовый URL соответствует региону, выбранному при настройке аккаунта — Сингапур, Вирджиния или Пекин для развёртывания в Китае. Межрегиональные запросы завершатся неудачей — не громко, просто с ошибкой аутентификации, которая потратит двадцать минут, если вы этого не ожидаете.

Authorization: Bearer YOUR_API_KEY

Content-Type: application/jsonОдно, что я делаю с самого начала: храню API-ключ в переменной окружения и никогда не хардкожу его, даже в локальных тестовых скриптах. Утечка ключа — это неприятный сюрприз в счёте.

Структура базового URL следует стандартным REST-конвенциям, определённым в IETF RFC 9110 (HTTP Semantics). Если вы работали с любым современным AI API, это покажется знакомым — JSON на входе, JSON на выходе, коды статусов, ведущие себя как ожидается.

Основные параметры запроса

Здесь я бы посоветовала немного замедлиться. Обязательных параметров немного — ID модели, промпт, тип входных данных — но необязательные влияют на качество вывода больше, чем можно ожидать.

Обязательные:

model— точная строка модели, проверенная по каталогуprompt— текстовое описание; для видео конкретность важнее длины- Входные данные: либо

image_url(для I2V), либо только текст для T2V

Необязательные, но практически важные:

resolution— принимает"480P","720P","1080P"; WAN 2.7 поддерживает нативный вывод 1080P до 15 секундduration— от 2 до 15 секунд; более длинные клипы стоят дороже и дольше обрабатываютсяseed— зафиксируйте это, как только найдёте хороший вывод. Это единственный параметр, делающий результаты воспроизводимыми между запускамиnegative_prompt— полезен для подавления мерцания, размытия и артефактов движения

Специфические для WAN 2.7 параметры, которые нужно проверить при официальном выходе документации:

first_frame_url+last_frame_url— для режима FLF2V (первый и последний кадр)image_grid— структура входных данных в виде сетки 9 изображений для более богатой I2V-композицииedit_instruction— редактирование существующего видео на естественном языке

Последние три новые в версии 2.7. Имена параметров могут меняться между предварительным просмотром и общей доступностью. Официальный справочник по API является авторитетным источником — используйте предварительные имена параметров на свой страх и риск.

Паттерны первых запросов

Текст в видео (минимальный)

response = VideoSynthesis.async_call(

model="wan2.7-t2v", # verify exact string at launch

prompt="A slow dolly shot through a foggy pine forest at dawn.",

resolution="720P",

duration=5,

seed=42

)

task_id = response.output.task_idСтандартный image-to-video

response = VideoSynthesis.async_call(

model="wan2.7-i2v",

img_url="https://your-cdn.com/input.jpg",

prompt="Camera holds still. Subject turns slowly toward light.",

resolution="720P",

duration=5

)Первый кадр + последний кадр (FLF2V)

Именно здесь WAN 2.7 делает то, чего предыдущие версии не могли сделать чисто. Вы определяете начальный и конечный кадр; модель заполняет движение между ними. Это не анимация в традиционном смысле — это структурированный инференс из двух семантических конечных точек.

response = VideoSynthesis.async_call(

model="wan2.7-flf2v", # verify exact string at launch

first_frame_url="https://your-cdn.com/start.png",

last_frame_url="https://your-cdn.com/end.png",

prompt="Fixed camera. Smooth transition. Natural lighting.",

resolution="720P",

seed=99

)Качество пары кадров важнее промпта. Хорошо подобранная пара с чётким пространственным соотношением будет стабильно превосходить выверенный промпт на несовпадающих входных кадрах. Я провела достаточно тестов, чтобы говорить это с уверенностью. Для справки о том, как версия с открытыми весами обрабатывает обусловливание кадров, в репозитории модели WAN на Hugging Face подробно описана архитектура — полезно, даже если вы только вызываете размещённый API.

Image-to-video с сеткой 9 изображений

Входные данные в виде сетки 9 изображений позволяют передать расположение 3×3 из неподвижных изображений в качестве композиционных ссылок для одной генерации. Проверьте точную структуру полезной нагрузки при запуске — параметр, вероятно, принимает массив из девяти URL изображений, но относитесь к предрелизной документации как к предварительной.

Обработка асинхронных заданий: отправка → опрос → результат

Генерация видео никогда не является синхронной. Даже для коротких клипов ожидайте 1–5 минут на задание. Паттерн всегда одинаковый: отправить → получить task_id → опросить → получить URL результата.

import time

def poll_for_result(task_id, interval=15, timeout=600):

elapsed = 0

while elapsed < timeout:

result = VideoSynthesis.fetch(task_id)

status = result.output.task_status

if status == "SUCCEEDED":

return result.output.video_url

if status == "FAILED":

raise Exception(f"Task failed: {result}")

time.sleep(interval)

elapsed += interval

raise TimeoutError("Job exceeded timeout")Интервал опроса: 15 секунд — это задокументированная рекомендация из собственного справочника API Alibaba для конечной точки image-to-video Wan. Не опрашивайте чаще — это не ускорит процесс и израсходует лимиты скорости.

Переходы статуса задания: PENDING → RUNNING → SUCCEEDED или FAILED. URL результата действителен в течение 24 часов после генерации. Скачайте и сохраните его немедленно — если пропустить это окно, ID задания также истекает через 24 часа и возвращает UNKNOWN при последующих запросах. Я узнала это неудобным способом при первом пакетном запуске.

Обработка ошибок

Ошибки, с которыми вы столкнётесь чаще всего:

| Ошибка | Вероятная причина | Решение |

|---|---|---|

| 404 для модели | Неверный или устаревший ID модели | Проверьте точную строку из каталога |

| 400 для входных данных | Формат изображения отклонён или URL недоступен | Используйте публичные HTTPS URL; проверьте формат |

| 429 Too Many Requests | Достигнут лимит скорости | Экспоненциальная задержка с джиттером |

| Статус задания UNKNOWN | ID задания истёк (окно 24ч) | Опрашивайте раньше; скачивайте результат немедленно |

Для ошибок 429: сделайте паузу, добавьте джиттер, не повторяйте в плотных циклах. Документация MDN HTTP о поведении заголовка Retry-After объясняет стандартный паттерн — заголовки ответа часто точно говорят, когда повторить попытку.

Лимиты скорости для видеозаданий WAN 2.7 публикуются отдельно от лимитов генерации изображений. Задания с высоким разрешением или большей длительностью обычно учитываются в лимите параллельных заданий, а не только в лимите запросов в минуту. Проверьте документацию для вашего уровня аккаунта.

Оценка стоимости

Цены на WAN 2.7 не были окончательными на момент написания. Из того, что стабильно во всём семействе моделей WAN, затраты масштабируются по трём параметрам:

- Разрешение — 1080P стоит значительно дороже, чем 720P за секунду вывода

- Длительность — оплачивается за секунду сгенерированного видео

- Сложность входных данных — входные данные с несколькими ссылками могут иметь множитель; уточните при запуске

Примерная формула оценки:

estimated cost = duration (seconds) × resolution multiplier × unit price per secondПеред запуском пакета протестируйте один клип с каждой комбинацией разрешения и длительности, которую планируете использовать. В обзоре биллинга Alibaba Cloud для Model Studio будут указаны поединичные затраты, когда будут опубликованы официальные тарифы WAN 2.7. Затраты на генерацию видео накапливаются быстрее, чем на генерацию изображений — разрешение является главным рычагом.

Часто задаваемые вопросы

Доступен ли WAN 2.7 в тот же день, что и официальный запуск Alibaba?

Не всегда. Размещённые конечные точки API обычно становятся доступны в течение нескольких дней после выпуска открытых весов, иногда в тот же день, иногда неделю спустя. Следите непосредственно за журналом изменений платформы. Репозиторий GitHub модели WAN исторически был местом, где команда Alibaba впервые документирует изменения схемы для новых выпусков с открытыми весами.

Совместимы ли API-вызовы WAN 2.5 с WAN 2.7?

Стандартные полезные нагрузки T2V и I2V с одним изображением должны быть структурно совместимы — новые функции версии 2.7 выглядят аддитивными, а не ломающими обратную совместимость. Тем не менее, вам нужно будет обновить строку ID модели, и любой код, использующий параметры, специфичные для версии 2.5, следует протестировать, прежде чем считать его полной заменой. Режимы 9-сетки и FLF2V требуют совершенно новых структур полезной нагрузки.

Каков лимит скорости для видеозаданий WAN 2.7?

Проверьте для вашего уровня аккаунта во время выполнения. В качестве рабочего значения по умолчанию: ставьте задания в очередь равномерным потоком, а не пакетами. Обрабатывайте 429 с экспоненциальной задержкой. Логируйте request_id из каждого ответа — это наиболее полезное поле, когда что-то идёт не так и нужно отследить проблему.

Механика здесь несложная. То, что на самом деле требует времени — это создание хороших входных ресурсов: пар кадров, референсных изображений, промптов, которые остаются конкретными, не становясь жёсткими. Как только они стабилизируются, работа с API становится рутинной.

Обновлю это, как только официальная документация по параметрам WAN 2.7 выйдет и у меня будет возможность протестировать формат сетки 9 изображений от начала до конца. Это та часть, которая мне наиболее интересна.

Предыдущие публикации:

- Узнайте, как работает редактирование видео с помощью инструкций на естественном языке в WAN 2.7

- Посмотрите ключевые различия между WAN 2.7 и WAN 2.6, особенно для лёгких правок на основе инструкций

- Изучите практические способы сочетания редактирования на основе инструкций с управлением первым/последним кадром

- Исследуйте новые функции WAN 2.7, включая редактирование видео на основе инструкций и путь обновления API

- Поймите реальные производственные сценарии использования и преимущества итерации при инструкционном редактировании в WAN 2.7