OmniHuman-1.5:Toward Virtual Humans with “Soul”

Have you ever watched videos featuring smoothly animated digital humans, but felt they lacked genuine emotion? To overcome this limitation, we introduce OmniHuman-1.5, developed by ByteDance—a groundbreaking framework designed to generate character animations that transcend superficial mimicry. It not only brings virtual avatars to life but also endows them with the ability to express emotions.

Вы когда-нибудь смотрели видео с плавно анимированными цифровыми людьми, но чувствовали, что им не хватает подлинной эмоции? Чтобы преодолеть это ограничение, мы представляем OmniHuman-1.5, разработанный ByteDance — революционную платформу, предназначенную для создания анимации персонажей, которая выходит за пределы поверхностной имитации. Она не только оживляет виртуальные аватары, но и наделяет их способностью выражать эмоции.

От имитации к выражению: технический прорыв

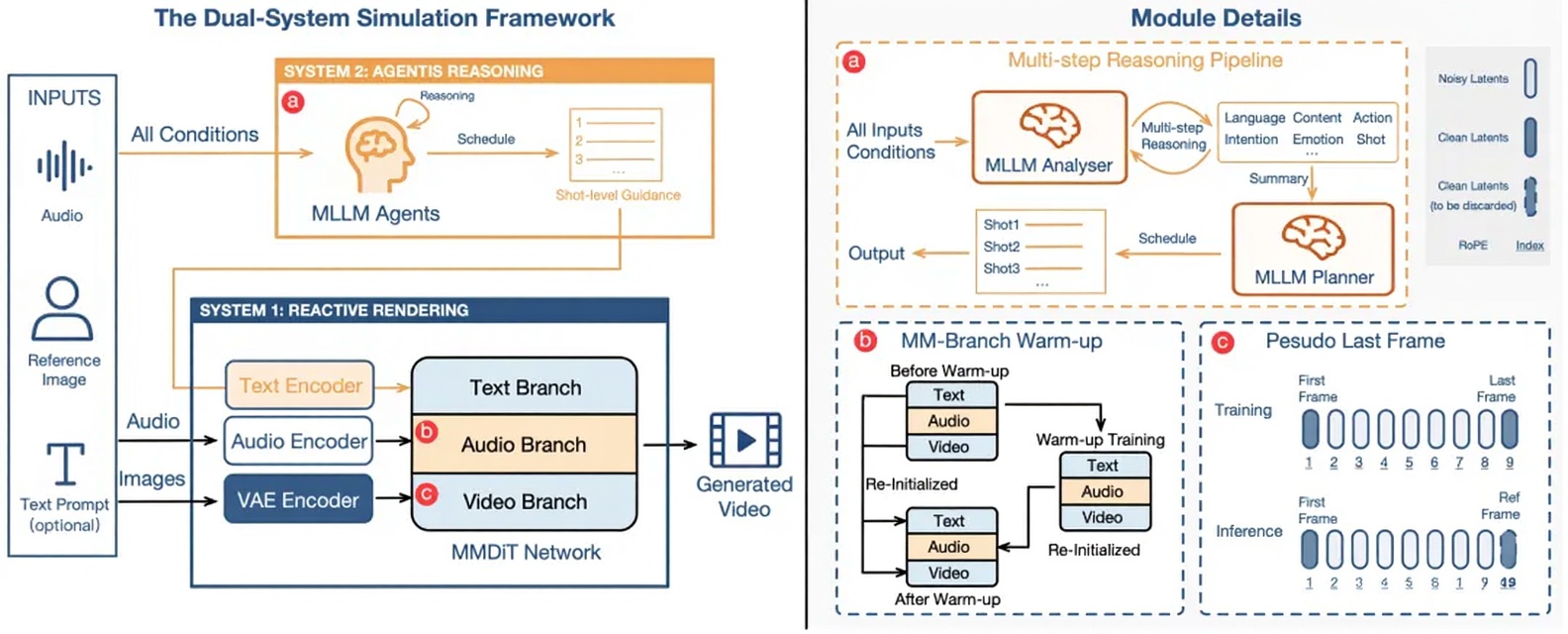

OmniHuman-1.5 использует двухсистемную структуру моделирования.

Во-первых, этот метод использует многомодальные большие языковые модели для создания структурированных семантических представлений, обеспечивающих продвинутое семантическое руководство, которое позволяет генерации движений выходить за пределы простой синхронизации ритма и лучше соответствовать контексту и эмоциям.

Во-вторых, благодаря специально разработанной многомодальной архитектуре DiT и механизму псевдо-конечного кадра, она эффективно объединяет многомодальную информацию, снижая конфликты и генерируя действия, которые глубоко согласованы с персонажами, сценами и языком.

Что может делать OmniHuman-1.5?

🎶Музыкальные представления

Используя просто фотографию и песню, OmniHuman-1.5 может создать «цифрового певца», который точно воспроизводит паузы, дыхание и ритм артиста.

🎭Эмоциональная игра

OmniHuman-1.5 может не только создавать цифровых певцов, но и производить эмоциональных цифровых актёров.

🗣️Жесты с учётом контекста

Вместо повторяющихся жестов анимация соответствует смыслу. Например, когда аудио упоминает «сердце», персонаж естественным образом кладёт руку на грудь.

✍️Анимация по текстовым подсказкам

OmniHuman-1.5 поддерживает управление через подсказки. Примеры включают:

- движения камеры: «Камера медленно обходит персонажа для создания артхаусного настроения».

- создание объектов: «Аватар тянется к объективу, затем начинает говорить».

- конкретные действия: «Пингвин танцует, носит солнцезащитные очки и выступает на сцене».

👥Несколько персонажей и стилизованные сценарии

В отличие от предыдущих цифровых людей, OmniHuman-1.5 может участвовать в групповых беседах и выполнять ансамблевые номера.

Она также работает с людьми, животными, антропоморфными персонажами и стилизованными мультфильмами, демонстрируя замечательную универсальность.

Заключение: к виртуальным людям с «душой»

Технология виртуальных людей достигла нового прорыва. Появление OmniHuman-1.5 означает новую эру, в которой виртуальные люди эволюционировали от поверхностной имитации к глубокому выражению. Она может понять, что вы говорите, и вступить в подлинное, искреннее общение с вами. С нетерпением ждём запуска модели OmniHuman-1.5!

Зарегистрируйтесь сейчас на WaveSpeedAI. Кроме того, вы можете связаться с нами в социальных сетях ниже.

Discord: Discord