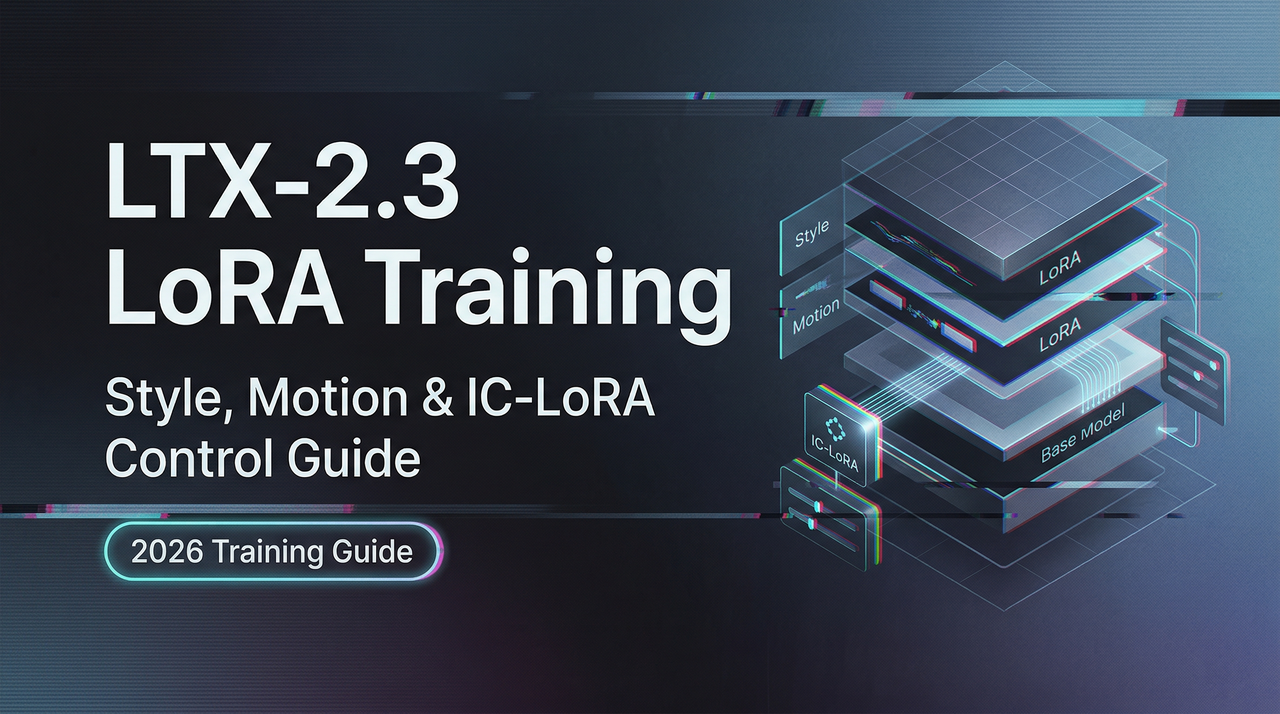

Руководство по обучению LoRA для LTX-2.3: Стиль, движение и управление IC-LoRA (2026)

Обучайте пользовательские LoRA на LTX-2.3 с помощью официального ltx-trainer. Охватывает стилевые LoRA, структурное управление IC-LoRA, настройки ранга, подготовку датасета и распространённые ошибки обучения.

Привет, друг. Это Дора.

Я не планировала тратить неделю на обучение LoRA. Мне просто нужно было, чтобы демо продукта следовало определённому паттерну движения, а текстовые промпты с этим не справлялись. Это небольшое препятствие привело меня на путь обучения LTX-2.3, и то, что я обнаружила, удивило меня — не потому что это революционно, а потому что это тихо и практично, если знать, какие настройки на самом деле важны.

Это не исчерпывающий справочник. Это то, что я узнала, тестируя рабочие процессы style, motion и IC-LoRA в марте 2026 года.

Что включает официальный тренер LTX-2.3

Репозиторий LTX-2 на GitHub организован как монорепозиторий с тремя пакетами: ltx-core для реализации модели, ltx-pipelines для рабочих процессов генерации и ltx-trainer для тонкой настройки LoRA и IC-LoRA. Ширина и высота должны делиться на 32, а количество кадров должно следовать правилу 8n+1 — то есть 1, 9, 17, 25 кадров и так далее.

Я проигнорировала это в своём первом обучающем запуске. Тренер выдал ошибку, я вручную дополнила кадры — и всё заработало. Небольшое ограничение, но лучше знать о нём заранее.

Три типа LoRA и когда использовать каждый

Style LoRA (внешний вид, текстура, цвет)

Style LoRA обучают LTX-2.3 визуальной эстетике — цветокоррекции, работе с текстурами, настроению освещения. Я обучила одну на предметной фотографии с постоянным белым фоном и мягкими тенями. Для LoRA персонажей или стилей обычно достаточно 20–50 изображений для получения хороших результатов, хотя для очень специфических субъектов я доходила до 80–120 изображений.

Датасеты только из изображений здесь отлично подходят. Для своих первых LoRA я использовала статичные кадры, а не видеоклипы — их проще курировать, и модель усваивает идентичность без необходимости обрабатывать движение.

Motion / Effect LoRA (движение, трансформация)

Motion LoRA фокусируются на том, как вещи движутся, а не на том, как они выглядят. Панорамирование камеры, вращение объектов, последовательности трансформаций. Для них нужны короткие связные видеоклипы, а не статичные изображения. Я тестировала motion LoRA с движением камеры типа dolly-in на клипах по 15 секунд с последовательным кадрированием, и модель уловила паттерн движения на разных объектах.

Обучение движению ощущалось менее стабильным, чем обучение стилю. Больше повторных попыток, более непостоянные результаты.

IC-LoRA (структурный контроль: глубина, поза, граница Canny)

IC-LoRA — это другое. Вместо того чтобы обучать модель новой эстетике или движению, она обусловливает генерацию по опорным сигналам — картам глубины, скелетам поз, детекции границ. IC-LoRA позволяет обусловить генерацию видео на опорных видеокадрах во время инференса, обеспечивая точный контроль видео-к-видео поверх базовой модели text-to-video.

Я использовала depth IC-LoRA, чтобы зафиксировать движение камеры, полностью меняя при этом визуальное содержимое. Официальное руководство по IC-LoRA хорошо объясняет три режима управления: Canny для сохранения границ, Depth для камеры и пространственной геометрии, Pose для переноса движений человека.

Правила подготовки датасета

Ограничение на количество кадров (правило 8n+1)

Количество кадров должно быть кратно 8 плюс 1. Это не мягкое руководство — если в ваших клипах 10 или 15 кадров, тренер либо выдаст ошибку, либо дополнит их внутренне. Я пакетно обработала свой датасет до 17 кадров (2 × 8 + 1) перед загрузкой, и обучение прошло без проблем.

Делимость разрешения (правило 32 пикселей)

Ширина и высота должны делиться на 32. Я узнала об этом после того, как изменила размер пакета до 1024×576 и увидела, как тренер тихо дополнил его до 1024×608. Лучше сразу правильно изменить размер.

Видео vs изображения: когда что использовать

Датасеты только из изображений допустимы для обучения LoRA на LTX-2.3. Это намного проще, чем слишком рано форсировать обучение движению, особенно для LoRA идентичности или стиля. Я начинала каждый проект со статичных кадров, проверяла внешний вид, а затем добавляла короткие видеоклипы, если движение было важно.

Для работы с преобладающим движением короткие связные клипы по-прежнему лучше, чем длинные многосценовые сегменты.

Базовые настройки обучения

Rank 32 как правильное значение по умолчанию и когда увеличивать

Для LTX-2.3 rank 32 — это правильное значение по умолчанию. Обычно оно даёт достаточную ёмкость, не делая LoRA слишком жёсткой слишком рано. Я тестировала rank 64 на сложной style LoRA и увидела минимальное улучшение — дополнительная ёмкость не помогла, потому что мой датасет был недостаточно большим и разнообразным, чтобы её заполнить.

Начальная точка learning rate и когда её менять

Для обучения LoRA на LTX-2.3 правильное место для начала — 1e-4. Это один из тех случаев, когда скучный ответ является правильным ответом. Я не трогала learning rate в своих первых четырёх LoRA, и все они сошлись чисто.

Количество шагов: как понять, когда остановиться раньше

Многие пользователи теряют время, сразу переходя к большому количеству шагов, не проверив, достаточно ли уже выглядит контрольная точка 250, 500 или 750. Я делаю выборку на контрольной точке 500, и если LoRA уже выглядит хорошо, останавливаюсь там. Если LoRA уже выглядит сильной на контрольной точке 750 или 1000, дальнейшее продвижение может просто сделать её более хрупкой.

Переобучение проявляется в том, что модель запоминает обучающие данные, а не обобщает их. Валидационные сэмплы начинают выглядеть идентично обучающим кадрам.

IC-LoRA: контроль глубины, позы и границ

Чем IC-LoRA отличается от стандартной style LoRA

IC-LoRA разделяет движение и визуальный стиль. Вы управляете внешним видом с помощью текста и style LoRA, а движением — с помощью структурированных ориентиров. Модель управления IC-LoRA Union для LTX-2.3 поддерживает несколько сигналов управления — глубину, позу, границы — в одном адаптере.

Я запускала depth IC-LoRA на последовательности поворотного стола с продуктом. Траектория камеры оставалась зафиксированной по опорной карте глубины, но визуальное содержимое полностью менялось в зависимости от моего промпта.

Интеграция рабочего процесса IC-LoRA в ComfyUI

Рабочий процесс RunComfy LTX 2.3 IC-LoRA автоматически обрабатывает извлечение глубины, позы и границ. Загрузите опорный клип, выберите режим управления, напишите промпт, сфокусированный на стиле, — и модель будет обрабатывать движение отдельно.

Одна деталь, которую я поначалу упустила: держите промпты сфокусированными на внешнем виде, потому что IC-LoRA управляет движением и структурой. Попытка описать движение камеры в промпте, пока IC-LoRA им управляет, создаёт конфликт.

Распространённые ошибки обучения и способы их исправления

LoRA проникает везде (решение с DOP)

DOP (Dropout of Prompts) — это первая продвинутая опция, к которой стоит обратиться, когда LoRA начинает проникать везде. Я обучила style LoRA для продукта, которая хорошо работала на похожих предметах, но начала влиять на несвязанные объекты. Добавление dropout для подписей помогло LoRA обобщиться.

Переобучение при большом количестве шагов

Не воспринимайте большее количество шагов как универсальное повышение качества. Я прогнала motion LoRA до 2 000 шагов и увидела, как она начала воспроизводить точные обучающие кадры, а не учиться лежащему в основе паттерну. Откатилась к контрольной точке 750.

Конфликт между Caption Dropout и Cache Text Embeddings

Если используется caption dropout, Cache Text Embeddings должен оставаться ВЫКЛЮЧЕННЫМ. Это одна из немногих небольших настроек, которая при неправильном использовании может тихо ухудшить поведение обучения. Я однажды включила оба параметра и получила непоследовательные результаты — модель не могла решить, полагаться ли на кэшированные эмбеддинги или обрабатывать отсутствующие подписи.

Проверка LoRA перед развёртыванием

Я запускаю три теста валидации, прежде чем считать LoRA готовой: один и тот же промпт с LoRA и без неё, чтобы убедиться, что она добавляет то, что я ожидаю; разнообразные промпты для проверки обобщения; и граничные случаи, которых не было в обучающем наборе. Если LoRA работает только с промптами, которые близко совпадают с обучающими подписями, она переобучена.

Часто задаваемые вопросы

Можно ли обучать LoRA на A100 или GPU с меньшим объёмом VRAM?

Обучение LTX-2.3 официально ориентировано на GPU Nvidia H100 с 80 ГБ+ VRAM, хотя конфигурации с меньшим объёмом VRAM могут работать с gradient checkpointing и уменьшенными разрешениями. Я сама не тестировала обучение на A100, но официальная документация тренера указывает на это как на рекомендуемую базовую конфигурацию оборудования.

Сколько времени занимает обучение style LoRA на H100?

Около 3–5 часов на LoRA на одном GPU 4090 для датасетов среднего размера, включая валидацию и небольшие перезапуски, согласно полевым отчётам. H100 должен быть быстрее, хотя точных цифр у меня нет.

Работают ли LoRA от LTX-2 на LTX-2.3 без переобучения?

Нет. LTX-2.3 поставляется с полностью переработанным VAE, обученным на данных более высокого качества, и архитектура текстового коннектора изменилась. Старые LoRA от LTX-2 не переносятся чисто — я проверяла это и получала визуальные артефакты.

Можно ли комбинировать IC-LoRA со style LoRA?

Да. Можно одновременно стекировать до трёх адаптеров LoRA, смешивая кастомную эстетику со структурным управлением. Я запускала style LoRA перед загрузчиком IC-LoRA и держала её вес умеренным, чтобы IC-LoRA могла поддерживать геометрию и тайминг.

Доступно ли обучение LoRA через облачные платформы?

Да. RunComfy AI Toolkit и fal.ai предлагают обучение через браузер без управления GPU-инфраструктурой. Загрузите датасет, настройте параметры, скачайте LoRA по завершении.

Обучение LoRA для LTX-2.3 — это не магия. Это подготовка датасета, базовые настройки и умение вовремя остановиться. Правило 8n+1 для кадров и ограничение на делимость на 32 пикселя поначалу кажутся произвольными, но это просто геометрические требования модели. Работайте с ними, а не против них.

Меня удивила не сложность — а то, сколько времени я сэкономила, придерживаясь rank 32 и learning rate 1e-4 вместо того, чтобы подстраивать каждый параметр с первого запуска.

Предыдущие публикации: