Настройка LTX-2.3 в ComfyUI: двухэтапный пайплайн, исправление VRAM и кодировщик Gemma

Установка LTX-2.3 в ComfyUI: размещение чекпоинта, настройка кодировщика Gemma 3 12B, двухэтапный пайплайн генерации и стратегии работы с ограниченным VRAM для потребительских GPU.

Привет, ребята. Я Дора. Знаете, я не планировала переходить. Моя настройка LTX-2 в ComfyUI работала нормально, и я не сторонник смены «просто потому что новое». Но на прошлой неделе (март 2026 года) я всё чаще натыкалась на небольшие заметки про LTX-2.3: лучшая согласованность, новый текстовый энкодер (Gemma 3 12B) и двухэтапный путь, обещавший более чёткие изображения без уничтожения VRAM.

Я выбрала тихое утро и перенесла свой рабочий процесс. Вот что реально изменилось для меня, где я столкнулась с трудностями и что сделало работу немного легче. Если вы ищете шаги по установке: они здесь есть, но полезная часть — это компромиссы, которые я замечала, пока день за днём выстраивала рабочий процесс LTX-2.3 в ComfyUI.

Чем LTX-2.3 в ComfyUI отличается от настройки LTX-2

LTX-2.3 ComfyUI ощущается скорее как шаг к надёжности, чем как прыжок вперёд. Модель ожидает Gemma 3 12B в качестве текстового энкодера, а рекомендуемый путь — двухэтапный пайплайн: генерация в половинном разрешении для базовой согласованности, затем увеличение латентов с помощью LTX-специфичного апсэмплера. На практике это изменило для меня две вещи:

- Промпты лучше держались при умеренном количестве шагов. Я заметила меньше «размытых» деталей, когда оставалась в диапазоне 25–35 шагов на Этапе 1.

- VRAM расходовалась менее скачкообразно, чем я опасалась, при условии соблюдения границ этапов и отказа от попыток пробиться через полное разрешение за один раз.

Я также заметила, что старые ноды LTX-2 в основном работали, но LTX-2.3 предпочитает собственные ноды сэмплера/латентного апсэмплера. Простой замены чекпоинта оказалось недостаточно. Именно здесь я споткнулась в первый раз.

Необходимые файлы и структура папок

Вот настройка, к которой я пришла после нескольких неудачных попыток. Ничего сложного: это минимум, который позволил избавиться от красных ошибок.

Варианты чекпоинтов (dev / fp8 / distilled + distilled LoRA)

- dev: Хорош для экспериментов. Чуть тяжелее, но я нашла его более снисходительным, когда промпты «гуляли».

- fp8: Легче для VRAM. На моей карте с 12 ГБ fp8 позволял держать размер батча 1 без OOM во время декодирования. Небольшое снижение качества, не критичное для социальных сетей или маркетинговых материалов.

- distilled + distilled LoRA: Самые чистые результаты для продуктовых снимков в моих тестах, но нужно не забыть загрузить LoRA и задать вес (мне подошло 0,6–0,8). Без активной LoRA результаты были ближе к dev.

Все чекпоинты хранились в ComfyUI/models/checkpoints. LoRA я держала в ComfyUI/models/loras и называла их тем же именем, что и базовый чекпоинт, чтобы быстро найти пару.

Текстовый энкодер Gemma 3 12B: загрузка и размещение

LTX-2.3 ожидает текстовый энкодер Gemma 3 12B. В зависимости от вашего стека нод вы будете использовать либо веса PyTorch, либо файл GGUF (для нод на основе llama.cpp). Я пробовала оба варианта.

- Путь через PyTorch: размещается в ComfyUI/models/clip (некоторые ноды автоматически определяют эту папку). Если ваша нода запрашивает другую папку, следуйте её документации, не сопротивляйтесь.

- Путь через GGUF: размещается в ComfyUI/models/llm (или в папке text_encoders, специфичной для ноды). Q4_K_M стал для меня оптимальным вариантом: Q3 экономил больше памяти, но терял часть нюансов на длинных промптах.

Если сомневаетесь, откройте справку «?» ноды или её README. Название папки имеет значение.

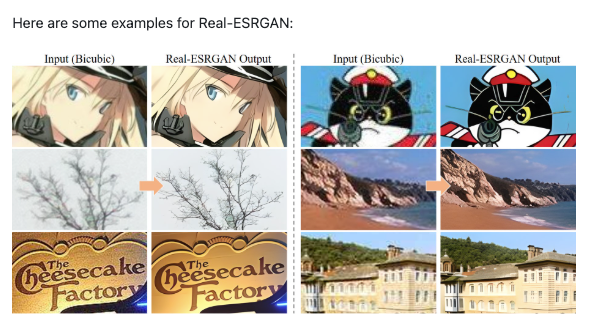

Модели апскейлера: когда их включать

Вам не нужен внешний апскейлер изображений, если вы используете латентный апсэмплер LTX. Тем не менее я держала 4x ESRGAN и латентный апскейлер SDXL x2 в ComfyUI/models/upscale_models для изображений, не связанных с LTX. Для LTX-2.3 встроенный LTXVLatentUpsampler справлялся лучше ESRGAN при работе с краями и текстоподобными фигурами.

Объяснение двухэтапного пайплайна

Я постоянно пыталась пропустить Этап 1. Это было ошибкой. Двухэтапный путь оказался проще для понимания и бережнее к VRAM.

Этап 1: базовая согласованность в половинном разрешении

Я генерирую в половине целевого размера (например, 640×384 для финального 1280×768). Этот этап задаёт композицию и детали объекта. 25–35 шагов, умеренный CFG (4–6), размер батча 1. Если что-то не так — руки, компоновка, цветовой сдвиг — исправить это здесь дешевле.

Что я заметила: меньше «дрейфов», когда я упрощала промпты и использовала максимум один-два стилевых якоря. LTX-2.3, похоже, вознаграждает сфокусированный язык.

Этап 2: латентное увеличение для чёткости (LTXVLatentUpsampler)

Затем я передаю латенты Этапа 1 в LTXVLatentUpsampler. Это делает края чёткими и восстанавливает мелкие детали без изменения композиции. Обычно я запускаю 15–20 шагов для апсэмплинга. Это не волшебный ластик: если основа неверна, апсэмплер просто сделает её чётко неверной.

Dev + Distilled LoRA против полного Distilled: что выбрать

- Dev + Distilled LoRA: мой вариант по умолчанию, когда я исследую образ. Немного гибче. Я задаю силу LoRA около 0,7 и корректирую, если текстуры кажутся переобученными.

- Полный Distilled: когда нужны быстрые, стабильные результаты для батча. Требовательнее к промптам, но экономит умственные усилия — меньше сюрпризов от запуска к запуску.

Если чувствуете, что зашли в тупик, попробуйте dev для Этапа 1 (свободнее) и distilled для Этапа 2 (жёстче). Эта комбинация спасла мне один проект с портретами в тёмных тонах.

Настройка энкодера Gemma 3 12B: управление VRAM

Gemma 3 12B — главная причина, по которой я ожидала проблем. Всё оказалось не так плохо, просто нужны ограничители.

Выгрузка энкодера на CPU/RAM при нехватке VRAM

На карте с 12 ГБ я выгружала энкодер Gemma на CPU для текстового прохода. Это добавляло несколько секунд на каждый запуск, но останавливало OOM во время Этапа 1. Если ваша нода поддерживает загрузку на смешанных устройствах, поместите слои внимания на GPU, а остальное на CPU. Ощущение: не быстрее, но спокойнее — никаких жёстких крашей в середине работы.

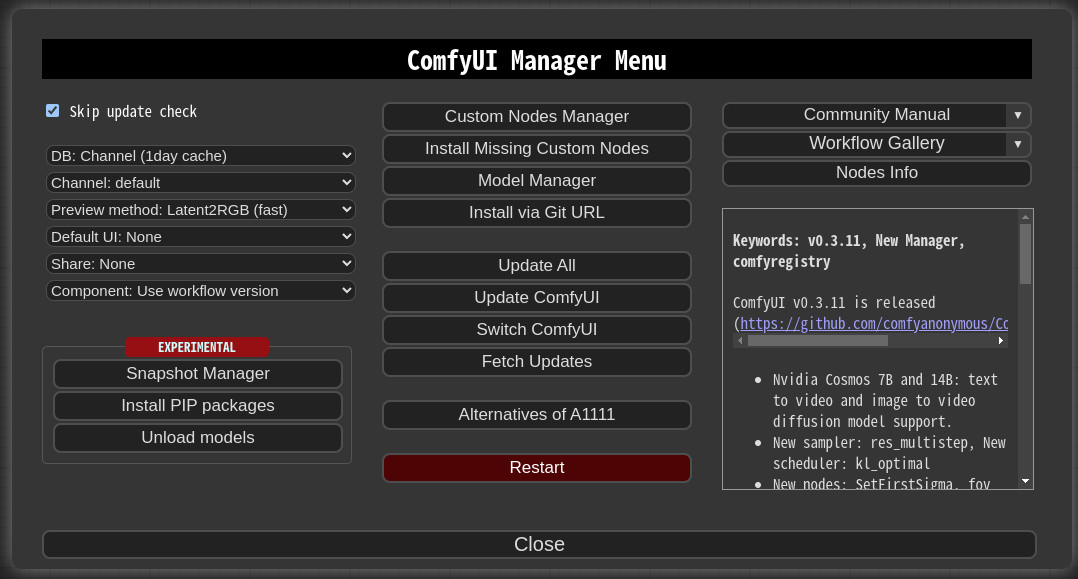

Флаг —novram и другие исправления при запуске

Если вы запускаете ComfyUI с флагами командной строки, —novram помог сгладить пики памяти при переключении моделей. Я также:

- Отключила «keep loaded» для больших моделей между тестовыми запусками.

- Задала torch.set_grad_enabled(False) в небольшом пользовательском init (если ваша настройка позволяет), чтобы избежать бесполезных градиентов.

- Использовала меньшие запасные сети: чекпоинты 16-bit или fp8, когда знала, что буду стекировать LoRA.

Стратегии для низкого VRAM на потребительских GPU (12 ГБ / 16 ГБ / 24 ГБ)

Что сработало на трёх машинах, которые я тестировала (RTX 3060 12 ГБ, 4070 12 ГБ и 4090 24 ГБ):

Квантизованные модели GGUF: компромиссы Q3 и Q4

- Q3: Минимальная память, быстрее всего загружается, но я теряла нюансы промпта и видела больше повторений в дескрипторах.

- Q4: Чуть тяжелее, но заметно лучшая согласованность. Мой выбор для карт 12–16 ГБ. Для 24 ГБ я пропускаю квантизацию или использую Q5, если доступно.

Выгрузка VAE для снижения пиков памяти

Декодирование — это место, где я чаще всего сталкивалась с OOM. Выгрузка VAE на CPU или использование более лёгкого VAE снижало пики в конце Этапа 2. На 12 ГБ я также задавала финальное декодирование для одного изображения (без батчинга), даже если предыдущие ноды работали пакетно, — меньше Drama.

Другие небольшие улучшения:

- Держите разрешение скромным на Этапе 1: увеличивайте позже.

- Избегайте стекирования нескольких трюков с управлением. Один CFG, одна LoRA за раз.

Распространённые ошибки при первом запуске и их исправление

Я встретила обычные красные блоки. Вот исправления, которые помогли.

Ошибки отсутствующих нод после загрузки

Если ComfyUI не может найти ноды LTX-2.3, обновите свой репозиторий custom-nodes и перезапустите. Некоторые ноды LTX также требуют более новое ядро ComfyUI. Одну упорную ошибку я исправила, удалив папку кэша ноды и позволив ей пересобраться при запуске.

OOM во время декодирования

Два рычага помогли мгновенно: переключите чекпоинт на fp8 или выгрузите VAE на CPU. Также уменьшите батч последнего этапа до 1. Если краши продолжаются, уменьшите целевое разрешение вдвое и позвольте внешнему апскейлеру изображений завершить работу.

Краш энкодера Gemma

Это обычно означало несовпадение папки или файл квантизации, который нода не приняла. Я повторно загрузила Gemma 3 12B с источника, указанного в README ноды, проверила контрольную сумму и разместила там, где нода ожидает (clip против llm). Q4 работал: Q3 иногда не загружался на моём 4070, пока я не обновилась до актуальной сборки на основе llama.cpp.

Часто задаваемые вопросы

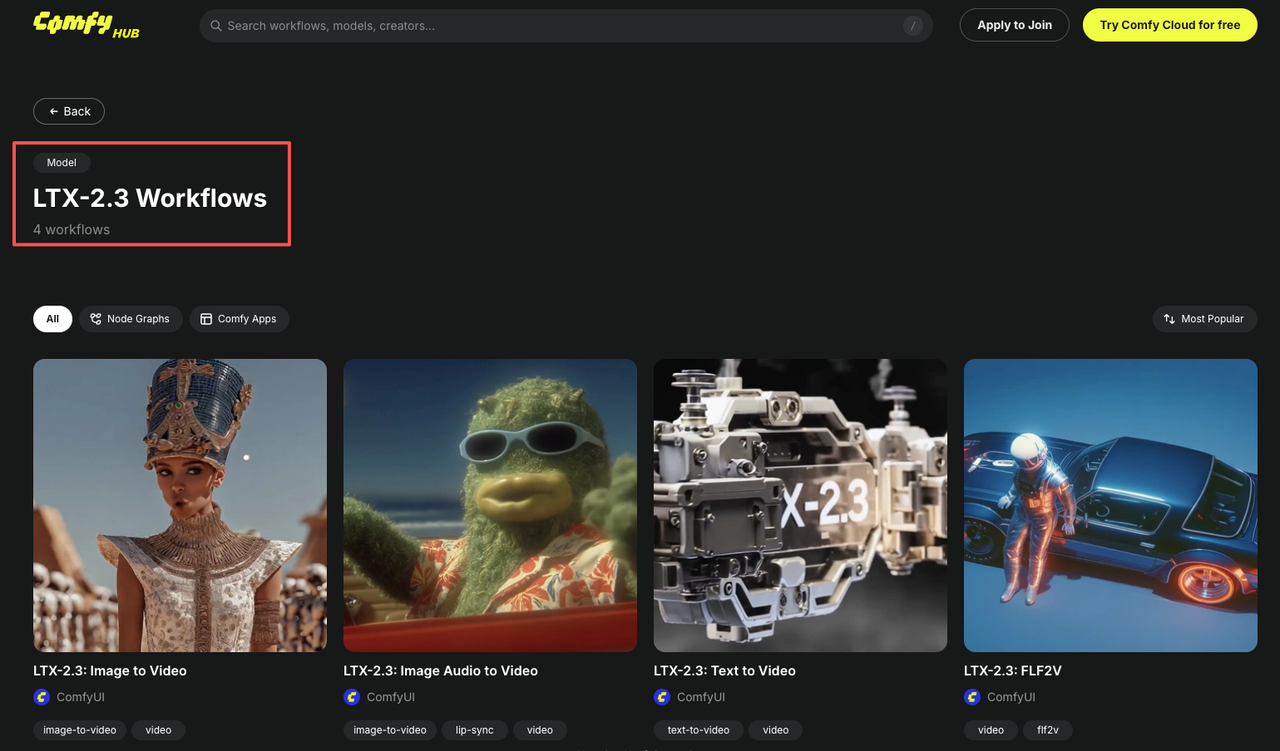

Нужно ли устанавливать ноды LTX-2.3 для ComfyUI отдельно?

Обычно да. Обновления одной только модели недостаточно. Подтяните последний репозиторий нод LTX и перезапустите ComfyUI, чтобы он зарегистрировал новые сэмплеры и латентный апсэмплер.

Можно ли использовать существующие рабочие процессы LTX-2 с чекпоинтами LTX-2.3?

Частично. Мне удалось повторно использовать компоновку, но пришлось заменить сэмплер на LTX-2.3 и LTXVLatentUpsampler, а также направить промпты на Gemma 3 12B. После этого большинство элементов управления вели себя нормально.

Какой минимальный VRAM нужен для запуска LTX-2.3 в ComfyUI?

Мне удавалось получать работоспособные одиночные изображения на 12 ГБ с fp8 или GGUF Q4 для энкодера, Этапом 1 в половинном разрешении и выгруженным VAE. На 16 ГБ всё работает плавнее. На 24 ГБ можно оставаться в PyTorch и двигаться быстрее.

Двухэтапный пайплайн быстрее или медленнее однэтапного?

По общему времени может быть примерно одинаково, но ощущается легче. Я трачу меньше времени на повторные попытки в полном разрешении. Этап 1 прорабатывает идею, Этап 2 её полирует. На карте с 12 ГБ это также разница между созданием и крашем.

Я не стала «в восторге» от LTX-2.3 ComfyUI. Скорее почувствовала облегчение. Картинки стали соответствовать запросу быстрее, а рабочий процесс перестал воевать с VRAM. Двухэтапный путь я оставлю. Он тихий и работает.

Предыдущие публикации: