Руководство по API LTX-2.3: 7 эндпоинтов, варианты доступа и использование в продакшене

LTX-2.3 предлагает 7 эндпоинтов: текст-в-видео, изображение-в-видео, аудио-в-видео, расширение, повтор (стандартный и быстрый варианты). Это руководство охватывает каждый режим и варианты доступа к управляемому API.

Привет, меня зовут Дора. Небольшая деталь подтолкнула меня к API LTX-2.3 на прошлой неделе: я снова и снова вручную переделывала одни и те же поясняющие ролики длиной 6–10 секунд. Ничего драматичного — просто усталость от монотонной работы. Я видела упоминания «быстрых» вариантов и эндпоинтов «retake» тут и там, поэтому выделила несколько утренних часов в марте 2026 года, чтобы опробовать API ltx-2.3 в реальной работе. Никакой помпы. Только несколько промптов, макеты продуктов и вступление к подкасту, к которому я слишком трепетно относилась.

Дальше — не обзор функций. Это то, как вели себя эндпоинты API ltx-2.3 в моём случае, что ускорило работу и где ещё заметны шероховатости.

7 эндпоинтов LTX-2.3 в общих чертах

Вот ментальная карта, которую я выработала после недели экспериментов. Главное, что я заметила: это не отдельные «функции» — это регуляторы в последовательности. Я часто делала наброски с быстрой генерацией текст-в-видео, фиксировала промпты, затем переключалась на стандартный режим, или засевала клип image-to-video и удлиняла его для нужного хронометража. Платформа предоставляет всё это через стандартный REST API, что не давало рабочему процессу распасться по вкладкам.

- Text-to-Video (стандартный): проход на качество. Медленнее, но лучше согласованность движения и чище текстуры. Я обращалась к нему, когда кадр важен и можно подождать.

- Text-to-Video (быстрый): разведчик. Быстрая оценка компоновки и идей движения, полезен для формирования промптов и пакетного генерирования идей.

- Image-to-Video: анимирует один кадр. Если нужно, чтобы логотип «ударил» или макет «дышал» на экране, этого достаточно без излишнего дрейфа.

- Audio-to-Video: управляет движением с помощью аудиодорожки. Не синхронизация губ — скорее метроном для модели.

- Extend-Video: добавляет секунды в конец. Непрерывность приемлемая, если промпты и сиды стабильны.

- Retake-Video: перегенерирует сегмент с сохранением ограничений. Помогает исправить дрожащую руку или странное движение камеры без начала с нуля.

- System/Utility: опрос состояния задач. Не glamorous, но необходимо.

Text-to-Video: компромиссы между стандартным и быстрым вариантами

Я постоянно переключалась между ними. Разница проста на бумаге — скорость против качества, — но проявляется в деталях, которые важны при финальной сдаче.

- Быстрый работал в 2–4 раза быстрее на клип на управляемых хостах. Отлично для набросков и выбора направления — не годится для тонких текстур и мелкой типографики.

- Стандартный уменьшил «размытые края» на руках и мерцание при микродвижениях, а также стабильнее удерживал направление освещения между кадрами.

- На сложных промптах (толпы, вода, листва) стандартный лучше справлялся с временным шумом. Быстрый иногда выглядел нормально при первом просмотре, но казался «суетливым» в монтаже рядом с реальными съёмками.

Скучная правда: я сэкономила больше времени, переключаясь между вариантами в нужный момент, чем выкручивая любую отдельную настройку.

Ключевые параметры и рекомендации по промптам

Несколько параметров реально повлияли на результат:

- Длительность и кадры: короче — лучше. 4–8 с при 16–24 к/с — оптимальный диапазон для стабильного движения и разумного времени ожидания в очереди.

- Сид: зафиксируйте его, как только направление покажется правильным. Сиды сделали retake и extension значительно менее хаотичными.

- Guidance/CFG: низкое значение (4–6) даёт модели свободу; высокое (7–9) жёстче удерживает стиль, но увеличивает однообразие кадр за кадром.

- Негативные подсказки: направляйте их на движение, а не только на визуальные элементы — «без резких наездов», «без вращения камеры», «стабильный штатив». Это убирало резкие рывки эффективнее, чем описание объектов.

Структура промпта, которая работала стабильно: одно предложение — сцена и объект, одно — камера и движение, одно — свет и текстура. Я перестала перегружать прилагательными, как только заметила, что они мешают друг другу.

Image-to-Video: требования к входным данным и риски артефактов

Я использовала этот режим преимущественно для анимации статичных изображений — макетов UI, главных кадров продуктов, простых логотипов. Входные данные предпочитали чистые источники: чёткие PNG без компрессионных артефактов. Квадратные или близкие к квадратным изображения вели себя лучше.

- Мягкие указания для камеры («тонкий параллакс, лёгкое покачивание с руки») создавали жизнь, не разрушая изображение.

- Делайте текстовые слои крупными — мелкие подписи UI превращались в кашу в движении. Критически важный текст я добавляла как оверлеи на постпродакшне.

- Тонкая штриховая графика мерцала по краям. Лёгкое размытие при предобработке помогало.

- Логотипы оставались читаемыми, если я избегала быстрых поворотов. Для появлений я давала модели наклон 10–15°, а затем делала монтажный переход.

Если артефакт появляется на 1–2 кадре, он обычно сохраняется на протяжении всего клипа. Перегенерируйте с новым сидом, прежде чем пытаться исправить это на постпродакшне.

Audio-to-Video: как работает кондиционирование на практике

Я шла туда в надежде на синхронизацию губ. Это не то, что делает данный эндпоинт. Думайте скорее о темпе, энергии и общих сигналах движения. С барабанными треками модель улавливала сильные доли как мягкие толчки камеры. С эмбиентным звуком она замедлялась — меньше подёргиваний, больше дрейфа.

На практике я воспринимала аудио как карту темпа. Для 20-секундной эмбиентной подложки я нарезала два клипа по 8 с и один 4-секундный, каждый обусловленный той же дорожкой, затем выбирала лучший для непрерывности. Даже низкочастотные гулы формировали движение — если вы не хотите, чтобы камера «дышала» на каждом ударе баса, добавьте «no rhythmic camera pulsing» в негативный промпт.

Где помогло: фоновые шумы, музыкальный темп для b-roll, совпадение тона. Где не помогло: синхронизация губ, точное совпадение с битом или диалоговые сцены.

Extend и Retake: создание более длинных или исправленных последовательностей

Эти два режима — тихие победы. Я соединила два 6-секундных клипа в 12-секундный кадр, удлинив хвост первого клипа с теми же промптом, сидом и указаниями для камеры. Стык был не идеальным, но точка монтажа скрылась под паузой в саундтреке. Если первый кадр вашего удлинения выглядит неправильно — остановитесь. Плохое начало редко исправляется.

Retake исправил быстрый панорамный наезд, проскользнувший в последние 2 секунды в остальном удачного клипа. Я сохранила негативные указания о движении, а не о содержании, и в среднем требовалось 1–3 попытки. Оба эндпоинта выигрывают от дисциплины: зафиксируйте сид, длительность и язык описания камеры, прежде чем гнаться за микроисправлениями.

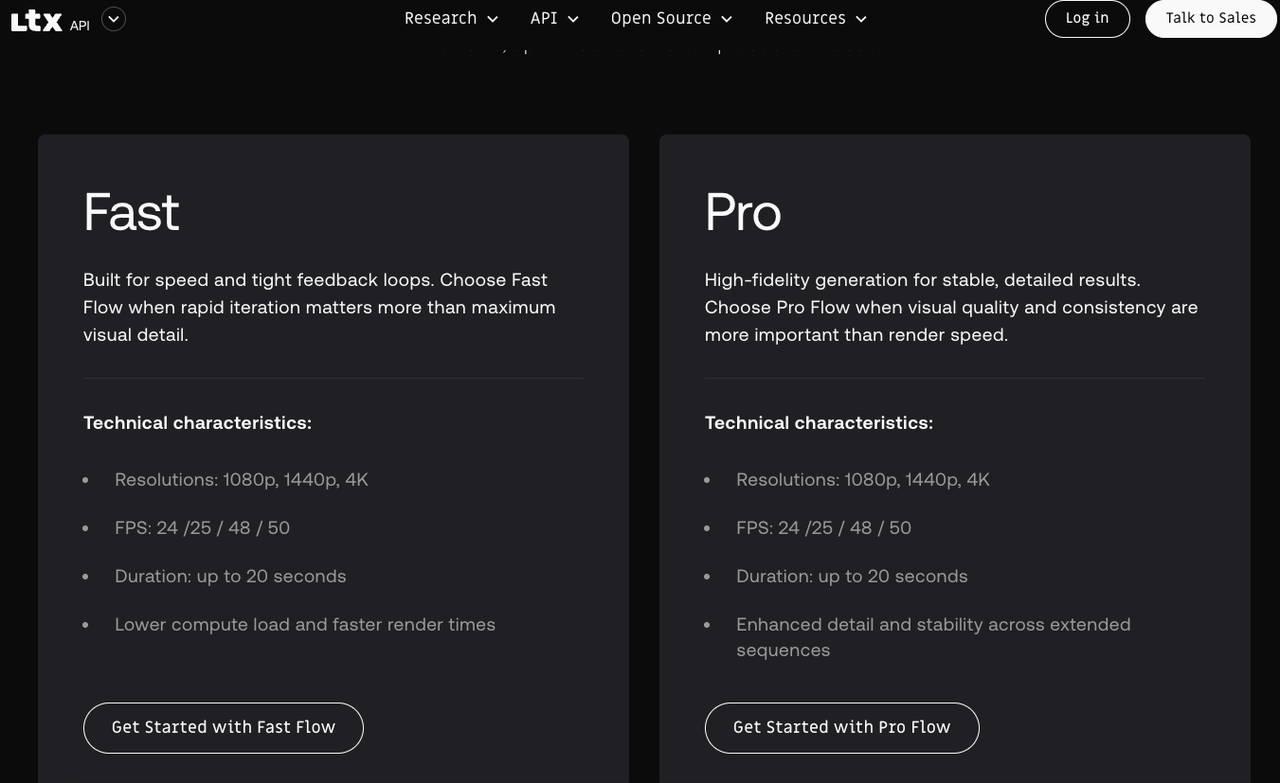

Управляемый API против самостоятельного хостинга: компромиссы

Я пробовала один управляемый хост (интерфейс в стиле fal.ai) и локальную машину в течение дня. Управляемый API выигрывает, когда нужно быстро получить десять вариантов и не хочется следить за драйверами, — но ограничения по частоте запросов и поминутные расходы суммируются при длительных запусках. Самостоятельный хостинг предлагает более низкую предельную стоимость и полный контроль над пакетной обработкой, ценой сложности настройки и проблем с драйверами.

Простая эвристика: десяток коротких исследовательских клипов — выигрывает управляемый. Сотни секунд с зафиксированными промптами — самостоятельный хостинг начинает окупаться.

По железу, 24 ГБ VRAM — комфортный минимум для клипов 8–10 с при разрешении 768p в марте 2026 года. Документация CUDA 12.x toolkit охватывает требования к драйверам, если вы настраиваете локальную машину для инференса — я зафиксировала версию драйверов, чтобы избежать неожиданных замедлений.

Распространённые ошибки API и способы их устранения

- Несоответствие размеров: некоторые эндпоинты требуют размеров, кратных 16. Если задача мгновенно завершается ошибкой, уменьшите до ближайшего кратного 16.

- Слишком длинные промпты: управляемые хосты обрезают или выдают таймаут на очень длинных JSON-пейлоадах. Переносите списки стилей в более короткие фразы; используйте негативные подсказки экономно.

- Дрейф сида между эндпоинтами: при переключении с text-to-video на extend-video сид иногда игнорировался, если я забывала его передать. Логируйте сид и cfg с каждым запросом.

- Всплески ограничений частоты запросов: разносите пакетные отправки на 200–300 мс или используйте рекомендованные провайдером заголовки параллелизма.

Часто задаваемые вопросы

Какова максимальная длина клипа на один вызов API?

Большинство управляемых хостов ограничивают 4–10 с при стандартных частотах кадров, чтобы поддерживать разумные очереди. На самостоятельном хостинге я доходила до ~12–16 с до заметного снижения качества. Для более длинных материалов используйте цепочку удлинений с общими сидами.

Насколько сильно отличается качество между быстрым и стандартным вариантами?

Заметно, но не кардинально. Быстрый даёт 70–80% результата за долю времени. Если клип будет стоять рядом с натурными съёмками, завершайте в стандартном режиме.

Можно ли применять адаптеры LoRA через управляемый API?

Зависит от хоста. Некоторые предоставляют предустановки моделей или адаптеры стилей; другие оставляют стандартные настройки. Хаб моделей Hugging Face — лучшее место для перекрёстной проверки доступных слотов адаптеров и дообученных моделей сообщества перед выбором провайдера. Локально у вас больше свободы — но и больше способов всё сломать.

Что насчёт использования нескольких модальностей с одним API-ключом?

Большинство мультимодельных платформ выставляют счёт по кредитам и покрывают эндпоинты для изображений и видео под одним ключом. Стоит проверить страницу цен провайдера до начала работы — спецификация OpenAPI полезна для понимания того, как хорошо структурированная документация API должна представлять охват эндпоинтов и модель оплаты.

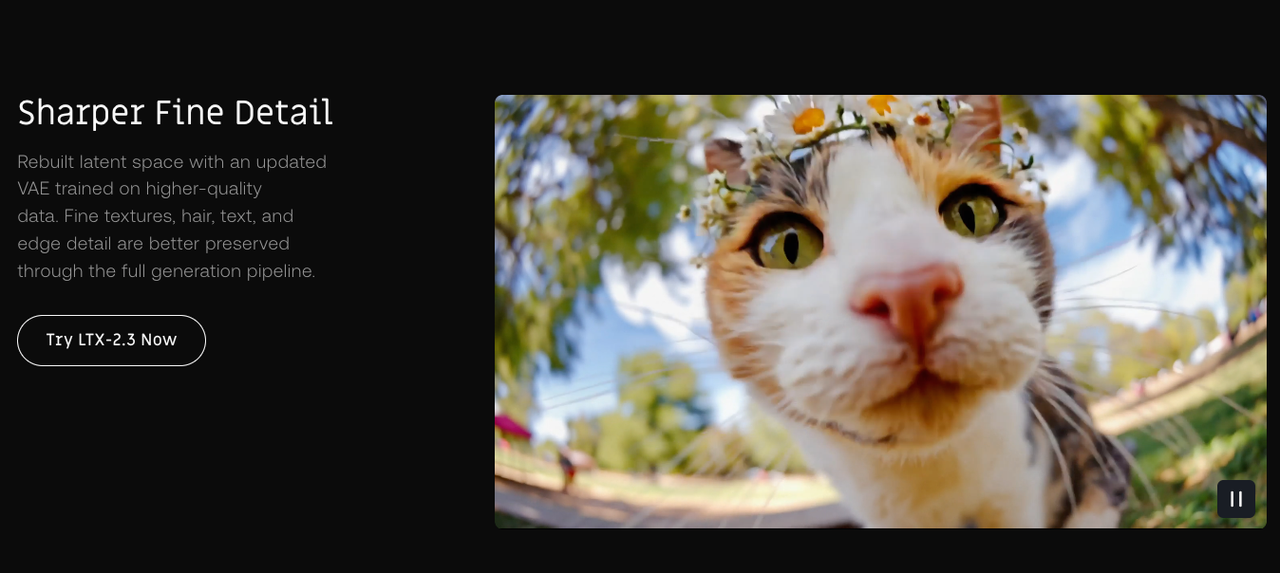

Примечание о стандартах качества видео

Стоит помнить: «высокое качество» означает разные вещи в разных контекстах. Для b-roll, предназначенного для соцсетей, быстрый режим зачастую достаточен. Для всего, что монтируется с телевизионным или кинематографическим материалом, полезно понимать, какие кодеки и цветовая наука требуются для финальной сдачи. Библиотека стандартов SMPTE — сухое чтение, но базовые спецификации для частоты кадров, битовой глубины и цветового пространства важны, если вы передаёте клипы колористу или постпродакшн-студии.

Закончу небольшим замечанием: чем больше я воспринимала эти эндпоинты как части системы — дисциплина сидов, короткие прогоны, устойчивый язык описания камеры, — тем меньше я с ними боролась потом. Это не магия. Но несколько простых правил сделали работу легче.

Предыдущие публикации:

- Пошаговое руководство по интеграции WAN 2.7 в рабочий процесс API

- Сравнение WAN 2.7 и WAN 2.6 для понимания реальных компромиссов при обновлении

- Как работает редактирование видео на основе инструкций в реальных производственных конвейерах

- Как управление первым и последним кадром повышает согласованность генерации видео

- Как апскейлеры AI-видео улучшают качество результата после генерации