Руководство по API GPT Image 2 для генерации и редактирования

Практическое руководство по API GPT Image 2 для разработчиков: генерация, редактирование, проектирование рабочих процессов и ключевые аспекты реализации.

На прошлой неделе я выпустила небольшую фичу продукта, которой требовалась генерация изображений по нажатию кнопки. На второй день разработки я поняла, что интеграционные решения, принятые в первый день, будут определять, сколько боли я буду нести следующие шесть месяцев. Вот о чём никто не предупреждает насчёт API GPT Image 2. Hello-world — это просто. Рабочее состояние в продакшене — вот где становится интересно.

Меня зовут Дора. Я веду рабочие заметки после того, как что-то выпускаю, а не до. Это то, что я узнала, интегрируя OpenAI gpt-image-2 в реальный продукт, и что я бы посоветовала другому разработчику или команде AI-инженеров обдумать перед отправкой первого запроса.

Что нужно перед использованием API GPT Image 2

Доступ к модели, эндпоинты и ключевая документация

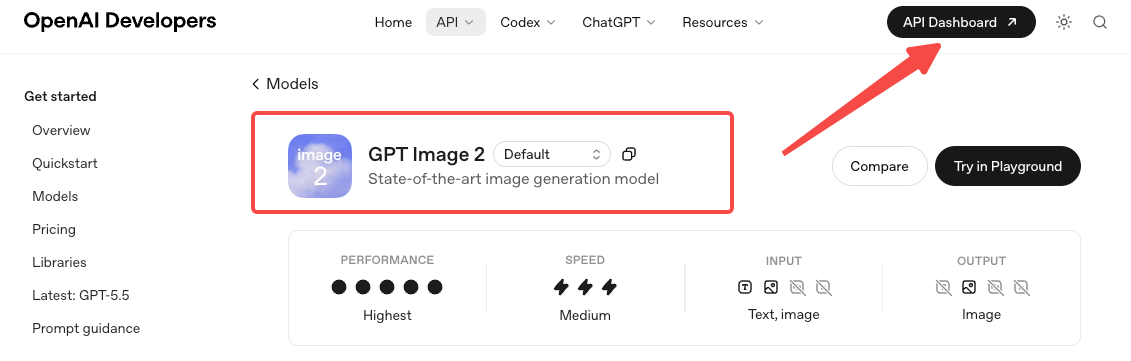

GPT Image 2 вышел 21 апреля 2026 года. ID модели — gpt-image-2. Перед первым вызовом вам, возможно, потребуется пройти верификацию API-организации в консоли разработчика — OpenAI ограничивает семейство GPT Image этой процедурой.

У вас есть три поверхности на выбор. Image API предоставляет два эндпоинта: images.generate для генерации текст-в-изображение и images.edit для изменения существующих изображений с помощью промпта и опциональной маски. Третья поверхность — Responses API, который предоставляет генерацию изображений как встроенный инструмент для разговорных или многошаговых потоков.

Выбирайте по задаче, а не по новизне. Если ваш продукт — «пользователь вводит промпт, получает изображение», используйте Image API. Если ваш продукт — «пользователь ведёт диалог, который иногда создаёт изображения», используйте Responses API. Смешивать их, потому что один выглядит круче — это ловушка сопровождения кода.

Что поддерживает GPT Image 2 сегодня

Два момента, которые нужно усвоить с самого начала.

Он не поддерживает прозрачный фон. Запросы с background: "transparent" завершатся ошибкой. Если вам нужны прозрачные PNG, направляйте эти задачи к gpt-image-1.5 и принимайте тот факт, что теперь вы поддерживаете два пути модели.

Точность ввода зафиксирована. Параметр input_fidelity существует для более старых моделей, но gpt-image-2 всегда обрабатывает входные данные с высокой точностью. Опустите параметр, иначе запрос завершится ошибкой. Ценовое следствие: запросы на редактирование с референсными изображениями потребляют больше входных токенов, чем вы могли ожидать исходя из опыта работы с gpt-image-1.

Как генерировать изображения с GPT Image 2

Базовая структура запроса и выбор выходных данных

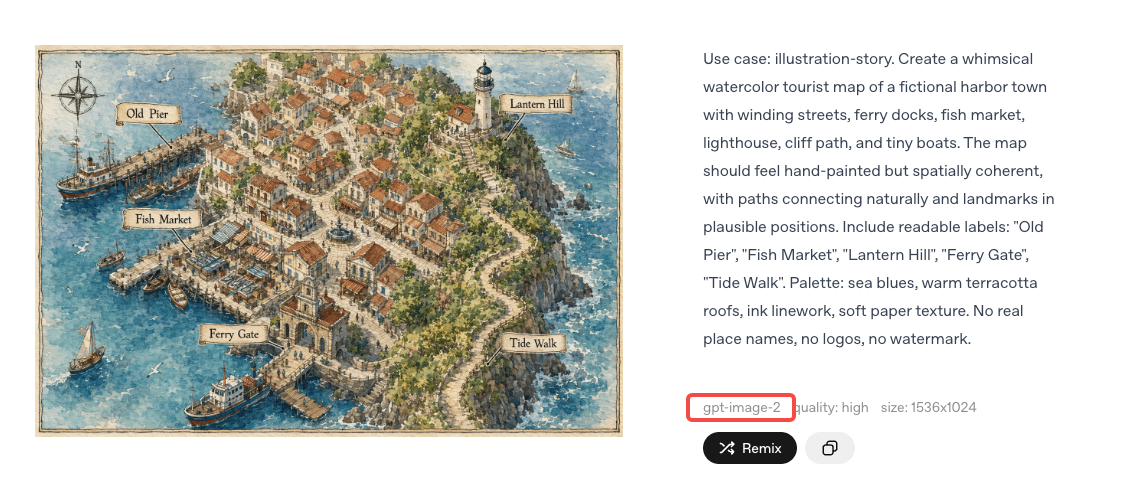

Запрос на генерацию принимает промпт, размер, качество и формат вывода. По умолчанию формат PNG; вы можете запросить JPEG или WebP, а JPEG быстрее PNG, когда важна задержка. Размер принимает пресеты или пользовательские размеры с ограничением: оба края должны быть кратны 16, максимальный отдельный край 3840px, соотношение сторон не более 3:1, общее количество пикселей от 655 360 до 8 294 400.

Параметр n позволяет генерировать несколько изображений в одном запросе. Полезно, когда нужно сравнить варианты. Менее полезно, когда вы платите за каждый выходной токен — а вы платите.

Управление размером, качеством и компромиссами в рабочем процессе

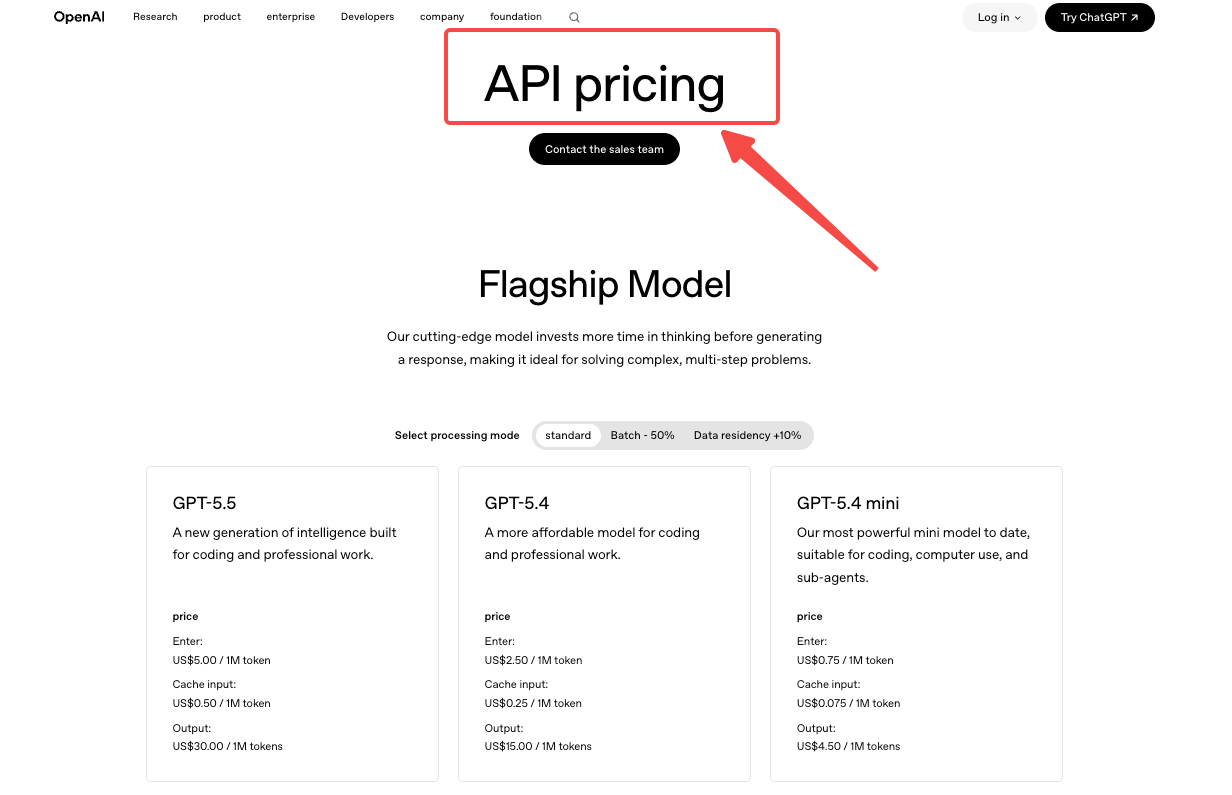

Здесь большинство команд тратят деньги, не осознавая этого. GPT Image 2 тарифицируется по токенам, а не по изображению: входные изображения $8 за 1M токенов, выходные изображения $30 за 1M токенов, текстовые входные $5 за 1M токенов. Кешированные входные данные дешевле. Пакетная обработка делит стандартные тарифы пополам.

Что это означает в практических цифрах: при 1024x1024 калькулятор OpenAI оценивает примерно $0,006 для низкого качества, $0,053 для среднего, $0,211 для высокого. Прямоугольные размеры, например 1024x1536, чуть дешевле — $0,005, $0,041 и $0,165. Это только оценки выходных данных. Прибавьте входные токены и токены референсов для редактирования.

Поэтому вопрос о компромиссе — не в том, какое качество выглядит лучше. Вопрос в том: при моём объёме, какова разница в стоимости между средним и высоким качеством, и действительно ли мой пользователь это замечает? Для поверхности миниатюр низкое качество часто вполне подходит. Для главного изображения, на которое пользователи будут смотреть, высокое качество оправдывает свою цену. Я выбрала среднее в качестве значения по умолчанию и сделала высокое опциональным. Это единственное решение изменило мой прогнозируемый ежемесячный счёт примерно в 4 раза.

Как работает редактирование изображений

Требования к входным данным и распространённые сценарии редактирования

Эндпоинт редактирования принимает изображение, опциональную маску и промпт, описывающий изменение. Передайте одно изображение, чтобы отредактировать его. Передайте несколько изображений, чтобы объединить субъекты, стили или референсы в один вывод. Модель поддерживает инпейнтинг и аутпейнтинг, сохраняет незамаскированные области и применяет промпт к остальному.

Редактирования, которые я проверила: замена фона на фотографиях продуктов, удаление объектов, перенос стиля между двумя референсными изображениями и перевод текста внутри изображения. Заявление о согласованности персонажа — один и тот же персонаж в нескольких сгенерированных сценах — работает у меня на простых субъектах. Надёжность снижается по мере роста сложности сцены.

Ошибки, которые увеличивают стоимость или снижают согласованность

Отправка входных данных с избыточным разрешением. Поскольку GPT Image 2 обрабатывает каждое входное изображение с высокой точностью, референсное фото 4K стоит столько же входных токенов, что для миниатюры, что для постера. Масштабируйте референсы до того, что действительно нужно задаче.

Расплывчатые промпты редактирования. «Сделай лучше» производит непредсказуемые изменения и часто требует повторного запроса. «Смени красную шапку на светло-синий бархат» сохраняет остальное изображение и обычно попадает с первого раза.

Неограниченное n. Запрос n=4, чтобы «посмотреть варианты», звучит безобидно — пока вы не осознаёте, что заплатили 4x за запрос, где использует только один результат.

Оценка стоимости редактирования как генерации. Редактирование часто стоит дороже генерации того же размера выходных данных, потому что референсные изображения добавляют входные токены. Учтите это в вашей модели ценообразования до запуска, а не после.

Производственные соображения для команд

Повторные попытки, модерация и операционные ограничения

Три вещи, которые необязательны в продакшене.

Повторные попытки с экспоненциальной задержкой. Генерация изображений может занять до 2 минут для сложных промптов, и вы столкнётесь с ограничениями по частоте запросов. Рекомендация OpenAI — повторять попытки с экспоненциальной задержкой плюс джиттер — джиттер важен, потому что синхронизированные повторные попытки от парка серверов попадают в один и тот же предел одновременно.

Модерация в два слоя. У эндпоинта генерации изображений есть встроенный параметр moderation (auto по умолчанию; low — более мягкий, но всё равно фильтруемый). Для промптов, введённых пользователями, пропускайте их через бесплатный эндпоинт omni-moderation-latest перед отправкой в gpt-image-2 — он принимает и текст, и изображения и блокирует большинство запросов, нарушающих политику, до того как вы заплатите за генерацию. В справке по API модераций указана точная форма запроса.

Логирование на нужном уровне детализации. Логируйте ID модели, размер, качество, количество токенов промпта, количество выходных токенов, задержку, ID запроса и финальную оценку стоимости на запрос. Когда что-то идёт не так в масштабе, именно эти данные позволяют диагностировать проблему. Когда всё идёт правильно — именно эти данные позволяют решить, масштабировать ли дальше. Привяжитесь к конкретному снапшоту модели в продакшене, а не к плавающему псевдониму, чтобы поведение не менялось незаметно. Руководство по лучшим практикам для продакшена охватывает ротацию ключей, мониторинг и остальной операционный уровень.

Когда достаточно прямой интеграции, а когда стоит добавить платформенный слой

Это вопрос, над которым я дольше всего думала.

Прямая интеграция с OpenAI — правильный ответ, когда ваш продукт использует одну модель изображений, ваша команда имеет опыт работы с API-операциями, а ваш трафик достаточно предсказуем, чтобы владение ограничениями по частоте запросов и первичное биллингование были важнее удобства.

Платформенный слой — и да, я работаю над одним в WaveSpeedAI — оправдывает своё место в иных ситуациях. Вы маршрутизируете запросы между несколькими моделями изображений (gpt-image-2 для типографики, другая модель для прозрачных PNG, ещё одна для видео). Вам нужно фиксированное ценообразование за вызов для предсказуемости бюджета, а не токенная математика. Вы хотите единую поверхность интеграции, которая переживает изменения провайдеров без переписывания точек вызова.

Ни один ответ не универсален. Честный тест: посчитайте, сколько провайдеров моделей ваш продукт вызывает сегодня, умножьте на то, сколько вы будете вызывать через двенадцать месяцев, и спросите себя, хотите ли вы сами поддерживать столько интеграций.

Часто задаваемые вопросы

Какой эндпоинт разработчики должны использовать для GPT Image 2?

Используйте images.generate для генерации текст-в-изображение, images.edit для изменения существующего изображения с помощью промпта и опциональной маски, и инструмент изображений Responses API, когда генерация должна происходить внутри многоходового разговора.

Поддерживает ли GPT Image 2 редактирование изображений?

Да. Эндпоинт images.edit принимает одно или несколько референсных изображений плюс промпт и поддерживает инпейнтинг и аутпейнтинг с маской. Все входные изображения обрабатываются с высокой точностью автоматически.

Что команды должны логировать и мониторить в продакшене?

Как минимум: ID снапшота модели, размер, качество, количество входных и выходных токенов, задержку, ID запроса, количество повторных попыток, результат модерации и финальную оценку стоимости на запрос. Это то, что позволяет восстановить картину любого инцидента и прогнозировать расходы.

Когда простой API-интеграции становится недостаточно?

Когда вы обращаетесь к более чем одному провайдеру изображений, когда режимы отказа требуют резервирования между провайдерами, или когда финансовый отдел требует предсказуемого ценообразования за вызов вместо вариативности на основе токенов. Ниже этих порогов прямая интеграция остаётся более чистым выбором.

Как предотвратить утечку prompt-инъекций и небезопасных результатов в продакшен?

Пропускайте пользовательские промпты через эндпоинт модерации перед генерацией, установите параметр moderation в Image API в auto, логируйте каждый помеченный запрос и следуйте лучшим практикам безопасности OpenAI — включая проверку человеком для высокорисковых поверхностей и red-teaming перед запуском.

Заключение

API GPT Image 2 не сложно интегрировать. Первый запрос занимает половину дня. Важные решения — качество по умолчанию, моделирование стоимости редактирования, слоёная модерация, поведение при повторных попытках, нужен ли платформенный слой — это те решения, которые тихо накапливаются в течение месяцев после выпуска. Принимайте их осознанно. Сначала запустите небольшой пилот. Всё остальное последует.