GPT-5.4 для разработчиков: что означают утечки для рабочих процессов ИИ

Быстрый режим, улучшения зрения и сигналы агентов программирования — вот что утечки о GPT-5.4 могут означать для создателей ИИ-инфраструктуры.

Привет, я Дора. Я не планировала отслеживать GPT‑5.4. Просто постоянно натыкалась на маленькие препятствия в своих агентных рабочих процессах — паузы, достаточно долгие, чтобы переключиться на почту, а потом забыть, чем вообще занималась. Когда модель обещает «Быстрый режим» и зрение в полном разрешении, я навостряю уши — не потому что хочу что-то новое, а потому что хочу избавиться от этих мелких помех.

Эта статья для разработчиков gpt 5.4 — или, точнее, для тех, кто решает: стоит ли и как именно строить решения вокруг неё. Я здесь не для того, чтобы продавать модель. Я здесь, чтобы поделиться: где она может снизить трение, где, скорее всего, нет, и к чему стремиться в разработке, чтобы сегодняшняя работа пережила завтрашние примечания к релизу.

Почему разработчики внимательно следят за GPT-5.4

Переход к модели как инфраструктуре

Я замечаю медленный, но реальный сдвиг: модели всё меньше похожи на «продукты» и всё больше — на утилиты, через которые маршрутизируются задачи. Год назад я воспринимала каждую модель как личность. Сейчас я отношусь к ним как к полосам на шоссе: высокоточная, быстрая, дешёвая — и стараюсь плавно перестраиваться между ними.

Если GPT‑5.4 закрепит двухполосный паттерн (быстрый/медленный или быстрый/думающий), это подталкивает нас проектировать агентов вокруг маршрутизации, а не единственной ставки. Звучит абстрактно — до тех пор, пока не отлаживаешь задачу из 12 шагов и не понимаешь, что шаг 3 требует просто быстрой классификации, а шаг 8 — тщательной цепочки рассуждений. Я вшивала эту логику вручную в текущие системы. Это хрупко. Если инфраструктура возьмёт это на себя — меньше мест, где можно споткнуться.

Версии меня не впечатляют: меня интересует, позволяет ли релиз убрать шаги или сократить связующий код. GPT‑5.4, если движется в сторону, на которую намекают сигналы, может оказаться именно таким.

Почему важны инкрементальные релизы

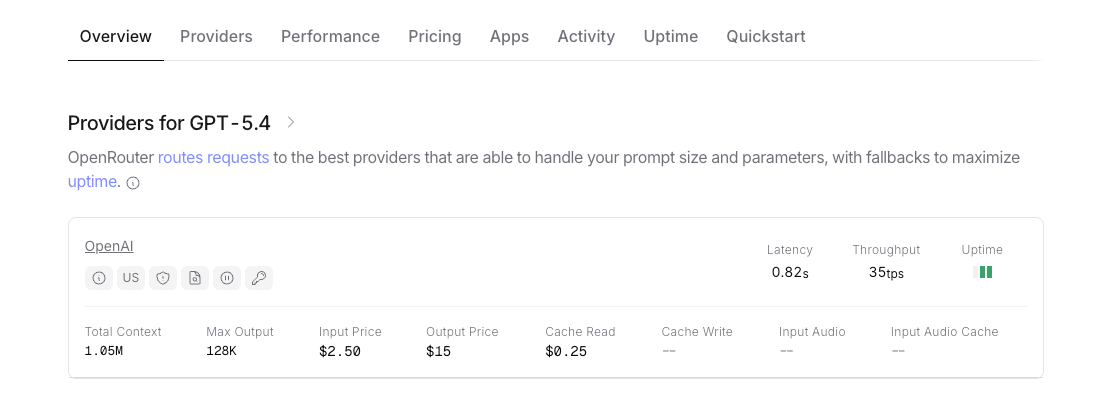

Мелкие версионные правки выглядят скучно, но спасают команды от полных переработок. Когда модели сохраняют интерфейсы стабильными, улучшая при этом задержку или качество распознавания зрения, мне не нужно переобучать пользователей (и себя). Ценность проявляется в таких вещах, как: меньше повторных попыток, более компактные промпты, более короткие таймауты.

Я слежу за документацией OpenAI API и страницами моделей на предмет структурных изменений, а не слоганов. Если GPT‑5.4 встраивается в существующие эндпоинты с более разумными дефолтами и более чётким поведением системы — это победа. Меньше изменений в коде, более предсказуемые логи. А для тех, кто поддерживает агентов в проде, предсказуемость каждый раз бьёт новизну.

Быстрый режим — что меняется в агентных рабочих процессах

Текущие затраты на рассуждение в многошаговых агентах

По моим запускам за последний месяц с моделями текущего поколения: типичный многошаговый агент (планирование → получение данных → вызов инструментов → резюмирование) занимает 8–15 вызовов модели. Каждый вызов стоит двух вещей: токенов и внимания. Токены можно заложить в бюджет. Внимание — это то, что истощает: маленькие ожидания, частичные повторы, моменты, когда задаёшься вопросом, не завис ли процесс.

У меня типичная задача разрешения внутреннего инструмента занимает в среднем 20–45 секунд от начала до конца. Большую часть этого времени составляют не тяжёлые рассуждения: это лёгкие проверки и форматирование. Если Быстрый режим GPT‑5.4 сокращает задержку на этих лёгких шагах, сохраняя достаточную точность, это меняет форму всего запуска. Длинный хвост маленьких ожиданий срезается. На бумаге это не выглядит драматично, но в ежедневной работе ощущается лучше.

Двухрежимный инференс и логика маршрутизации

Я слежу за тем, является ли «Быстрый режим» просто меньшей моделью, или это действительно модель в паре с думателем внутри одной границы. Если API предоставит чистый хинт — скажем, параметр или правило маршрутизации на уровне инструмента — я смогу централизовать решение: быстро для классификации, полностью для синтеза. Больше никаких самодельных развилок в каждом шаге агента.

В тестах с сегодняшними моделями я прототипировала двойное поведение маршрутизации, проверяя намерение шага и уверенность. Это неуклюже, но работает: быстрый маршрут для известных паттернов, глубокий маршрут при высокой неопределённости. GPT-5.4 скорее всего потребует того же, если API не будет автоматически маршрутизировать. Если будет — задача смещается к написанию разумных ограждений и логирования, чтобы видеть, когда модель злоупотребляет медленной полосой.

В любом случае, логика — это главное. Функция под названием «Быстро» не помогает, если нельзя понять, когда она используется. Я предпочту простой параметр и хороший трейс, нежели магию.

Последствия для циклов вызова инструментов

Вот где это важно в повседневной работе: циклы инструментов. Когда агент три раза подряд обращается к вашему калькулятору, базе данных или браузеру, накладные расходы накапливаются. Если Быстрый режим снижает стоимость round-trip для разбора намерений и конструирования аргументов функций — цикл сужается. Это освобождает бюджет для шагов, которые действительно требуют рассуждения.

Но есть нюанс: если быстрый проход неправильно маршрутизирует даже 5–10% вызовов, вы платите за это повторными попытками и ограждениями. Мое практическое правило простое: измеряю общее количество завершённых циклов в минуту, а не задержку на вызов. Если это число растёт при включённом Быстром режиме — оставляю. Если падает (больше повторов, больше исправлений) — отключаю для этого потока. Дело не в скорости, а в надёжной пропускной способности.

Зрение в полном разрешении — реальные кейсы использования

Пайплайны скриншот-в-код

У меня есть небольшой пайплайн скриншот-в-компонент для внутренних инструментов. Сегодня зрение с низким разрешением упускает мелкие отступы или подсказки состояния (hover vs. active). Зрение в полном разрешении, если оно реально и доступно по разумной стоимости токенов, это меняет. Модель может видеть пиксельную границу и тонкую тень, сигнализирующую об уровне подъёма.

На практике я бы подключила это так: проход в высоком разрешении для маркировки атомарных UI-элементов, затем быстрый текстовый проход для сборки кода с использованием карты библиотек. Два прохода, каждый хорош в своём деле. Результат — не магия «дизайн в код», а меньше ручных исправлений. На простом дашборде это может сэкономить мне 10–15 минут и пару возвратов в Figma.

Рабочие процессы отладки UI

Тихий, но полезный кейс: воспроизведение багов. Я часто получаю скриншоты с наполовину обрезанными тостами ошибок или наложениями модальных окон. Зрение высокого разрешения помогает модели рассуждать о z-index и наложении макетов без необходимости описывать это словами. Модель может отметить: кнопка закрытия тоста перекрывает навигацию — вероятно, проблема с CSS-стекингом. Я всё равно проверяю, но начинать ближе к исправлению — это облегчение.

Для команд это может встроиться в триаж: вставить скриншот, получить список вероятных причин плюс селекторы для проверки. Ничего магического, просто более плотный цикл.

Интерпретация дизайн-ассетов

Дизайнеры передают мне экспорты с соглашениями об именовании, которые смещаются под давлением дедлайнов — так бывает. Зрение в полном разрешении плюс контекст о дизайн-системе может восстановить порядок. Модель может сопоставить визуальные токены (отступы, радиус, контрастность цвета) с ближайшими переменными дизайн-системы.

Ограничения остаются. Модель не знает вкусов вашей команды. Но она может сделать скучную часть: «эти 12 иконок 20px, эти 3 — 16px: вероятное несоответствие». Это не заголовок новости, но именно такая маленькая точность накапливается за спринт.

Сигналы агента кодирования в контексте

Почему утечки появились в репозиториях Codex

Вы, наверное, видели намёки — коммиты со ссылками на сигналы агента или конфиги с необъяснёнными флагами маршрутизации. Я не придаю утечкам слишком большого значения, но они согласуются с тем, что нужно разработчикам: более чёткие сигналы о том, когда модель планирует, действует или рефлексирует. Более ранние репозитории эпохи Codex часто имитировали это с помощью эвристик на стороне клиента. Поэтому конфиги и утекали: логика должна была жить за пределами модели.

Если GPT‑5.4 предоставит более чёткие сигналы состояния (даже простые, вроде «планирование» vs «выполнение»), разработчики смогут синхронизировать UI и логирование без необходимости угадывать по тексту.

Потенциал редактирования нескольких файлов

Редактирование нескольких файлов — это место, где агенты кодирования ломаются. Сегодня я разбиваю контекст, прошу план, затем применяю диффы с линтером в цикле. Это работает до тех пор, пока не работает — обычно когда агент забывает небольшой файл или переименовывает что-то на лету. Лучшая нативная поддержка выглядела бы так: предложить коммит с картой файлов, включить обоснование по файлу и позволить принимать изменения по файлу.

Даже без новых примитивов улучшенное рассуждение GPT‑5.4 (если оно реализуется) плюс более строгие сообщения — «покажи мне набор патчей, не прозу» — могут уменьшить количество ошибок. У меня был некоторый успех с принудительным форматом патча и отклонением всего остального. Скучно. Помогает.

Улучшения навигации по репозиторию

Контекстные окна стали больше, но навигация всё равно важна. Лучшие прогоны кодирования, которые у меня были в 2026 году, используют быстрый индексатор, который строит карту символов и граф зависимостей, а затем передаёт только нужные срезы. Если GPT‑5.4 лучше читает эти карты, таблицы перекрёстных ссылок, сводки символов — мы можем передавать более тонкий, точный контекст.

Один практический сигнал для наблюдения: как часто агент запрашивает файл, который уже видел. Меньше повторов обычно означает, что он строит лучший рабочий набор. Я это логирую. Если вы нет — начните: это лёгкая метрика для отслеживания тенденций по релизам.

К чему разработчикам стремиться сейчас

Архитектурные паттерны, независимые от модели

Я стараюсь держать модели за узким портом. Брокер решает маршрутизацию: инструменты остаются без состояния и видимыми в логах: промпты живут в версионированных файлах с тестами. Таким образом, если GPT‑5.4 сделает Быстрый режим стоящим, я могу переключить полосу без перепрошивки всего.

Два паттерна, которые хорошо себя показали:

- Типизированные схемы инструментов со строгими валидаторами. Меньше догадок, меньше плохих вызовов.

- Дизайн с трейсингом на первом месте. Каждый шаг агента записывает компактный трейс, который я могу воспроизвести. Когда обновление модели меняет поведение, я могу сравнить старые и новые запуски.

Ни то, ни другое не блестит. Оба — это то, что не даёт доставке застопориться, когда модели меняются.

Мониторинг каналов релизов моделей

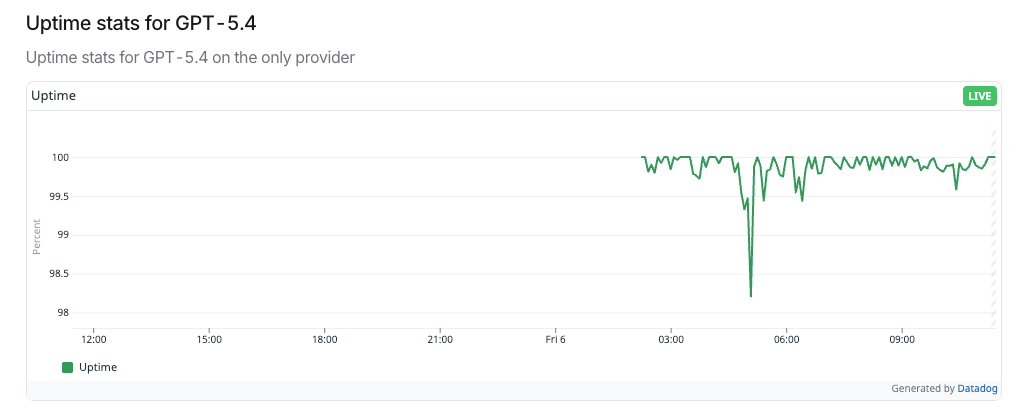

Даже если вы не двигаетесь быстро — следите за каналами. Я подписана на страницы моделей и просматриваю список моделей и примечания к релизам. При каждом обновлении отмечаю три вещи: подсказки по задержке, ценообразование токенов и любые новые системные переключатели (режимы, маршрутизация, поведение безопасности). Затем перезапускаю небольшой набор бенчмарков — 10–20 трейсов, представляющих мои реальные рабочие процессы.

Занимает час. Экономит дни потом. Если GPT‑5.4 выходит поэтапно (обычно так и бывает), вы увидите граничные случаи сначала в трейсах, а не в тикетах поддержки. В этом и смысл мониторинга: спокойно улавливать дрейф, пока он не стал пожаром.

Дисклеймер о статусе

Меня не спонсировали для написания этого. Я также ещё не делала производственных ставок на GPT‑5.4. Мои заметки здесь основаны на смежных экспериментах и паттернах, которые сохранялись в более ранних обновлениях моделей. Если и когда официальная документация прояснит режимы или детали зрения — я дам ссылки и скорректирую. До тех пор воспринимайте это как полевые заметки — надеюсь, полезные, но предварительные.

Последнее, над чем я всё ещё думаю: если Быстрый режим делает тихие части быстрее, мы замечаем меньше или просто меньше беспокоимся? Меня устроит любой вариант.