Guia de Edição de Vídeo Baseada em Instruções com WAN 2.7

O WAN 2.7 adiciona edição de vídeo baseada em instruções. O que é, o que você pode editar, como se encaixa em um pipeline de produção e o que os desenvolvedores precisam saber.

Olá a todos. Sou a Dora. Trabalho com ferramentas de vídeo com IA há algum tempo e, quando ouvi falar pela primeira vez sobre o recurso de edição baseada em instruções do WAN 2.7, não fiquei imediatamente convencida de que isso mudaria muita coisa. Editar vídeo com comandos de texto soava como um daqueles recursos que parece ótimo na demonstração, mas que desmorona quando você realmente precisa usá-lo.

Admito que estava parcialmente errada.

O Que Significa Edição de Vídeo Baseada em Instruções no WAN 2.7

Você pega um clipe de vídeo existente, escreve o que quer mudar e o modelo ajusta esse elemento específico mantendo todo o resto intacto. Não é uma regeneração. É uma edição.

Como se diferencia da geração padrão de texto para vídeo

Texto para vídeo começa do zero. Você escreve um prompt e obtém o que sair.

A edição por instrução começa de algo que já existe. O clipe está lá. O timing está definido. Você está pedindo ao modelo que mude uma parte — troque o fundo, altere a iluminação, recolora uma roupa — sem mexer no resto.

A análise da WaveSpeedAI observa que isso importa operacionalmente: ciclos de iteração que antes exigiam regenerar clipes do zero agora podem ser tratados como edições leves. Regenerar porque a cor da jaqueta estava errada parecia um desperdício. Editar apenas a jaqueta parecia certo.

Como se diferencia da Recriação de Vídeo

A recriação pega a estrutura de movimento de um vídeo de referência e a aplica a novos sujeitos ou estilos. É uma transferência de movimento.

A edição por instrução modifica. O clipe original permanece; apenas o elemento que você especifica muda.

O que o modelo recebe como entrada

Duas coisas: o vídeo de origem (até 15 segundos em 1080P) e uma instrução em linguagem natural.

O que me surpreendeu: sem máscaras, sem isolamento de camadas. Apenas o clipe e a frase.

O Que Você Pode e Não Pode Editar com Instruções

Categorias de edição suportadas

Com base em testes e na documentação da plataforma Dzine, a edição por instrução suporta:

- Troca de fundo (interno para externo, ensolarado para chuvoso)

- Alterações de iluminação (hora dourada para hora azul)

- Ajustes em nível de objeto (mudar cor de camisa, adicionar adereços)

- Modificações de estilo (realista para ilustrado)

Isso funciona porque são mudanças delimitadas. O modelo sabe o que é um fundo, o que a iluminação faz.

O que resiste à edição baseada em instruções

Rearranjos espaciais complexos não funcionam bem. “Mova o personagem para a esquerda” não produziu resultados limpos. O personagem ficou parado ou a composição se deslocou de forma estranha.

Cenas com forte identidade — expressões faciais específicas, detalhes finos de logotipos — resistem à edição. O modelo consegue mudar a iluminação, mas tem dificuldade em manter características exatas ao alterar expressão ou idade.

Mudanças de física são incertas. “Faça a água fluir mais rápido” às vezes funcionou, às vezes pareceu com falha.

Granularidade da edição

Todas as edições são feitas no nível do prompt. Você descreve o que muda; o modelo infere a qual parte isso se aplica. Ainda não há segmentação por objeto.

Aprendi a escrever instruções muito específicas. “Mude a jaqueta para vermelho” funcionou melhor do que “deixe a roupa em tons mais quentes.”

Como Criar Instruções de Edição Eficazes

O que torna uma boa instrução de edição

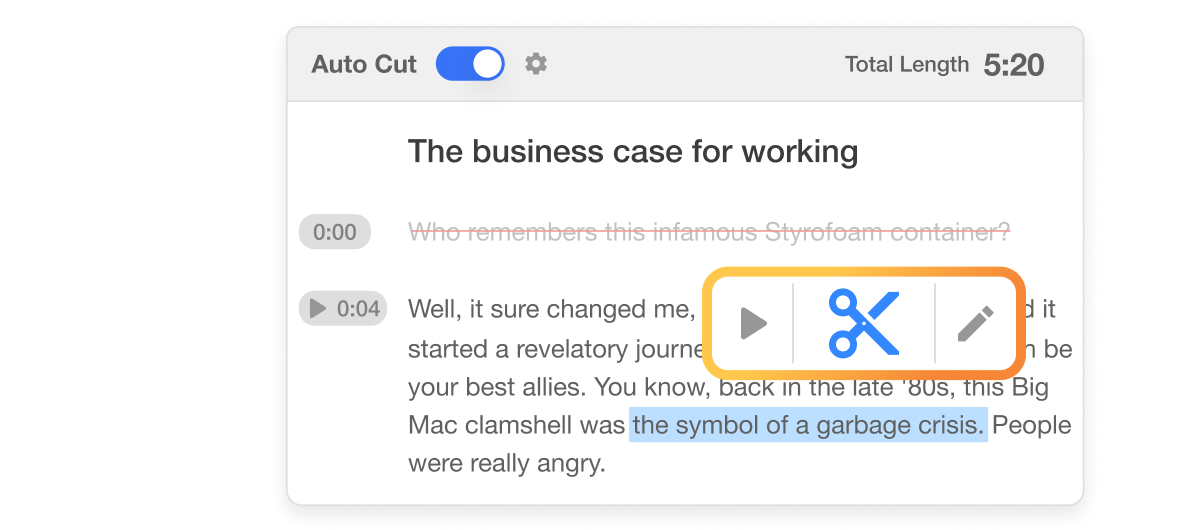

Boas instruções são específicas, direcionais e delimitadas. Essa abordagem ecoa a filosofia por trás de ferramentas como o Descript, onde você pode editar vídeo simplesmente editando o texto, sem nenhuma máscara ou isolamento de camadas.

“Mude o céu para nublado com nuvens escuras” funcionou consistentemente. Especifica o que muda, em que se transforma e adiciona detalhes.

“Faça parecer mais dramático” não funcionou. Muito vago. O modelo o interpretou de forma diferente a cada vez.

O que torna uma instrução ruim

Instruções que contradizem o clipe de origem falham silenciosamente. “Remova a pessoa da cena” em uma tomada focada em personagem foi simplesmente ignorado ou produziu quadros quebrados.

Instruções com múltiplos elementos conflitantes têm dificuldades. “Mude a jaqueta para azul, o fundo para uma floresta e adicione chuva” tentou três edições de uma vez. Uma edição por instrução funcionou melhor. Esse padrão claro de prompt — declare o que muda e descreva o estado alvo — está alinhado com as melhores práticas vistas na edição de vídeo baseada em texto da Visla, onde você refina o material editando diretamente a transcrição.

Padrão de prompt

O padrão que funcionou:

- Declare o que muda

- Descreva o estado alvo

- Mantenha em até 15 palavras

“Troque o fundo urbano por uma paisagem de montanha” — sujeito claro, alvo claro, resultados limpos.

Requisitos de Entrada

Especificações do vídeo de origem

Vídeos de origem: de 2 a 15 segundos, até 1080P. Testei clipes de 5 segundos em 1080P e de 10 segundos em 720P. Ambos funcionaram.

Alinhamento de referência

Se sua fonte tem muito desfoque de movimento, cortes rápidos ou exposição extrema, os resultados da edição pioram. O modelo precisa de quadros nítidos.

Tomadas com panorâmica rápida produziram trocas de fundo com borrão. Tomadas estáticas ou com movimento lento produziram edições limpas.

Onde a Edição por Instrução se Encaixa em um Pipeline de Produção

Não esperava usar isso como ferramenta principal. Esperava que fosse uma novidade. Não é.

Loop de polimento pós-geração

Depois de gerar um clipe com texto para vídeo padrão, frequentemente obtinha 80% do que queria. O movimento estava certo, o enquadramento estava certo, mas a gradação de cores parecia errada ou o fundo não correspondia ao briefing.

Antes da edição por instrução, isso significava regenerar com prompts ajustados e torcer para dar certo. Taxa de acerto: talvez 40%. Cada regeneração levava de 60 a 90 segundos, e eu frequentemente desperdiçava três ou quatro tentativas antes de conseguir algo utilizável.

Agora gero uma vez e depois edito o elemento específico que está errado. A taxa de acerto está mais perto de 70%, e a iteração é mais rápida. Em vez de três regenerações completas de 90 segundos cada (4,5 minutos no total), faço uma geração mais uma edição (aproximadamente 2,5 minutos no total). A economia de tempo se acumula ao longo de vários projetos.

Iteração de estilo sem regeneração completa

Testei isso gerando um clipe base de um personagem caminhando por uma rua da cidade e depois criando três variantes de estilo com edições por instrução:

- “Mude para estética neon cyberpunk”

- “Mude para estilo de pintura em aquarela”

- “Deixe em preto e branco, estilo film noir”

As três edições preservaram o movimento e a composição originais. Apenas o estilo visual mudou. O ciclo de caminhada do personagem permaneceu idêntico. O movimento da câmera não se alterou.

Isso é útil para apresentações a clientes onde você quer mostrar opções de conceito sem regenerar toda a cena três vezes. Também é útil para testes A/B de criativos de anúncios sem gastar créditos de geração.

Tentei o mesmo fluxo de trabalho com regeneração em vez de edição — escrevendo três prompts diferentes com palavras-chave de estilo incorporadas. Dois dos três retornaram com timing de movimento ligeiramente diferente, o que comprometeu a comparação. A edição manteve tudo comparável, exceto a variável de estilo que estava sendo testada.

Comparação de custos: editar vs. regenerar

Com base na análise de custos da WaveSpeedAI, a edição baseada em instruções provavelmente terá um perfil de custo diferente da geração padrão, mas os preços exatos ainda não foram publicados.

Do ponto de vista do fluxo de trabalho, mesmo que a edição custe o mesmo por segundo que a geração, ainda é mais barata na prática porque você não está descartando tentativas fracassadas. Uma geração mais uma edição direcionada supera três regenerações completas.

O cálculo: se a geração custa $0,12/segundo para 1080P (preço do WAN 2.6 da PiAPI), um clipe de 5 segundos custa $0,60. Três regenerações custam $1,80. Uma geração mais uma edição — mesmo que a edição custe o mesmo $0,60 — custa apenas $1,20. Isso representa uma economia de 33% só pela redução do desperdício.

Se a edição acabar sendo mais barata que a geração (o que parece provável, já que ela modifica quadros existentes em vez de criar novos do zero), a economia se multiplica.

Implicações do Acesso à API

Endpoint separado ou flag de parâmetro?

A análise da WaveSpeedAI sugere que a edição por instrução exigirá novos campos no payload — provavelmente um parâmetro edit_instruction e possivelmente um endpoint distinto.

Estou aguardando a documentação oficial da API antes da integração em produção.

Custo de token e computação

A inferência com múltiplas entradas é mais pesada que a geração com entrada única. A edição por instrução processa tanto o vídeo de origem quanto a instrução de edição, o que implica maior custo computacional.

Planeje o orçamento adequadamente, mas não finalize as projeções até que os preços sejam divulgados.

Considerações sobre jobs assíncronos

Todas as operações do WAN são executadas de forma assíncrona. Envie a solicitação, obtenha o ID da tarefa e faça polling até que seja concluída.

Tempo de espera esperado com base nos meus testes: de 30 segundos a 2 minutos para uma edição de 5 segundos em 1080P.

FAQ

A edição baseada em instruções está disponível via API WaveSpeed no lançamento?

O WAN 2.7 é lançado em março de 2026. A disponibilidade da API para edição por instrução ainda não foi confirmada. A WaveSpeedAI normalmente adiciona novos endpoints em poucos dias após os lançamentos oficiais.

Qual o comprimento máximo do vídeo de origem para edição?

Até 15 segundos em 1080P. Clipes mais curtos (de 2 a 5 segundos) são processados mais rapidamente e produzem edições mais limpas.

A edição preserva o áudio original? Depende da edição. Mudanças de fundo preservam o áudio. Mudanças de estilo que alteram a estética visual às vezes afetam a sincronização. Vale testar caso a caso.

Posts Anteriores:

- Descubra como funciona a edição por instrução em linguagem natural no WAN 2.7

- Veja as principais diferenças entre o WAN 2.7 e o WAN 2.6, especialmente para edições leves baseadas em instruções

- Aprenda formas práticas de combinar a edição baseada em instruções com o controle de primeiro/último quadro

- Explore os novos recursos do WAN 2.7, incluindo edição de vídeo baseada em instruções e caminho de atualização da API

- Entenda casos de uso de produção reais e benefícios de iteração da edição por instrução no WAN 2.7