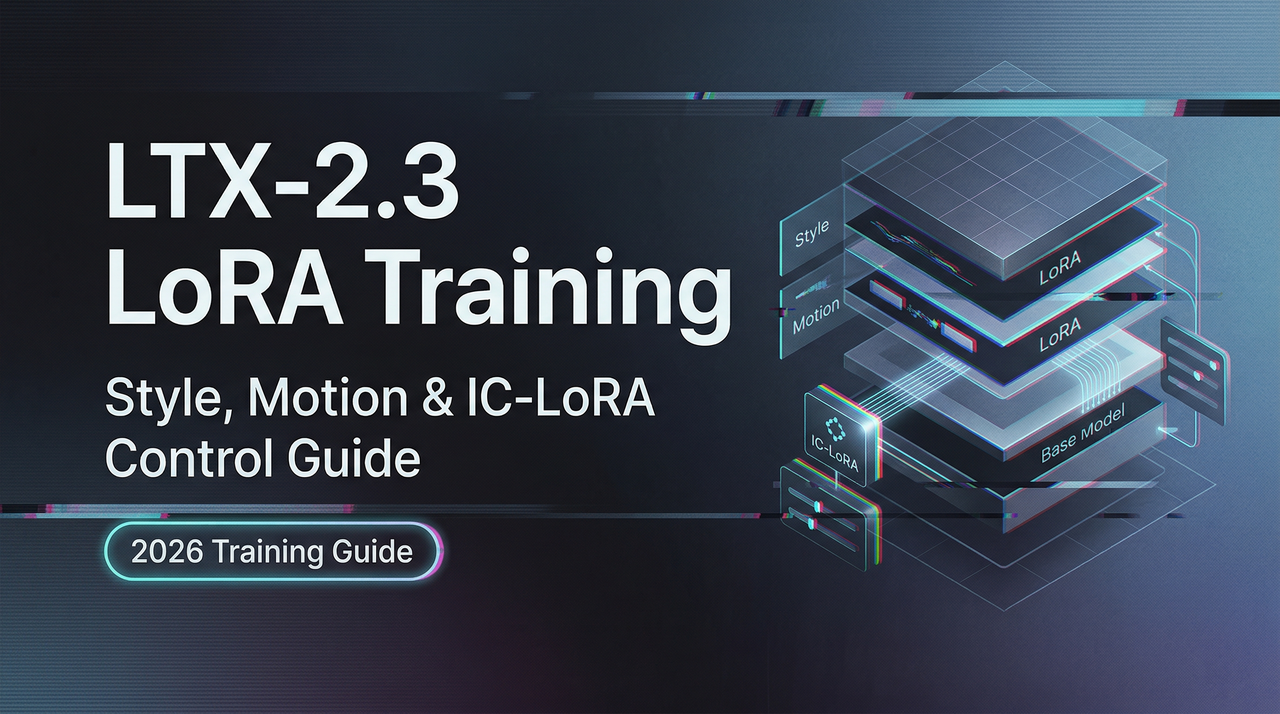

Guia de Treinamento de LoRA para LTX-2.3: Controle de Estilo, Movimento e IC-LoRA (2026)

Treine LoRAs personalizados no LTX-2.3 usando o ltx-trainer oficial. Aborda LoRAs de estilo, controle estrutural IC-LoRA, configurações de rank, preparação de dataset e falhas comuns de treinamento.

Ei, meu amigo. Aqui é a Dora.

Eu não planejava passar uma semana treinando LoRAs. Eu só precisava que uma demo de produto seguisse um padrão de movimento específico, e os prompts de texto não estavam dando conta. Essa pequena fricção me levou pelo caminho do treinamento do LTX-2.3, e o que encontrei me surpreendeu — não por ser revolucionário, mas por ser silenciosamente prático quando você sabe quais configurações realmente importam.

Isso não é um guia completo. É o que aprendi testando fluxos de trabalho de estilo, movimento e controle IC-LoRA em março de 2026.

O Que o Treinador Oficial do LTX-2.3 Inclui

O repositório LTX-2 no GitHub está organizado como um monorepo com três pacotes: ltx-core para implementação do modelo, ltx-pipelines para fluxos de geração e ltx-trainer para ajuste fino de LoRA e IC-LoRA. As configurações de largura e altura devem ser divisíveis por 32, e a contagem de frames deve seguir a regra 8n+1 — ou seja, 1, 9, 17, 25 frames, e assim por diante.

Passei minha primeira rodada de treinamento ignorando isso. O treinador retornou erro, preenchi os frames manualmente e funcionou. É uma restrição pequena, mas vale saber desde o início.

Três Tipos de LoRA e Quando Usar Cada Um

LoRAs de Estilo (aparência, textura, cor)

LoRAs de estilo ensinam ao LTX-2.3 estéticas visuais — gradação de cor, tratamento de textura, humor da iluminação. Treinei um em fotografia de produtos com fundos brancos consistentes e sombras suaves. Para LoRAs de personagem ou estilo, 20-50 imagens geralmente são suficientes para obter bons resultados, embora para sujeitos muito específicos eu tenha chegado a 80-120 imagens.

Conjuntos de dados somente com imagens funcionam bem aqui. Para os meus primeiros LoRAs, usei frames estáticos em vez de clipes de vídeo — é mais simples de curar, e o modelo aprende a identidade sem precisar processar movimento.

LoRAs de Movimento / Efeito (movimentação, transformação)

LoRAs de movimento focam em como as coisas se movem, e não em como parecem. Panorâmicas de câmera, rotação de objetos, sequências de transformação. Esses precisam de clipes de vídeo curtos e coerentes, não de imagens estáticas. Testei um LoRA de movimento dolly-in com clipes de 15 segundos com enquadramento consistente, e o modelo captou o padrão de movimento em diferentes sujeitos.

Treinar movimento pareceu menos estável do que estilo. Mais tentativas, resultados mais variáveis.

IC-LoRAs (controle estrutural: profundidade, pose, borda canny)

IC-LoRA é diferente. Em vez de ensinar ao modelo uma nova estética ou movimento, ele condiciona a geração a sinais de referência — mapas de profundidade, esqueletos de pose, detecções de borda. IC-LoRA permite condicionar a geração de vídeo em frames de vídeo de referência no momento da inferência, possibilitando controle fino de vídeo-para-vídeo sobre o modelo base de texto-para-vídeo.

Usei o IC-LoRA de profundidade para travar o movimento da câmera enquanto mudava completamente o conteúdo visual. O guia oficial de IC-LoRA explica bem os três modos de controle: Canny para preservação de bordas, Depth para câmera e geometria espacial, Pose para transferência de movimento humano.

Regras de Preparação de Dataset

Restrição de Contagem de Frames (regra 8n+1)

A contagem de frames deve ser divisível por 8 + 1. Isso não é uma diretriz flexível — se seus clipes têm 10 ou 15 frames, o treinador vai retornar erro ou preenchê-los internamente. Processei meu dataset em lote para 17 frames (2 × 8 + 1) antes de enviar, e o treinamento ocorreu sem problemas.

Divisibilidade de Resolução (regra de 32px)

Largura e altura devem ser divisíveis por 32. Aprendi isso depois de redimensionar um lote para 1024×576 e ver o treinador preencher silenciosamente para 1024×608. É melhor redimensionar corretamente desde o início.

Datasets de Vídeo vs Imagem: Quando Usar Cada Um

Conjuntos de dados somente com imagens são válidos para treinamento de LoRA no LTX-2.3. Isso é muito mais fácil do que forçar o aprendizado de movimento muito cedo, especialmente para LoRAs de identidade ou estilo. Comecei cada projeto com imagens estáticas, validei a aparência e depois adicionei clipes curtos de vídeo se o movimento fosse importante.

Para trabalhos com muito movimento, clipes curtos e coerentes ainda superam segmentos longos com múltiplas cenas.

Configurações Básicas de Treinamento

Rank 32 como Padrão Correto e Quando Aumentar

Para o LTX-2.3, rank 32 é o padrão correto. Geralmente oferece capacidade suficiente sem tornar o LoRA rígido demais cedo. Testei rank 64 em um LoRA de estilo complexo e vi melhoria mínima — a capacidade extra não ajudou porque meu dataset não era grande ou diverso o suficiente para preenchê-la.

Ponto de Partida da Taxa de Aprendizado e Quando Alterá-la

Para treinamento de LoRA no LTX-2.3, 1e-4 é o lugar certo para começar. Este é um desses casos em que a resposta simples é a resposta certa. Não mexi na taxa de aprendizado nos meus primeiros quatro LoRAs, e todos eles convergiram bem.

Contagem de Passos: Como Saber Quando Parar Cedo

Muitos usuários perdem tempo indo diretamente para contagens altas de passos antes de verificar se o checkpoint 250, 500 ou 750 já parece bom. Verifico no checkpoint 500 e, se o LoRA já parece forte, paro ali. Se um LoRA já parece forte no checkpoint 750 ou 1000, continuar muito além pode apenas torná-lo mais frágil.

O sobreajuste se manifesta quando o modelo começa a memorizar os dados de treinamento em vez de generalizar. As amostras de validação começam a parecer idênticas aos frames de treinamento.

IC-LoRA: Controle de Profundidade, Pose e Borda

Como o IC-LoRA Difere do LoRA de Estilo Padrão

O IC-LoRA separa o movimento do estilo visual. Você orienta a aparência com texto e LoRAs de estilo, e orienta o movimento com guias estruturados. O modelo de controle union IC-LoRA do LTX-2.3 suporta múltiplos sinais de controle — profundidade, pose, borda — em um único adaptador.

Executei o IC-LoRA de profundidade em uma sequência de giro de produto. O trajeto da câmera ficou travado no mapa de profundidade de referência, mas o conteúdo visual mudou completamente com base no meu prompt.

Integração do Fluxo de Trabalho IC-LoRA no ComfyUI

O fluxo de trabalho RunComfy LTX 2.3 IC-LoRA lida automaticamente com extração de profundidade, pose e borda. Carregue um clipe de referência, escolha um modo de controle, escreva um prompt focado em estilo, e o modelo cuida do movimento separadamente.

Um detalhe que perdi no início: mantenha os prompts focados na aparência porque o IC-LoRA cuida do movimento e da estrutura. Tentar descrever o movimento da câmera no prompt enquanto o IC-LoRA o está controlando cria conflito.

Falhas Comuns de Treinamento e Correções

LoRA Vazando Para Tudo (Solução DOP)

DOP (Dropout de Prompts) é a primeira opção avançada que vale usar quando um LoRA começa a vazar para tudo. Treinei um LoRA de estilo de produto que funcionava bem em itens similares, mas começou a afetar sujeitos não relacionados. Adicionar abandono de legenda ajudou o LoRA a generalizar.

Sobreajuste com Contagens Altas de Passos

Não trate mais passos como uma melhoria universal de qualidade. Executei um LoRA de movimento até 2.000 passos e vi ele começar a reproduzir frames exatos de treinamento em vez de aprender o padrão subjacente. Voltei ao checkpoint 750.

Conflito entre Abandono de Legenda e Cache de Embeddings de Texto

Se o abandono de legenda estiver sendo usado, o Cache de Embeddings de Texto deve permanecer DESATIVADO. Esta é uma das poucas configurações pequenas que pode silenciosamente piorar o comportamento do treinamento se usada incorretamente. Habilitei ambos uma vez e obtive resultados inconsistentes — o modelo não conseguia decidir se deveria depender dos embeddings em cache ou lidar com legendas ausentes.

Verificando Seu LoRA Antes da Implantação

Realizo três testes de validação antes de considerar um LoRA pronto: mesmo prompt com e sem o LoRA para confirmar que ele está adicionando o que espero, prompts variados para verificar a generalização, e casos extremos que não estavam no conjunto de treinamento. Se o LoRA só funciona em prompts que se aproximam muito das legendas de treinamento, está sobreajustado.

Perguntas Frequentes

Posso treinar LoRAs em A100 ou GPUs menores?

O treinamento do LTX-2.3 tem como alvo oficial GPUs Nvidia H100 com 80GB+ de VRAM, embora configurações com menos VRAM possam funcionar com verificação de gradiente e resoluções reduzidas. Não testei o treinamento em A100 pessoalmente, mas a documentação oficial do treinador menciona isso como a linha de base de hardware recomendada.

Quanto tempo leva para treinar um LoRA de estilo na H100?

Cerca de 3-5 horas por LoRA em uma única 4090 para datasets de tamanho médio, incluindo validação e pequenas reinicializações, de acordo com relatos de campo. H100 deve ser mais rápida, embora eu não tenha números diretos.

LoRAs do LTX-2 funcionam no LTX-2.3 sem retreinamento?

Não. O LTX-2.3 vem com um VAE completamente redesenhado treinado em dados de maior qualidade, e a arquitetura do conector de texto foi alterada. LoRAs antigos do LTX-2 não transferem bem — testei isso e obtive artefatos visuais.

O IC-LoRA pode ser combinado com LoRAs de estilo?

Sim. Você pode empilhar até três adaptadores LoRA simultaneamente, mesclando estéticas personalizadas com controle estrutural. Executei um LoRA de estilo antes do carregador IC-LoRA e mantive seu peso moderado para que o IC-LoRA pudesse manter geometria e temporização.

O treinamento de LoRA está disponível via plataformas em nuvem?

Sim. O RunComfy AI Toolkit e o fal.ai oferecem treinamento baseado em navegador sem gerenciar infraestrutura de GPU. Envie seu dataset, configure os parâmetros e baixe o LoRA quando estiver pronto.

Treinar LoRAs para o LTX-2.3 não é mágica. É preparação de dataset, configurações básicas e saber quando parar cedo. A regra de frame 8n+1 e a restrição de divisibilidade por 32px parecem arbitrárias no início, mas são apenas os requisitos de geometria do modelo. Trabalhe com eles, não em torno deles.

O que me surpreendeu não foi a complexidade — foi quanto tempo economizei ao manter o rank 32 e a taxa de aprendizado 1e-4 em vez de ajustar todos os parâmetros na primeira rodada.

Posts Anteriores: