Configuração do LTX-2.3 no ComfyUI: Pipeline em Dois Estágios, Correções de VRAM e Encoder Gemma

Configure o LTX-2.3 no ComfyUI: posicionamento de checkpoint, configuração do encoder Gemma 3 12B, o pipeline de geração em dois estágios e estratégias para VRAM reduzida em GPUs para consumidores.

Olá, pessoal. Sou a Dora. Vocês sabem que eu não planejava mudar. Minha configuração do LTX-2 no ComfyUI estava funcionando bem, e não sou fã de “novo só porque sim.” Mas semana passada (março de 2026), fiquei vendo pequenas notas sobre o LTX-2.3: melhor coerência, novo codificador de texto (Gemma 3 12B) e um caminho em dois estágios que prometia imagens mais nítidas sem destruir a VRAM.

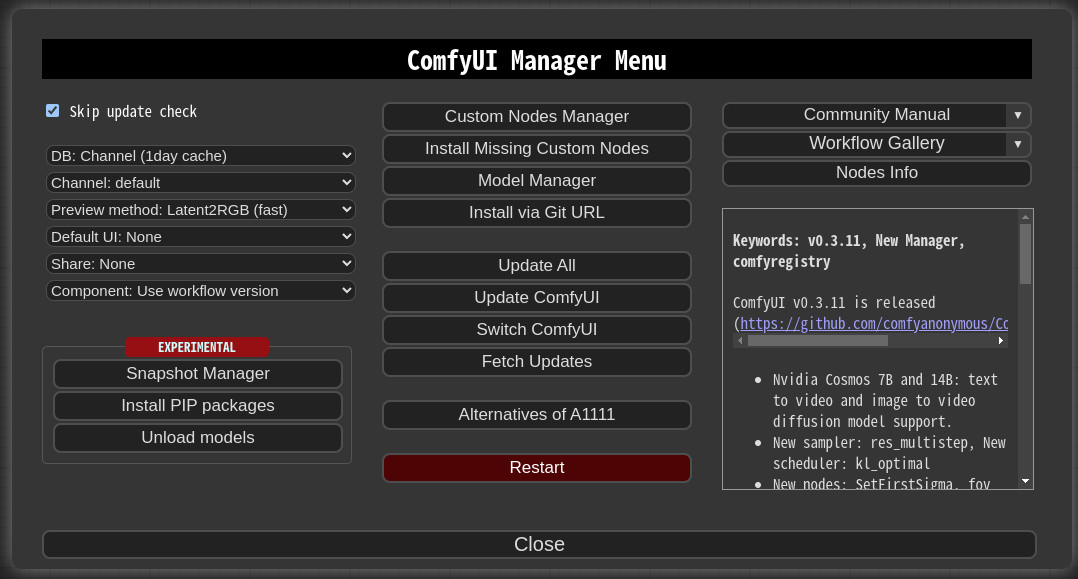

Abri uma manhã tranquila e migrei meu fluxo de trabalho. Aqui está o que realmente mudou para mim, onde encontrei obstáculos, e os pontos que tornaram o trabalho mais leve. Se você está procurando as etapas de instalação: elas estão aqui, mas as partes úteis são as trocas que percebi enquanto construía um fluxo de trabalho LTX-2.3 ComfyUI dia a dia.

O que é Diferente no LTX-2.3 no ComfyUI (vs configuração LTX-2)

O LTX-2.3 ComfyUI parece um empurrão em direção à confiabilidade, e não um salto. O modelo espera o Gemma 3 12B como seu codificador de texto, e o caminho recomendado é um pipeline de dois estágios: gerar na metade da resolução para coerência base, depois aumentar os latentes com um amostrador específico do LTX. Na prática, isso mudou duas coisas para mim:

- Os prompts se mantiveram mais coesos com passos modestos. Notei menos detalhes “embaralhados” quando ficava entre 25–35 passos no Estágio 1.

- A VRAM foi menos instável do que eu temia, contanto que eu respeitasse os limites entre estágios e não tentasse forçar a resolução completa de uma vez.

Também percebi que os nós antigos do LTX-2 funcionaram em sua maioria, mas o LTX-2.3 prefere seus próprios nós de amostrador/amostrador de latentes. Trocar apenas o checkpoint não foi suficiente. Foi aí que tropecei pela primeira vez.

Arquivos Necessários e Estrutura de Pastas

Aqui está a configuração que cheguei depois de algumas tentativas frustradas. Não é sofisticada: é o mínimo que fez as caixas de erro vermelhas pararem.

Opções de Checkpoint (dev / fp8 / distilled + distilled LoRA)

- dev: Bom para experimentar. Um pouco mais pesado, mas achei mais tolerante quando os prompts se desviavam.

- fp8: Mais leve na VRAM. Na minha placa de 12GB, o fp8 me deixou manter batch size 1 sem OOM durante o decode. Pequena queda de qualidade, nada dramático para ativos sociais ou de marketing.

- distilled + distilled LoRA: Saídas mais limpas para fotos com aparência de produto nos meus testes, mas você precisa lembrar de carregar o LoRA e definir um peso (0.6–0.8 funcionou para mim). Sem o LoRA ativo, os resultados pareciam mais próximos do dev.

Todos os checkpoints ficavam em ComfyUI/models/checkpoints. Mantive os LoRAs em ComfyUI/models/loras e os nomeei com o mesmo nome base do checkpoint para encontrar o par rapidamente.

Codificador de Texto Gemma 3 12B: Download e Posicionamento

O LTX-2.3 espera o codificador de texto Gemma 3 12B. Dependendo da sua pilha de nós, você usará um peso PyTorch ou um arquivo GGUF (para nós com suporte a llama.cpp). Tentei os dois.

- Rota PyTorch: colocado em ComfyUI/models/clip (alguns nós detectam automaticamente aqui). Se o seu nó pedir uma pasta diferente, siga a documentação, não tente forçar.

- Rota GGUF: colocado em ComfyUI/models/llm (ou uma pasta text_encoders específica do nó). Q4_K_M foi o ponto ideal para mim: Q3 economizou mais memória, mas perdeu alguma nuance em prompts longos.

Em caso de dúvida, abra a ajuda ”?” do nó ou o README. O nome da pasta importa.

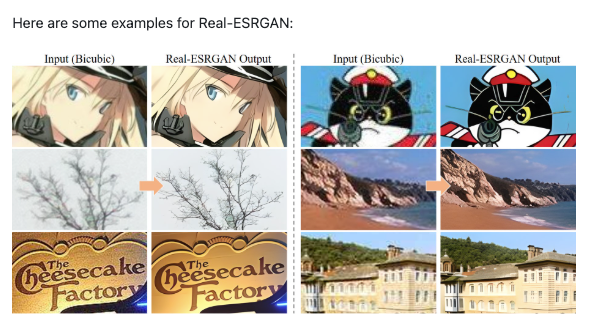

Modelos de Upscaler: Quando Incluí-los

Você não precisa de um upscaler de imagem externo se estiver usando o amostrador de latentes LTX. Dito isso, mantive um 4x ESRGAN e um upscaler de latentes SDXL x2 em ComfyUI/models/upscale_models para imagens não-LTX. Para o LTX-2.3, o LTXVLatentUpsampler integrado foi melhor que o ESRGAN para bordas e formas semelhantes a texto.

O Pipeline de Dois Estágios Explicado

Fiquei tentando pular o Estágio 1. Isso foi um erro. O caminho de dois estágios acabou sendo mais simples de entender e mais gentil com a VRAM.

Estágio 1, Coerência Base na Metade da Resolução

Gero na metade do tamanho alvo (ex.: 640×384 para um final de 1280×768). Este estágio define a composição e os detalhes do sujeito. 25–35 passos, CFG modesto (4–6), batch size 1. Se algo está errado — mãos, layout, dominante de cor — é mais barato corrigir aqui.

O que notei: menos “desvios” quando simplifiquei os prompts e usei no máximo uma ou duas âncoras de estilo. O LTX-2.3 parece recompensar linguagem focada.

Estágio 2, Upscaling de Latentes para Nitidez (LTXVLatentUpsampler)

Então passo os latentes do Estágio 1 para o LTXVLatentUpsampler. Isso afina as bordas e restaura detalhes finos sem refazer a composição. Normalmente executo 15–20 passos para o upsampling. Não é um apagador mágico: se a base estiver errada, o amostrador só torna o erro mais nítido.

Dev + Distilled LoRA vs Full Distilled: Qual Usar

- Dev + Distilled LoRA: Meu padrão quando estou explorando uma aparência. Ligeiramente mais flexível. Defino a intensidade do LoRA em torno de 0.7 e ajusto se as texturas parecerem sobreajustadas.

- Full Distilled: Quando preciso de saídas rápidas e consistentes para um lote. É mais exigente com os prompts, mas economiza energia mental — menos surpresas de execução para execução.

Se você se sentir travado, tente dev para o Estágio 1 (mais solto) e distilled para o Estágio 2 (mais rígido). Essa combinação salvou um conjunto de retratos com clima pesado para mim.

Configuração do Codificador Gemma 3 12B: Gerenciamento de VRAM

O Gemma 3 12B foi o principal motivo pelo qual eu esperava dificuldades. Não foi tão ruim, mas precisa de proteções.

Descarregando o Codificador para CPU/RAM Quando a VRAM Está Apertada

Em uma placa de 12GB, descarreguei o codificador Gemma para a CPU durante o passo de texto. Adicionou alguns segundos por execução, mas evitou OOM durante o Estágio 1. Se o seu nó suportar carregamento em dispositivo misto, defina as camadas de atenção para GPU e o restante para CPU. A sensação: não é mais rápido, mas mais calmo — sem travamentos no meio de uma ideia.

Flag —novram e Outras Correções de Inicialização

Se você estiver iniciando o ComfyUI com flags de comando, —novram ajudou a suavizar os picos de memória durante as trocas de modelo. Também:

- Desativei “keep loaded” em modelos grandes entre execuções de teste.

- Defini torch.set_grad_enabled(False) em um pequeno init personalizado (se a sua configuração permitir) para evitar gradientes desnecessários.

- Usei redes de segurança menores: checkpoints de 16 bits ou fp8 quando sabia que empilharia LoRAs.

Estratégias para VRAM Baixa em GPUs de Consumidor (12GB / 16GB / 24GB)

O que funcionou em três máquinas que testei (RTX 3060 12GB, 4070 12GB e 4090 24GB):

Modelos GGUF Quantizados: Trocas entre Q3 e Q4

- Q3: Menor memória, mais rápido para carregar, mas perdi nuance no prompt e vi mais repetição nos descritores.

- Q4: Ligeiramente mais pesado, coerência visivelmente melhor. Minha escolha para placas de 12–16GB. Para 24GB, pulo a quantização ou uso Q5 se disponível.

Descarregamento do VAE para Reduzir Picos de Memória

A decodificação é onde encontrei OOM com mais frequência. Descarregar o VAE para a CPU ou usar um VAE mais leve reduziu os picos no final do Estágio 2. Em 12GB, também defini a decodificação final para imagem única (sem lotes) mesmo que nós anteriores fizessem lotes — menos drama.

Outros ganhos pequenos:

- Mantenha a resolução modesta no Estágio 1: faça o upscale depois.

- Evite empilhar múltiplos truques de orientação. Um CFG, um LoRA de cada vez.

Erros Comuns na Primeira Execução e Correções

Encontrei as usuais caixas vermelhas. Estas foram as correções que ficaram.

Erros de Nós Faltando Após Carregamento

Se o ComfyUI não conseguir encontrar os nós do LTX-2.3, atualize seu repositório de nós personalizados e reinicie. Alguns nós LTX também exigem um núcleo ComfyUI mais recente. Corrigi um erro persistente excluindo a pasta de cache do nó e deixando-a reconstruir na inicialização.

OOM Durante a Decodificação

Dois controles ajudaram imediatamente: troque o checkpoint para fp8 ou descarregue o VAE para a CPU. Também reduza o lote do último estágio para 1. Se ainda estiver travando, reduza pela metade a resolução alvo e deixe um upscaler de imagem externo terminar o trabalho.

Crash do Codificador Gemma

Isso geralmente significava incompatibilidade de pasta ou um arquivo de quantização que o nó não gostou. Fiz o download novamente do Gemma 3 12B da fonte listada no README do nó, verifiquei o checksum e o coloquei onde o nó espera (clip vs llm). Q4 funcionou: Q3 às vezes falhava ao carregar no meu 4070 até que eu atualizei para a build mais recente com suporte a llama.cpp.

Perguntas Frequentes

Os nós LTX-2.3 do ComfyUI precisam ser instalados separadamente?

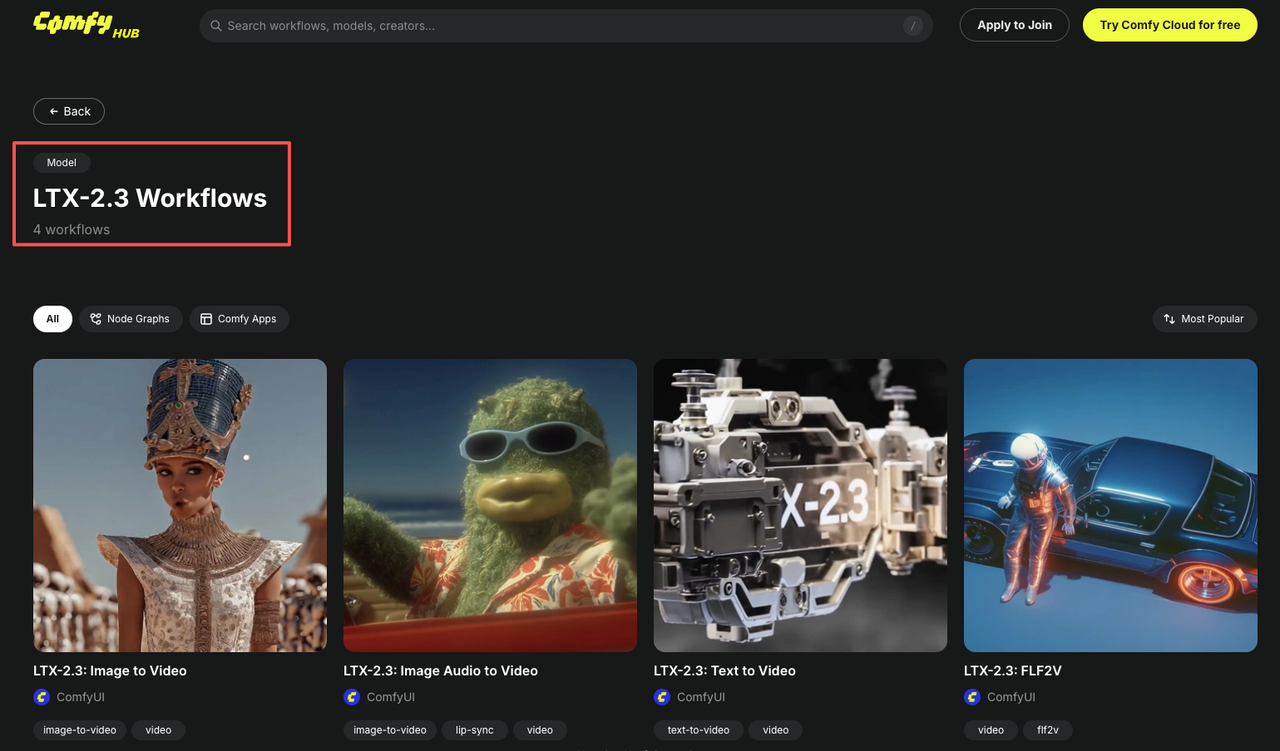

Geralmente sim. Atualizar apenas o modelo não é suficiente. Baixe o repositório de nós LTX mais recente e reinicie o ComfyUI para que ele registre os novos amostradores e o amostrador de latentes.

Posso usar fluxos de trabalho LTX-2 existentes com checkpoints LTX-2.3?

Parcialmente. Consegui reutilizar o layout, mas tive que trocar pelo amostrador LTX-2.3 e pelo LTXVLatentUpsampler, e apontar os prompts para o Gemma 3 12B. Depois disso, a maioria dos controles funcionou.

Qual é a VRAM mínima para executar o LTX-2.3 no ComfyUI?

Consegui execuções de imagem única funcionais em 12GB com fp8 ou GGUF Q4 para o codificador, Estágio 1 na metade da resolução e VAE descarregado. Fica mais suave em 16GB. Em 24GB, você pode ficar no PyTorch e se mover mais rápido.

O pipeline de dois estágios é mais rápido ou mais lento que o de estágio único?

O tempo total pode ser semelhante, mas parece mais leve. Passo menos tempo refazendo erros em resolução completa. O Estágio 1 solidifica a ideia: o Estágio 2 a refina. Em uma placa de 12GB, também é a diferença entre criar e travar.

Não fiquei “animado” com o LTX-2.3 ComfyUI. Mais aliviado. As imagens ficaram como pedi mais cedo, e o fluxo de trabalho parou de brigar com a VRAM. Vou manter o caminho de dois estágios por perto. É tranquilo, e funciona.

Posts Anteriores: