Guia da API LTX-2.3: 7 Endpoints, Opções de Acesso e Uso em Produção

O LTX-2.3 oferece 7 endpoints: texto para vídeo, imagem para vídeo, áudio para vídeo, extensão e retomada (variantes padrão e rápida). Este guia aborda cada modo e as opções de acesso à API gerenciada.

Olá, sou a Dora. Uma pequena frustração me levou à API do LTX-2.3 semana passada: eu ficava recriando os mesmos planos explicativos de 6 a 10s manualmente. Nada dramático — apenas o cansaço de fazer a mesma coisa repetidamente. Eu tinha visto menções a variantes “rápidas” e endpoints de “retake” circulando por aí, então separei algumas manhãs em março de 2026 para testar a API do ltx-2.3 no trabalho real. Sem alarde. Apenas alguns prompts, mockups de produtos e uma intro de podcast que eu estava sendo excessivamente cuidadosa.

O que se segue não é um tour pelos recursos. É como os endpoints da API do ltx-2.3 se comportaram para mim, o que acelerou as coisas e onde as limitações ainda aparecem.

Os 7 Endpoints do LTX-2.3 em Resumo

Este é o mapa mental que acabei usando depois de uma semana de testes. A coisa principal que percebi: esses não são “recursos” separados — são controles em uma sequência. Frequentemente eu esboçava com text-to-video rápido, fixava os prompts, depois mudava para o padrão, ou iniciava um clipe de image-to-video e o estendia para ajustar o timing. A plataforma disponibiliza tudo isso através de um design de API REST padrão, o que impediu o fluxo de trabalho de se fragmentar entre abas.

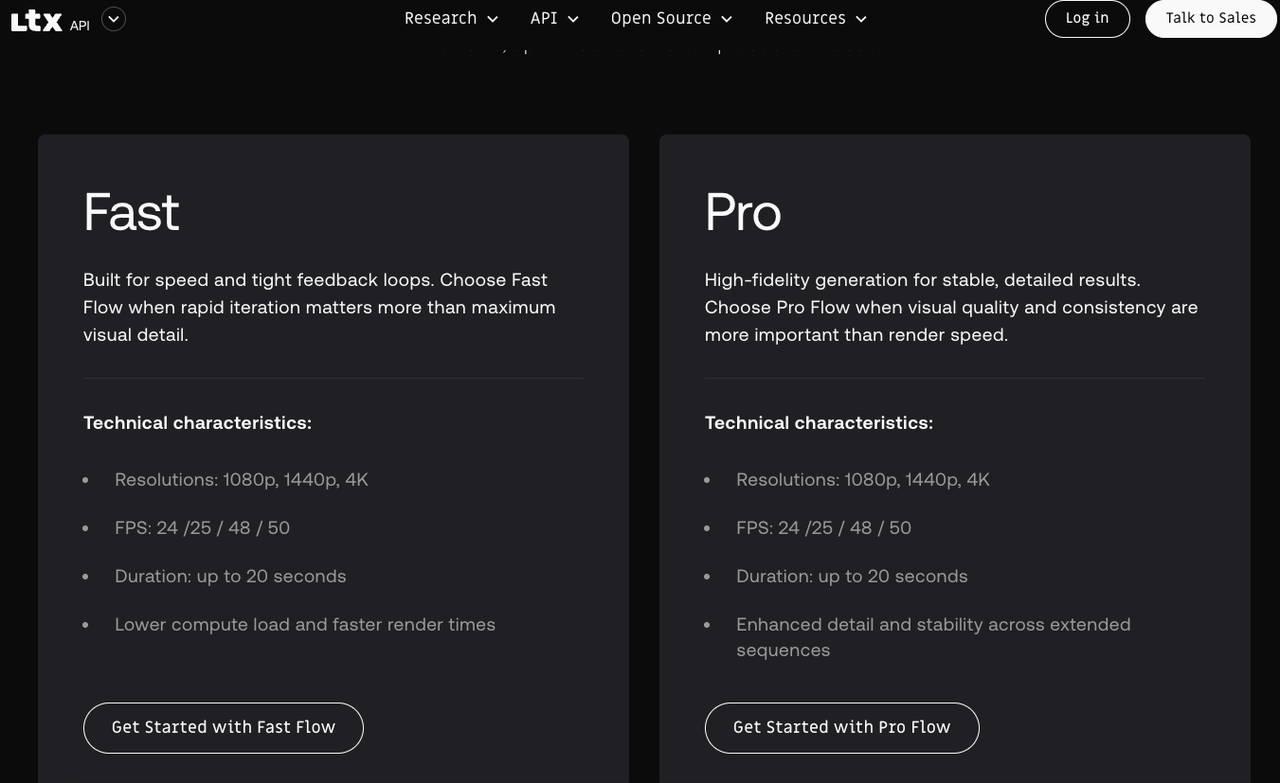

- Text-to-Video (padrão): o passe de qualidade. Mais lento, melhor consistência de movimento, texturas mais limpas. Eu recorria a esse quando o plano importava e eu podia esperar.

- Text-to-Video (rápido): o explorador. Leituras rápidas sobre enquadramentos e ideias de movimento, útil para moldagem de prompts e ideação em lote.

- Image-to-Video: anima um único quadro. Se eu queria que um logotipo aparecesse ou que um mockup “respirasse” na tela, esse dava conta sem desviar demais.

- Audio-to-Video: condicionamento de movimento com uma trilha de áudio. Não é mágica de lip-sync — é mais como dar ao modelo um metrônomo.

- Extend-Video: acrescenta mais segundos ao final. A continuidade é razoável se os prompts e seeds estiverem estáveis.

- Retake-Video: regenera um segmento com as restrições mantidas. Útil para corrigir uma mão tremida ou movimento de câmera estranho sem começar do zero.

- System/Utility: monitoramento de jobs. Não é glamoroso, mas é necessário.

Text-to-Video: Trade-offs entre a Variante Padrão e a Rápida

Fiquei alternando entre as duas o tempo todo. A distinção é simples no papel — velocidade vs qualidade — mas aparece em especificidades que importam quando você está entregando algo.

- A versão rápida rodou 2 a 4× mais veloz por clipe em hosts gerenciados. Ótima para esboços e para definir uma direção — não tão boa para texturas finas ou tipografia pequena.

- A versão padrão reduziu as “bordas derretidas” em mãos e o tremor de micro-movimento, e manteve a direção da iluminação de forma mais consistente entre os quadros.

- Em prompts com muito conteúdo (multidões, água, folhagem), o padrão lidou melhor com ruído temporal. A versão rápida às vezes parecia boa na primeira visualização, mas ficava “agitada” quando cortada ao lado de filmagens reais.

A verdade sem graça: economizei mais tempo alternando as variantes no momento certo do que ajustando qualquer configuração isolada.

Parâmetros Principais e Orientações de Prompt

Alguns parâmetros realmente fizeram diferença:

- Duração e frames: Mais curto é mais gentil. 4 a 8s a 16–24 fps foi o ponto ideal para movimento estável e tempos de fila razoáveis.

- Seed: Fixe-o assim que uma direção parecer certa. Os seeds tornaram os retakes e extensões muito menos caóticos.

- Guidance/CFG: Mais baixo (4–6) deixou o modelo respirar; mais alto (7–9) fixou o estilo, mas aumentou a uniformidade entre quadros.

- Indicações negativas: Aponte-as para o movimento, não apenas para os visuais — “evite zooms rápidos,” “sem câmera girando,” “tripé estável.” Isso conteve os movimentos bruscos mais do que descrever objetos.

Estrutura de prompt que funcionou de forma confiável: uma frase para cena e sujeito, uma para câmera e movimento, uma para luz e textura. Parei de acumular adjetivos assim que percebi que eles brigam entre si.

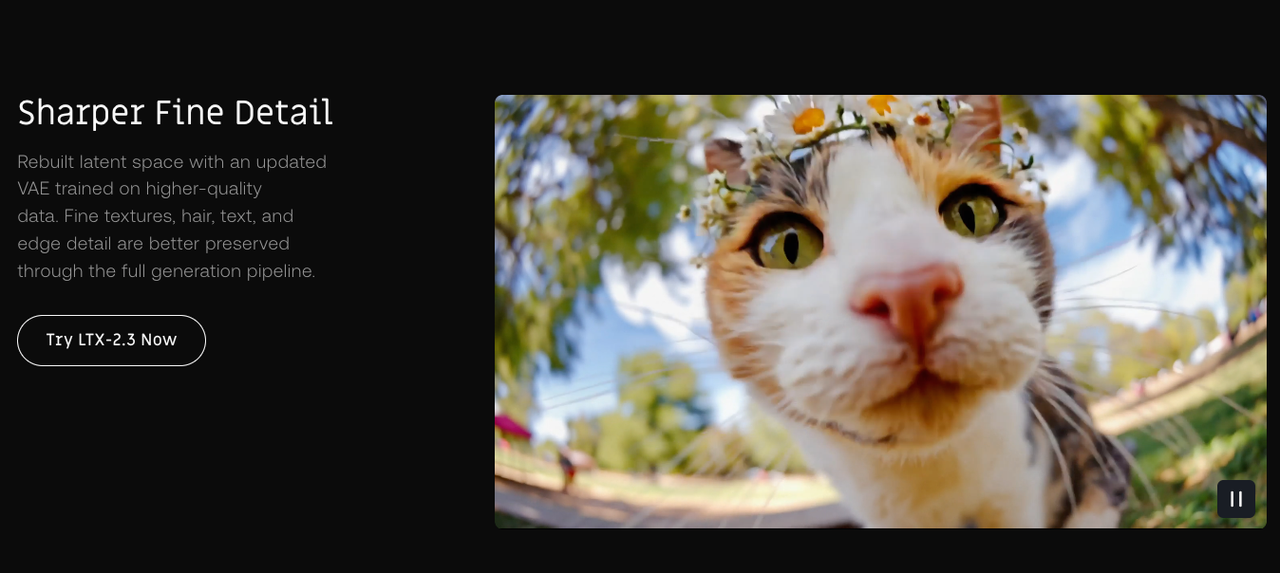

Image-to-Video: Especificações de Entrada e Riscos de Artefatos

Usei principalmente para animar imagens estáticas — mockups de UI, frames de destaque de produtos, marcas simples. A entrada gostava de fontes limpas: PNGs nítidos, sem borrão de compressão. Quadrado ou quase quadrado se comportou melhor.

- Notas suaves de câmera (“paralaxe sutil, leve balanço manual”) criaram vida sem rasgar a imagem.

- Mantenha as camadas de texto grandes — rótulos de UI pequenos viraram sopa em movimento. Coloquei o texto crítico como sobreposições no pós-produção.

- Arte com linhas finas tremelicou nas bordas. Um leve pré-processamento com desfoque ajudou.

- Logotipos permaneceram legíveis se eu evitasse rotações rápidas. Para revelações, deixei o modelo fazer uma inclinação de 10–15°, depois cortei.

Se um artefato aparecer no frame 1–2, ele geralmente persiste. Regenere com um novo seed antes de tentar corrigir no pós.

Audio-to-Video: Como o Condicionamento Realmente Funciona

Entrei esperando lip-sync. Não é isso que esse endpoint faz. Pense em ritmo, energia e indicações amplas de movimento. Com trilhas de bateria, o modelo captou os tempos fortes como suaves movimentos de câmera. Com áudio ambiente, desacelerou — menos agitação, mais deriva.

Na prática, tratei o áudio como um mapa de tempo. Para uma base ambiente de 20s, cortei dois clipes de 8s e um de 4s, cada um condicionado na mesma trilha, depois escolhi o melhor para continuidade. Até ruídos de baixa frequência moldaram o movimento — se você não quer que a câmera “respire” em cada batida de baixo, adicione “sem pulsação rítmica de câmera” como prompt negativo.

Onde ajudou: bases de foley, ritmo musical para b-roll, correspondência de tom. Onde não ajudou: lip-sync, edições precisas no tempo, ou cenas de diálogo.

Extend e Retake: Construindo Sequências Mais Longas ou Corrigidas

Esses dois são vitórias silenciosas. Encadeei dois clipes de 6s em um plano de 12s estendendo o final do primeiro clipe com o mesmo prompt, seed e notas de câmera. A transição não foi perfeita, mas o ponto de corte ficou bem escondido sob uma pausa na trilha sonora. Se o primeiro quadro da extensão parecer errado — pare ali. Inícios ruins raramente se recuperam.

O Retake corrigiu uma panorâmica rápida que escapou nos últimos 2s de um clipe que era bom no restante. Mantive a orientação negativa sobre movimento, não sobre conteúdo, e precisei de 1 a 3 tentativas em média. Os dois endpoints se beneficiam de disciplina: fixe seed, duração e linguagem de câmera antes de perseguir micro-correções.

API Self-Hosted vs Gerenciada: Trade-offs

Experimentei um host gerenciado (interface estilo fal.ai) e uma máquina local por um dia. A API gerenciada vence quando você precisa de dez variantes rápido e não quer ficar monitorando drivers — mas os limites de taxa e custos por minuto somam em execuções mais longas. O self-hosting oferece custo marginal mais baixo e controle total de lotes, ao preço de fricção na configuração e dores de cabeça com drivers.

Uma heurística simples: uma dúzia de clipes exploratórios curtos — o gerenciado vence. Centenas de segundos com prompts fixos — o self-hosting começa a se pagar.

Para hardware, 24 GB de VRAM foi o piso confortável para clipes de 8 a 10s a 768p em março de 2026. A documentação do CUDA 12.x toolkit cobre os requisitos de driver se você estiver configurando uma máquina de inferência local — fixei os drivers para evitar lentidões surpresa.

Erros Comuns de API e Como Corrigi-los

- Dimensões incompatíveis: Alguns endpoints exigem dimensões divisíveis por 16. Se um job falhar instantaneamente, reduza para o múltiplo de 16 mais próximo.

- Prompts muito longos: Hosts gerenciados cortam ou expiram em payloads JSON muito longos. Mova listas de estilos para frases mais curtas; use negativos com moderação.

- Desvio de seed entre endpoints: Mudar de text-to-video para extend-video às vezes ignorava o seed se eu esquecia de passá-lo. Registre seed e cfg em cada requisição.

- Picos de limite de taxa: Espaçe submissões em lote em 200–300 ms ou use os cabeçalhos de concorrência recomendados pelo provedor.

FAQ

Qual é o comprimento máximo de clipe por chamada única de API?

A maioria dos hosts gerenciados limita a 4–10s em taxas de frames comuns para manter as filas saudáveis. Com self-hosting, cheguei a ~12–16s antes da qualidade cair. Para qualquer coisa mais longa, encadeie extensões com seeds compartilhados.

O quanto a qualidade difere entre as variantes rápida e padrão?

Perceptível, mas não é dia e noite. A versão rápida entrega 70–80% da aparência em uma fração do tempo. Se um clipe vai ficar ao lado de filmagem ao vivo, finalize na versão padrão.

É possível aplicar adaptadores LoRA via API gerenciada?

Depende do host. Alguns expõem presets de modelo ou adaptadores de estilo; outros mantêm o padrão. O hub de modelos do Hugging Face é o melhor lugar para verificar os slots de adaptadores disponíveis e ajustes finos da comunidade antes de se comprometer com um provedor. Localmente, você tem mais liberdade — mas também mais formas de quebrar as coisas.

E quanto a executar múltiplas modalidades com uma única chave de API?

A maioria das plataformas multi-modelo cobra por crédito e cobre endpoints de imagem e vídeo com a mesma chave. Vale verificar a página de preços do provedor antes de começar — a Especificação OpenAPI é uma referência útil para entender como uma documentação de API bem estruturada deve apresentar a cobertura de endpoints e o comportamento de cobrança.

Uma Nota sobre Padrões de Qualidade de Vídeo

Uma coisa que vale ter em mente: “alta qualidade” significa coisas diferentes em contextos diferentes. Para b-roll destinado às redes sociais, o modo rápido geralmente é suficiente. Para qualquer coisa cortada contra material de transmissão ou cinema, ajuda entender quais codecs e ciência de cores a entrega final exige. A biblioteca de padrões SMPTE é uma leitura árida, mas as especificações de base para taxa de frames, profundidade de bits e espaço de cor são relevantes se você estiver entregando clipes para um colorista ou uma casa de pós-produção.

Termino com uma pequena observação: quanto mais eu tratei esses endpoints como partes de um sistema — disciplina de seed, execuções curtas, linguagem de câmera consistente — menos lutei com eles depois. Não é mágica. Mas algumas regras simples tornaram o trabalho mais leve.

Posts Anteriores:

- Obtenha um guia passo a passo para integrar o WAN 2.7 ao seu fluxo de trabalho de API

- Compare WAN 2.7 vs WAN 2.6 para entender os trade-offs reais da atualização

- Aprenda como a edição de vídeo baseada em instruções funciona em pipelines de produção reais

- Veja como o controle de primeiro e último frame melhora a consistência na geração de vídeo

- Explore como os upscalers de vídeo com IA melhoram a qualidade de saída após a geração