Godmod3 AI Explicado: Chat Multi-Modelo Sem Restrições de Acesso

O Godmod3 permite executar mais de 50 modelos de IA em paralelo com uma única chave OpenRouter — sem instalação, sem servidor, sem conta. Veja o que isso significa na prática.

Construí um fluxo de trabalho em torno disso antes de entender completamente o que era. Geralmente é assim que acontece.

Na semana passada, eu estava em três abas abertas — Claude em uma, GPT-5 em outra, Gemini em uma terceira — copiando e colando o mesmo prompt em cada uma para descobrir qual modelo lidava melhor com uma comparação técnica detalhada. O atrito era evidente: três sessões de login, três painéis de parâmetros, três contas de faturamento, zero formato de saída padronizado. Sou Dora, que já fez esse tipo de avaliação entre modelos dezenas de vezes e mantém uma anotação no meu diário de trabalho: “o custo de troca é invisível até você estar fazendo isso cinquenta vezes por semana.” Aí ele se torna muito visível.

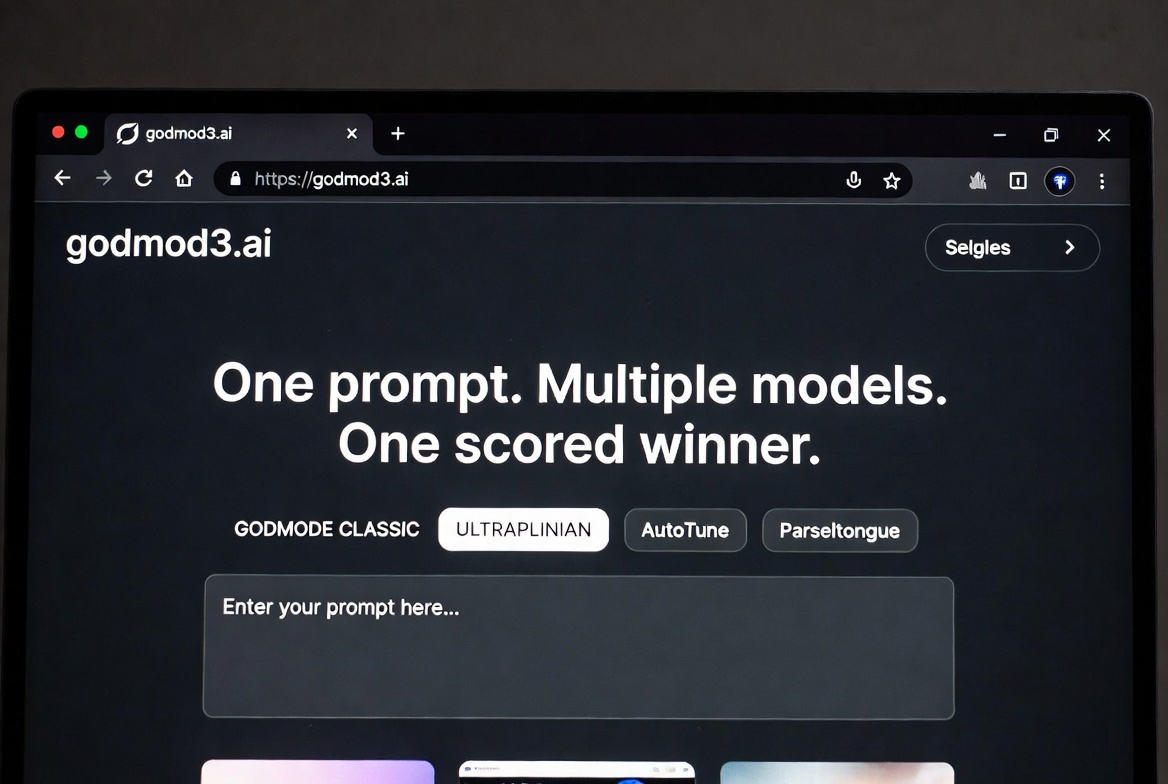

Esse é o problema que o godmod3.ai resolve. Um prompt. Múltiplos modelos. Um vencedor pontuado. Aqui está o que você realmente precisa saber antes de decidir se ele pertence ao seu fluxo de trabalho.

Godmod3 vs Sua Configuração Atual de Chat com IA

O problema de um único modelo: por que alternar abas entre ChatGPT e Claude não é suficiente

O problema não é que o ChatGPT ou o Claude sejam ruins. É que usar um modelo por vez te obriga a confiar no julgamento daquele modelo sem um ponto de comparação. Você digita um prompt, recebe uma resposta e ou aceita ou reformula. Você não sabe se outro modelo teria acertado na primeira tentativa.

Alternar abas para descobrir é lento. Cada plataforma tem suas próprias configurações de parâmetros, seu próprio comportamento de janela de contexto, sua própria forma de interpretar a mesma instrução. No momento em que você compara três saídas, gastou mais tempo no processo do que na tarefa em si.

O que o godmod3.ai oferece: um prompt, múltiplos modelos, um vencedor

O Godmod3 envia seu prompt para múltiplos modelos simultaneamente e retorna os resultados lado a lado. Em seu modo ULTRAPLINIAN, ele pontua as respostas em uma métrica composta de 100 pontos e apresenta automaticamente a resposta mais bem classificada. Você não está lendo por cinco abas — você está lendo o veredicto.

Toda a interface é uma aplicação de navegador de página única construída por Pliny (elder-plinius) sob a licença AGPL-3.0. Nenhum servidor backend é necessário para a versão hospedada básica. Sua chave de API permanece no localStorage do seu navegador. O Godmod3 não armazena suas conversas em nenhum servidor — feche a aba e elas desaparecem.

A dependência do OpenRouter explicada de forma simples

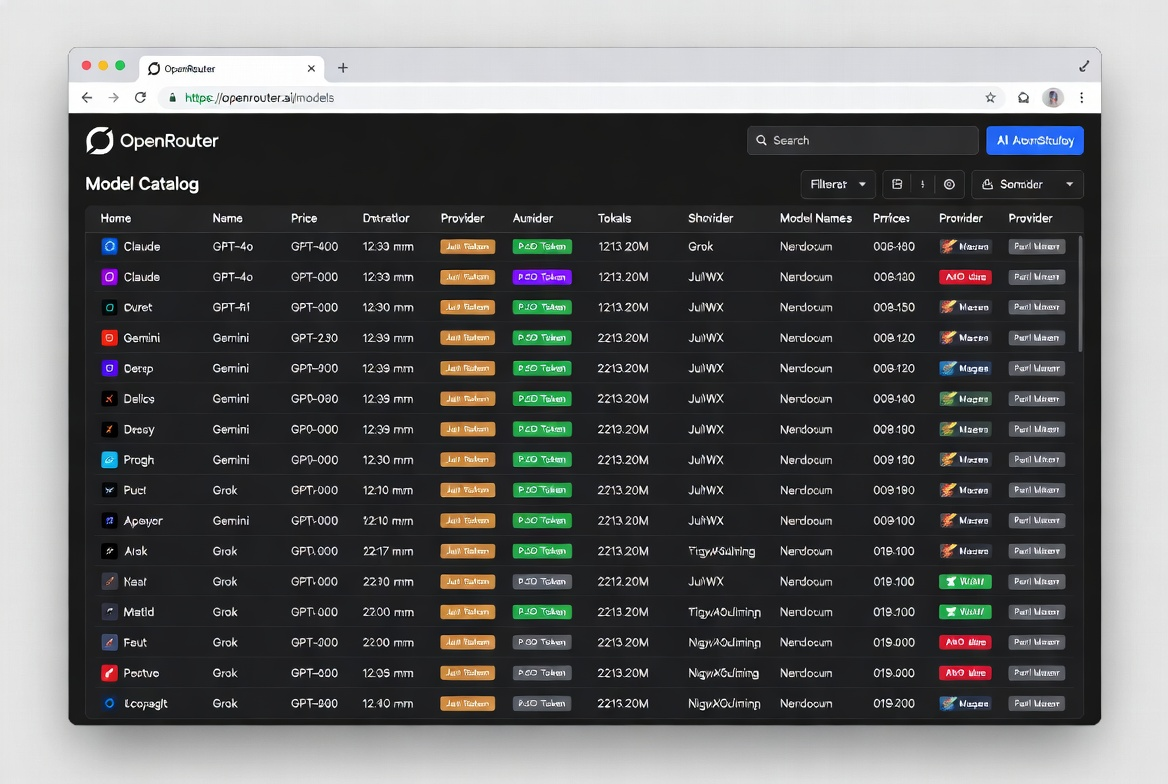

O Godmod3 não se conecta diretamente ao OpenAI, Anthropic ou Google. Ele roteia tudo através do OpenRouter, um gateway de API unificado que fornece acesso a mais de 300 modelos de múltiplos provedores com uma única chave. Você paga ao OpenRouter por token, não ao godmod3. A ferramenta em si é gratuita. O OpenRouter é a camada de faturamento, o catálogo de modelos e a infraestrutura de roteamento, tudo ao mesmo tempo.

Três Formas de Acessar o Godmod3

Versão hospedada em godmod3.ai — sem instalação, traga sua chave OpenRouter

Acesse godmod3.ai, cole sua chave de API do OpenRouter nas configurações e comece a prompts. É isso. Sem download, sem Docker, sem npm install. A versão hospedada elimina completamente o recurso opcional de coleta de dados — é uma interface de chat puramente do lado do cliente.

Eu estava usando em 60 segundos após acessar a página. O atrito foi quase zero, o que é raro para ferramentas de IA de código aberto.

Arquivo único auto-hospedado — clone e abra o index.html

Todo o aplicativo cabe dentro de um único arquivo index.html. Clone o repositório do GitHub, abra o index.html em um navegador e pronto. Ou execute python3 -m http.server 8000 se quiser um servidor local. Sem etapa de build, sem instalação de dependências, sem arquivo de configuração.

Isso importa se você quiser inspecionar exatamente qual código está sendo executado antes de colar uma chave de API nele. A licença AGPL-3.0 — reconhecida pela Open Source Initiative como uma licença de software livre — significa que o código-fonte é totalmente auditável.

Deploy estático — GitHub Pages, Vercel ou Netlify em menos de 5 minutos

Por ser um único arquivo HTML, fazer deploy em qualquer plataforma de hospedagem estática é trivial. Faça push para um repositório do GitHub, habilite o GitHub Pages e sua instância pessoal do godmod3 está ativa em uma URL que você controla. O mesmo vale para Vercel ou Netlify — importe o repositório e faça o deploy. Sem funções serverless, sem variáveis de ambiente (além da sua chave de API, que permanece no lado do cliente).

Testei a rota do GitHub Pages. Levou cerca de três minutos do fork até a URL ativa.

Os Quatro Modos Explicados

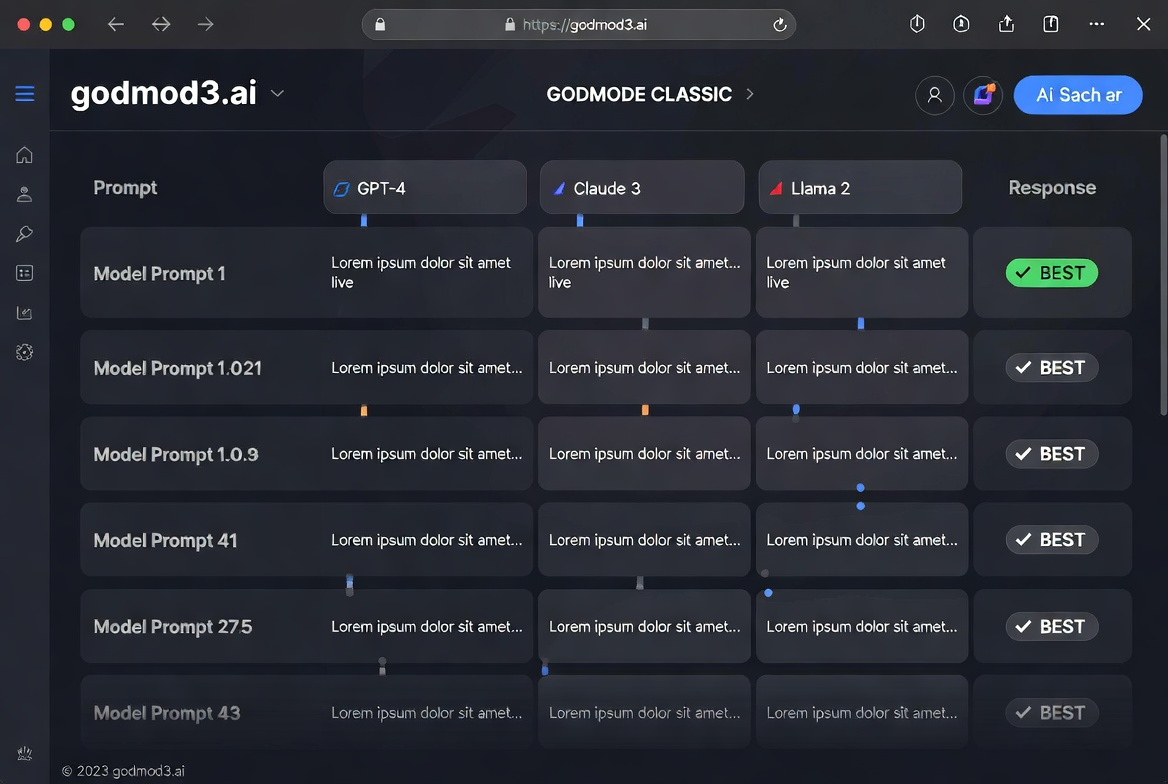

GODMODE CLASSIC — o modo de corrida paralela

O modo original. Cinco combinações de modelo-prompt rodam em paralelo, cada uma pareando um modelo específico com um prompt de sistema ajustado. As respostas competem entre si, e a interface apresenta a melhor. É rápido e opinionado — você confia nas configurações predefinidas em vez de escolher os modelos você mesmo.

Bom para comparações rápidas quando você não quer pensar em ajuste de parâmetros. Menos útil quando você precisa de controle específico do modelo.

ULTRAPLINIAN — avaliação profunda de múltiplos modelos para comparações sérias

Este é o modo que me fez pausar. Ele pode consultar até 51 modelos em paralelo, pontuar cada resposta em uma métrica composta e classificá-las. A pontuação leva em conta relevância, coerência e qualidade da resposta. Para engenheiros de prompt testando como diferentes modelos lidam com a mesma instrução, aqui é onde o valor real está.

Não é barato, no entanto. Executar 51 modelos em paralelo significa 51 chamadas de API separadas, cada uma faturada pelo OpenRouter. Executei um prompt de complexidade média em uma configuração de 10 modelos e o custo foi modesto — alguns centavos. Com 51 modelos, o valor aumenta.

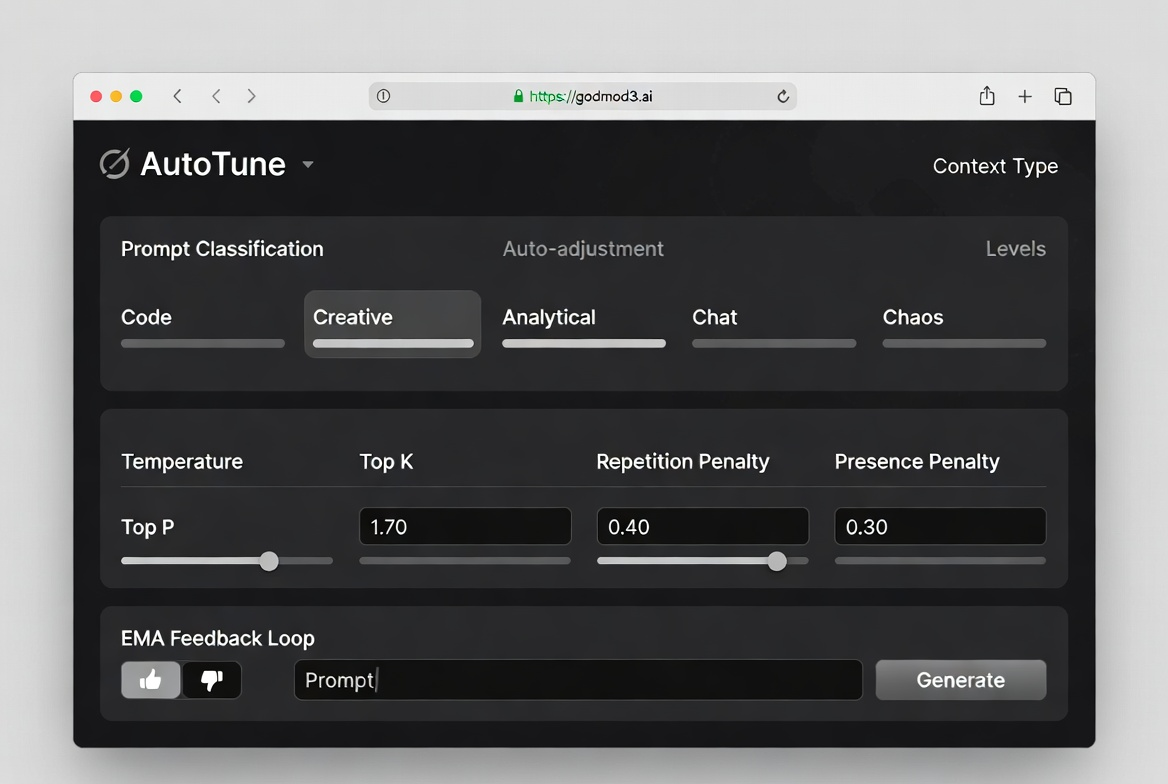

AutoTune — por que você não precisa mais definir a temperatura manualmente

O AutoTune classifica seu prompt em um dos cinco tipos de contexto — código, criativo, analítico, chat ou caos — e ajusta automaticamente temperatura, top_p, top_k e parâmetros de penalidade. Ele usa um loop de feedback baseado em EMA: polegar para cima ou para baixo em uma resposta refina a seleção futura de parâmetros.

Ainda não tenho certeza total de quanto isso faz diferença em comparação com definir manualmente a temperatura para 0,7 e deixar assim. Após uma semana de uso, as escolhas de parâmetros pareceram razoáveis, mas não dramaticamente melhores do que meus padrões. Essa conclusão tem prazo de validade — o loop de feedback precisa de mais dados para convergir.

Parseltongue — perturbação de entrada para pesquisadores de segurança (e para o que não é)

Parseltongue é um módulo de pesquisa red-team. Ele detecta palavras-gatilho e aplica transformações no nível de caracteres — leetspeak, substituição Unicode, codificação fonética — para estudar como os modelos respondem a entradas adversariais. O artigo de pesquisa do projeto enquadra isso explicitamente como uma ferramenta de avaliação de segurança de IA para testar a robustez do modelo no tempo de inferência.

Isso não é uma ferramenta de bypass de conteúdo. É projetado para pesquisa controlada sobre como as camadas de segurança respondem à perturbação de entrada. A distinção importa. Se o seu caso de uso é “quero enganar uma IA para dizer algo que não deveria,” não é para isso que este módulo foi criado, e a documentação do projeto diz isso diretamente.

Acesso a Modelos Através do OpenRouter

Quais modelos estão disponíveis

Através do OpenRouter, o godmod3 pode acessar Claude, GPT-4o, Gemini, Grok, Mistral, Llama, DeepSeek, Qwen e dezenas mais. O catálogo de modelos do OpenRouter lista mais de 300 opções de mais de 60 provedores em abril de 2026. Nem todos são úteis para cada tarefa, mas a amplitude significa que é improvável que você bata em uma parede de “modelo não disponível.”

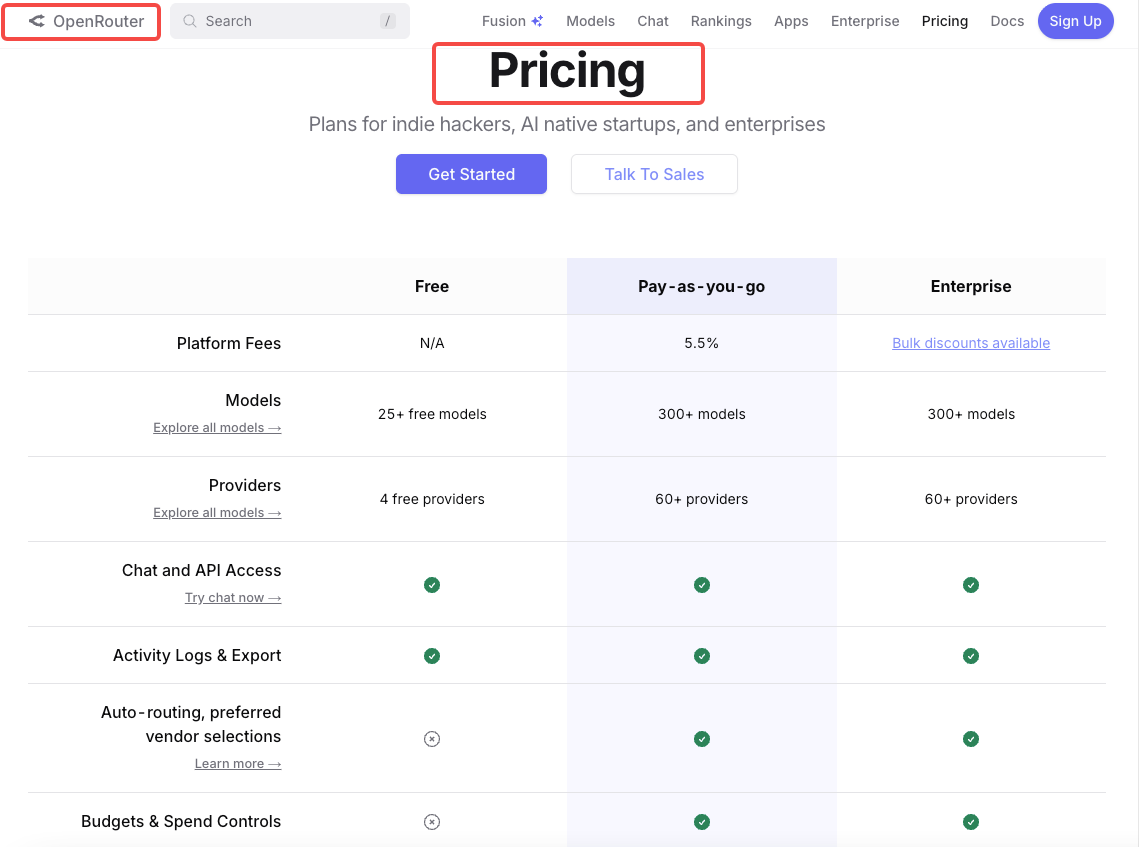

Realidade de preços: você paga ao OpenRouter por token, não ao godmod3

O Godmod3 em si é gratuito. Seus custos vêm do faturamento por token do OpenRouter, que repassa os preços de cada provedor nas taxas diretas da API ou próximas delas. Executar um prompt por um modelo custa o mesmo que chamar diretamente a API desse modelo. Executá-lo por dez modelos custa dez vezes isso.

A página de preços do OpenRouter detalha as taxas por token por modelo. Não há taxa mensal, sem gasto mínimo. Você adiciona créditos e eles são consumidos conforme o uso.

Modelos gratuitos no OpenRouter que você pode usar com o godmod3 hoje

O OpenRouter mantém uma coleção de modelos gratuitos — atualmente cerca de 29 opções incluindo DeepSeek R1, Llama 3.3 70B, Qwen3 Coder e várias variantes Gemma. Os modelos gratuitos têm limites de taxa (tipicamente 20 requisições por minuto, 200 por dia), mas não requerem créditos.

Para testar se o godmod3 se encaixa no seu fluxo de trabalho antes de comprometer qualquer dinheiro, o nível gratuito é suficiente para formar uma opinião.

O Que o Godmod3 Não É

Não é um backend — o histórico de chat fica apenas no seu navegador

Não há conta, sem sincronização na nuvem, sem armazenamento no lado do servidor. Limpe os dados do seu navegador e suas conversas desaparecem permanentemente. Troque de dispositivo e nada te acompanha. O modo de navegação privada descarta tudo ao fechar a janela.

Isso é um recurso de privacidade, não uma limitação — mas significa que o godmod3 é um bloco de rascunho, não uma base de conhecimento.

Não é um substituto para APIs de produção

Se você está construindo um produto que chama LLMs, precisa de integração direta com a API com lógica de retry, tratamento de erros e gerenciamento de limite de taxa. O Godmod3 é uma interface de pesquisa e avaliação, não infraestrutura de produção. A própria documentação do projeto é clara sobre isso.

Não é uma ferramenta de bypass — o propósito do Parseltongue na pesquisa de segurança de IA

Vale repetir: o Parseltongue existe para estudar a robustez do modelo sob condições controladas. O projeto se posiciona dentro do cenário mais amplo de pesquisa de segurança de IA ao lado de frameworks como IA Constitucional e RLHF. Ele fornece ferramentas de avaliação no tempo de inferência — não modificações no tempo de treinamento. O risco de uso dual é reconhecido na documentação, e os usuários são responsáveis pelo cumprimento da legislação local.

Quem Obtém Mais Valor do Godmod3

Engenheiros de prompt que precisam de comparação rápida entre múltiplos modelos

Se você está testando como um prompt funciona em Claude, GPT-4o e Gemini antes de se comprometer com um, o godmod3 comprime esse fluxo de trabalho de “três abas, três logins, comparação manual” para “um prompt, uma tela, resultados classificados.” Esse é o valor central.

Desenvolvedores avaliando qual LLM se adequa ao seu caso de uso antes de comprometer-se com uma API

Antes de integrar uma API e construir em torno de suas peculiaridades, você quer saber: esse modelo lida bem com meu caso de uso? Executar os mesmos prompts de teste por 5-10 modelos em paralelo fornece uma matriz de comparação em minutos, não dias.

Pesquisadores fazendo estudos controlados de comportamento de LLM

A combinação de AutoTune (variação de parâmetros), Parseltongue (perturbação de entrada) e ULTRAPLINIAN (pontuação entre modelos) cria um pipeline de avaliação estruturado. Para pesquisadores acadêmicos ou da indústria estudando como os modelos respondem sob diferentes condições, este é um kit de ferramentas pronto que não requer a construção de infraestrutura personalizada.

Perguntas Frequentes

O godmod3.ai é o mesmo que G0DM0D3 no GitHub?

Sim. “Godmod3” e “G0DM0D3” referem-se ao mesmo projeto. A versão hospedada em godmod3.ai executa o mesmo código-base do repositório do GitHub. A principal diferença é que a versão hospedada não inclui o recurso opt-in de coleta de dados — isso só está disponível ao auto-hospedar com o servidor API completo baseado em Docker.

Preciso pagar para usar o godmod3?

A ferramenta em si é gratuita. Você precisa de uma chave de API do OpenRouter, e o OpenRouter cobra por token ao usar modelos pagos. Você pode usar modelos gratuitos no OpenRouter sem custo algum, sujeito a limites de taxa. Sem assinatura, sem taxa de plataforma do godmod3.

Minha chave de API está segura no godmod3.ai?

Sua chave do OpenRouter é armazenada no localStorage do seu navegador e enviada diretamente para a API do OpenRouter. Ela nunca toca um servidor do godmod3. Dito isso, você está confiando que o código do lado do cliente não a exfiltrará — razão pela qual o código-fonte aberto importa. Você pode auditá-lo você mesmo, ou auto-hospedar para controle total.

Posso usar o godmod3 sem uma conta no OpenRouter?

Não. O OpenRouter é a camada de roteamento para todo acesso a modelos. Você precisa de uma conta no OpenRouter e uma chave de API. A criação de conta é gratuita e não requer cartão de crédito se você estiver usando apenas modelos gratuitos.

O que acontece com meu histórico de chat se eu fechar o navegador?

Ele permanece no localStorage até você limpar os dados do navegador. Mas não há backup, sem sincronização, sem recuperação. Se você precisar preservar uma conversa, copie-a manualmente antes de fechar a aba.

Tenho usado o godmod3 há cerca de dez dias. Ele não substituiu minhas assinaturas diretas de Claude ou GPT — essas ainda importam para fluxos de trabalho conversacionais longos onde a continuidade do contexto conta. Mas para a tarefa específica de “qual modelo lida melhor com este prompt,” ele reduziu meu tempo de comparação de minutos para segundos.

Isso é tudo que posso confirmar. O resto você precisará verificar por conta própria.

Posts anteriores: