Como Usar o Seedance 2.0 via API: Jobs Assíncronos, Retentativas e Tratamento de Resultados

Padrões de produção para APIs do Seedance 2.0: ciclo de vida de jobs assíncronos, retentativas, idempotência, observabilidade e controles de custo.

Quer criar vídeos cinematográficos como o Seedance 2.0? Experimente o WaveSpeed Cinematic Video Generator para criar vídeos cinematográficos no nível do Seedance 2.0 agora mesmo.

Olá a todos. Aqui é a Dora. Sabe, eu ficava cutucando uma tarefa de longa duração na API do Seedance 2.0 e me pegava alternando entre janelas para verificar se tinha terminado. Não era um problema grave, só um incômodo constante. Ao longo de alguns dias, executei alguns trabalhos reais (transformações de conteúdo e extrações em lote) e prestei atenção nas partes que realmente mudaram como meu dia se sentia.

O que segue é o conjunto de padrões que tornaram o trabalho mais estável: como envio, rastreio e coleto resultados; como empacoto entradas; o que retento (e o que não retento); e as proteções básicas que me impediram de tropeçar em chaves, custos e logs. Se você já lida com APIs, isso vai soar familiar — de propósito.

Ciclo de vida de um job na API (enviar → status → resultado)

Tentei manter a API do Seedance 2.0 simples na minha cabeça: três movimentos — enviar, verificar status, buscar resultado. Quando passei a tratá-la dessa forma, a carga mental diminuiu.

Enviar: mando um job com um payload claro e autocontido, e uma chave de idempotência gerada pelo cliente (mais sobre isso adiante). Anoto, em comentários de código para mim mesmo, o que considero “concluído”. Não é uma questão filosófica: é apenas a forma exata do sucesso (ex.: JSON com os campos X, Y, Z; um checksum que confere; sem parciais).

Status: parei de pensar no status como uma coisa só. Categorizo assim:

- Em andamento (seguro para verificar periodicamente)

- Bloqueado (precisa da minha ação, geralmente entrada inválida)

- Terminal (concluído com sucesso ou falhou permanentemente)

Essa pequena divisão mudou como eu verificava. Se está em andamento, recuo e aguardo. Se está bloqueado, corrijo as entradas. Se é terminal, sigo em frente. Não interpreto demais os rótulos intermediários.

Resultado: quando um job termina, coleto as saídas em um formato em que posso confiar depois — geralmente JSON com um schema estável e um hash de conteúdo simples. Se a API suporta webhooks, ainda mantenho o polling como fallback. Webhooks são ótimos até que uma regra de firewall ou falha na fila engula um. Polling é chato e confiável.

Duas observações de campo:

- As primeiras execuções não economizaram tempo. Após algumas iterações, percebi que economizavam atenção. Menos verificações de “isso terminou?”, mais “verei quando estiver realmente pronto”.

- Evito encadear jobs dentro da API quando posso. Um job, um resultado. Se preciso de lógica de ramificação ou dependência, mantenho isso no meu sistema. Torna a depuração e as retentativas mais limpas.

Se você está construindo em torno disso, uma máquina de estados simples ajuda. Sem drama, apenas alguns estados enumerados e transições claras. Não é sofisticado, mas absorve casos extremos sem virar espaguete.

Design de payload (empacotamento de texto + referências)

A maior parte do meu atrito veio dos payloads. Não eram falhas, apenas incompatibilidades. Quando organizei melhor a estrutura, as coisas se encaixaram.

Parei de enviar blocos de texto gigantes inline quando não precisava. Em vez disso:

- Envio instruções de texto concisas e parâmetros inline.

- Passo artefatos grandes (documentos, mídia, saídas anteriores) por referência — URLs assinadas ou chaves de objeto — com identificadores versionados.

Essa divisão tornou as retentativas mais seguras e reduziu o reenvio desnecessário. Também deixou os logs mais sensatos: conseguia ver o que mudava entre execuções sem rolar por megabytes de conteúdo. Se a API do Seedance 2.0 precisa tanto de texto quanto de referências, os mantenho sob um único objeto “input” com nomes claros. O eu do futuro agradece por não ter que caçar campos perdidos.

Validando entradas antes de enviar

Antes de enviar qualquer coisa, executo três verificações localmente:

- Estrutura: o payload corresponde ao meu próprio schema? Campos obrigatórios presentes, tipos corretos, enums válidos. Uso um validador de JSON Schema para isso.

- Referências: as URLs resolvem e atendem às regras de tamanho/tipo? Faço requisições HEAD de preflight e anexo content-length e checksum quando disponíveis.

- Expectativas: os parâmetros são consistentes com o tipo de job que estou solicitando? Se digo “resumir”, não passo também “full_transcript=true”. Parece bobo, mas acontece.

Essas verificações não fazem os erros desaparecerem: elas os movem para o lugar mais barato de corrigir — antes de saltos de rede, antes de limites de taxa, antes de eu estar lendo logs à meia-noite.

Padrões de confiabilidade

Após uma semana de uso constante, a maioria das minhas dores de cabeça veio de retentativas que eu não conseguia raciocinar. A cura foram padrões simples que conseguia explicar a um colega em uma frase.

Divido falhas em dois grupos:

- Seguro para retentar (problemas de rede transitórios, erros 5xx, timeouts antes do início do trabalho no servidor)

- Não retentar cegamente (erros de validação, cota excedida, estados desconhecidos)

Depois de fazer isso, o resto se encaixou.

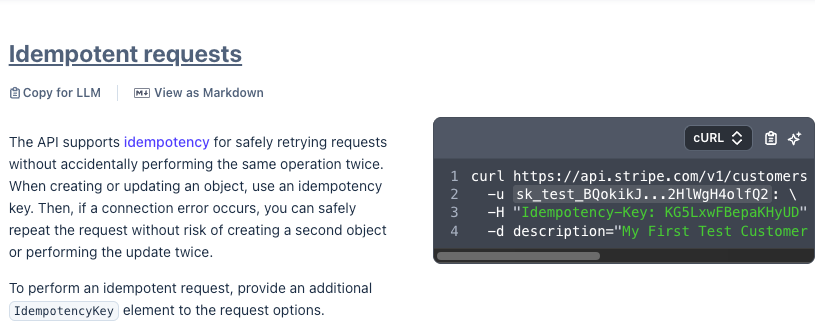

Chaves de idempotência + retentativas seguras

Adiciono uma chave de idempotência única a cada envio de job. O servidor deve tratar repetições com a mesma chave como a mesma requisição. Na prática, assumo que posso não saber se uma requisição chegou ao servidor. Então, torno as retentativas seguras por design.

O que ajudou:

- Derivar a chave de entradas estáveis (ex.: um UUID mais um hash do payload normalizado) para que duplicatas acidentais colidam de propósito.

- Armazenar a chave e o efeito pretendido com um TTL curto do meu lado. Se perco uma resposta, posso retentar com confiança.

- Tratar operações não idempotentes (como “iniciar e cobrar”) como idempotentes na fronteira do cliente. Ou o servidor impõe isso ou evito retentativas automáticas.

Se quiser um modelo mental sólido, a forma como as APIs de pagamento lidam com isso é clara. A documentação de chaves de idempotência da Stripe é concisa e vale uma leitura, mesmo que você não esteja movendo dinheiro.

Timeouts, backoff e limites de retentativa

Mantenho três números à mão: timeout de requisição, backoff inicial e número máximo de tentativas.

Minha configuração padrão se parece com isso:

- Timeouts: conservadores, mas não mesquinhos. Longos o suficiente para o trabalho típico do servidor, curtos o suficiente para evitar sockets zumbis. Se um job realmente demora, prefiro uma chamada de envio rápida e polling separado.

- Backoff: exponencial com jitter. O jitter importa. Sem ele, retentativas sincronizadas se comportam como um pequeno DDoS.

- Limites: limites rígidos no total de retentativas e no tempo total por job. Depois de atingir um limite, exibo um erro amigável e paro. Sem trashing silencioso.

Na prática, esses números mudaram duas vezes: uma após o primeiro dia (muito agressivos) e uma vez depois que vi um padrão de picos curtos na virada da hora (adicionei mais jitter). Nada foi sofisticado. Apenas fez o sistema parecer mais calmo.

Observabilidade (logs, buckets de falha, monitoramento de custos)

Não persigo rastreamento completo a menos que precise. Para o trabalho com a API do Seedance 2.0, três visões foram suficientes:

- Logs de requisições com IDs de correlação: marco cada chamada de envio, status e resultado com o mesmo ID de correlação. Quando algo dá errado, consigo acompanhar um job do início ao fim sem adivinhação. As convenções semânticas do OpenTelemetry são uma boa referência se você está configurando isso pela primeira vez.

- Buckets de falha: agruo falhas por causa (validação, autenticação, cota, timeout, 5xx, incompatibilidade de schema). Buckets tornam tendências visíveis. Se “cota” de repente explode nas segundas-feiras, planejo em torno disso em vez de apagar incêndios.

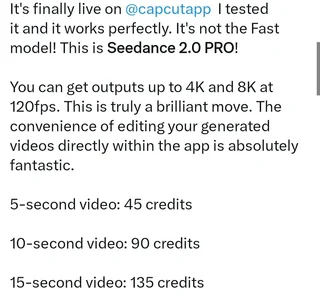

- Visão de custos: registro o custo estimado por job — entradas, saídas, retentativas incluídas — e agrego isso semanalmente. O objetivo não é precisão: é sentir a tendência. Uma visão simples por percentil (P50, P95) mostra se alguns outliers estão consumindo silenciosamente o orçamento.

Uma pequena nota sobre alertas: os mantenho simples. Sem fogos de artifício, apenas thresholds que mapeiam para ações: “bucket de falhas > X por Y minutos” ou “custo P95 sobe > Z% semana a semana”. Prefiro perceber tarde do que viver em falsos positivos. A energia economizada compensa em outros lugares.

Conceitos básicos de segurança e conformidade (chaves, tratamento de conteúdo do usuário)

Nada sofisticado aqui, e esse é um pouco o ponto. O básico faz a maior parte do trabalho.

- Chaves: mantenho as chaves de API fora do código e as rotaciono periodicamente. Chaves por ambiente, privilégio mínimo se escopos existirem, e sem compartilhamento entre equipes. Se a API suporta tokens de curta duração, os uso.

- Conteúdo do usuário: não registro dados brutos do usuário. Registro hashes, tamanhos e referências. Se preciso de amostras para depuração, primeiro anonimizo ou redato, com um timer de retenção claro.

- Tratamento de dados: marco cada job com um ID de tenant ou usuário e carrego essa tag nos logs e no armazenamento. É mundano, mas evita que verificações de acesso se tornem folclore.

- Armazenamento: os resultados ficam em um bucket ou banco de dados com criptografia do lado do servidor e ACLs restritas. Trilhas de auditoria importam mais do que sofisticação aqui.

- Postura de conformidade: se uma equipe precisa de conforto com SOC 2 ou GDPR, escrevo exatamente o que vai para onde, quem pode ver e por quanto tempo. Sem promessas no escuro. Em caso de dúvida, verifico a página de segurança e os termos de processamento de dados do fornecedor em vez de adivinhar.

O teste para mim é simples: conseguiria explicar essa configuração a um colega preocupado com privacidade sem gesticular vagamente? Se não, é porque ainda não simplifiquei o suficiente.

Uma última observação

Entrei buscando velocidade. O que obtive foi estabilidade. A API do Seedance 2.0 não eliminou etapas: as tornou previsíveis. Isso foi suficiente para fazer o trabalho parecer mais leve. Ainda estou acompanhando como os custos evoluem ao longo de um mês, e se meus buckets aguentam sob novos tipos de jobs. Perguntas silenciosas, mas boas. Você concorda?

Quer criar vídeos cinematográficos como o Seedance 2.0? Experimente o WaveSpeed Cinematic Video Generator para criar vídeos cinematográficos no nível do Seedance 2.0 agora mesmo.