Versões do Modelo GPT-5 Explicadas: De GPT-5 ao GPT-5.4

GPT-5 não é um único modelo. Este guia explica cada versão GPT-5.x e o que os desenvolvedores devem saber sobre a família de modelos em evolução.

Olá, sou Dora. Não planejei escrever sobre modelos GPT-5 esta semana. Fiquei presa novamente escolhendo uma versão no menu suspenso de modelos. Uma pequena pausa, depois a pergunta familiar: o 5.2 realmente ajuda aqui, ou estou clicando no mais novo porque é mais novo?

Disponível na WaveSpeedAI — preços transparentes por token, endpoint compatível com OpenAI. GPT-5.5 API → · GPT-5.4 API → · Abrir Playground →

Essa pequena fricção me fez entrar numa toca de coelho. Passei algumas noites no final de fevereiro e início de março de 2026 refazendo as mesmas tarefas na família 5.x: um resumo de pesquisa compacto, uma extração de JSON estruturado e uma refatoração simples de código em vários arquivos. Nada elaborado. Apenas o tipo de trabalho que ou parece mais fácil, ou não parece. Estas são minhas anotações de campo, não uma celebração de vitória.

Por Que o GPT-5 É um Sistema, Não um Modelo Único

Continuo vendo pessoas falando sobre “o” modelo GPT-5, como se fosse um cérebro único que você substitui. Isso não corresponde ao que observei, nem ao que a OpenAI sugere em sua documentação e palestras públicas.

Visão geral da arquitetura de roteamento

O comportamento parece um sistema roteado: uma “porta de entrada” que decide silenciosamente qual especialista interno lida com qual parte da sua solicitação. Pense nisso como um controlador de tráfego com alguns objetivos em mente: manter a latência estável, atingir um limiar de qualidade e evitar executar especialistas caros, a menos que o prompt realmente precise. É por isso que o mesmo prompt pode parecer um pouco diferente entre as configurações “rápida” e “padrão”, ou entre versões adjacentes — há mais de um modelo em jogo.

Na prática, vi sinais disso quando:

- A chamada de ferramentas é detectada mais rapidamente em determinadas execuções, como se um planejador tivesse entrado mais cedo.

- A confiabilidade do modo JSON aumenta após uma atualização no lado do sistema, mesmo sem mudança nos parâmetros da API.

- A latência se mantém sob carga melhor do que deveria para um único monolito.

Não consigo ver nos bastidores, mas os resultados sugerem um roteador que pondera custo, velocidade e tipo de tarefa, depois escolhe um caminho. Essa perspectiva me ajuda a entender por que dois rótulos “GPT-5” podem se comportar de forma diferente.

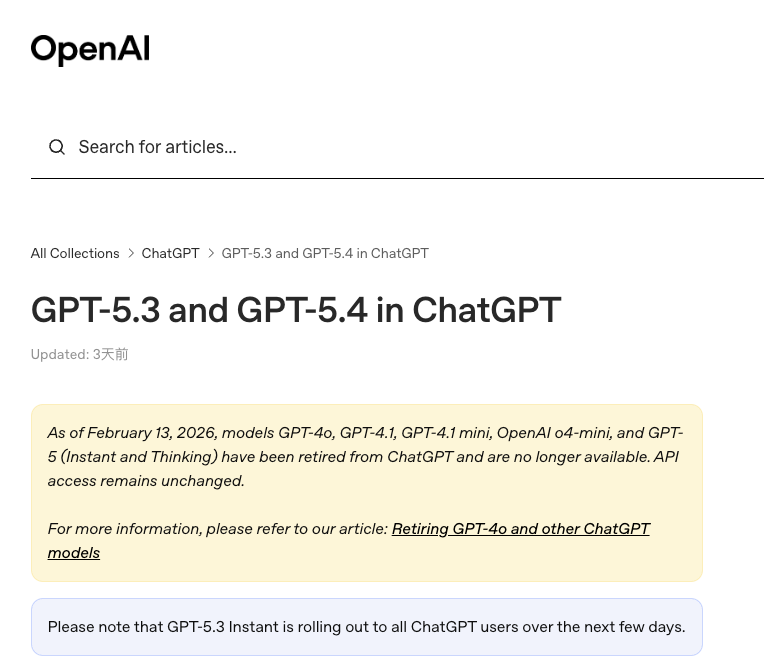

Como funciona o versionamento da OpenAI

A OpenAI geralmente lança famílias de modelos com versões nomeadas e builds ocasionais de “prévia”. Com o tempo, uma versão pode se tornar o padrão e depois ser descontinuada. Os rótulos podem mudar mais rápido do que os posts de blog conseguem acompanhar. Quando estou em dúvida, consulto a documentação de modelos da OpenAI e o changelog da API antes de fixar uma versão. Também vale a pena dar uma olhada na referência da API para flags pequenas mas importantes (esquema de resposta, modos JSON, nuances de chamada de ferramentas) que mudam entre versões.

Então quando digo “GPT-5”, me refiro ao sistema roteado exposto sob esse nome de família. E quando digo “5.1” ou “5.3”, me refiro a uma configuração específica desse sistema, geralmente com padrões diferentes, roteadores levemente diferentes e às vezes novas proteções de segurança ou confiabilidade.

GPT-5 (Base) — Capacidades Iniciais

Inicialmente tratei o GPT-5 base como um generalista. Não porque fosse mágico, mas porque lidava com três tarefas comuns razoavelmente bem com pouca configuração.

Recursos principais no lançamento

- Clareza de raciocínio: Para tarefas de planejamento — “esboce uma abordagem em 3 passos, depois preencha o passo 1” —, o modelo base seguiu a estrutura sem eu precisar explicar demais. Não era chamativo. Era constante.

- Uso de ferramentas sem drama: A chamada de funções funcionou imediatamente. Quando pedi para extrair campos estruturados, ele passou argumentos consistentes e tipados na maioria das vezes.

- Contexto longo sem travar: Enviei briefings longos e referências em várias partes. Permaneceu coerente o suficiente para ser útil, especialmente quando eu o ancorava com cabeçalhos de seção.

- Modo JSON e esquemas de resposta: Com um esquema simples, consegui outputs analisáveis 8–9 vezes em 10 na primeira tentativa. Quando falhava, falhava visivelmente (objeto truncado), o que é uma estranha forma de misericórdia.

Limitações iniciais

- O determinismo ainda é suave: mesmo com temperatura baixa, execuções repetidas ajustavam a formulação e às vezes a ordenação. Para produção, tive que adicionar pós-processamento leve (ordenação de chaves, normalização de espaços em branco) para manter os diffs tranquilos.

- Recall de chamada de ferramentas: ao encadear ferramentas, o modelo às vezes “esquecia” as restrições de limite de uma ferramenta anterior, a menos que eu as reafirmasse. Um pequeno inconveniente, mas real.

- Picos de latência: a maioria das chamadas estava bem. Então uma ou duas demoravam visivelmente mais. Não minutos, mas o suficiente para atrapalhar um loop apertado.

- Consciência de custo: o base não era o mais barato, então prompts longos descuidados pareciam caros. Reduzi as mensagens de sistema e movi o boilerplate para templates de código. Passo simples, economia significativa.

GPT-5.1 ao GPT-5.3 — Mudanças Incrementais

Essas versões de ponto não mudaram o caráter dos modelos GPT-5. Elas apertaram os parafusos.

Melhorias versão por versão

- 5.1: O seguimento de instruções ficou mais nítido. Quando pedi “apenas marcadores, sem introdução”, ele obedeceu com mais frequência. A conformidade com JSON também aumentou um pouco.

- 5.2: Melhor ancoragem em citações. Quando forneci trechos e pedi resumos com suporte em citações, ele se ancorou de forma mais limpa ao texto citado. As alucinações diminuíram — não chegaram a zero, mas o suficiente para eu notar.

- 5.3: A chamada de ferramentas pareceu mais confiável sob carga. Menos formatos de argumento estranhos. Também vi primeiros tokens ligeiramente mais rápidos nos meus logs, embora isso possa ser o roteador fazendo triagem inteligente em vez do próprio modelo.

Tudo isso apareceu de formas silenciosas: menos tentativas repetidas, menos limpeza, menos orientação nos prompts.

Diferenças voltadas ao desenvolvedor

- Esquemas de resposta: as versões mais novas eram mais exigentes de uma boa forma. Quando declarei um esquema, elas ou o seguiam ou falhavam rapidamente. Isso me economizou mais tempo do que qualquer melhoria de “inteligência”.

- Deltas de streaming: o fluxo de tokens chegava em chunks mais estáveis. Mais fácil de construir UIs que não tremem.

- Tolerância de assinatura de ferramentas: 5.2 e 5.3 lidaram com tipos estritos sem improvisar. Se um campo era um enum, paravam de inventar novos valores com tanta frequência. Isso reduziu o código de proteção.

São pequenas melhorias, mas removem irritações cotidianas. Se você mantém agentes, pequeno é grande ao longo de muitas chamadas.

O que permaneceu igual

- Realidades do tamanho do contexto: alimentar contexto enorme ainda penaliza latência e custo. Reduzir e indexar ainda é vencedor.

- Deriva de estilo: mesmo com exemplos, o tom variava um pouco em outputs mais longos. Mantenho trechos de referência e peço ao modelo para emulá-los — funciona melhor do que adjetivos.

- “Gênio de uma tacada” é raro: os melhores resultados ainda vêm de scaffolding constante, objetivos claros, pequenos passos e feedback. O modelo melhorou, mas o design do meu sistema importou mais.

GPT-5.4 — O Que os Vazamentos Sugerem Atualmente

Não tenho acesso ao 5.4 enquanto escrevo isto. Estou me baseando em migalhas públicas, conversas de desenvolvedores, algumas referências de SDK que as pessoas identificaram e o padrão geral de como essas famílias evoluem. Trate isso como direcional, não definitivo. Se você está próximo de uma janela de lançamento, verifique a documentação do modelo e as notas de versão recentes.

Referências ao modo rápido

Há uma conversa constante sobre um caminho de roteamento “rápido” ou “turbo” no 5.4. Meu palpite: um perfil com prioridade de latência que relaxa algumas proteções de qualidade, semelhante em espírito aos níveis de velocidade que vimos em famílias anteriores. Se isso se concretizar, eu esperaria:

- Tempo de primeiro token mais ágil.

- Variância ligeiramente maior na formatação exata, a menos que você use esquemas estritos.

- Melhor comportamento de concorrência para UIs de chat e agentes ao vivo.

Se você se importa mais com velocidade percebida do que com fraseado perfeito, este pode ser o padrão.

Sinais de tratamento de visão

Algumas dicas apontam para uma compreensão de imagem mais forte e OCR mais robusto em entradas bagunçadas (reflexos, recibos inclinados, capturas de tela de código). Também esperaria respostas mais estáveis em gráficos e tabelas, especialmente se você fornecer um esquema alvo. O resultado prático: menos pré-processamento manual. Hoje frequentemente recorto ou aprimoro imagens antes de enviá-las. Se o 5.4 conseguir absorver mais desse caos, uma etapa inteira desaparece.

Melhorias no fluxo de trabalho de codificação

A conversa aqui gira em torno de planejamento e edições em vários arquivos. Se for verdade, o 5.4 pode:

- Propor planos de etapas mais claros antes de tocar no código.

- Manter assinaturas de funções consistentes entre arquivos.

- Reduzir erros de off-by-one e problemas com caminhos de importação.

Mesmo uma pequena melhoria na confiabilidade importa. Em meus testes com versões anteriores, 70–80% do “tempo perdido” não era lógica — era limpar edições confiantes mas levemente erradas. Se o 5.4 reduzir isso em até 10–15%, vai parecer mais do que um lançamento incremental.

Como os Desenvolvedores Escolhem Entre as Versões GPT-5.x

Não escolho uma versão porque um blog me disse. Faço testes pequenos e entediantes. Aqui está o framework que funcionou para mim.

Mapeamento de casos de uso

- Redação de conteúdo com controle de tom: prefiro versões mais novas (5.2/5.3) porque a aderência de estilo melhorou ligeiramente. Mantenho uma pequena biblioteca de exemplos de tom e aponto para eles.

- Extração estruturada: a versão que me dá a maior aderência ao esquema vence. Ultimamente tem sido 5.2 ou 5.3 com esquemas de resposta explícitos. Ainda adiciono um validador e uma nova tentativa.

- Agentes e fluxos de trabalho com ferramentas: o 5.3 tem sido o mais estável em argumentos de função. Se o modo rápido do 5.4 for real, farei testes A/B para agentes ao vivo que precisam de troca rápida mais do que prosa perfeita.

- Assistência de código: começo com um contexto curto e peço um plano primeiro. Se o modelo não consegue escrever um plano convincente, não vai escrever diffs limpos. Versões adjacentes do 5.x diferem o suficiente aqui para importar — teste no seu repositório, não em um arquivo de brinquedo.

Acompanho três números para cada caso de uso: taxa de sucesso na primeira passagem, latência média e a porcentagem de chamadas que precisam de limpeza humana. Se uma versão mais nova não mover pelo menos um desses na direção certa, não mudo.

Compensações entre custo e capacidade

Os preços da OpenAI mudam, e não vou adivinhar números aqui. O padrão, porém, é estável:

- Modelos mais novos nem sempre são mais caros, mas podem ser. Faço orçamento por tokens, não por intuição.

- Prompts longos multiplicam o custo. Removo boilerplate, comprimo exemplos e referencio IDs externos quando posso.

- Se você processa trabalho em lote (resumos, extrações), a versão confiável mais barata geralmente vence. Se você está voltado ao usuário, a velocidade percebida frequentemente importa mais do que o custo bruto.

Duas dicas práticas que me economizaram dinheiro e tempo:

- Conjuntos dourados: mantenha 20–50 prompts reais com outputs conhecidamente bons. Re-execute-os quando considerar uma mudança. Sem memória, apenas comparações limpas. Você verá as compensações rapidamente.

- Proteções no código, não em prosa: esquemas, validadores e pequenos pós-processadores superam parágrafos de instruções.

Política de Atualização da Página (mantida continuamente)

Atualizo esta página quando vejo mudanças significativas nos modelos GPT-5, geralmente após re-executar meu conjunto de testes ou quando a documentação da OpenAI muda. Adiciono uma nota curta com data, o que testei e o que mudou (se algo mudou). Ligo a fontes oficiais quando posso e sinalizo incerteza quando não consigo verificar algo.

Se você lida com restrições semelhantes, vale a pena dar uma olhada de vez em quando — mas não me espere. A documentação do modelo é a fonte da verdade. Mantenho minhas anotações constantes, não exaustivas.

Uma pequena observação para encerrar: quanto mais trato o “GPT-5” como um sistema vivo em vez de um único interruptor, mais calmas ficam minhas decisões. O menu suspenso para de parecer um teste. É apenas um botão que giro com uma razão.