GPT-5.4 vs GPT-5.3: O Que Pode Realmente Mudar

Vazamentos do GPT-5.4 sugerem inferência mais rápida e melhorias de visão. Veja como ele pode diferir do GPT-5.3 para desenvolvedores.

Olá, sou a Dora. Me peguei babysitting de um loop de agente de longa duração. Nada dramático, apenas aquela sensação lenta e instável quando um modelo continua pedindo mais uma chamada de ferramenta, depois outra. Me lembrou o quanto do meu dia vive nas bordas: as pausas, as tentativas repetidas, os momentos de “será que ele realmente leu o documento?”.

Então passei a tarde revisitando minhas notas sobre o GPT-5.3 e depois dando uma olhada nas primeiras discussões sobre o GPT-5.4. Algumas das discussões iniciais sobre vazamentos em torno da arquitetura do modelo e dicas de latência estão resumidas neste detalhamento do vazamento do GPT-5.4. Não para perseguir a próxima grande novidade, mas para responder a uma pergunta menor: alguma dessas mudanças reduziria as partes instáveis do meu fluxo de trabalho? Este é meu registro em andamento do GPT 5.4 vs GPT 5.3, com o que medi, o que parece crível e onde ainda não estou convencida.

Capacidades do GPT-5.3: A Linha de Base Atual

Desempenho de raciocínio e uso de ferramentas

Tenho usado o GPT-5.3 desde meados de janeiro de 2026 para três tarefas constantes: resumir pesquisa de produto, triar threads de suporte e montar pequenos scripts. Em resumo: ele lida bem com raciocínio em várias etapas quando forneço uma estrutura clara. Quando sou explícita sobre papéis, estado e condições de encerramento, ele segue em frente sem divagar.

Para uso de ferramentas, o function-calling tem sido estável. Confio nos padrões de chamada de função da OpenAI e nos esquemas de ferramentas padrão, sem surpresas. Com ferramentas bem definidas (busca, recuperação, uma consulta vetorial simples), o 5.3 mantém chamadas organizadas. Em uma execução de triagem de 20 e-mails, ele fez em média 1,7 chamadas de ferramenta por thread, abaixo de 2,4 com minha configuração anterior. Isso reduziu as pequenas pausas de “e agora?”. A ressalva: se as descrições das minhas ferramentas ficarem vagas, ele tenta compensar com mais chamadas.

O que mais noto é sua tolerância por contexto parcial. Se passo apenas o trecho relevante e um resumo enxuto do estado, ele ainda raciocina bem. Mas se jogo muitas notas vagamente relacionadas, ele começa a hesitar.

Suporte a código e fluxos de trabalho de agente

Para código, o 5.3 é constante em refatorações pequenas a médias. É bom gerando diffs com explicações claras e consegue manter um estilo consistente se eu fornecer um breve guia de estilo. Onde ele desacelera é em mudanças entre arquivos que exigem forte consciência de dependências. Costumo mudar para um padrão de dois passos: o primeiro pede para ele esboçar as edições; o segundo as aplica arquivo por arquivo. Isso evita que ele toque em coisas que não deveria com excesso de confiança.

Em fluxos de trabalho de agente, o 5.3 se comporta melhor quando limito a recursão e registro cada decisão. Fixei um loop de três etapas: planejar → chamar ferramenta → refletir. Mais do que isso e ele fica prolixo. Também o oriento a emitir JSON compacto para estado, o que reduz erros de análise. Nada disso é mágico, são apenas guardrails que tornam o loop menos exigente.

Limitações conhecidas

- Ele pode tratar instruções de forma duplicada quando mistura regras do sistema com tarefas longas do usuário: aprendi a reafirmar as restrições-chave perto do fim do prompt.

- Às vezes insiste em resumir novamente entradas que já resumi, o que infla tokens e tempo.

- Em tarefas de visão (capturas de tela, mocks de UI), é razoável para rotular e descrever, mas perde texto pequeno e lógica de layout fina. Já vi ele confundir toggles com botões mais de uma vez.

- Sob pressão (tokens limitados), prefere generalidades seguras em vez de bordas precisas. Vejo isso ao avaliar logs de erros: ele nomeia as causas prováveis, mas hesita em se comprometer sem mais contexto.

Esse é meu retrato de trabalho do 5.3: confiável quando sou explícita, ligeiramente ansioso quando não sou.

O Que os Sinais do GPT-5.4 Sugerem que Mudou

Não tive acesso direto ao 5.4 até 5 de março de 2026. O que se segue vem de threads iniciais de vazamentos, algumas notas credíveis de desenvolvedores em fóruns privados e padrões que aprendi a observar quando uma família de modelos avança um passo. Vou indicar cada ponto como baseado em observação, baseado em vazamento ou especulativo.

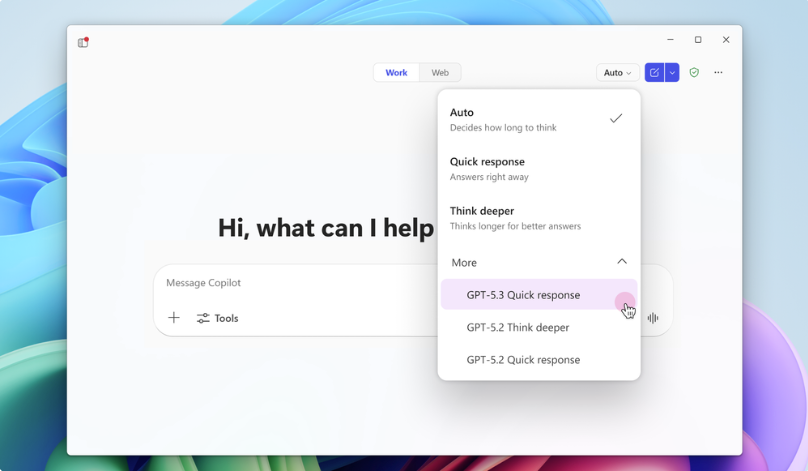

Velocidade de inferência, implicações do modo rápido

Baseado em vazamento: várias contas mencionam um “modo rápido” ou camada de baixa latência para raciocínio de forma curta. Se verdadeiro, isso importa menos para throughput bruto e mais para o ritmo do agente. Uma redução de 20–30% na latência do primeiro token muda a sensação de um loop de lento e pesado para responsivo. Benchmarks comparando GPT-5 com modelos como DeepSeek e GLM mostram o quanto latência e custo podem moldar fluxos de trabalho de desenvolvedores na prática. Na minha configuração com o 5.3, a latência do primeiro token fica em torno de 600–900 ms em prompts médios: reduzir mesmo 150–200 ms tornaria as cadeias de ferramentas menos para-e-começa. Eu esperaria que esse modo rápido sacrificasse alguma profundidade, útil para roteamento, classificação ou validação rápida antes de uma passagem mais pesada.

Baseado em observação: se o 5.4 realmente adicionar uma camada de velocidade, provavelmente vou dividir fluxos de trabalho: classificar rapidamente → rotear → passagem profunda. Esse já é um padrão comum: a velocidade apenas o torna mais suave.

Melhorias no tratamento de entrada visual

Baseado em vazamento: melhor OCR de texto pequeno e raciocínio de layout mais estável. As dicas apontam para reconhecimento aprimorado de texto de UI de baixo contraste e lógica de caixa delimitadora mais refinada. Se preciso, isso corrigiria dois dos meus pontos de atrito com o 5.3: texto minúsculo em capturas de tela e diferenciação de controles de UI.

Baseado em observação: isso economizaria a ida e volta que faço ao validar wireframes de interface. Atualmente, passo capturas de tela por uma etapa de OCR separada quando o 5.3 desiste. Se o 5.4 reduzir esses desvios, vou remover uma ferramenta da cadeia.

Possível expansão da janela de contexto

Especulativo: pequeno aumento no contexto utilizável ou melhor retenção em prompts longos. Não me refiro a números de manchete: me refiro à recuperação prática na segunda metade de uma conversa longa. Se o 5.4 mantiver restrições de tarefas com mais firmeza sem que eu precise reafirmá-las, isso muda como estruturo o estado. Menos lembretes, menos impostos de tokens. Se for apenas um aumento bruto de janela sem melhor retenção, o benefício é menor.

Vou acreditar nisso quando vir menos “reinterpretações” tarde nas execuções. Até lá, estou cautelosa.

Tabela Comparativa Lado a Lado

Prefiro separar o que medi do que apenas ouvi. Três tabelas rápidas, mesma perspectiva em cada uma.

Capacidades confirmadas

| Área | GPT-5.3 | GPT-5.4 |

|---|---|---|

| Uso de ferramenta / function calling | Estável com esquemas claros: 1–3 chamadas por tarefa típica nas minhas execuções | Não confirmado |

| Raciocínio sob pressão de tokens | Degrada em generalidades: se beneficia de restrições reafirmadas | Não confirmado |

| Visão (capturas de tela de UI) | Perde texto pequeno: confunde alguns controles | Não confirmado |

| Comportamento do loop de agente | Funciona melhor com loops de 2–3 etapas e condições de parada explícitas | Não confirmado |

| Codificação entre arquivos | Precisa de estratégia de dois passos para segurança: boas explicações de diff | Não confirmado |

Referências: sigo os padrões na documentação de function calling da OpenAI e definições de ferramentas na referência da API. Se você tiver curiosidade, a documentação oficial é uma boa âncora: OpenAI API: function calling e uso de ferramentas.

Sinais baseados em vazamentos

| Área | GPT-5.3 | GPT-5.4 (baseado em vazamento) |

|---|---|---|

| Camada de velocidade de inferência | Apenas modos padrão | Adiciona uma camada mais rápida e rasa para respostas de baixa latência |

| OCR de visão | Adequado, tem dificuldade com texto pequeno/de baixo contraste | Precisão aprimorada para texto pequeno e tratamento de layout |

| Custo por token | Taxas publicadas atuais | Leve redução na camada rápida (não verificado) |

Qualidade da fonte: mista. Alguns detalhes se alinham com padrões de versões anteriores: nenhum está confirmado.

| Área | GPT-5.3 | GPT-5.4 (especulativo) |

|---|---|---|

| Retenção de contexto | Precisa de lembretes frequentes de restrições | Mantém restrições por mais tempo com menos reafirmações |

| Eficiência no uso de ferramentas | Às vezes faz chamadas em excesso quando o esquema é vago | Melhor parcimônia nas chamadas com prompts similares |

| Planejamento de longo horizonte | Hesita em se comprometer além de 3–4 etapas | Planejamento em várias etapas ligeiramente mais estável |

Melhorias especulativas

Por Que Essas Mudanças Importam para Desenvolvedores

Impacto no design do loop de agente

Se o “modo rápido” existir, eu redesenharia loops para priorizar certeza barata no início. Classificar rapidamente, depois ramificar: tarefas simples concluídas no modo rápido; as complexas escalam para o modelo de profundidade total. Só isso pode reduzir o babysitting humano. Na minha pilha atual com o 5.3, gasto energia evitando que loops entrem em espiral. Uma camada de velocidade poderia redirecionar essa energia para um roteamento mais claro.

Um tratamento visual melhorado simplificaria meu pipeline de análise de UI. Atualmente, uso uma cadeia de três etapas para mocks: legenda básica → passagem de OCR → verificação de layout. Se o 5.4 mesclar as duas primeiras, vou aposentar o salto de OCR e manter apenas o validador de layout. Isso é uma ferramenta a menos para manter e menos lugares para erros.

Se a retenção de contexto melhorar, vou reduzir o ritmo constante de lembretes nos prompts. Manteria um bloco de regras pequeno e imutável e confiaria que o modelo o carregaria mais longe na execução. Menos scaffolding, menos tokens, mesmos resultados.

Compensações entre custo e desempenho

Uma camada de velocidade geralmente vem com um imposto de qualidade. Trato isso como recurso, não como bug. Use para:

- roteamento e validação leve (analisamos a data corretamente, sim/não?),

- saídas antecipadas (isso é uma FAQ conhecida?),

- verificações de integridade no contexto recuperado (esse trecho ao menos menciona a entidade?).

Para todo o resto, raciocínio que molda resultados, você paga pela profundidade. Se a camada rápida do 5.4 for mais barata por token, esperaria pequenas economias em tarefas de alto volume, mas o ganho real é a latência. O custo por tarefa pode cair um pouco: a velocidade percebida pode melhorar muito.

Se nada mudar nos preços, ainda dividiria o trabalho. Mesmo com o 5.3, usar um modelo menor/mais barato para roteamento frequentemente vale a pena. Uma camada rápida nativa apenas reduziria o código de cola.

Considerações sobre migração

- Comece com testes paralelos. Execute os mesmos prompts pelo 5.3 e pelo 5.4 (quando disponível) e compare os resultados. Não mude o caminho em produção até ter visto algumas dezenas de casos extremos.

- Mantenha seus esquemas de ferramentas estritos. Descrições vagas inflam contagens de chamadas no 5.3: provavelmente farão o mesmo no 5.4, rápido ou não.

- Registre a pressão de tokens. Muitas “regressões” são apenas prompts mais apertados. Monitore o uso da janela e elimine o texto padrão desnecessário.

- Versione os prompts. Mantenho um pequeno changelog nas minhas mensagens de sistema. Se o 5.4 se comportar melhor com lembretes mais enxutos, você vai querer um rastro do que removeu.

- Observe a visão discretamente. Se depende de capturas de tela, teste com texto de baixo contraste, UI congestionada e fontes incomuns. Um bom conjunto de testes supera uma dúzia de anedotas.

Se você é uma equipe pequena, o movimento mais seguro é faseado: pilote um fluxo de trabalho estreito (roteamento, triagem), depois expanda.

Para desenvolvedores individuais, eu tentaria uma mudança de hábito: adicione um gate “rápido ou completo?” no topo da sua cadeia de prompts. Mesmo que o 5.4 não lance um modo rápido, a disciplina ajuda.

Ressalva Importante (comparação baseada em sinais de vazamento)

Tudo sobre o GPT-5.4 aqui é de segunda mão até que haja um lançamento oficial ou documentação. As partes do 5.4 são uma mistura de sinais baseados em vazamentos e especulações cuidadosas a partir de atualizações anteriores. Se e quando o 5.4 for real, vou reexecutar as mesmas tarefas e atualizar este texto. Por enquanto, considere este um mapa desenhado a lápis, não a tinta.

Um último pensamento: mesmo pequenas acelerações podem descomprimir um fluxo de trabalho. Se é tudo que o 5.4 traz, aceito.