HappyHorse-1.0은 오픈 소스인가? 확인 가능한 것들

HappyHorse-1.0은 오픈 소스라고 주장하지만, 현재 GitHub 및 HuggingFace 링크에 접근할 수 없습니다. 확인된 사실과 앞으로 주목해야 할 점을 정리했습니다.

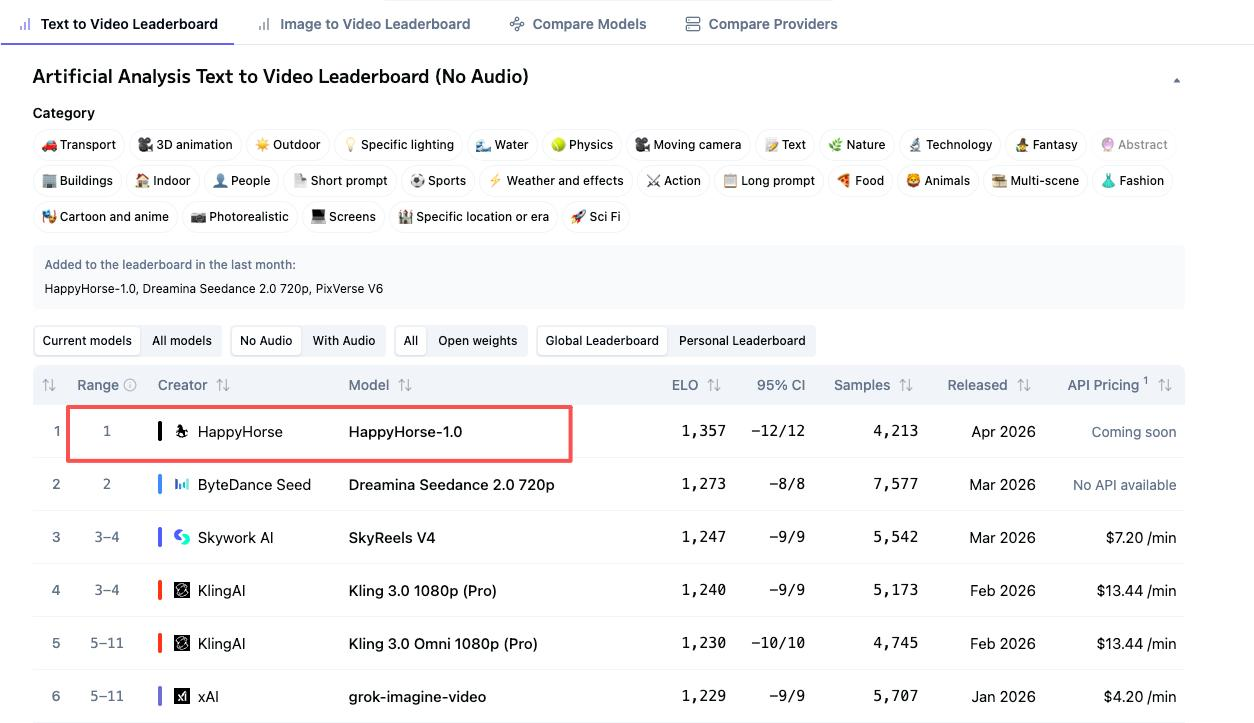

지난 화요일, 로컬 WAN 2.2 파이프라인을 구축하던 중 Artificial Analysis Video Arena 상단에 낯선 이름 하나가 올라왔다. HappyHorse-1.0. Elo 1333점. Seedance 2.0을 앞서고, Kling 3.0을 앞서고, 지난 한 달간 내가 테스트해온 모든 모델을 제쳤다.

첫 번째 반응은 “와”가 아니었다. “레포는 어디 있지?”였다.

내가 팔로우하는 Discord 채널의 누군가가 나를 태그했다 — “Dora, 이거 봤어?” — 공식 사이트 링크를 달아서. 클릭해서 들어갔다. “완전 오픈 소스”라는 문구가 굵게 적혀 있었다. “GitHub — 곧 공개 예정”이라는 문구도. 그 주장과 링크 사이의 작은 간극이 머릿속에 걸렸다. 존재하지 않는 다운로드 버튼을 쫓아다닌 시간이 충분히 쌓인 나로서는, 사용할 수 있는 모델과 읽을 수만 있는 모델의 차이를 안다.

그래서 그 다음 몇 시간 동안 늘 하던 대로 했다: 실마리를 잡아당기고, HuggingFace를 확인하고, 실제로 로컬 머신에 웨이트를 올린 사람이 있는지 X를 훑었다.

2026년 4월 8일 현재 내가 확인할 수 있는 것과 없는 것을 정리했다.

HappyHorse-1.0이 오픈 소스에 대해 주장하는 것

happyhorses.io의 표현은 자신감이 넘친다. 사이트는 이 모델을 “완전 공개”라고 설명하며, 베이스 모델, 증류 모델, 초해상도 모델, 추론 코드가 모두 공개되었다고 명시한다. 주장된 아키텍처는 150억 파라미터의 통합 40레이어 셀프어텐션 트랜스포머 — 크로스어텐션 없음 — 로, 텍스트에서 영상과 오디오를 동시에 생성할 수 있다. 립싱크에 7개 언어를 지원하며, DMD-2 증류를 통해 디노이징을 8단계로 줄였다고 한다.

강력한 주장들이다. 하지만 한 가지 사실이 있다: 주장과 가용성은 별개의 문제다. 그리고 그 간극이 바로 개발자들이 피해를 입는 지점이다.

또한 HappyHorse-1.0을 누가 만들었는지 공개적으로 확인된 바가 없다는 점도 짚을 필요가 있다. Artificial Analysis 자체도 이 모델을 아레나에 추가할 때 “익명” 모델이라고 설명했다. X에서의 커뮤니티 추측은 WAN 변형이라는 것부터 Seedance 경쟁작이라는 것까지 다양하지만, 검증된 것은 없다. 관련 사이트 중 하나에서 ByteDance 인프라를 언급하지만, 이 역시 독립적으로 확인할 수 없었다.

현재 실제로 검증 가능한 것

여기서부터 이야기가 빈약해진다.

GitHub: happyhorses.io 사이트에 GitHub 링크가 있다. “곧 공개 예정”이라고 적혀 있다. 오늘 현재, 공개 레포지토리가 없다 — 코드도, README도, 라이선스 파일도 없다. 관련 조직이나 포크가 있는지 GitHub를 검색했다. 아무것도 없었다.

HuggingFace: 같은 상황이다. 사이트의 “Model Hub” 링크도 “곧 공개 예정”이라고 나온다. HuggingFace에 모델 카드가 없고, 웨이트 파일도 없고, 커뮤니티 토론 스레드도 없다.

데모: 웹사이트를 통해 라이브 데모를 이용할 수 있다. 텍스트 프롬프트에서 영상 클립을 생성한다. 내가 본 결과물은 진짜 인상적이었다 — 깔끔한 움직임, 괜찮은 일관성. 하지만 데모는 모델이 작동한다는 것을 보여줄 뿐이다. 직접 실행하거나, 파인튜닝하거나, 그 위에 무언가를 만들 수 있는지는 알려주지 않는다.

결론: 현재 이 글을 쓰는 시점에서 HappyHorse-1.0을 다운로드할 수 없다. 웨이트를 검사하거나, 라이선스를 읽거나, 로컬에서 실행할 수 없다. “완전 오픈 소스” 라벨은 현재 선언된 의도로만 존재한다.

이 간극이 개발자에게 중요한 이유

오픈 모델을 프로덕션 파이프라인에 통합할지 평가하는 개발자라면, 라벨보다 아티팩트가 중요하다. 그리고 이 분야에서 끊임없이 혼용되는 세 가지 용어가 있다:

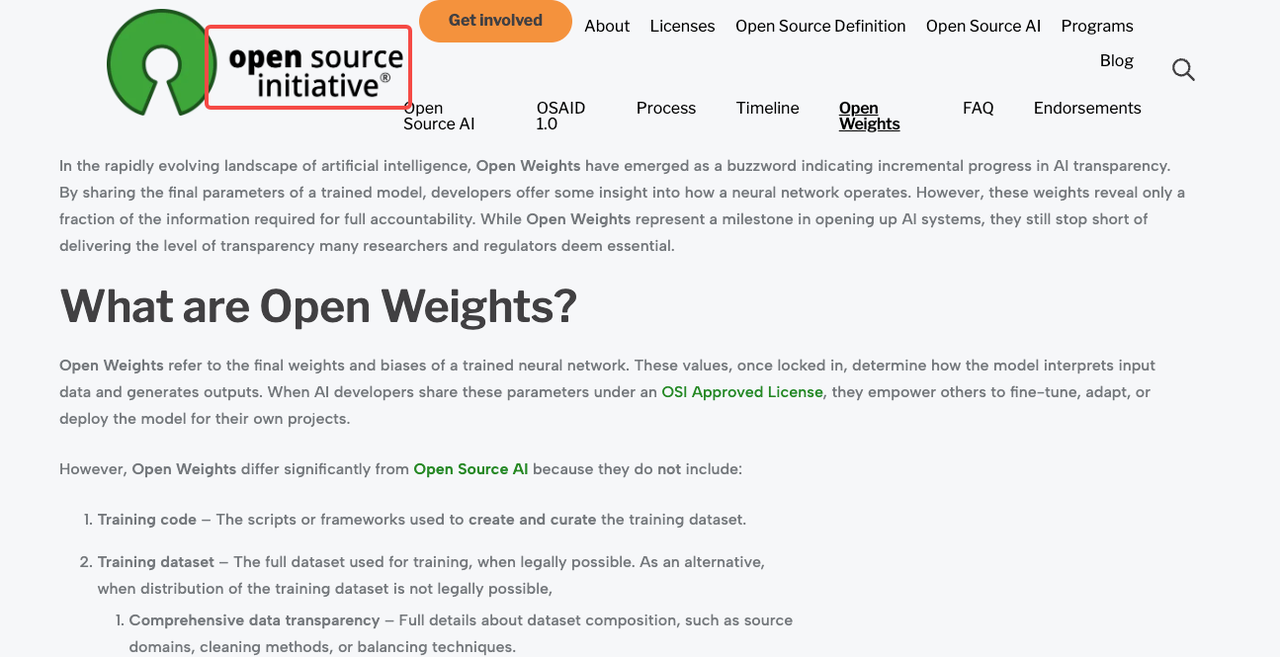

오픈 소스는 전체 패키지를 의미한다 — 웨이트, 학습 코드, 아키텍처 세부사항, 그리고 수정 및 재배포를 허용하는 라이선스. 오픈 소스 이니셔티브는 이 구분에 대해 분명히 말해왔다: 웨이트만 공개하는 것은 자격이 되지 않는다.

오픈 웨이트는 학습된 파라미터를 다운로드하고 사용할 수 있지만, 학습 데이터, 코드, 방법론은 비공개일 수 있다는 의미다. 추론을 실행하고 파인튜닝할 수 있지만, 모델을 완전히 재현하거나 감사할 수는 없다.

오픈 액세스는 API나 데모를 통해 모델을 사용할 수 있지만 다운로드 가능한 것은 없다는 의미다. 소유자가 아니라 임차인인 셈이다.

현재 HappyHorse-1.0은 세 번째 범주에 해당한다. 내일 바뀔 수도 있다. 하지만 미공개 모델을 중심으로 워크플로우를 구축하는 것은 리스크다. 특히 타임라인이 로컬 배포나 커스텀 파인튜닝에 의존한다면 더욱 그렇다.

출시 상태 추적 방법

이 분야를 지켜보고 있다면 — 그리고 지켜볼 가치가 있다고 생각한다 — 여기를 확인하라:

GitHub: 새 조직 페이지가 생기는지 주시하라. 코드가 공개되면 그곳에 올라올 것이다. 현재는 레포가 없지만, 사이트는 하나가 계획 중임을 시사한다.

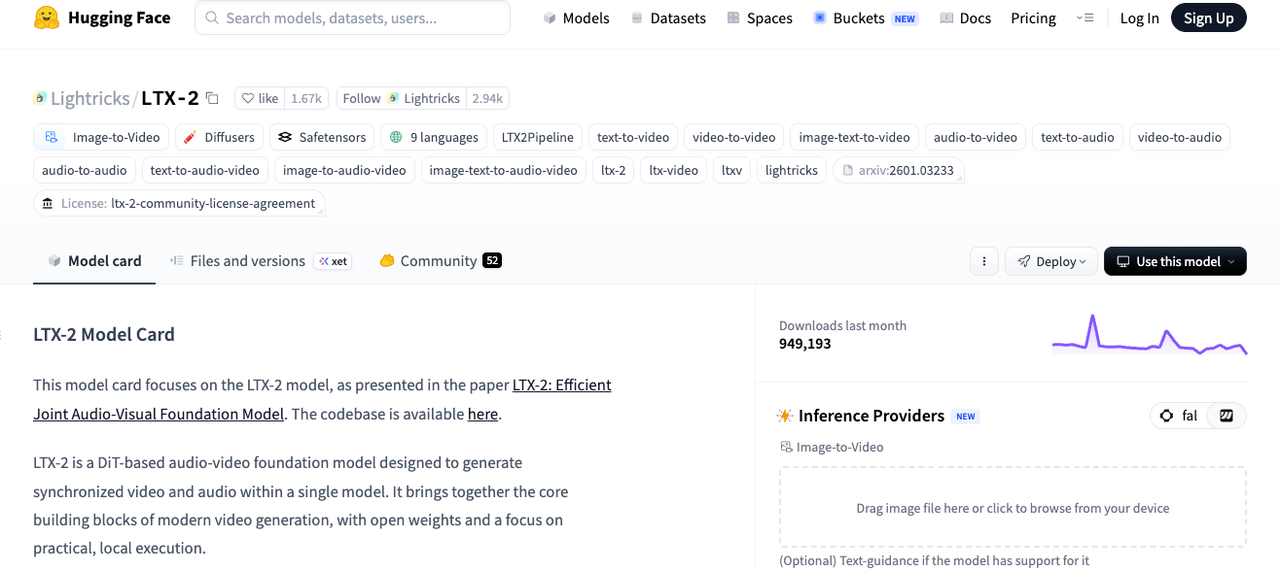

HuggingFace와 모델 허브: 모델 카드가 가장 명확한 신호가 될 것이다. 웨이트가 라이선스 파일과 함께 게시되면 그때부터 본격적으로 평가할 수 있다. HuggingFace의 모델 카드 문서에 제대로 된 출시가 어떤 모습인지 나와 있다.

커뮤니티 신호: X에서의 논의가 활발하다. 연구자들과 AI 영상 제작자들이 이미 HappyHorse 결과물을 다른 아레나 참가작들과 비교하고 있다. AI 영상 생성 관련 Reddit과 Discord 채널은 포크나 비공식 업로드가 등장하면 빠르게 노출시키는 경향이 있다.

Artificial Analysis: 이들의 영상 리더보드는 시간에 따른 성능을 추적하기에 아마도 가장 객관적인 곳이다. 투표가 더 들어오면 Elo 점수가 변동하므로, 오늘의 순위가 유지되지 않을 수 있다.

AI 영상 분야의 오픈 소스 실적: 참고 기준

실제로 오픈 웨이트 약속을 이행한 모델들과 비교하는 것이 도움이 된다고 생각한다. “진짜”가 어떤 모습인지 기준선을 제공해준다.

Lightricks의 LTX-2는 좋은 참고 사례다. 오픈 소스를 발표한 후 실제로 이행했다: HuggingFace의 전체 웨이트, 추론 코드가 있는 GitHub 레포, ComfyUI 통합, 학습 프레임워크, 명확한 라이선스. 다운로드하고, 로컬에서 실행하고, LoRA로 파인튜닝하고, 그 위에 프로덕션 워크플로우를 구축할 수 있다. 그것이 신뢰할 수 있는 오픈 웨이트 출시의 실제 모습이다.

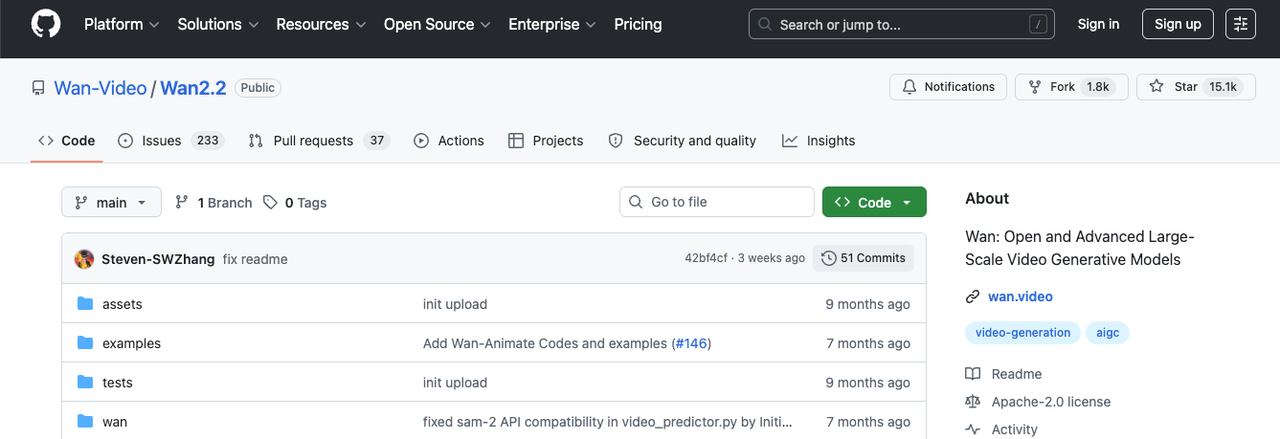

WAN 2.2도 마찬가지다. Alibaba 팀은 HuggingFace에 여러 모델 변형을 공개했다 — 텍스트-투-비디오, 이미지-투-비디오, 경량 5B 버전 — GitHub의 전체 추론 코드, Diffusers 통합, Apache 2.0 라이선싱과 함께. 커뮤니티 기여가 빠르게 따랐다: ComfyUI 래퍼, 양자화 버전, 증류 실험들.

실제로 사용 가능한지 확인하기 위해 출시에서 찾아봐야 할 것들:

- 다운로드 가능한 웨이트 (대기 목록이나 “곧 공개 예정” 페이지 뒤에 있지 않은)

- 라이선스 파일 — Apache 2.0이 상업적 사용에 가장 명확한 허가지만, 커스텀 라이선스라도 없는 것보다는 낫다

- 독점 의존성 없이 실행되는 추론 코드

- 아키텍처 세부사항, 한계점, 의도된 사용이 포함된 모델 카드

HappyHorse-1.0은 오늘 현재 이 중 어느 것도 없다. 이는 모델 품질에 대한 판단이 아니다 — 아레나 결과는 진짜 강하다는 것을 보여준다. 현재 접근성에 대한 판단이다.

FAQ

지금 당장 HappyHorse-1.0 웨이트를 다운로드할 수 있나요?

아니요. 2026년 4월 8일 현재, 공개된 웨이트가 없습니다. 공식 사이트의 GitHub와 Model Hub 링크 모두 “곧 공개 예정”으로 표시되어 있습니다. 내가 찾을 수 있었던 서드파티 업로드나 커뮤니티 포크가 없습니다.

HuggingFace에 HappyHorse-1.0이 있나요?

아직 없습니다. HappyHorse와 관련된 모델 카드, 웨이트 파일, 조직 페이지가 HuggingFace에 없습니다. 언제든지 바뀔 수 있으므로 주기적으로 확인할 가치가 있습니다.

HappyHorse-1.0은 어떤 라이선스를 사용하나요?

알 수 없습니다. 관련 사이트에서 호스팅 플랫폼 맥락에서 “상업적 사용 권리”를 언급하지만, 독립적인 모델 라이선스가 게시되지 않았습니다. 웨이트와 함께 라이선스 파일이 제공될 때까지, 자체 호스팅이나 상업적 배포에 대한 조건을 평가할 방법이 없습니다.

지금 당장 HappyHorse-1.0을 중심으로 상업적 워크플로우를 구축해도 안전한가요?

기다리는 것을 권장합니다. 다운로드 가능한 웨이트, 게시된 라이선스, 확인된 개발자 신원조차 없는 상황에서 프로덕션 사용에는 불확실성이 너무 많습니다. 오늘 당장 상업적 영상 생성을 위한 오픈 모델이 필요하다면, LTX-2와 WAN 2.2 모두 명확한 라이선싱과 함께 이용 가능합니다.

개방성 측면에서 HappyHorse-1.0은 LTX-2나 WAN 2.2와 어떻게 비교되나요?

출력 품질 면에서 HappyHorse는 경쟁력이 있습니다 — 일부 아레나 지표에서는 앞서 있을 수도 있습니다. 개방성 면에서는 지금 당장 같은 범주에 있지 않습니다. LTX-2와 WAN 2.2는 모두 게시된 웨이트, 공개 레포, 추론 코드, 정의된 라이선스를 갖추고 있습니다. HappyHorse는 데모와 약속만 있습니다. 그 간극이 좁혀질 수 있지만, 아직은 아닙니다.

GitHub 레포가 공개되면 다시 살펴볼 것이다. 모델 자체는 흥미로워 보인다 — 아레나 성과는 무시하기 어렵다. 하지만 인상적인 데모와 다운로드 가능한 웨이트는 매우 다른 것임을 알 만큼 오래 이 분야에 있었다.

지금은 지켜보고 있다. 아직 그 위에 만들지는 않는다.

WaveSpeedAI에서 HappyHorse-1.0 사용해보기

HappyHorse-1.0은 이제 WaveSpeedAI에서 이용 가능합니다:

이전 게시물: