GPT Image 2 API 가이드: 생성 및 편집

생성, 편집, 워크플로우 설계 및 일반적인 구현 고려사항을 다루는 개발자를 위한 실용적인 GPT Image 2 API 가이드.

지난주에 버튼 뒤에 이미지 생성 기능이 필요한 소규모 제품 기능을 출시했다. 빌드 이틀째 되던 날, 첫날 내린 통합 결정들이 앞으로 6개월간 내가 겪을 고통을 결정할 것임을 깨달았다. 그게 바로 GPT Image 2 API에 대해 아무도 경고해주지 않는 부분이다. Hello-world는 쉽다. 프로덕션 환경이 진짜 흥미로워지는 곳이다.

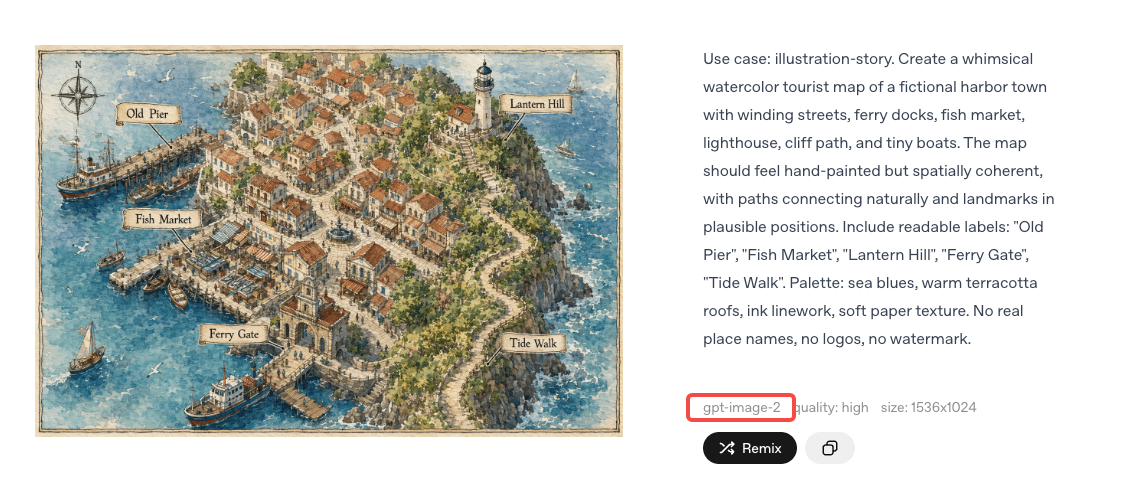

나는 Dora다. 뭔가를 출시하고 난 후에 작업 노트를 작성하는 편이다, 출시 전이 아니라. 이것은 실제 제품에 OpenAI의 gpt-image-2를 연결하면서 배운 것들이고, 첫 번째 요청을 보내기 전에 다른 개발자나 AI 엔지니어링 팀이 생각해봐야 할 것들이다.

GPT Image 2 API 사용 전 필요한 것들

모델 접근, 엔드포인트, 핵심 문서

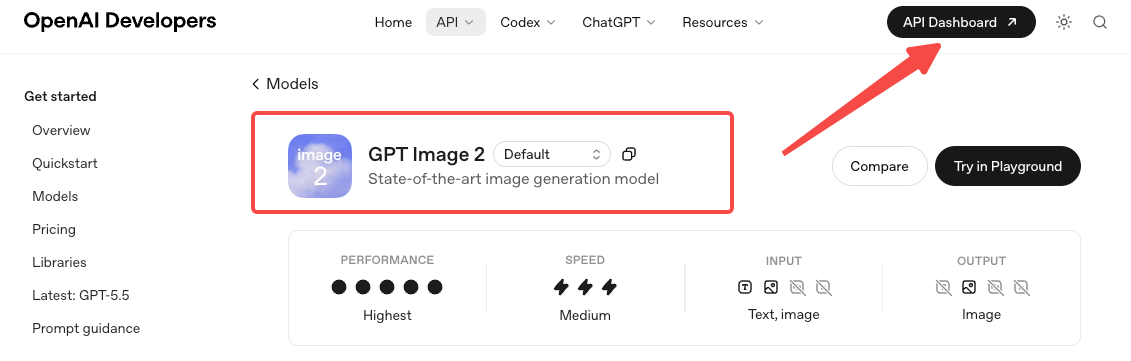

GPT Image 2는 2026년 4월 21일에 출시됐다. 모델 ID는 gpt-image-2다. 첫 번째 호출 전에 개발자 콘솔에서 API Organization Verification을 완료해야 할 수 있다 — OpenAI는 GPT Image 패밀리를 이 인증 뒤에 제한해두고 있다.

선택할 수 있는 인터페이스가 세 가지 있다. Image API는 두 개의 엔드포인트를 제공한다: 텍스트-to-이미지용 images.generate와 프롬프트 및 선택적 마스크로 기존 이미지를 수정하는 images.edit. 세 번째 인터페이스는 Responses API로, 이미지 생성을 대화형 또는 멀티스텝 플로우를 위한 내장 도구로 제공한다.

새로움이 아닌 용도에 따라 선택하라. 제품이 “사용자가 프롬프트를 입력하고 이미지를 받는” 것이라면 Image API를 사용하라. 제품이 “사용자가 때때로 이미지를 생성하는 대화를 주고받는” 것이라면 Responses API를 사용하라. 하나가 더 멋있어 보인다는 이유로 섞어 쓰는 것은 유지보수 함정이다.

GPT Image 2가 현재 지원하는 것

초기에 내면화해야 할 두 가지가 있다.

투명 배경을 지원하지 않는다. background: "transparent"를 포함한 요청은 실패한다. 투명 PNG가 필요하다면 해당 작업을 gpt-image-1.5로 라우팅하고, 이제 두 개의 모델 경로를 유지해야 한다는 사실을 받아들여라.

입력 충실도는 고정되어 있다. input_fidelity 파라미터는 구형 모델에 존재하지만, gpt-image-2는 항상 높은 충실도로 입력을 처리한다. 이 파라미터를 포함하면 요청이 실패한다. 비용 측면에서: 참조 이미지가 있는 편집 요청은 gpt-image-1 시절에 예상했던 것보다 훨씬 많은 입력 토큰을 소비한다.

GPT Image 2로 이미지 생성하는 방법

기본 요청 구조와 출력 선택

생성 요청에는 프롬프트, 크기, 품질, 출력 형식이 필요하다. 형식은 기본값이 PNG이며 JPEG나 WebP를 요청할 수 있고, 레이턴시가 중요할 때는 JPEG가 PNG보다 빠르다. 크기는 프리셋이나 커스텀 치수를 허용하며, 두 모서리 모두 16의 배수여야 하고, 최대 단일 모서리 3840px, 종횡비 3:1 미만, 총 픽셀 수 655,360~8,294,400 사이라는 제약이 있다.

n 파라미터를 사용하면 한 번의 요청으로 여러 이미지를 생성할 수 있다. 변형 이미지를 비교해야 할 때 유용하다. 출력 토큰당 비용을 지불하고 있다는 점에서는 덜 유용하다 — 실제로 그렇다.

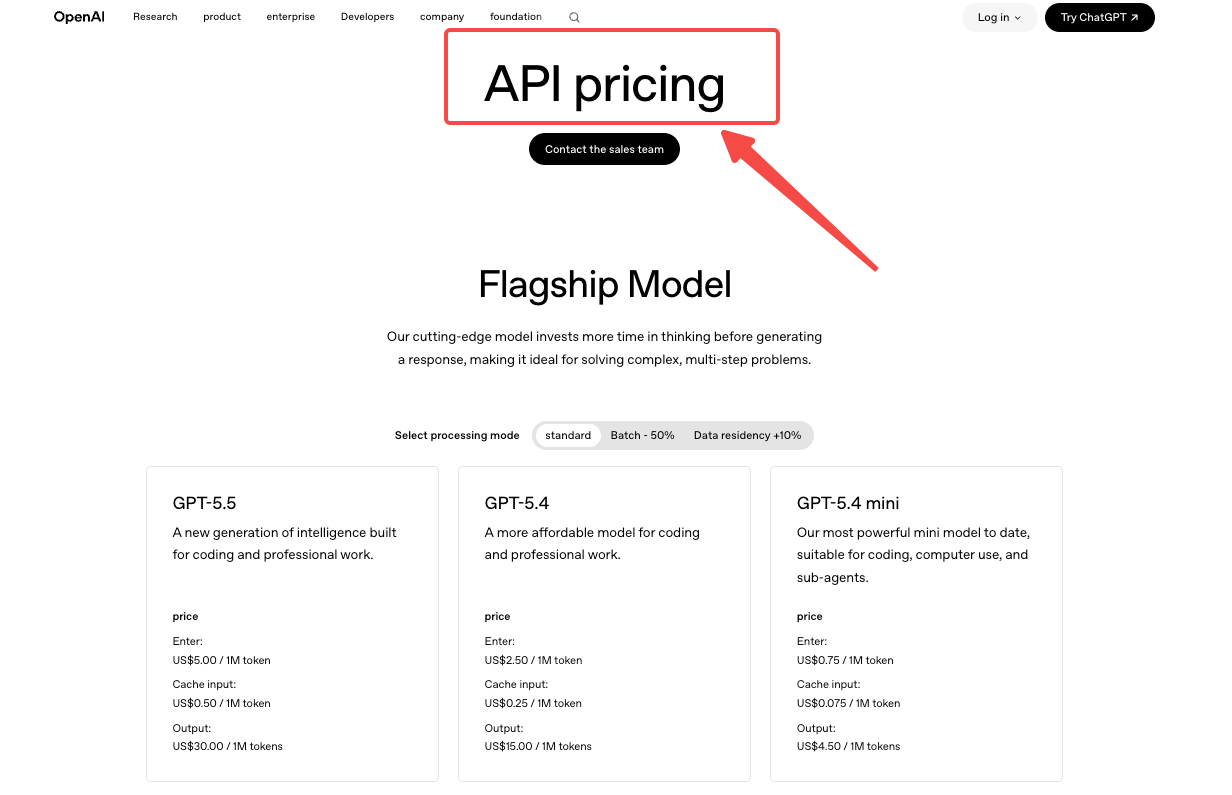

크기, 품질, 워크플로우 트레이드오프 관리

대부분의 팀이 깨닫지 못한 채 돈을 낭비하는 곳이 바로 여기다. GPT Image 2는 이미지당이 아닌 토큰당 청구된다: 이미지 입력 1M 토큰당 $8, 이미지 출력 1M 토큰당 $30, 텍스트 입력 1M 토큰당 $5. 캐시된 입력은 더 저렴하다. 배치 처리는 표준 요금을 절반으로 줄인다.

실용적인 수치로 말하자면: 1024x1024에서 OpenAI의 계산기는 낮은 품질에 약 $0.006, 중간 품질에 $0.053, 높은 품질에 $0.211로 추산한다. 1024x1536 같은 직사각형 크기는 $0.005, $0.041, $0.165로 약간 더 저렴하다. 이것은 출력만의 추산치다. 입력 토큰과 편집 참조 토큰은 추가로 계산해야 한다.

따라서 트레이드오프 질문은 어떤 품질이 가장 좋아 보이는가가 아니다. 내 사용량 기준으로 중간과 높은 품질의 비용 차이가 얼마이고, 사용자가 실제로 그것을 인식하는가이다. 썸네일 화면에서는 낮은 품질로도 충분한 경우가 많다. 사용자가 오래 볼 히어로 이미지에는 높은 품질이 값어치를 한다. 나는 중간을 기본값으로 설정하고 높은 품질을 옵트인으로 제공했다. 그 단 하나의 결정이 예상 월 청구액을 약 4배 바꿔놨다.

이미지 편집이 작동하는 방식

입력 요구사항과 일반적인 편집 시나리오

edits 엔드포인트는 이미지, 선택적 마스크, 변경 사항을 설명하는 프롬프트를 받는다. 이미지 하나를 전달해서 편집하거나, 여러 이미지를 전달해서 피사체, 스타일, 참조를 하나의 출력으로 합칠 수 있다. 모델은 인페인팅과 아웃페인팅을 처리하며, 마스크되지 않은 영역을 유지하면서 나머지에 프롬프트를 적용한다.

내가 검증한 일반적인 편집들: 제품 사진의 배경 교체, 오브젝트 제거, 두 참조 이미지 간의 스타일 전환, 이미지 내 텍스트 번역. 캐릭터 일관성 — 여러 생성된 장면에서 동일한 캐릭터 — 은 단순한 피사체에서는 잘 작동한다. 장면 복잡도가 높아질수록 신뢰도가 떨어진다.

비용을 높이거나 일관성을 낮추는 실수들

너무 큰 입력을 보내는 것. GPT Image 2는 모든 이미지 입력을 높은 충실도로 처리하기 때문에, 4K 참조 사진은 출력이 썸네일이든 포스터든 동일한 입력 토큰을 소비한다. 참조 이미지를 실제 작업에 필요한 크기로 다운스케일하라.

모호한 편집 프롬프트. “더 좋게 만들어”는 예측할 수 없는 변경을 만들고 종종 재시도 비용이 든다. “빨간 모자를 밝은 파란색 벨벳으로 바꿔”는 나머지 이미지를 유지하고 보통 한 번에 원하는 결과가 나온다.

무제한 n. “옵션을 보기 위해” n=4를 요청하는 것은 하나의 출력만 사용할 요청에 4배를 지불했다는 사실을 깨달을 때까지는 무해해 보인다.

비용 추산 시 편집을 생성처럼 취급하는 것. 편집은 참조 이미지가 입력 토큰을 추가하기 때문에 동일한 출력 크기의 생성보다 비용이 더 드는 경우가 많다. 출시 후가 아닌 출시 전에 가격 모델에 이를 반영하라.

팀을 위한 프로덕션 고려사항

재시도, 모더레이션, 운영 가드레일

프로덕션에서 선택 사항이 아닌 세 가지.

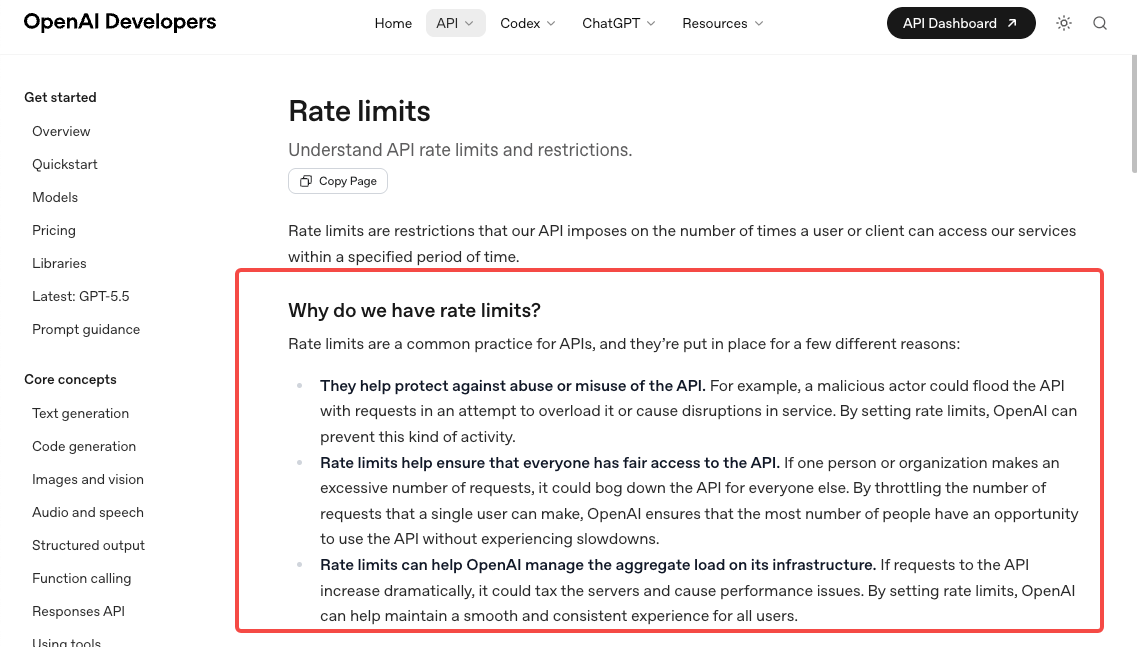

지수 백오프를 적용한 재시도. 이미지 생성은 복잡한 프롬프트의 경우 최대 2분이 걸릴 수 있으며, 레이트 리밋에 걸리게 된다. OpenAI의 가이드는 지터를 포함한 지수 백오프로 재시도할 것을 권장한다 — 지터가 중요한 이유는 플릿에서 동기화된 재시도가 동시에 동일한 레이트 한도에 도달하기 때문이다.

두 레이어의 모더레이션. 이미지 생성 엔드포인트에는 내장 moderation 파라미터가 있다 (auto가 기본값; low는 허용적이지만 여전히 필터링됨). 사용자 제출 프롬프트의 경우, gpt-image-2로 보내기 전에 무료 omni-moderation-latest 엔드포인트를 통해 실행하라 — 텍스트와 이미지 모두 허용하며, 생성 비용을 지불하기 전에 대부분의 정책 위반 요청을 차단한다. moderations API 레퍼런스에 정확한 요청 형식이 있다.

적절한 세분화로 로깅하기. 모델 ID, 크기, 품질, 프롬프트 토큰 수, 출력 토큰 수, 레이턴시, 요청 ID, 요청당 최종 비용 추산치를 로깅하라. 규모에서 뭔가 잘못됐을 때, 이 데이터가 진단을 가능하게 한다. 잘 됐을 때는 더 확장할지 결정하는 데이터가 된다. 동작이 모르는 사이에 바뀌지 않도록 부동 별칭 대신 프로덕션에서는 특정 모델 스냅샷에 고정하라. 프로덕션 베스트 프랙티스 가이드에서 키 교체, 모니터링, 나머지 운영 레이어를 다루고 있다.

직접 통합을 단순하게 유지할 때 vs 플랫폼 레이어를 추가할 때

이것이 내가 가장 오래 고민한 질문이다.

직접 OpenAI 통합이 올바른 답인 경우: 제품이 하나의 이미지 모델을 사용하고, 팀에 API 운영 경험이 있으며, 트래픽이 레이트 리밋 소유권과 1차 결제가 편의성보다 중요할 만큼 예측 가능한 경우다.

플랫폼 레이어 — 그렇다, 나는 WaveSpeedAI에서 하나를 개발하고 있다 — 는 다른 상황에서 그 가치를 발휘한다. 여러 이미지 모델을 라우팅하는 경우 (타이포그래피에는 gpt-image-2, 투명 PNG에는 다른 모델, 비디오에는 또 다른 모델). 토큰 수학 대신 예산 예측 가능성을 위한 단일 통화 요금이 필요한 경우. 제공자 변경 시 호출 사이트를 다시 작성하지 않고도 살아남는 하나의 통합 인터페이스가 필요한 경우.

어느 답이나 보편적이지 않다. 정직한 테스트: 제품이 오늘 호출하는 모델 제공자 수를 세고, 12개월 후에 호출할 수를 곱한 다음, 그 많은 통합을 직접 유지하고 싶은지 물어봐라.

FAQ

개발자들이 GPT Image 2에 어떤 엔드포인트를 사용해야 하나?

텍스트-to-이미지에는 images.generate, 프롬프트와 선택적 마스크로 기존 이미지를 수정할 때는 images.edit, 생성이 멀티턴 대화 안에 있어야 할 때는 Responses API 이미지 도구를 사용하라.

GPT Image 2는 이미지 편집을 지원하나?

그렇다. images.edit 엔드포인트는 하나 이상의 참조 이미지와 프롬프트를 받으며, 마스크된 인페인팅과 아웃페인팅을 지원한다. 모든 이미지 입력은 자동으로 높은 충실도로 처리된다.

팀이 프로덕션에서 무엇을 로깅하고 모니터링해야 하나?

최소한: 모델 스냅샷 ID, 크기, 품질, 입출력 토큰 수, 레이턴시, 요청 ID, 재시도 횟수, 모더레이션 결과, 요청당 최종 추산 비용. 이것이 모든 인시던트를 재구성하고 지출을 예측할 수 있게 해주는 것들이다.

단순한 API 통합이 더 이상 충분하지 않을 때는 언제인가?

하나 이상의 이미지 제공자를 호출할 때, 장애 모드에 크로스-프로바이더 폴백이 필요할 때, 또는 재무팀이 토큰 기반 변동성 대신 예측 가능한 단일 통화 요금을 요구할 때. 그 임계값 이하에서는 직접 통합이 더 깔끔한 선택이다.

프롬프트 인젝션과 안전하지 않은 출력이 프로덕션에 유출되지 않도록 하려면 어떻게 해야 하나?

생성 전에 사용자 프롬프트를 모더레이션 엔드포인트를 통해 실행하고, 이미지 API의 moderation 파라미터를 auto로 설정하고, 플래그된 모든 요청을 로깅하고, OpenAI의 안전 베스트 프랙티스를 따르라 — 고위험 화면에 대한 인간 검토와 출시 전 레드팀 테스트를 포함하여.

결론

GPT Image 2 API는 연결하기 어렵지 않다. 첫 번째 요청은 오후 한나절이면 된다. 중요한 결정들 — 품질 기본값, 편집 비용 모델링, 모더레이션 레이어링, 재시도 동작, 플랫폼 레이어 추가 여부 — 이야말로 출시 후 몇 달간 조용히 복리로 쌓이는 것들이다. 신중하게 선택하라. 소규모 파일럿을 먼저 진행하라. 나머지는 자연스럽게 따라온다.