Qwen3.5-Omniとは:機能、バリアント、APIアクセスの完全ガイド

Qwen3.5-OmniがPlus、Flash、Lightの3バリアントでリリース。機能、APIアクセス、本番環境での活用方法について開発者向けに解説します。

みなさん、こんにちは!Doraです、またお会いしましょう!動画プロジェクトを編集している最中に通知が届きました:Qwen3.5-Omni がリリースされたのです。ここ数ヶ月、いくつかの本番ワークフローで Qwen3-Omni ファミリーを使ってきたので、これが小さなパッチではないとすぐにわかりました。256Kコンテキストウィンドウ、音声クローニング、セマンティック割り込み、113言語の音声認識——すべてが一つのモデルに。作業を止めざるを得ませんでした。

音声エージェント、字幕パイプライン、または実際の人間の音声と映像を同時に処理しなければならないものを構築している方には、このリリースは直接関係します。実際に何ができるのか、3つのバリアントが実際には何を意味するのか、そしてアクセス方法——今日現在でまだ不明な点も含めて——をご説明します。

Qwen3.5-Omniが実際にできること

テキスト、画像、音声、動画を単一の推論呼び出しで処理

AIの発表でいつも過小評価されていることがあります:ネイティブマルチモーダル処理と、つなぎ合わせたパイプラインによるマルチモーダル処理は同じではありません。

ChatGPT 5.4のような非オムニモーダルモデルが動画を入力として受け取る場合、ビジョンモデルでフレームを抽出し、Whisperのようなもので音声を文字起こしし、埋め込み字幕を読むためにOCRを適用しなければなりません——真のオムニモデルが単一パスで行うことを近似するために、3つの別々のプロセスをつなぎ合わせています。理想的な条件で、明るい映像とクリーンな音声であっても、ある実際のテストでは9分かかりました。

Qwen3.5-Omniは同じ入力を1回の呼び出しで処理します。動画を送信すれば、レスポンスが返ってきます。中間パイプラインなし。フォーマット変換のオーバーヘッドなし。画面上の状況がわからない音声モデルや、何も聞こえないビジョンモデルもありません。

このモデルはテキスト、画像、音声、音声-動画の理解をサポートし、ThinkerとTalkerコンポーネントの両方がHybrid-Attention MoEアーキテクチャを使用しています。最後の点は聞こえるより重要で、以下のアーキテクチャセクションで説明します。

「オムニモーダル」の実際の意味 vs. つなぎ合わせたパイプライン

この違いは、つなぎ合わせたシステムにとって本当に難しいシナリオで現れます。たとえば:誰かがコーディングしながら同時にナレーションしている画面録画。あるいは、コンテキストの半分が口頭で半分が画面上にあるカスタマーサービス通話。または、周囲の音声と視覚的なアクションが独立して意味を持つアクセシビリティ字幕ワークフロー。

Qwenチームは「Audio-Visual Vibe Coding」と呼ぶものをデモしました——このモデルはコーディングタスクの画面録画を見て、テキストプロンプトなしで純粋に見たものと聞いたものだけに基づいて機能的なコードを書くことができます。

変わったデモ名ですが、これは音声を後付けしたテキストファーストモデルと比較した場合の実際の能力差です。推論と知覚が同じモデル内で同時に行われると、クロスモーダルなコンテキストを必要とするものが実際に機能します。

3つのバリアント:Plus、Flash、Light

Plus——コストに見合う場合のベンチマークリーダー

Qwen3.5-Omni-Plusは音声と音声-動画の理解、推論、インタラクションタスクにわたって215のSOTA結果を達成しました。これは大きな数字で、Alibabaのベンチマークは積極的にカウントする傾向がありますが、独立した比較が重要なカテゴリでこれを裏付けています。

標準的なベンチマークでは、Qwen3.5-Omni Plusは一般的な音声理解、推論、翻訳タスクでGemini 3.1 Proを上回り、音声-ビジュアル理解では同等でした。20言語にわたる多言語音声の安定性では、ElevenLabs、GPT-Audio、Minimaxを上回りました。

音声クローニングはPlusとFlashの両方でAPI経由で利用可能です——10〜30秒の音声サンプルを送信すると、モデルがそれを出力用にクローンします。

いつPlusにお金を払うべきか?出力品質がユーザーが実際に気づくものである場合です。音声の自然さがコアバリュープロポジションである音声エージェント製品。まれな言語での精度が重要な高リスクな文字起こし。GeminiやGPT-Audioと直接比較して、品質で勝つ必要がある場合。

Flash——スループットとレイテンシのトレードオフ

Flashは、APIドキュメントによると本番使用のデフォルト推奨です。モデルIDは標準バリアントの場合qwen3.5-omni-flashで、Flashはほとんどの本番シナリオでレイテンシ、品質、レスポンスのバランスを取る際のデフォルトとして説明されています。

AIアシスト型ワークフローを構築するクリエイター——自動字幕パイプライン、リアルタイムインタビュー文字起こし、スケールでの動画要約——にとって、Flashはほぼ確実に出発点です。Plusと比較してバッチテストを行い、特定のユースケースでの品質差がコスト差に見合うかどうかを確認します。

前身のQwen3-Omni Flashはすでに234ミリ秒という低いレイテンシでストリーミング音声レスポンスを持っていました。Qwen3.5-Omni Flashも同様の範囲になると予想されますが、3.5専用の正確な公開レイテンシベンチマークは初期リリースノートでは確認されていません。

Light——エッジとバジェットユースケース

Lightはこのファミリーの最小バリアントです。3.5-Omniシリーズのパラメータ数は執筆時点では完全に確認されていませんが、前身の30B-A3Bモデルは適切な量子化で消費者向けハードウェアで比較的うまく動作しており、ここでのLightバリアントも同様のパターンに従う可能性があります。

プロトタイプを作成している場合、推論コストが厳しいクライアント向けに何かを構築している場合、またはエッジで本当に動作させている場合は、Lightから始めます。「悪いもの」として切り捨てないでください——多くのクリエイターツールワークフロー(自動サムネイル字幕、アップロードされた音声に対するシンプルなQ&Aなど)では、おそらく十分以上です。

Qwen3-Omniからの新機能

コンテキストウィンドウ:256Kトークン、10時間以上の音声

これは実際の本番観点から私が最も重視している変更です。

256Kトークンのコンテキストウィンドウは、10時間以上の音声、または音声付きの720p動画約400秒に相当します。これは意味のある飛躍です。前身のQwen3-Omniのシンキングモードは最大65,536トークン、32,768トークンの推論チェーンで最大でした——有用ですが、長尺メディアには限界がありました。

ポッドキャスト分析、長尺インタビュー処理、長い顧客通話の要約——このコンテキストウィンドウは、単一のAPI呼び出しで実際に何が実行可能かを変えます。

言語カバレッジ:認識113言語、生成36言語

音声認識は前身の19から113言語・方言に拡大しました。音声生成は10言語から36言語に拡大しました。

正直なメモ:Alibabaは地域方言を、たとえばOpenAIが同じカバレッジをカウントする方法と比較して数を増やす方法でカウントします。それを差し引いても、増加は本物です。東南アジア市場、アラビア語コンテンツ、または多言語音声ワークフローを構築している場合、これは実質的な改善です。

Hybrid-Attention MoEを備えたThinker-Talker

Thinker-TalkerアーキテクチャはQwen2.5-Omniで初めて導入されました。3.5-Omniでの重要なアップグレードは、両コンポーネントがHybrid-Attention MoE(Mixture-of-Experts)設計を使用するようになったことで、より広いQwen3.5ファミリーのスパースアーキテクチャへのシフトと一致しています。

開発者にとってこれが重要な理由:Thinker-Talkerの分割により、外部システム——RAGパイプライン、安全フィルター、関数呼び出し——が音声合成が始まる前に2つのステージの間に介入できます。これは単なるアーキテクチャの詳細ではありません。モデルが推論することと実際に声に出して言うことの間に独自のロジックを組み込むことができることを意味します。本番音声エージェントにとって、これは本当に有用です。

セマンティック割り込みと音声クローニング

音声ボットを展開したことのある人なら誰でもその苦痛を知っています:ユーザーが咳をする、犬が吠える、誰かが「うーん」と言う、するとボットは割り込まれていると思って返答の途中で止まってしまいます。

Qwen3.5-Omniはセマンティック割り込みを追加し、ユーザーが本当に話に割り込みたいのか、周囲の背景音やちょっとしたコメントなのかを区別しようとします。これは変更履歴では些細なことのように聞こえる機能の一つですが、実際には人々が不満を感じる音声アシスタントと使い続けるものとの違いです。

音声クローニングと速度、音量、感情のリアルタイム音声コントロールも新機能です。チームはARIAと呼ばれる機能について言及していますが、これは音声出力の安定性と自然さを向上させるもので——ARIAが内部でどのように機能するかの技術的詳細は初期リリースでは詳述されていません。

Qwen3.5-Omniへのアクセス方法

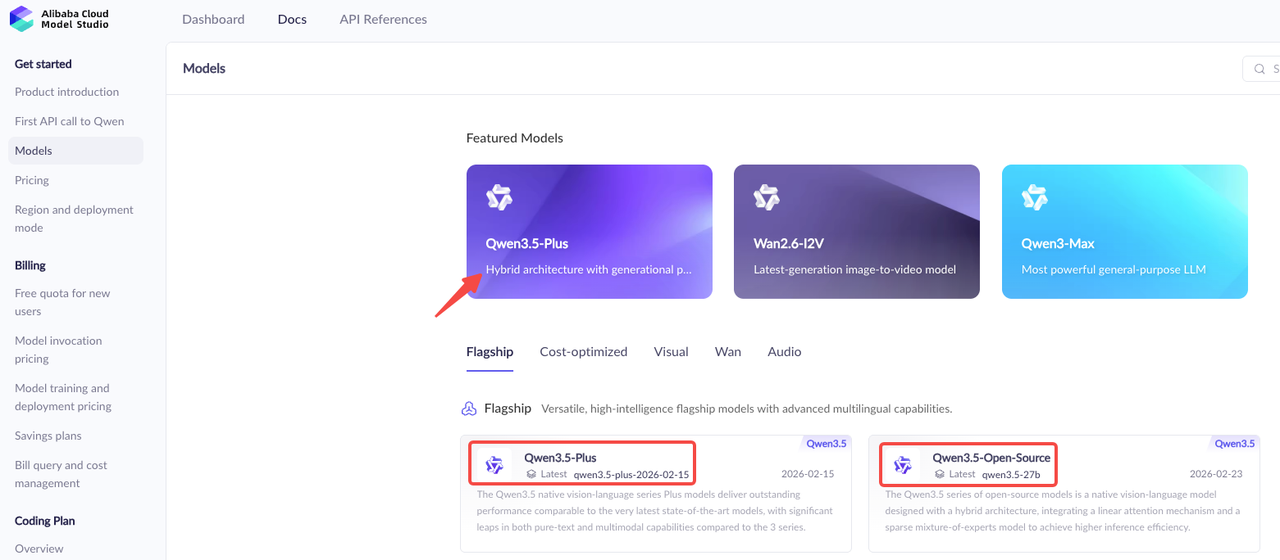

DashScope API(Alibaba Cloud)

主要な本番アクセスパスはAlibaba CloudのDashScope APIを通じてです。OpenAI互換インターフェースを使用しているため、すでにOpenAI SDKを通じてGPT-4oやClaudeを使用している場合、移行は簡単です。

DashScopeは複数のリージョンをサポートしています:シンガポール(国際)、米国バージニア、中国北京、香港、それぞれ異なるエンドポイントURLがあります。中国以外のチームのほとんどにとって、シンガポール国際エンドポイントがデフォルトです:dashscope-intl.aliyuncs.com。

3つのバリアントのモデルIDはqwen3.5-omni-plus、qwen3.5-omni-flash、qwen3.5-omni-lightというパターンに従います。API構造は標準的な/v1/chat/completionsフォーマットで、レスポンスにテキスト、音声、またはその両方が必要かを指定するmodalitiesパラメータがあります。

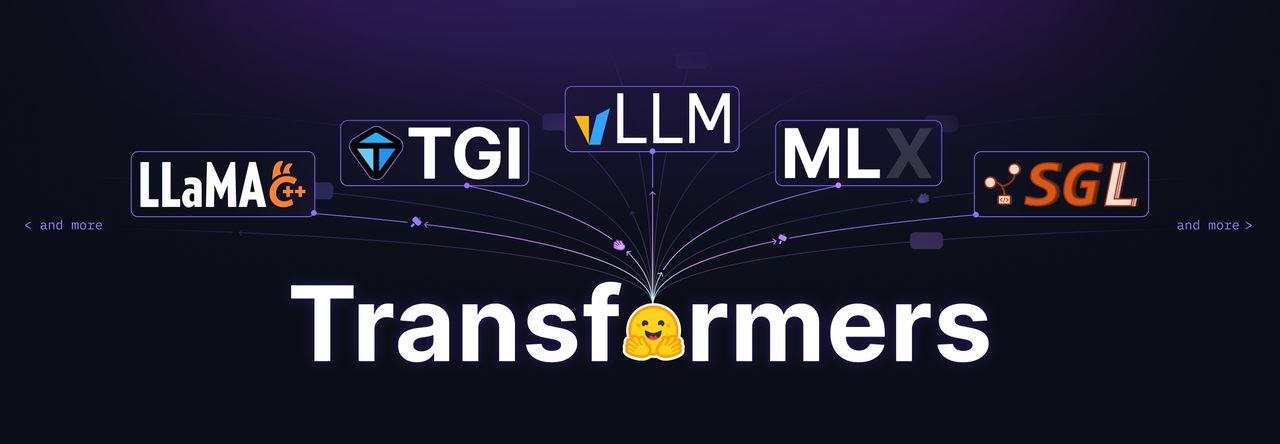

vLLMセルフホスティングオプション

Qwenチームは、Qwen-Omniシリーズモデルの推論とデプロイメントにvLLMを強く推奨しており、HuggingFace TransformersとvLLMの両方の完全なランタイム環境を含むDockerイメージを提供しています。

注意点として、MoEモデルでのHuggingFace Transformersによる推論速度は非常に遅くなる可能性があるため、大規模または低レイテンシ要件には、vLLMまたはDashScope APIが推奨パスです。

セルフホスティングする場合は、vLLM 0.13.0を計画してください——それが公式セットアップドキュメントで参照されているバージョンです。MoEアーキテクチャは、同じ品質レベルの同等の密なモデルよりもメモリ要件が低いことを意味しますが、本番デプロイメントを開始する前にGPUの割り当てを検証したいでしょう。

オープンウェイトの状況:確認済みと保留中

これについては慎重に、確認されたことを超えて推測しないようにしたいです。

Qwen3-Omni(前身)はGitHubとHuggingFaceでApache 2.0の下でリリースされました。Qwen3.5-Omniのウェイトが同じApache 2.0ライセンスパスに従うかどうかは、初期発表では確認されていません。前身のウェイトは公開されています——3.5のウェイトも続く可能性がありますが、3月30日のリリース日現在、その確認は保留中です。

公式GitHubリポジトリまたはHuggingFaceモデルカードがライセンスを確認するまで、オープンウェイトデプロイメント計画をこれに基づいて構築しないでください。更新についてはQwenLM GitHubを確認してください。

このリリースに注目すべき人

音声エージェントとリアルタイム会話ビルダー

音声ファーストアプリケーション——カスタマーサービスボット、AIコンパニオン、インタラクティブ音声ツール——を構築している場合、Qwen3.5-Omniは真剣に評価する価値があります。セマンティック割り込みだけでも、すべての音声エージェント開発者が経験した既知の痛点に対処します。ネイティブ関数呼び出しとウェブ検索を加えると、これは研究リリースではなく実際のインフラのように見え始めます。

Qwenのブログ投稿は、オムニモデルに直接組み込まれたネイティブウェブ検索と関数呼び出しのサポートを強調しており、これを研究成果というよりも音声ファーストアプリケーションのインフラとして位置づけています。

音声-ビジュアル制作と字幕ワークフロー

クリエイターツール、動画制作オートメーション、スケールでの字幕作成——これはオープンウェイトのマルチモーダル空間で現在最も魅力的なリリースです。10時間以上の音声コンテキストは、1回の呼び出しで全長コンテンツを処理できることを意味します。拡張された言語カバレッジは、多言語コンテンツがもはや特別なケースではないことを意味します。

単一の推論呼び出しでの音声理解と動画フレーム分析の組み合わせは、自動ハイライト抽出、Bロール字幕、画面上のテキスト相関を含む音声-ビジュアル文字起こしなどにとっても本当に有用です。

すでにQwen3-Omniを本番で運用しているチーム

Qwen3-Omniがすでにスタックに含まれている場合、Qwen3.5-Omniへのアップグレードは簡単です。API構造は一貫しています。コンテキストウィンドウのアップグレードだけでも、既存のワークロードでテストする価値があります——特に65Kトークンの上限に当たっていたものは。

カバーしていないこと

画像生成モデルではない

「オムニモーダル」が混乱を生むので明確に言っておく価値があります:Qwen3.5-Omniはテキストと音声を生成します。画像や動画は生成しません。入力として画像や動画を理解します——それは完全に異なる能力です。画像生成が必要な場合は、QwenのVLおよび画像生成モデルライン、またはDashScopeカタログのqwen-image-plusモデルを検討してください。

MoEでの推論速度:vLLM vs. HuggingFace Transformers

これはQwen3-Omniで多くの人がつまずいており、3.5-Omniでも同様につまずく人がいるでしょう。Qwen3-OmniはMoEアーキテクチャを採用しているため、MoEモデルでのHuggingFace Transformersによる推論速度は非常に遅くなる可能性があります。大規模な呼び出しや低レイテンシ要件には、vLLMまたはDashScope APIが強く推奨されます。

HuggingFace Transformersでベンチマークを取って、モデルが遅いと結論づけないでください。本番実行可能性についての見解を形成する前に、vLLMまたはマネージドAPIでテストしてください。

よくある質問

Qwen3.5-Omniはオープンソースまたはオープンウェイトですか?

2026年3月30日のリリース時点では、Qwen3.5-Omniのオープンウェイト状況は公式に確認されていません。前身のQwen3-OmniはApache 2.0オープンウェイトで、HuggingFaceで利用可能でした。3.5-Omniでも同様のリリーススケジュールが期待されますが、依存する前に公式のQwenLM GitHubで確認してください。

Qwen3.5-Omni-Plusをセルフホストできますか?

DashScope APIは現在確認されている本番パスです。vLLMを通じたセルフホスティングはQwen3-Omniでサポートされており、ウェイトがリリースされれば3.5-Omniでもサポートされる可能性があります。PlusバリアントのMoEアーキテクチャは、同等の密なモデルよりもアクティブパラメータ要件が低いことを意味しますが、フルPlusバリアントにはマルチGPUセットアップが必要です。

関数呼び出しとウェブ検索をネイティブでサポートしていますか?

はい。Qwenのブログ投稿は、オムニモデルに組み込まれたネイティブウェブ検索と関数呼び出しのサポートを明示的に強調しています。関数呼び出しはDashScope API経由で標準のOpenAIツールフォーマットに従います。これは意味のある差別化要因です——別のオーケストレーションレイヤーを経由せずにライブデータをクエリする音声エージェントを構築できます。

過去の投稿: