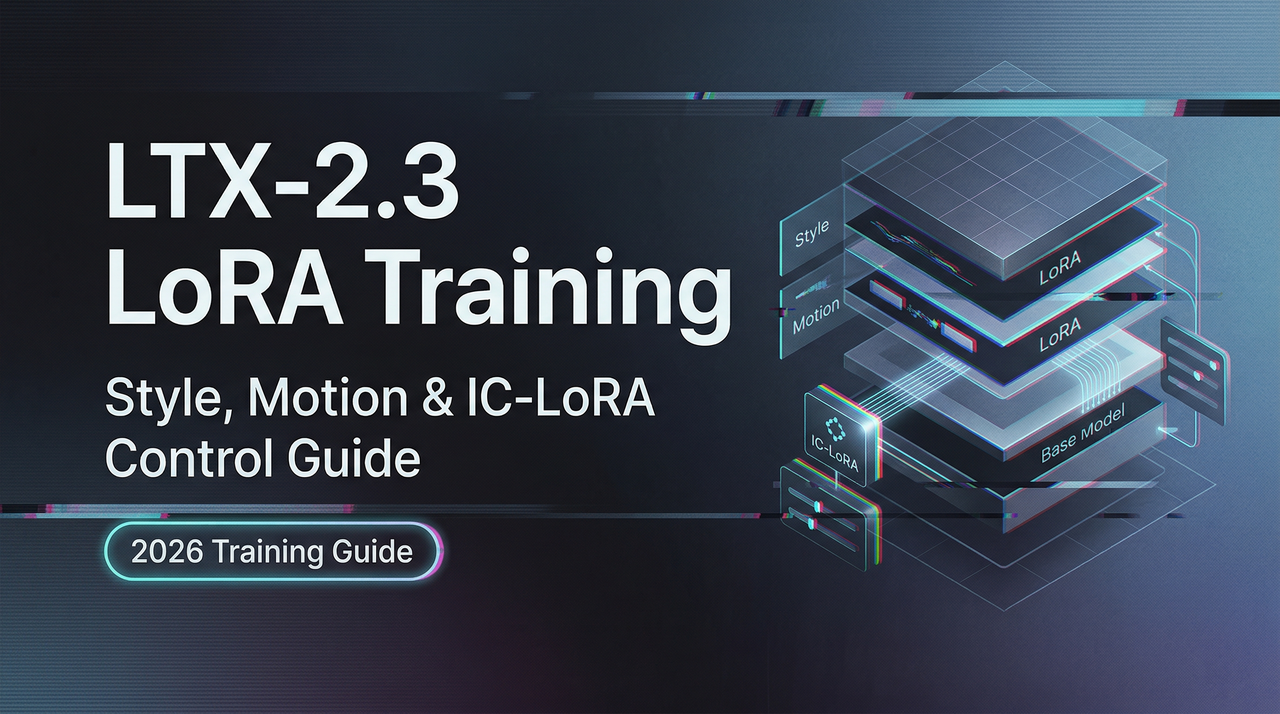

LTX-2.3 LoRAトレーニングガイド:スタイル、モーション、IC-LoRAコントロール(2026年)

公式ltx-trainerを使用してLTX-2.3でカスタムLoRAをトレーニングする方法を解説。スタイルLoRA、IC-LoRA構造制御、ランク設定、データセット準備、よくあるトレーニングエラーを網羅。

やあ、友よ。Doraだよ。

LoRAのトレーニングに1週間費やすつもりはなかった。特定のモーションパターンに従うプロダクトデモが必要だっただけで、テキストプロンプトでは対応しきれなかった。その小さな摩擦がLTX-2.3のトレーニングへの道へと誘い、発見したものに驚いた——革命的だからではなく、どの設定が本当に重要かを知れば、静かに実用的だからだ。

これは包括的なリファレンスではない。2026年3月にスタイル、モーション、IC-LoRAコントロールのワークフローをテストして学んだことだ。

LTX-2.3の公式トレーナーに含まれるもの

LTX-2 GitHubリポジトリは、ltx-core(モデル実装)、ltx-pipelines(生成ワークフロー)、ltx-trainer(LoRAおよびIC-LoRAのファインチューニング)の3つのパッケージを持つモノレポとして構成されている。幅と高さの設定は32の倍数でなければならず、フレーム数は8n+1ルール——つまり1、9、17、25フレームなど——に従う必要がある。

最初のトレーニングではこれを無視していた。トレーナーがエラーを出し、手動でフレームをパディングして、それで動いた。小さな制約だが、最初から知っておく価値がある。

3種類のLoRAとそれぞれの使い所

スタイルLoRA(外観、テクスチャ、色)

スタイルLoRAはLTX-2.3に視覚的な美学——カラーグレーディング、テクスチャ処理、ライティングの雰囲気——を教える。一貫した白い背景とソフトな影を持つプロダクト写真でトレーニングした。キャラクターやスタイルのLoRAなら、20〜50枚の画像で十分な結果が得られることが多いが、非常に特定の被写体には80〜120枚まで増やすこともある。

画像のみのデータセットでも問題ない。最初のいくつかのLoRAでは、動画クリップではなく静止フレームを使った——キュレーションが簡単で、モーションを処理せずにモデルがアイデンティティを学習できる。

モーション/エフェクトLoRA(動き、変換)

モーションLoRAは見た目よりも動き方に焦点を当てる。カメラパン、オブジェクトの回転、変換シーケンス。これには静止画ではなく、短く一貫した動画クリップが必要だ。一定のフレーミングで15秒のクリップを使ってドリーインモーションLoRAをテストしたところ、モデルは異なる被写体にまたがってその動きのパターンを学習した。

モーションのトレーニングはスタイルほど安定していなかった。より多くの試行錯誤と、より変動的な結果が伴った。

IC-LoRA(構造制御:深度、ポーズ、Cannyエッジ)

IC-LoRAは異なる。新しい美学やモーションをモデルに教えるのではなく、参照シグナル——深度マップ、ポーズスケルトン、エッジ検出——に基づいて生成を条件付けする。IC-LoRAは推論時に参照動画フレームに基づいて動画生成を条件付けることを可能にし、テキストから動画へのベースモデルの上に細かい動画間制御を実現する。

深度IC-LoRAを使って、視覚コンテンツを完全に変えながらカメラの動きをロックした。公式IC-LoRAガイドでは、3つのコントロールモードをわかりやすく説明している:エッジ保存のためのCanny、カメラと空間ジオメトリのためのDepth、人体モーション転送のためのPose。

データセット準備のルール

フレーム数の制約(8n+1ルール)

フレーム数は8の倍数+1でなければならない。これはゆるいガイドラインではない——クリップが10フレームや15フレームの場合、トレーナーはエラーを出すか内部的にパディングする。アップロード前にデータセットを17フレーム(2×8+1)にバッチ処理し、トレーニングはスムーズに進んだ。

解像度の整除可能性(32pxルール)

幅と高さは32の倍数でなければならない。1024×576にバッチリサイズした後にトレーナーが静かに1024×608にパディングするのを見てから学んだ。最初から正しくリサイズした方がいい。

動画vs画像データセット:それぞれの使い所

画像のみのデータセットはLTX-2.3 LoRAトレーニングに有効だ。これは、特にアイデンティティやスタイルLoRAの場合、早い段階でモーション学習を強制するよりはるかに簡単だ。すべてのプロジェクトを静止画から始め、外観を検証してから、モーションが重要な場合に短い動画クリップを追加した。

モーションが多い作業では、長いマルチシーンのセグメントより短く一貫したクリップの方が優れている。

ベースラインのトレーニング設定

正しいデフォルトとしてのランク32と、より高くする場面

LTX-2.3では、ランク32が正しいデフォルトだ。通常、LoRAを早期に硬直させすぎることなく十分な容量を提供する。複雑なスタイルLoRAでランク64をテストしたが、改善はほぼなかった——データセットが大きくも多様でもなかったため、追加容量は役立たなかった。

学習率の出発点と変更する場面

LTX-2.3 LoRAトレーニングでは、1e-4が出発点として適切だ。退屈な答えが正しい答えである事例の一つだ。最初の4つのLoRAで学習率に手を加えず、すべてクリーンに収束した。

ステップ数:早期停止のタイミングの見極め方

多くのユーザーは、チェックポイント250、500、または750がすでに良好に見えるかどうかを確認せずに、高いステップ数に直接ジャンプして時間を無駄にする。チェックポイント500でサンプリングし、LoRAがすでに良好に見えればそこで停止する。チェックポイント750や1000でLoRAがすでに良好に見えるなら、さらに進めるとより脆くなるだけだ。

オーバーフィッティングは、モデルが汎化するのではなくトレーニングデータを記憶することとして現れる。バリデーションサンプルがトレーニングフレームと同一に見え始める。

IC-LoRA:深度、ポーズ、エッジコントロール

IC-LoRAが標準スタイルLoRAと異なる点

IC-LoRAはモーションと視覚スタイリングを分離する。テキストとスタイルLoRAで外観を操り、構造化されたガイドでモーションを操る。LTX-2.3 IC-LoRAユニオンコントロールモデルは、単一のアダプターで複数のコントロールシグナル——深度、ポーズ、エッジ——をサポートする。

プロダクトターンテーブルシーケンスで深度IC-LoRAを実行した。カメラパスは参照深度マップにロックされたままだったが、視覚コンテンツはプロンプトに基づいて完全に変わった。

ComfyUI IC-LoRAワークフローの統合

RunComfy LTX 2.3 IC-LoRAワークフローは、深度、ポーズ、エッジの抽出を自動的に処理する。参照クリップを読み込み、コントロールモードを選択し、スタイルに焦点を当てたプロンプトを書けば、モデルがモーションを別途処理する。

最初に見落としていた詳細:IC-LoRAがモーションと構造を処理するため、プロンプトは外観に焦点を当てること。IC-LoRAがコントロールしている状態でプロンプトにカメラの動きを記述しようとすると、競合が生じる。

よくあるトレーニングの失敗と修正

LoRAがあらゆるものに滲み出す(DOPの解決策)

DOP(Dropout of Prompts)は、LoRAがあらゆるものに滲み出し始めたときに最初に試す価値のある高度なオプションだ。同様のアイテムには良好に機能したが、無関係の被写体に影響を与え始めるプロダクトスタイルLoRAをトレーニングした。キャプションドロップアウトを追加することでLoRAの汎化が改善された。

高ステップ数でのオーバーフィッティング

より多くのステップを普遍的な品質向上として扱わないこと。モーションLoRAを2,000ステップまで実行し、基礎となるパターンを学習するのではなく、正確なトレーニングフレームを再現し始めるのを見た。チェックポイント750にロールバックした。

キャプションドロップアウトとキャッシュテキスト埋め込みの競合

キャプションドロップアウトを使用している場合、Cache Text EmbeddingsはOFFのままにすべきだ。これは、誤って使用するとトレーニングの動作を静かに悪化させる数少ない小さな設定の一つだ。両方を有効にして一貫性のない結果を得た——モデルはキャッシュされた埋め込みに依存するか、欠落したキャプションを処理するかを決めかねていた。

デプロイ前のLoRAの検証

LoRAが完成したと呼ぶ前に3つの検証テストを実行する:LoRAありとなしで同じプロンプトを使って期待通りのものを追加していることを確認、汎化をチェックするためにバリエーションのあるプロンプト、そしてトレーニングセットに含まれていないエッジケース。LoRAがトレーニングキャプションに近いプロンプトでのみ機能するなら、オーバーフィットしている。

よくある質問

A100や小型GPUでLoRAをトレーニングできますか?

LTX-2.3のトレーニングは公式にはNvidia H100 GPU(80GB以上のVRAM)を対象としているが、グラジエントチェックポインティングと解像度の削減により、より低いVRAMのセットアップでも動作できる。A100トレーニングは自分でテストしていないが、公式トレーナードキュメントでは、これが推奨ハードウェアのベースラインとして記載されている。

H100でスタイルLoRAのトレーニングにどのくらい時間がかかりますか?

フィールドレポートによると、バリデーションと小さな再起動を含む中規模データセットの場合、単一の4090で1つのLoRAsに約3〜5時間かかる。H100はより速いはずだが、直接的な数値は持っていない。

LTX-2のLoRAはLTX-2.3で再トレーニングなしに動作しますか?

いいえ。LTX-2.3はより高品質なデータでトレーニングされた完全に再設計されたVAEを搭載し、テキストコネクタのアーキテクチャも変更された。LTX-2の古いLoRAはクリーンに移行できない——これをテストしてビジュアルアーティファクトを確認した。

IC-LoRAをスタイルLoRAと組み合わせることはできますか?

はい。最大3つのLoRAアダプターを同時にスタックし、カスタム美学と構造コントロールをブレンドできる。IC-LoRAローダーの前にスタイルLoRAを実行し、IC-LoRAがジオメトリとタイミングを維持できるようにその重みを適度に保った。

クラウドプラットフォームでLoRAトレーニングは利用できますか?

はい。RunComfy AI Toolkitとfal.aiは、GPUインフラを管理せずにブラウザベースのトレーニングを提供している。データセットをアップロードし、パラメーターを設定し、完了したらLoRAをダウンロードするだけだ。

LTX-2.3のLoRAトレーニングは魔法ではない。 データセットの準備、ベースライン設定、そして早期停止のタイミングを知ることだ。8n+1フレームルールと32px整除可能性の制約は最初は恣意的に感じるが、それはただモデルのジオメトリ要件に過ぎない。それらに逆らうのではなく、それらと共に作業すること。

私を驚かせたのは複雑さではなかった——最初の実行ですべてのパラメーターを調整する代わりに、ランク32と1e-4の学習率に固執することで節約できた時間の多さだった。

以前の投稿: