GPT Image 2 API 生成・編集ガイド

生成、編集、ワークフロー設計、および一般的な実装上の考慮事項を網羅した、開発者向けの実践的なGPT Image 2 APIガイドです。

先週、ボタンの裏で画像生成を動かす小さなプロダクト機能をリリースした。ビルド開始から2日後、初日に下した統合の選択が、これからの6ヶ月間の苦労を決定づけると気づいた。それが、GPT Image 2 APIについて誰も警告してくれない部分だ。Hello worldは簡単。本番環境での運用こそが面白くなるところだ。

私はDoraだ。何かをリリースした後に、リリース前ではなく、作業メモを書く。これはOpenAIのgpt-image-2を実際のプロダクトに組み込んで学んだこと、そして最初のリクエストを送る前に別の開発者やAIエンジニアリングチームに考えてほしいことだ。

GPT Image 2 APIを使用する前に必要なこと

モデルアクセス、エンドポイント、主要ドキュメント

GPT Image 2は2026年4月21日にリリースされた。モデルIDはgpt-image-2だ。最初のAPI呼び出しの前に、開発者コンソールでAPIオーガニゼーション認証を完了する必要があるかもしれない — OpenAIはGPT Imageファミリーをその認証の裏に置いている。

選べるサーフェスは3つある。Image APIは2つのエンドポイントを公開している: テキストから画像へのimages.generateと、プロンプトとオプションのマスクを使用して既存の画像を修正するimages.editだ。3つ目のサーフェスはResponses APIで、会話型またはマルチステップのフローのための組み込みツールとして画像生成を公開している。

目的に応じて選ぶ、目新しさではなく。 プロダクトが「ユーザーがプロンプトを入力して画像を取得する」ものなら、Image APIを使え。プロダクトが「ユーザーが時々画像を生成する会話のやり取りをする」ものなら、Responses APIを使え。一方がかっこよく見えるからと混在させると、メンテナンスの罠になる。

GPT Image 2が現在サポートしていること

早めに把握しておくべきことが2つある。

透明な背景をサポートしていない。 background: "transparent"を指定したリクエストは失敗する。透明なPNGが必要なら、それらのタスクをgpt-image-1.5にルーティングし、2つのモデルパスを管理することを受け入れること。

入力精度は固定されている。 input_fidelityパラメーターは古いモデルには存在するが、gpt-image-2は常に高精度で入力を処理する。パラメーターを省略しないとリクエストが失敗する。コストへの影響: 参照画像を使った編集リクエストは、gpt-image-1時代の予想よりも多くの入力トークンを消費する。

GPT Image 2で画像を生成する方法

基本的なリクエスト構造と出力の選択

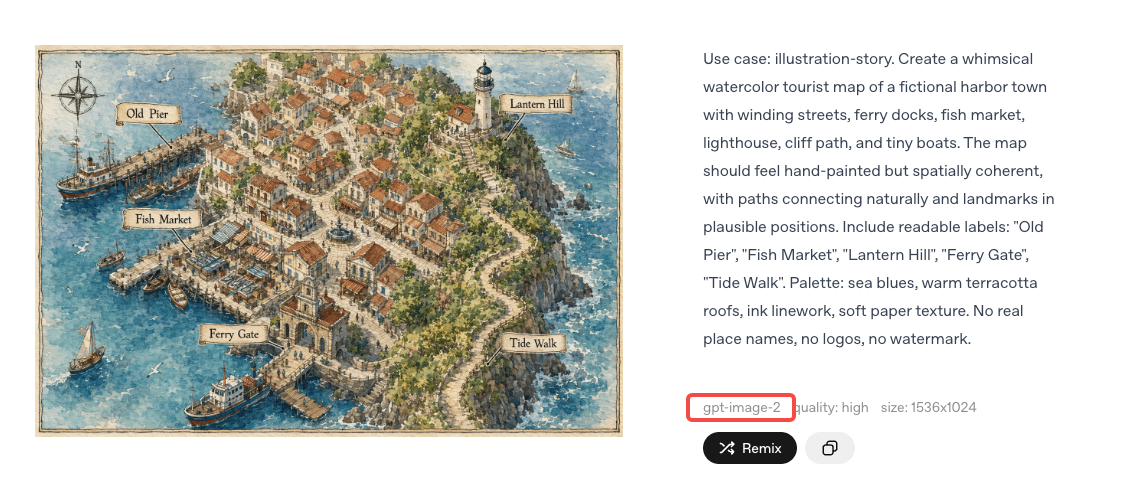

生成リクエストには、プロンプト、サイズ、品質、出力フォーマットが必要だ。フォーマットのデフォルトはPNG。JPEGまたはWebPをリクエストすることもでき、レイテンシが重要な場合はJPEGの方がPNGより速い。サイズはプリセットまたはカスタム寸法を受け付けるが、両辺が16の倍数、最大辺は3840px、アスペクト比が3:1未満、総ピクセル数が655,360から8,294,400の間という制約がある。

nパラメーターで1回のリクエストで複数の画像を生成できる。比較のためにバリエーションが必要な場合に便利だ。出力トークンごとに課金されていることを考えると、あまり便利ではないが。

サイズ、品質、ワークフローのトレードオフを管理する

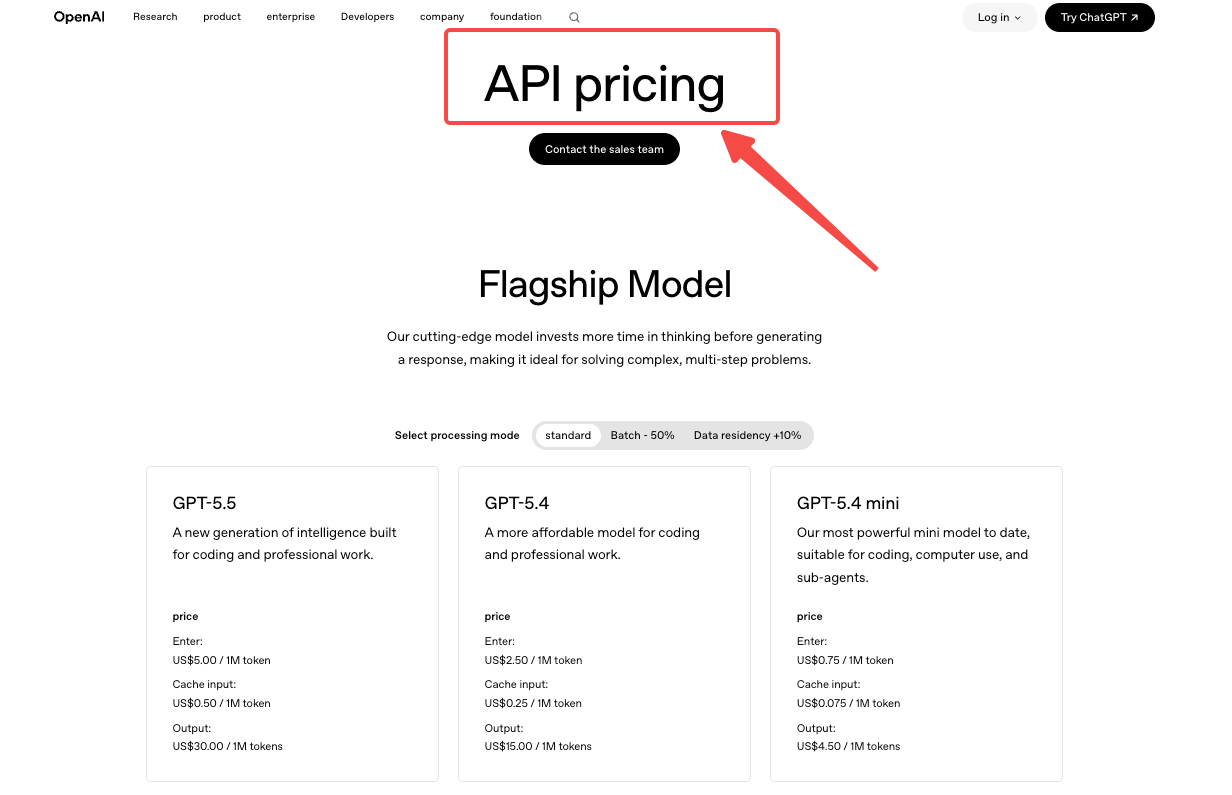

ここが多くのチームが気づかずにお金を無駄にするところだ。GPT Image 2は画像ごとではなくトークンごとに課金される: 画像入力1Mトークンあたり8ドル、画像出力1Mトークンあたり30ドル、テキスト入力1Mトークンあたり5ドル。キャッシュされた入力は安くなる。バッチ処理で標準レートが半額になる。

実際の数字で言うと: 1024x1024で、OpenAIの計算機は低品質でおよそ0.006ドル、中品質で0.053ドル、高品質で0.211ドルと見積もっている。1024x1536のような長方形サイズは、0.005ドル、0.041ドル、0.165ドルと少し安い。これらは出力のみの見積もりだ。入力トークンと編集参照トークンを上に追加すること。

つまり、トレードオフの問題は「どの品質が一番きれいか」ではない。「私のボリュームでは、中品質と高品質のコスト差はいくらで、ユーザーは実際にその差を感じるか」だ。サムネイルのサーフェスでは、低品質で十分なことが多い。ユーザーが見つめることになるヒーロー画像には、高品質がその価格に見合う。私は中品質をデフォルトに選び、高品質をオプトインとして公開した。その一つの決定が、予測月次請求額を約4倍変えた。

画像編集の仕組み

入力要件と一般的な編集シナリオ

editsエンドポイントは画像、オプションのマスク、変更を説明するプロンプトを受け取る。1枚の画像を渡してそれを編集する。複数の画像を渡して、被写体、スタイル、参照を1つの出力に組み合わせる。モデルはインペインティングとアウトペインティングを処理し、マスクされていない領域を保持しながら残りにプロンプトを適用する。

私が検証した一般的な編集: 商品写真の背景スワップ、オブジェクトの削除、2つの参照画像間のスタイル転送、画像内のテキスト翻訳。キャラクターの一貫性の主張 — 複数の生成シーンにわたって同じキャラクター — はシンプルな被写体では機能する。シーンの複雑さが増すにつれて信頼性が低下する。

コストを増やしたり一貫性を低下させるミス

過大なサイズの入力を送る。 GPT Image 2はすべての画像入力を高精度で処理するため、4Kの参照写真は出力がサムネイルでもポスターでも同じ入力トークンがかかる。タスクが実際に必要とするものに参照をダウンスケールすること。

曖昧な編集プロンプト。 「よくして」は予測不可能な変更を生み、しばしばリトライのコストがかかる。「赤い帽子を薄いブルーのベルベットに変えて」は残りの画像を保持し、通常1回で決まる。

制限のないn。 「選択肢を見るために」n=4を指定することは、1つしか使わないリクエストに4倍払ったと気づくまで無害に見える。

コスト見積もりで編集を生成として扱う。 編集は参照画像が入力トークンを追加するため、同じ出力サイズの生成よりもコストが高くなることが多い。それをリリース後ではなく、前に価格モデルに組み込んでおくこと。

チームのための本番環境の考慮事項

リトライ、モデレーション、運用上のガードレール

本番環境で省略できない3つのことがある。

指数バックオフを使ったリトライ。 複雑なプロンプトでは画像生成に最大2分かかることがあり、レート制限にぶつかることがある。OpenAIのガイダンスは、ジッターを加えた指数バックオフでリトライすることだ — ジッターが重要なのは、フリートからの同期リトライが同時に同じレート上限にぶつかるからだ。

2層のモデレーション。 画像生成エンドポイントには組み込みのmoderationパラメーターがある(autoがデフォルト;lowは許容的だがまだフィルタリングされる)。ユーザーが送信したプロンプトについては、gpt-image-2に送る前に無料のomni-moderation-latestエンドポイントを通すこと — テキストと画像の両方を受け付け、ポリシーに違反するリクエストのほとんどを生成の費用が発生する前に止める。モデレーションAPIリファレンスに正確なリクエスト形式がある。

適切な粒度でのロギング。 モデルID、サイズ、品質、プロンプトトークン数、出力トークン数、レイテンシ、リクエストID、リクエストごとの最終コスト見積もりをログに残すこと。スケールで何かが問題になったとき、これが診断できるデータだ。何かがうまくいっているとき、さらにスケールするかどうかを決めるデータだ。動作がいつの間にか変わらないよう、浮動エイリアスではなく特定のモデルスナップショットに固定すること。本番環境のベストプラクティスガイドには、キーローテーション、モニタリング、その他の運用レイヤーが記載されている。

直接統合をシンプルに保つべき場合とプラットフォーム層を追加すべき場合

これが私が最も長く考えた問いだ。

OpenAIの直接統合が正解なのは、プロダクトが1つの画像モデルを使用し、チームにAPIオペレーションの経験があり、レート制限の管理とファーストパーティの課金が利便性よりも重要なほど予測可能なトラフィックがある場合だ。

プラットフォーム層 — そう、私はWaveSpeedAIでそれを開発している — は異なる状況でその価値を発揮する。複数の画像モデルにルーティングしている(タイポグラフィにはgpt-image-2、透明なPNGには別のモデル、動画にはさらに別のモデル)。トークン計算ではなく予算予測のためのフラットな通話ごとの価格設定が必要だ。コールサイトを書き直すことなくプロバイダーの変更を乗り越えられる1つの統合サーフェスが欲しい。

どちらの答えも万能ではない。正直なテスト: 今日プロダクトが呼び出しているモデルプロバイダーの数を数え、12ヶ月後に呼び出す数を掛け合わせ、その数の統合を自分でメンテナンスしたいかどうかを問うこと。

FAQ

開発者はGPT Image 2にどのエンドポイントを使うべきか?

テキストから画像への変換にはimages.generate、プロンプトとオプションのマスクで既存の画像を修正するにはimages.edit、マルチターンの会話の中に生成を組み込む必要がある場合はResponses APIの画像ツールを使うこと。

GPT Image 2は画像編集をサポートしているか?

はい。images.editエンドポイントは1枚以上の参照画像とプロンプトを受け付け、マスクを使ったインペインティングとアウトペインティングをサポートしている。すべての画像入力は自動的に高精度で処理される。

チームは本番環境で何をログに記録し、監視すべきか?

最低限: モデルスナップショットID、サイズ、品質、入出力トークン数、レイテンシ、リクエストID、リトライ回数、モデレーション結果、リクエストごとの最終推定コスト。これがインシデントを再構築し、支出を予測するためのものだ。

シンプルなAPI統合ではいつ不十分になるか?

複数の画像プロバイダーを呼び出しているとき、障害モードでクロスプロバイダーのフォールバックが必要なとき、または財務部門がトークンベースの変動ではなく予測可能な通話ごとの価格設定を求めているとき。これらのしきい値を下回る場合、直接統合がよりクリーンな選択肢であり続ける。

プロンプトインジェクションと安全でない出力が本番環境に漏れないようにするには?

生成前にモデレーションエンドポイントでユーザープロンプトを通し、Image APIのmoderationパラメーターをautoに設定し、フラグが立てられたリクエストをすべてログに記録し、OpenAIの安全性のベストプラクティスに従うこと — 高リスクなサーフェスには人間によるレビューを含め、リリース前にレッドチームを行うこと。

まとめ

GPT Image 2 APIの組み込みは難しくない。最初のリクエストには半日かかる。重要な決定 — 品質のデフォルト、編集コストのモデリング、モデレーションの層、リトライの動作、プラットフォーム層を追加するかどうか — は、リリースから何ヶ月も静かに積み重なるものだ。意図的に選ぶこと。まず小さなパイロットを実行すること。残りはその後についてくる。