Godmod3 AIとは:制限なしのマルチモデルチャット

Godmod3なら1つのOpenRouterキーで50以上のAIモデルを並列実行できます。インストール不要、サーバー不要、アカウント不要。その実態を解説します。

完全に理解する前に、それを中心としたワークフローを構築してしまった。いつもそういうものだ。

先週、私は3つのタブを開いていた — Claudeが一つ、GPT-5が別の一つ、Geminiが三つ目 — 同じプロンプトをそれぞれにコピペして、どのモデルが微妙な技術的比較を最もうまく処理するかを調べていた。摩擦は明らかだった:3つのログインセッション、3つのパラメーターパネル、3つの課金アカウント、統一された出力フォーマットはゼロ。私はDoraといい、このようなクロスモデル評価を何十回も実行してきた。作業ログにはこんなメモが走り書きされている:「切り替えコストは、週に50回やるまで見えない」。そうなると、非常に見えてくる。

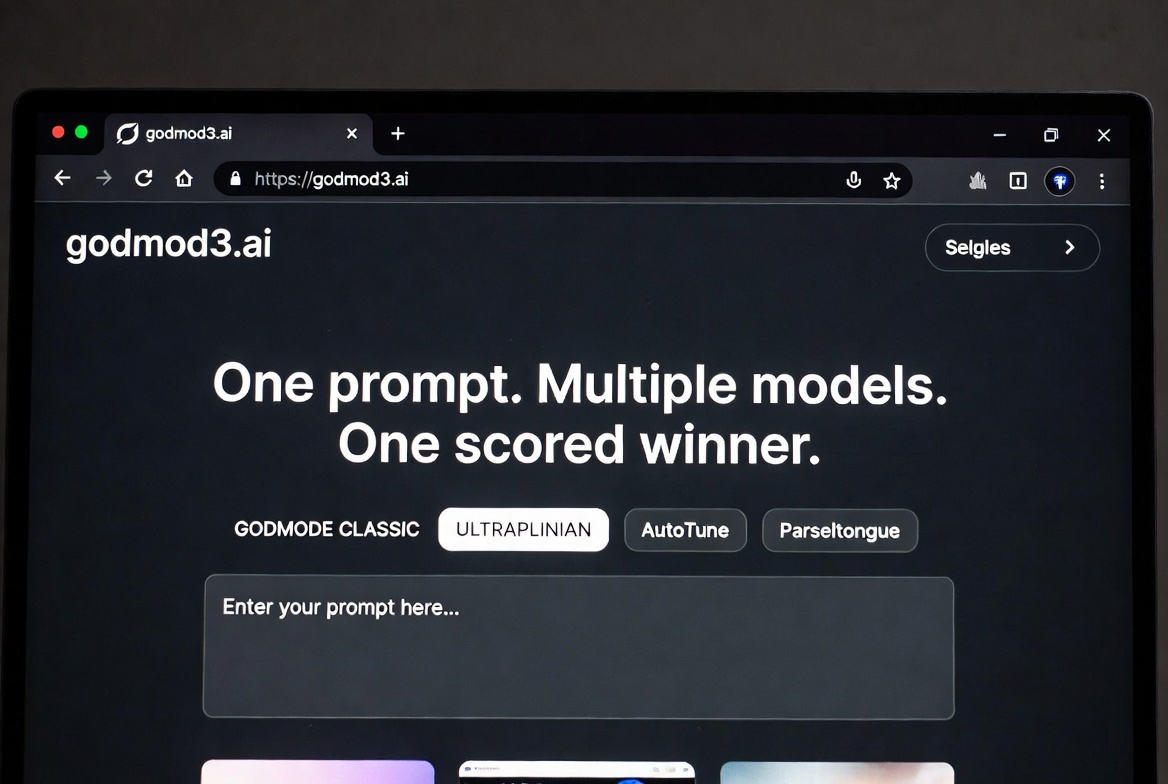

それがgodmod3.aiが解決する問題だ。一つのプロンプト。複数のモデル。一つのスコアリングされた勝者。ワークフローに組み込む価値があるかどうかを判断する前に、実際に知っておくべきことを紹介する。

Godmod3 vs 現在のAIチャット環境

シングルモデルの問題:ChatGPTとClaudeのタブを切り替えるだけでは不十分な理由

問題はChatGPTやClaudeが悪いということではない。問題は、一度に一つのモデルを使うと、比較ポイントなしにそのモデルの判断を信頼せざるを得ないということだ。プロンプトを入力し、レスポンスを受け取り、それを受け入れるか言い換えるかする。別のモデルなら最初の試みで完璧にこなせたかどうかはわからない。

それを確認するためにタブを切り替えるのは遅い。各プラットフォームには独自のパラメーター設定、独自のコンテキストウィンドウの動作、同じ指示を解釈する独自の方法がある。三つの出力を比較し終わる頃には、実際のタスクよりもプロセスに多くの時間を費やしている。

godmod3.aiが提供するもの:一つのプロンプト、複数のモデル、一人の勝者

Godmod3はプロンプトを複数のモデルに同時に送信し、結果を並べて返す。ULTRAPLINIANモードでは、レスポンスを100点満点の複合指標でスコアリングし、最高ランクの回答を自動的に表示する。5つのタブを読み通すのではなく、判定を読むだけだ。

インターフェイス全体は、AGPL-3.0ライセンスのもとPliny(elder-plinius)が構築したシングルページブラウザアプリケーションだ。基本的なホスト版にはバックエンドサーバーは不要。APIキーはブラウザのlocalStorageに保存される。Godmod3は会話をどのサーバーにも保存しない — タブを閉じれば消える。

OpenRouterへの依存関係をシンプルに説明

Godmod3はOpenAI、Anthropic、Googleに直接接続しない。すべてをOpenRouterを通じてルーティングする。OpenRouterは、単一のキーで複数プロバイダーの300以上のモデルにアクセスできる統合APIゲートウェイだ。支払いはgodmod3ではなくOpenRouterにトークン単位で行う。ツール自体は無料だ。OpenRouterが課金レイヤー、モデルカタログ、ルーティングインフラをすべて兼ねている。

Godmod3へのアクセス3つの方法

godmod3.aiのホスト版 — インストール不要、OpenRouterキーを持参

godmod3.aiにアクセスし、設定にOpenRouter APIキーを貼り付けて、プロンプトを入力するだけ。以上だ。ダウンロード不要、Docker不要、npm install不要。ホスト版はオプションのデータセット収集機能を完全に取り除いている — 純粋なクライアントサイドのチャットインターフェイスだ。

ページに着いてから60秒以内に使い始めた。オープンソースのAIツールとしては珍しく、摩擦がほぼゼロだった。

セルフホスト単一ファイル — クローンしてindex.htmlを開く

アプリケーション全体が一つのindex.htmlファイルに収まっている。GitHubリポジトリをクローンし、ブラウザでindex.htmlを開けば完了。またはローカルサーバーが必要ならpython3 -m http.server 8000を実行する。ビルドステップなし、依存関係のインストールなし、設定ファイルなし。

これは、APIキーを貼り付ける前に実行されるコードを正確に検査したい場合に重要だ。AGPL-3.0ライセンス — Open Source Initiativeによりフリーソフトウェアライセンスとして認められている — は、ソースコードが完全に監査可能であることを意味する。

静的デプロイ — GitHub Pages、Vercel、またはNetlifyで5分以内

単一のHTMLファイルなので、どんな静的ホスティングプラットフォームへのデプロイも簡単だ。GitHubリポジトリにプッシュし、GitHub Pagesを有効にすれば、自分でコントロールできるURLでパーソナルgodmod3インスタンスが公開される。VercelやNetlifyも同様 — リポジトリをインポートしてデプロイするだけだ。サーバーレス関数なし、環境変数なし(APIキーを除く、それはクライアントサイドに留まる)。

GitHub Pagesルートをテストした。フォークから公開URLまで約3分かかった。

4つのモードの説明

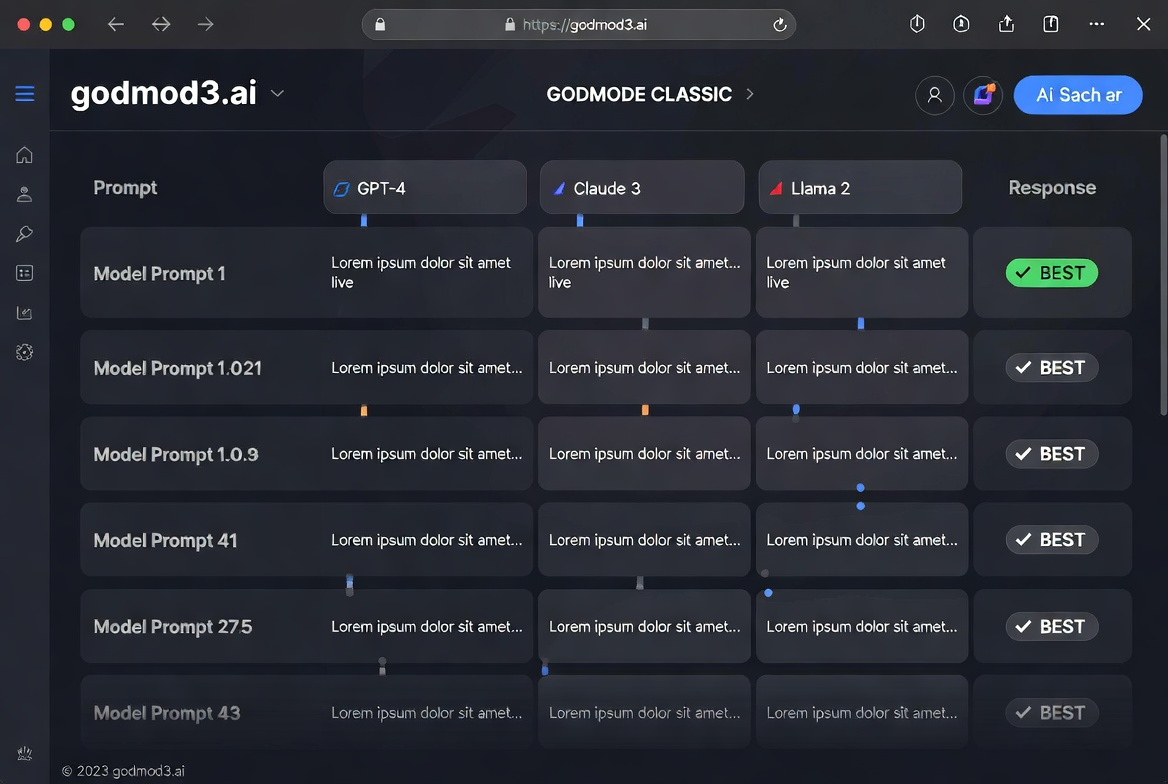

GODMODE CLASSIC — 並列レースモード

オリジナルモード。5つのモデルとプロンプトの組み合わせが並列で実行され、それぞれが特定のモデルとチューニングされたシステムプロンプトをペアリングする。レスポンスが競い合い、インターフェイスが最良のものを表示する。高速でオピニオネイテッドだ — モデルを自分で選ぶのではなく、プリセット設定を信頼することになる。

パラメーターチューニングについて考えたくない場合の素早い比較に適している。特定のモデル制御が必要な場合はあまり役立たない。

ULTRAPLINIAN — 本格的な比較のための深いマルチモデル評価

これは立ち止まらせたモードだ。最大51のモデルを並列でクエリし、複合指標で各レスポンスをスコアリングし、ランク付けできる。スコアリングは関連性、一貫性、レスポンスの品質を考慮する。同じ指示を異なるモデルがどう処理するかをテストするプロンプトエンジニアにとって、本当の価値がここにある。

ただし安くはない。51のモデルを並列で実行するということは、それぞれOpenRouterを通じて課金される51の個別APIコールを意味する。中程度の複雑さのプロンプトを10モデル構成で実行したところ、コストは控えめだった — 数セント程度。51モデルになると積み重なる。

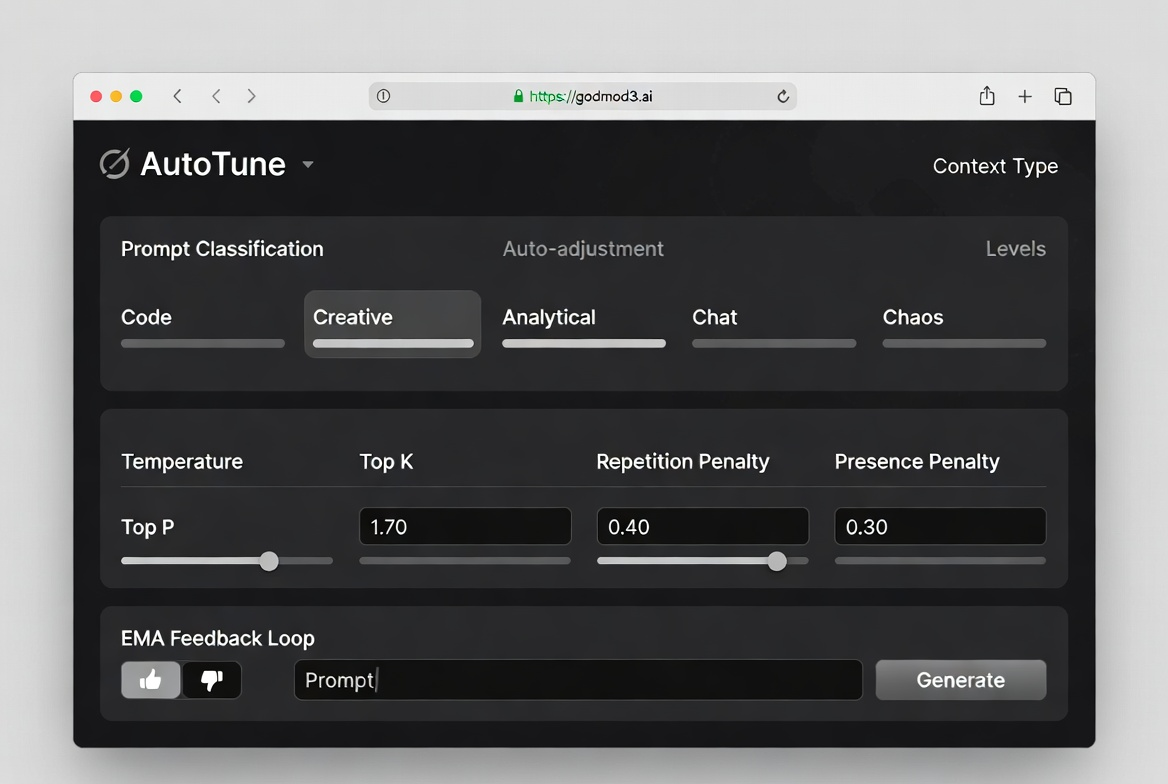

AutoTune — 温度を手動で設定する必要がなくなる理由

AutoTuneはプロンプトをコード、クリエイティブ、分析、チャット、カオスの5つのコンテキストタイプに分類し、温度、top_p、top_k、ペナルティパラメーターを自動的に調整する。EMSベースのフィードバックループを使用:レスポンスへの高評価または低評価が将来のパラメーター選択を洗練させる。

これが温度を0.7に手動設定してそのままにする場合と比べてどれだけ差があるのか、まだ完全には確信できていない。1週間使用した後、パラメーターの選択は合理的に感じられたが、私のデフォルトよりも劇的に優れているわけではなかった。この結論には有効期限がある — フィードバックループが収束するには、より多くのデータが必要だ。

Parseltongue — セキュリティ研究者向けの入力摂動(そして何のためでないか)

Parseltongueはレッドチーム研究モジュールだ。トリガーワードを検出し、文字レベルの変換(リートスピーク、Unicode置換、音声エンコーディング)を適用して、モデルが敵対的入力にどう応答するかを研究する。プロジェクトの研究論文は、これを推論時のモデルロバスト性テストのためのAI安全評価ツールとして明示的に位置づけている。

これはコンテンツバイパスツールではない。安全レイヤーが入力摂動にどう応答するかについての制御された研究のために設計されている。区別は重要だ。「AIに言ってはいけないことを言わせたい」というユースケースであれば、このモジュールはそのために作られていないし、プロジェクトのドキュメントもそう明言している。

OpenRouterを通じたモデルアクセス

利用可能なモデル

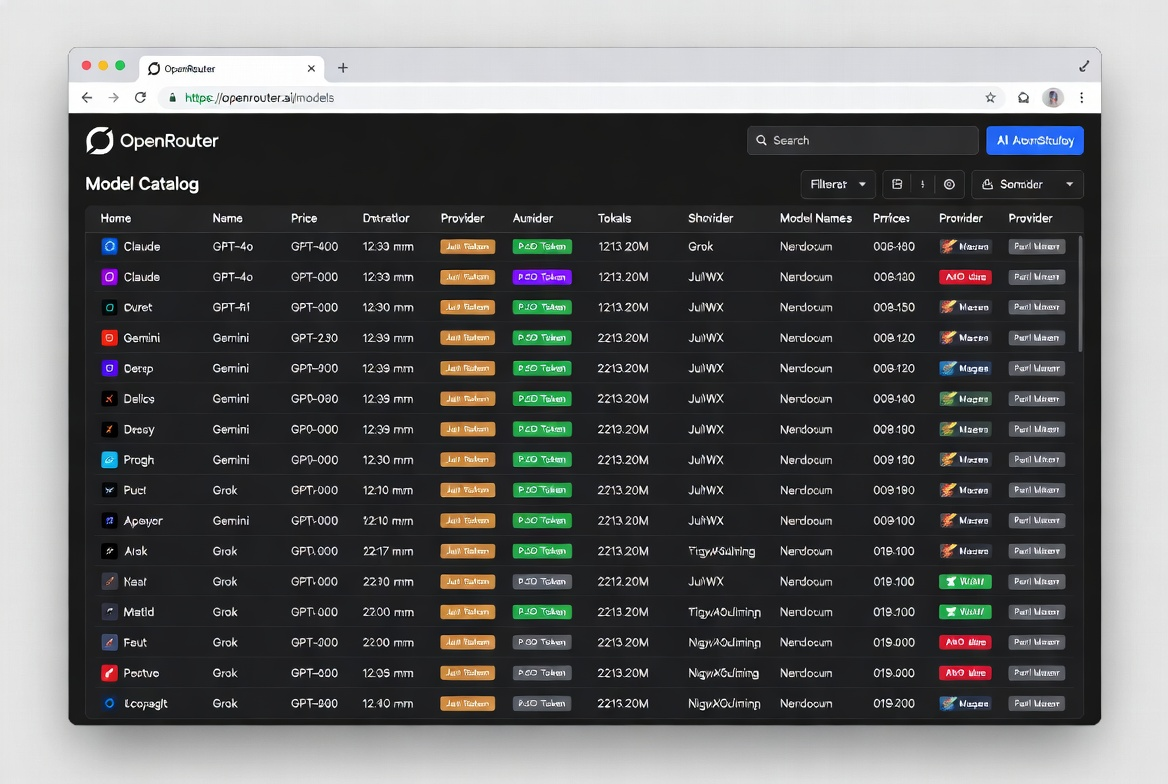

OpenRouterを通じて、godmod3はClaude、GPT-4o、Gemini、Grok、Mistral、Llama、DeepSeek、Qwen、その他多数にアクセスできる。OpenRouterモデルカタログには、2026年4月時点で60以上のプロバイダーの300以上のオプションがリストされている。すべてがすべてのタスクに役立つわけではないが、その幅広さから「モデルが利用できない」という壁にぶつかることはほとんどないだろう。

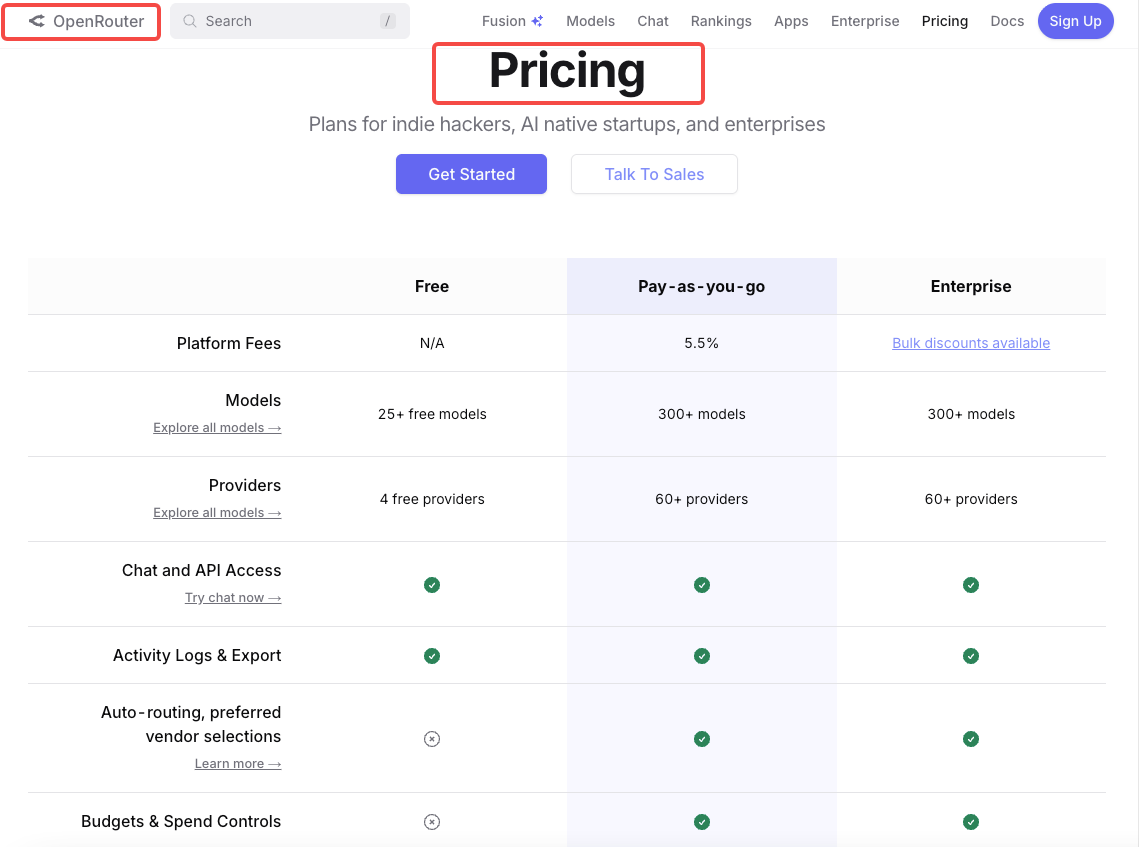

価格の現実:支払いはgodmod3ではなくOpenRouterにトークン単位で行う

Godmod3自体は無料だ。コストはOpenRouterのトークン単位の課金から発生し、各プロバイダーの価格を直接APIレートと同等かそれに近い形でパススルーする。一つのモデルにプロンプトを実行するコストは、そのモデルのAPIを直接呼び出すのと同じだ。10のモデルで実行すれば、10倍のコストがかかる。

OpenRouterの価格ページではモデル別のトークン単位レートを詳細に説明している。月額料金なし、最低利用金額なし。クレジットを追加し、使用に応じて消費される。

今すぐgodmod3で使えるOpenRouterの無料モデル

OpenRouterは無料モデルのコレクションを維持している — 現在DeepSeek R1、Llama 3.3 70B、Qwen3 Coder、いくつかのGemmaバリアントを含む約29のオプション。無料モデルにはレート制限がある(通常は1分あたり20リクエスト、1日200件)が、クレジットは不要だ。

お金を使う前にgodmod3がワークフローに合うかどうかをテストするには、無料ティアで十分意見を形成できる。

Godmod3でないもの

バックエンドではない — チャット履歴はブラウザにのみ存在する

アカウントなし、クラウド同期なし、サーバーサイドストレージなし。ブラウザデータをクリアすると会話は永久に消える。デバイスを切り替えても何も引き継がれない。プライベートブラウジングモードはウィンドウを閉じると全てを破棄する。

これは制限ではなくプライバシー機能だ — しかしgodmod3はスクラッチパッドであり、知識ベースではないことを意味する。

本番APIの代替ではない

LLMを呼び出す製品を構築している場合、リトライロジック、エラー処理、レート制限管理を備えた直接API統合が必要だ。Godmod3は研究・評価インターフェイスであり、本番インフラではない。プロジェクト自体のドキュメントもこれについて明確だ。

バイパスツールではない — AI安全研究におけるParseltongueの目的

繰り返す価値がある:Parseltongueは制御された条件下でモデルのロバスト性を研究するために存在する。このプロジェクトは、Constitutional AIやRLHFのようなフレームワークと並んでより広いAI安全研究の景観の中に自らを位置づけている。これは推論時の評価ツールを提供するもので — 訓練時の修正ではない。デュアルユースのリスクはドキュメントで認められており、ユーザーは地域の法律の遵守に責任を持つ。

Godmod3から最も価値を得るのは誰か

迅速なマルチモデル比較が必要なプロンプトエンジニア

一つに決める前に、プロンプトがClaude、GPT-4o、Geminiでどのように機能するかをテストしている場合、godmod3はそのワークフローを「3つのタブ、3つのログイン、手動比較」から「一つのプロンプト、一つの画面、ランク付けされた結果」に圧縮する。それが核心的な価値だ。

APIに統合してその特性に合わせて構築する前に、どのLLMがユースケースに合うかを評価する開発者

APIを統合してその特性に合わせて構築する前に、知りたいことがある:このモデルは私のユースケースをうまく処理するか?同じテストプロンプトを5〜10モデルで並列実行すると、日単位ではなく分単位で比較マトリックスが得られる。

制御されたLLB動作研究を行う研究者

AutoTune(パラメーターのバリエーション)、Parseltongue(入力摂動)、ULTRAPLINIAN(クロスモデルスコアリング)の組み合わせは、構造化された評価パイプラインを作り出す。異なる条件下でモデルがどう応答するかを研究するアカデミックまたは産業の研究者にとって、これはカスタムインフラを構築する必要のない既製のツールキットだ。

よくある質問

godmod3.aiはGitHubのG0DM0D3と同じですか?

はい。「Godmod3」と「G0DM0D3」は同じプロジェクトを指している。godmod3.aiのホスト版はGitHubリポジトリと同じコードベースで実行される。主な違いは、ホスト版にはオプトインのデータセット収集機能が含まれていないことだ — それは完全なDockerベースのAPIサーバーでセルフホスティングする場合にのみ利用できる。

godmod3を使うのに支払いが必要ですか?

ツール自体は無料だ。OpenRouter APIキーが必要で、OpenRouterは有料モデルを使用する場合にトークン単位で課金する。OpenRouterの無料モデルをゼロコストで使用でき、レート制限が適用される。サブスクリプションなし、godmod3からのプラットフォーム料金なし。

godmod3.aiでAPIキーは安全ですか?

OpenRouterキーはブラウザのlocalStorageに保存され、OpenRouterのAPIに直接送信される。godmod3のサーバーには触れない。とはいえ、クライアントサイドのコードが盗み出さないことを信頼することになる — そのためオープンソースのコードベースが重要だ。自分で監査することも、完全な制御のためにセルフホストすることもできる。

OpenRouterアカウントなしでgodmod3を使えますか?

いいえ。OpenRouterはすべてのモデルアクセスのルーティングレイヤーだ。OpenRouterアカウントとAPIキーが必要だ。無料モデルのみを使用する場合、アカウント作成は無料でクレジットカードも不要だ。

ブラウザを閉じたらチャット履歴はどうなりますか?

ブラウザデータをクリアするまでlocalStorageに残る。しかしバックアップなし、同期なし、回復なし。会話を保存する必要がある場合は、タブを閉じる前に手動でコピーしてほしい。

godmod3を使い始めて約10日になる。直接のClaudeやGPTのサブスクリプションの代わりにはなっていない — コンテキストの継続性が重要な長い会話ワークフローではそれらがまだ重要だ。しかし「このプロンプトをどのモデルが最もうまく処理するか」という特定のタスクについては、比較時間を分単位から秒単位に短縮した。

確認できるのはそれだけだ。残りは自分で検証する必要がある。

過去の投稿: