WAN 2.7: Fitur Baru, Akses API & Jalur Peningkatan

WAN 2.7 adalah peningkatan besar dari Alibaba: kontrol frame pertama/terakhir, I2V 9-grid, referensi suara, dan pengeditan berbasis instruksi. Yang perlu diketahui oleh para pengembang.

Halo, semuanya. Ini Dora! Saya telah memantau keluarga model Wan secara seksama sejak versi 2.1, terutama karena begitu sebuah model mulai mendapatkan daya tarik open-source dalam pipeline produksi, perkembangannya cenderung lebih cepat dari liputannya. WAN 2.7 masih dalam tahap peluncuran — direncanakan rilis dalam Maret 2026 — jadi ini bukan ulasan rilis. Ini adalah daftar periksa pra-terbang untuk tim yang sudah menjalankan 2.5 dan perlu memutuskan apakah akan mengalihkan infrastruktur atau menunggu.

Tanpa hype. Hanya apa yang sudah dikonfirmasi, apa yang masih kabur, dan …apa artinya bagi antrean build Anda. Jika Anda masih memetakan di mana model seperti Wan sebenarnya cocok dalam stack produksi, uraian tentang cara penggunaan alat pembuatan video AI dalam alur kerja nyata ini membantu mendasari keputusan sebelum Anda mendalami spesifikasinya.

WAN 2.7 dalam 60 Detik (Versi Singkat)

Jika Anda mengevaluasi dari perspektif produk atau teknik: WAN 2.7 tampaknya lebih merupakan ekspansi fungsional daripada lompatan kualitas murni. Judul beritanya bukan “video yang lebih baik” — melainkan “lebih banyak permukaan kontrol.” Peningkatan mencakup kualitas visual, pembuatan audio, dan dinamika gerakan, namun penambahan yang lebih menarik bersifat struktural: kontrol frame pertama/terakhir, multi-input I2V 9-grid, referensi subjek-plus-suara, dan pengeditan berbasis instruksi.

Perbedaan dari 2.5 bukan pada resolusi utama. Melainkan pada jumlah input penahan yang kini diterima model dalam satu panggilan.

Apa yang Baru di WAN 2.7

Kontrol Video Frame Pertama & Terakhir

Pendekatan frame pertama-dan-terakhir memungkinkan pengguna mendefinisikan awal dan akhir video menggunakan dua gambar, dengan model yang secara otomatis menghasilkan konten perantara. Fitur ini sudah ada sebagai model mandiri dalam rilis seri Wan sebelumnya (lihat Wan2.1-FLF2V-14B), namun 2.7 menghadirkannya dalam model itu sendiri, bukan sebagai checkpoint terpisah.

Bagi tim produksi: ini paling penting ketika Anda memiliki keyframe yang terdefinisi — foto produk dalam posisi diam, foto produk dalam gerakan — dan ingin model menginterpolasi transisi tanpa perlu melewati seluruh proses animasi manual. Titik akhirnya bersifat deterministik. Apa yang terjadi di antaranya masih stokastik, namun pembatas komposisi Anda sudah tersedia.

9-Grid Image-to-Video (Multi-Input 3×3)

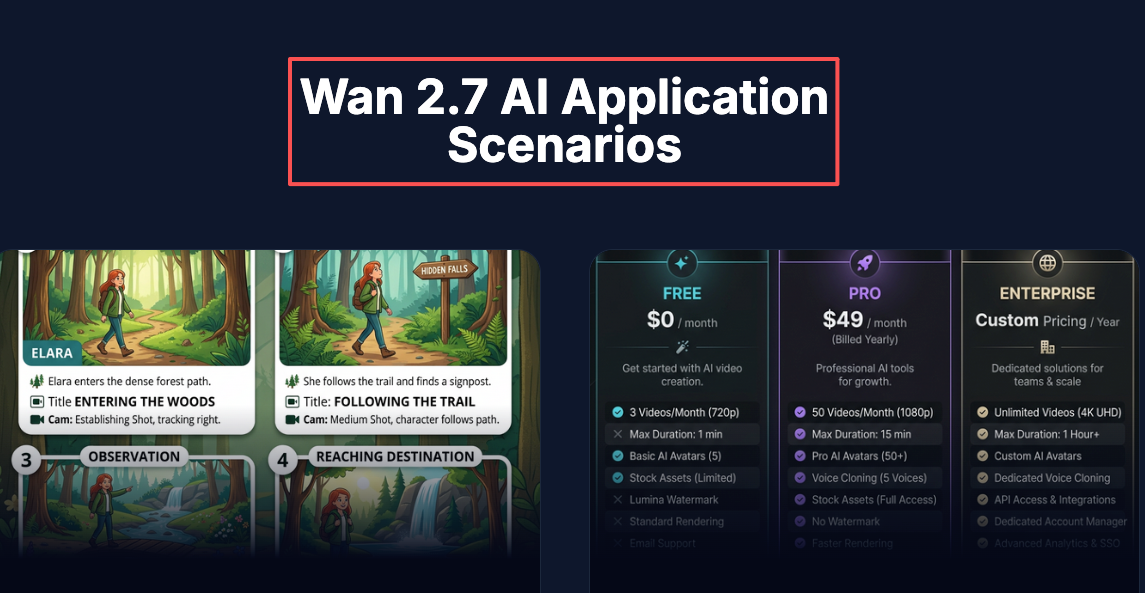

WAN 2.7 mendukung pendekatan sintesis grid 3×3, artinya hingga sembilan gambar referensi dapat dikirimkan sebagai input terstruktur untuk satu tugas pembuatan video. Ini secara bermakna berbeda dari I2V single-frame.

Aplikasi praktisnya: jika Anda menghasilkan konten dengan konsistensi karakter di berbagai sudut atau kondisi pencahayaan, Anda kini dapat menyediakan grid referensi …daripada satu anchor tunggal. Jika Anda membandingkan cara berbagai alat menangani konsistensi multi-referensi, panduan tentang alat face swap video terbaik dengan dukungan multi-wajah dan multi-input ini menunjukkan di mana solusi saat ini masih kesulitan. Ini mengurangi faktor keberuntungan one-shot yang membuat pekerjaan batch I2V mahal untuk diperiksa kualitasnya. Konfirmasi struktur parameter API yang tepat saat peluncuran — skema endpoint untuk input grid belum dipublikasikan secara resmi pada saat penulisan ini.

Referensi Subjek + Suara

WAN 2.7 memungkinkan Anda menggabungkan referensi subjek visual dengan referensi suara untuk menghasilkan video di mana penampilan dan suara karakter konsisten dengan input Anda. Ini merupakan perluasan dari apa yang diperkenalkan Wan 2.6 dengan model R2V-nya — yang memungkinkan pengguna mengunggah video referensi karakter dengan penampilan dan suara, memanfaatkan prompt teks untuk menghasilkan adegan baru yang hidup dengan karakter yang sama.

Dalam 2.7, ekspektasinya adalah ini menjadi lebih terintegrasi erat daripada endpoint model terpisah. Bagi tim yang membangun konten berkarakter pendek atau pipeline lokalisasi, …ini adalah fitur dengan ROI produksi yang paling jelas — asalkan penanganan referensi suara stabil di bawah panggilan batch berulang. Sebagai konteks, ini juga di mana pipeline face swap video AI saat ini mulai rusak pada skala besar, terutama ketika konsistensi identitas dan suara keduanya diperlukan.

Pengeditan Video Berbasis Instruksi

WAN 2.7 mendukung pengeditan video yang sudah ada menggunakan instruksi bahasa alami — mengubah latar belakang, memodifikasi pencahayaan, atau mengubah pakaian karakter dengan mendeskripsikan perubahan dan membiarkan model menangani sisanya.

Ini adalah pergeseran bermakna dari pembuatan ke pengeditan. Bagi tim produk yang menjalankan loop koreksi pasca-produksi, ini membuka alternatif yang lebih ringan dari pekerjaan roto dan compositing manual untuk perubahan kecil. Hal yang belum diketahui adalah bagaimana model menangani konsistensi temporal pada klip yang lebih panjang ketika pengeditan memengaruhi elemen yang berdekatan dengan gerakan (misalnya pakaian pada subjek yang bergerak). Di sinilah alat serupa secara historis mengalami degradasi.

Dokumentasi resmi Alibaba Cloud Model Studio sudah mencakup endpoint pengeditan terkait dalam jajaran Wan saat ini, yang memberikan beberapa dasar untuk pola API yang kemungkinan akan Anda lihat di 2.7.

Rekreasi / Replikasi Video [Perlu Verifikasi]

Fitur ini — merekonstruksi atau mereplikasi video yang sudah ada dengan perubahan gaya atau subjek sambil mempertahankan struktur gerakan — telah muncul dalam rangkuman pihak ketiga tentang WAN 2.7. Ini belum dikonfirmasi secara independen dalam dokumentasi resmi Alibaba pada saat penulisan ini. Jangan membangun ketergantungan alur kerja pada kemampuan ini sampai catatan rilis resmi Alibaba mengonfirmasinya. Tandai sebagai eksplorasi jika Anda sedang memetakan proyek peningkatan sekarang.

Yang Tetap Sama (Kontinuitas Arsitektur dari 2.6)

Arsitektur DiT (Diffusion Transformer) yang mendasarinya dilanjutkan. Seri Wan menggunakan komponen Transformer berdasarkan arsitektur video DiT utama, menggunakan mekanisme Full Attention untuk secara akurat menangkap dependensi spatiotemporal jangka panjang, memastikan konsistensi temporal dan spasial yang tinggi.

Ini penting bagi tim yang menjalankan inferensi lokal: profil memori GPU dan pendekatan kuantisasi tidak akan berubah drastis. Jika stack inferensi 2.6 Anda sudah dioptimalkan (operasi FP8, sharding multi-GPU), investasi tersebut berlanjut. Jangan mengharapkan arsitektur deployment yang sepenuhnya baru.

Akses API & Ketersediaan — Apa yang Dikonfirmasi, Apa yang Masih TBD

Jalur Akses Resmi (DashScope / Wan.video)

Dua saluran resmi yang dikonfirmasi untuk versi Wan sebelumnya adalah platform DashScope Alibaba Cloud — yang menangani penyediaan API key dan akses model — dan Wan.video untuk alur kerja yang menghadap kreator. Keduanya diharapkan membawa 2.7 saat peluncuran, meskipun ketersediaan regional (terutama untuk akun internasional vs. daratan China) harus dikonfirmasi saat rilis.

API key DashScope dimuat dari variabel lingkungan DASHSCOPE_API_KEY, dengan pengguna internasional mengarah ke dashscope-intl.aliyuncs.com — pola yang sama hampir pasti akan berlaku untuk 2.7 mengingat infrastruktur yang sudah ada.

Ketersediaan API Pihak Ketiga

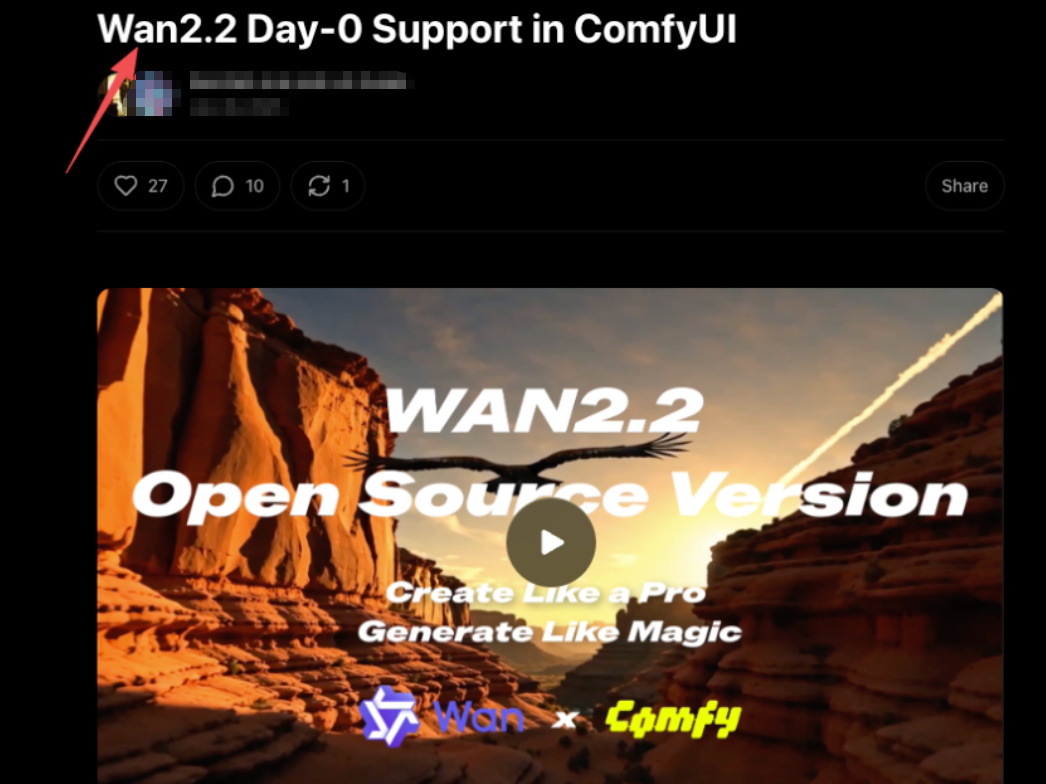

Pada saat penulisan ini, WAN 2.7 belum dikonfirmasi pada agregator API pihak ketiga. Berdasarkan pola dari 2.2 dan seterusnya — di mana dukungan native ComfyUI tiba pada hari peluncuran untuk bobot model open-source — perkirakan integrasi komunitas akan mengikuti dengan cepat jika 2.7 diluncurkan dengan bobot publik.

Apakah 2.7 diluncurkan sebagai open-source sendiri masih belum dikonfirmasi. Lihat FAQ di bawah.

Siapa yang Harus Memprioritaskan WAN 2.7 Sekarang

Tim yang Melakukan Produksi Video Berbasis Referensi

Jika pipeline Anda sudah mengandalkan konsistensi karakter di berbagai shot — dan Anda telah mengkompensasi dengan beberapa kali proses generasi atau solusi ControlNet — referensi subjek + suara dan input grid multi-frame adalah dua fitur yang paling langsung mengurangi overhead tersebut. Layak untuk dipertimbangkan sebagai peningkatan.

Developer yang Membutuhkan Multi-Input I2V

I2V gambar tunggal berhasil sampai Anda membutuhkan konsistensi. Input 9-grid mengubah area permukaan referensi secara signifikan. Jika Anda telah melakukan workaround batch untuk mensimulasikan ini, 2.7 mungkin dapat mengkonsolidasikan beberapa panggilan API menjadi satu.

Tim Kreatif yang Bisa Menunggu di WAN 2.5

Jika alur kerja 2.5 Anda stabil dan fitur-fitur baru tidak memetakan ke hambatan produksi aktif, tidak ada urgensi. Model masih dalam tahap peluncuran. Biarkan dua minggu pertama umpan balik komunitas memunculkan kasus-kasus tepi sebelum mengubah apa pun.

FAQ

- Kapan WAN 2.7 tersedia secara resmi melalui API? Peluncuran direncanakan dalam Maret 2026. Tanggal ketersediaan API yang tepat per region: belum dikonfirmasi.

- Apakah WAN 2.7 open-source seperti WAN 2.2? Belum dikonfirmasi. Wan 2.2 diluncurkan di bawah Apache 2.0, yang memungkinkan penggunaan komersial dan integrasi ComfyUI. Apakah 2.7 mengikuti lisensi yang sama belum dinyatakan dalam materi pra-peluncuran.

- Apakah WAN 2.7 mendukung ComfyUI? Belum ada integrasi yang dikonfirmasi. Mengingat rilis sebelumnya — Wan 2.1 dan 2.2 keduanya memiliki dukungan ComfyUI pada atau menjelang hari peluncuran — asumsikan node komunitas akan mengikuti dengan cepat jika bobot model bersifat publik.

- Berapa harganya dibandingkan WAN 2.5? Belum ada harga yang diumumkan. Seri model Wan biasanya ditagih per detik atau per video melalui DashScope. Periksa harga Alibaba Cloud Model Studio saat peluncuran untuk tarif terbaru.

- Bisakah saya mengakses WAN 2.7 dari penyedia API pihak ketiga sekarang? Belum. Model belum diluncurkan. Pantau GitHub resmi Wan dan dokumen DashScope untuk konfirmasi rilis, lalu periksa dukungan platform dari sana.

Yang Perlu Dipantau Setelah Peluncuran

Beberapa hal yang layak dilacak saat 2.7 menstabilkan diri dalam beberapa minggu pertama:

— Konsistensi temporal pada pengeditan instruksi: Pengeditan berbasis instruksi adalah fitur yang paling mungkin berperilaku berbeda dalam praktik versus framing preview. Perhatikan output komunitas dengan seksama.

— Rilis bobot open-source: Jika bobot dikirimkan secara publik, perkirakan alur kerja ComfyUI, integrasi Diffusers, dan varian terkuantisasi dalam hitungan hari. Jika tidak, API DashScope tetap menjadi jalur akses utama — dan latensi regional menjadi variabel alur kerja yang nyata.

— Status fitur rekreasi video: Yang satu ini membutuhkan sumber resmi. Jangan jadikan spesifikasi apa pun sampai Alibaba mengonfirmasinya secara eksplisit.