Godmod3 AI Dijelaskan: Chat Multi-Model Tanpa Batasan

Godmod3 memungkinkan Anda menjalankan 50+ model AI secara paralel dengan satu kunci OpenRouter — tanpa instalasi, tanpa server, tanpa akun. Inilah artinya dalam praktik.

Saya membangun workflow di sekitarnya sebelum saya benar-benar memahami apa itu. Begitulah biasanya.

Minggu lalu saya membuka tiga tab sekaligus — Claude di satu tab, GPT-5 di tab lain, Gemini di tab ketiga — menyalin dan menempelkan prompt yang sama ke masing-masing untuk mencari tahu model mana yang paling baik menangani perbandingan teknis yang nuansif. Friksinya jelas: tiga sesi login, tiga panel parameter, tiga akun penagihan, nol format output yang terstandarisasi. Saya Dora, yang telah menjalankan evaluasi lintas model seperti ini puluhan kali, menyimpan catatan di log kerja saya: “biaya peralihan tidak terlihat sampai kamu melakukannya lima puluh kali seminggu.” Setelah itu menjadi sangat terlihat.

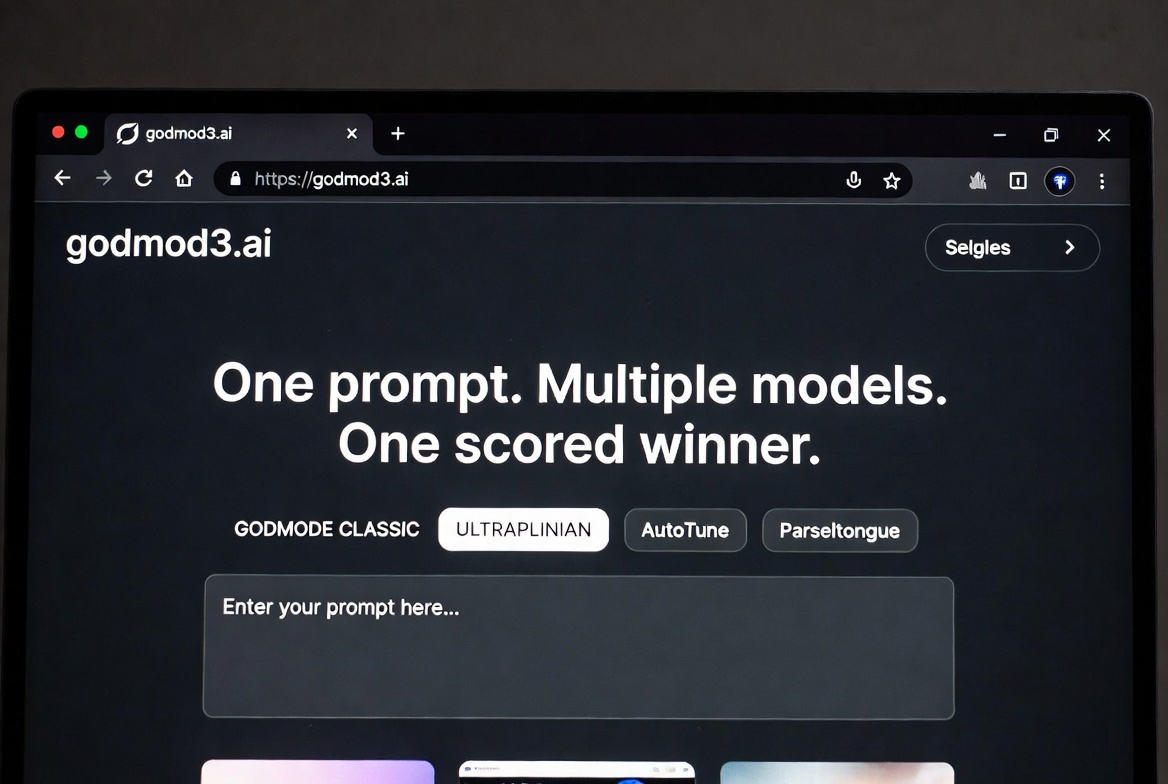

Itulah masalah yang diselesaikan oleh godmod3.ai. Satu prompt. Beberapa model. Satu pemenang dengan skor. Berikut yang sebenarnya perlu kamu ketahui sebelum memutuskan apakah ini cocok untuk workflow kamu.

Godmod3 vs Pengaturan AI Chat Kamu Saat Ini

Masalah model tunggal: mengapa berpindah tab antara ChatGPT dan Claude tidak cukup

Masalahnya bukan karena ChatGPT atau Claude buruk. Masalahnya adalah menggunakan satu model sekaligus memaksamu untuk mempercayai penilaian model tersebut tanpa titik pembanding. Kamu mengetik prompt, mendapatkan respons, dan entah menerimanya atau memparafrase ulang. Kamu tidak tahu apakah model lain akan berhasil pada percobaan pertama.

Berpindah tab untuk mencari tahu itu lambat. Setiap platform memiliki pengaturan parameter sendiri, perilaku jendela konteks sendiri, cara menafsirkan instruksi yang sama sendiri. Saat kamu sudah membandingkan tiga output, kamu telah menghabiskan lebih banyak waktu untuk prosesnya daripada untuk tugas sebenarnya.

Apa yang godmod3.ai berikan: satu prompt, beberapa model, satu pemenang

Godmod3 mengirimkan promptmu ke beberapa model secara bersamaan dan menampilkan hasilnya secara berdampingan. Dalam mode ULTRAPLINIAN, ia memberi skor respons pada metrik komposit 100 poin dan secara otomatis menampilkan jawaban dengan peringkat tertinggi. Kamu tidak membaca melalui lima tab — kamu membaca verdiknya.

Seluruh antarmuka adalah aplikasi browser satu halaman yang dibangun oleh Pliny (elder-plinius) di bawah lisensi AGPL-3.0. Tidak diperlukan server backend untuk versi hosted dasar. API key kamu tersimpan di localStorage browser-mu. Godmod3 tidak menyimpan percakapanmu di server mana pun — tutup tab dan semuanya hilang.

Ketergantungan OpenRouter dijelaskan secara sederhana

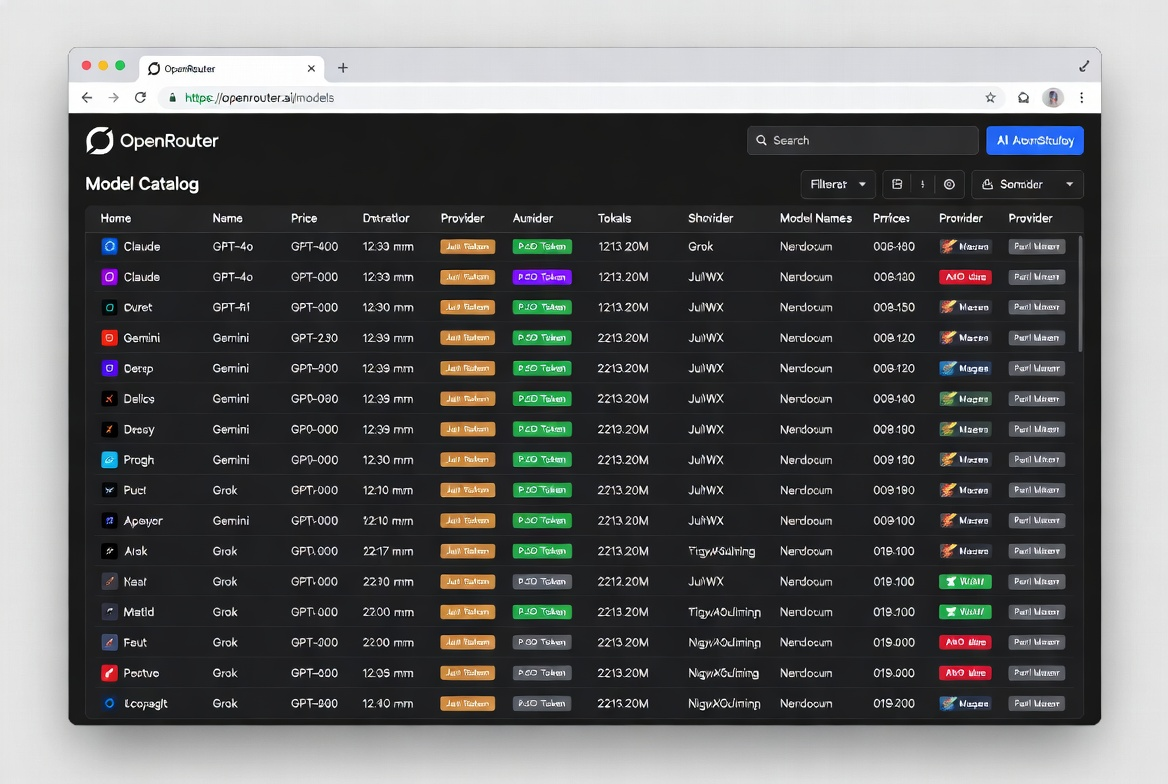

Godmod3 tidak terhubung langsung ke OpenAI, Anthropic, atau Google. Semuanya diarahkan melalui OpenRouter, gateway API terpadu yang menyediakan akses ke 300+ model dari berbagai penyedia dengan satu kunci. Kamu membayar OpenRouter per token, bukan godmod3. Alatnya sendiri gratis. OpenRouter adalah lapisan penagihan, katalog model, dan infrastruktur routing sekaligus.

Tiga Cara Mengakses Godmod3

Versi hosted di godmod3.ai — tanpa instalasi, bawa OpenRouter key kamu

Buka godmod3.ai, tempel API key OpenRouter-mu di pengaturan, dan mulai membuat prompt. Itu saja. Tanpa unduhan, tanpa Docker, tanpa npm install. Versi hosted menghapus fitur pengumpulan dataset opsional sepenuhnya — ini adalah antarmuka chat sisi klien murni.

Saya sudah menggunakannya dalam 60 detik setelah membuka halaman. Friksinya hampir nol, yang jarang terjadi untuk alat AI open-source.

Self-hosted satu file — clone dan buka index.html

Seluruh aplikasi muat dalam satu file index.html. Clone repo GitHub, buka index.html di browser, selesai. Atau jalankan python3 -m http.server 8000 jika kamu ingin server lokal. Tidak ada langkah build, tidak ada instalasi dependensi, tidak ada file konfigurasi.

Ini penting jika kamu ingin memeriksa kode apa yang berjalan sebelum menempelkan API key ke dalamnya. Lisensi AGPL-3.0 — diakui oleh Open Source Initiative sebagai lisensi perangkat lunak bebas — berarti kode sumbernya sepenuhnya dapat diaudit.

Deploy statis — GitHub Pages, Vercel, atau Netlify dalam waktu kurang dari 5 menit

Karena ini adalah satu file HTML, men-deploy ke platform hosting statis mana pun sangat mudah. Push ke repo GitHub, aktifkan GitHub Pages, dan instans godmod3 pribadimu sudah live di URL yang kamu kendalikan. Sama untuk Vercel atau Netlify — impor repo dan deploy. Tidak ada fungsi serverless, tidak ada variabel lingkungan (selain API key-mu, yang tetap di sisi klien).

Saya menguji rute GitHub Pages. Butuh sekitar tiga menit dari fork hingga URL live.

Empat Mode Dijelaskan

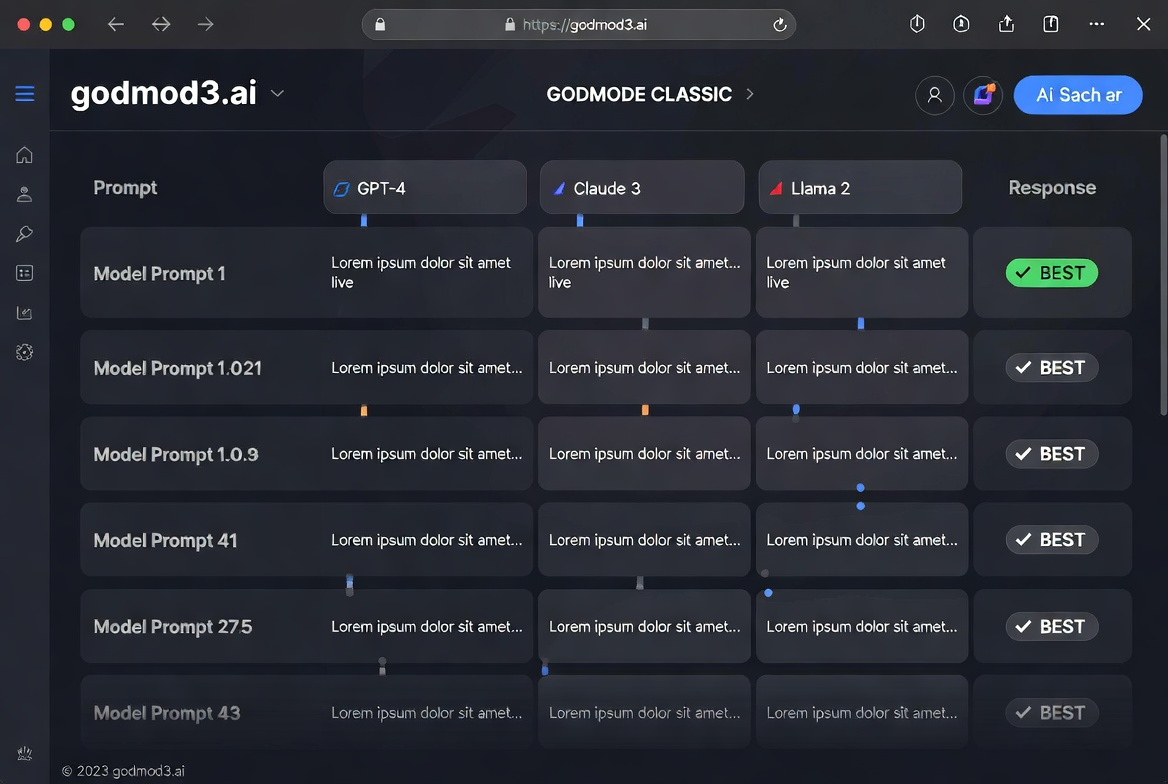

GODMODE CLASSIC — mode balapan paralel

Mode orisinal. Lima kombinasi model-prompt berjalan secara paralel, masing-masing memasangkan model tertentu dengan system prompt yang disetel. Respons-respons berlomba, dan antarmuka menampilkan yang terbaik. Ini cepat dan berpendirian — kamu mempercayai konfigurasi preset daripada memilih model sendiri.

Bagus untuk perbandingan cepat ketika kamu tidak ingin memikirkan penyetelan parameter. Kurang berguna ketika kamu membutuhkan kontrol model yang spesifik.

ULTRAPLINIAN — evaluasi multi-model mendalam untuk perbandingan serius

Ini mode yang membuat saya berhenti sejenak. Ia dapat mengkueri hingga 51 model secara paralel, memberi skor setiap respons pada metrik komposit, dan merangkingnya. Penilaian mempertimbangkan relevansi, koherensi, dan kualitas respons. Bagi prompt engineer yang menguji bagaimana model berbeda menangani instruksi yang sama, di sinilah nilai sebenarnya berada.

Tapi tidak murah. Menjalankan 51 model secara paralel berarti 51 panggilan API terpisah, masing-masing ditagih melalui OpenRouter. Saya menjalankan prompt dengan kompleksitas sedang melalui konfigurasi 10 model dan biayanya moderat — beberapa sen. Dengan 51 model, jumlahnya bertambah.

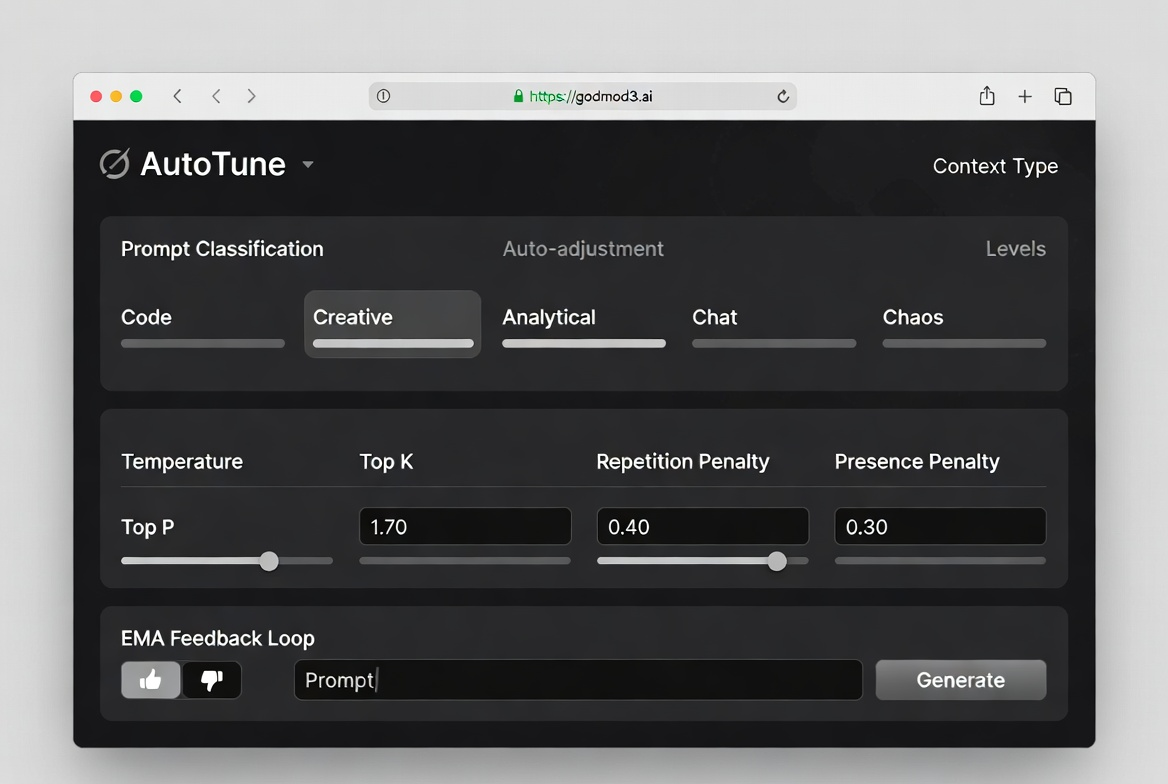

AutoTune — mengapa kamu tidak perlu lagi mengatur temperature secara manual

AutoTune mengklasifikasikan promptmu ke salah satu dari lima jenis konteks — kode, kreatif, analitis, chat, atau chaos — dan secara otomatis menyesuaikan temperature, top_p, top_k, dan parameter penalti. Ini menggunakan feedback loop berbasis EMA: jempol ke atas atau ke bawah pada respons menyempurnakan pemilihan parameter di masa mendatang.

Saya masih belum sepenuhnya yakin seberapa besar perbedaan yang dihasilkan ini dibandingkan mengatur temperature secara manual ke 0.7 dan membiarkannya. Setelah seminggu penggunaan, pilihan parameter terasa masuk akal tetapi tidak jauh lebih baik dari default saya. Kesimpulan ini memiliki tanggal kedaluwarsa — feedback loop membutuhkan lebih banyak data untuk konvergen.

Parseltongue — perturbasi input untuk peneliti keamanan (dan apa yang bukan tujuannya)

Parseltongue adalah modul penelitian red-team. Ia mendeteksi kata pemicu dan menerapkan transformasi tingkat karakter — leetspeak, substitusi Unicode, encoding fonetik — untuk mempelajari bagaimana model merespons input adversarial. Makalah penelitian proyek ini secara eksplisit memposisikannya sebagai alat evaluasi keamanan AI untuk menguji ketahanan model pada waktu inferensi.

Ini bukan alat bypass konten. Ini dirancang untuk penelitian terkontrol tentang bagaimana lapisan keamanan merespons perturbasi input. Perbedaannya penting. Jika kasus penggunaanmu adalah “saya ingin mengelabui AI agar mengatakan sesuatu yang seharusnya tidak,” itu bukan tujuan modul ini dibangun, dan dokumentasi proyek mengatakannya secara langsung.

Akses Model Melalui OpenRouter

Model apa saja yang tersedia

Melalui OpenRouter, godmod3 dapat mengakses Claude, GPT-4o, Gemini, Grok, Mistral, Llama, DeepSeek, Qwen, dan puluhan lainnya. Katalog model OpenRouter mencantumkan 300+ pilihan dari 60+ penyedia per April 2026. Tidak semuanya berguna untuk setiap tugas, tetapi luasnya berarti kamu tidak mungkin menemui dinding “model tidak tersedia”.

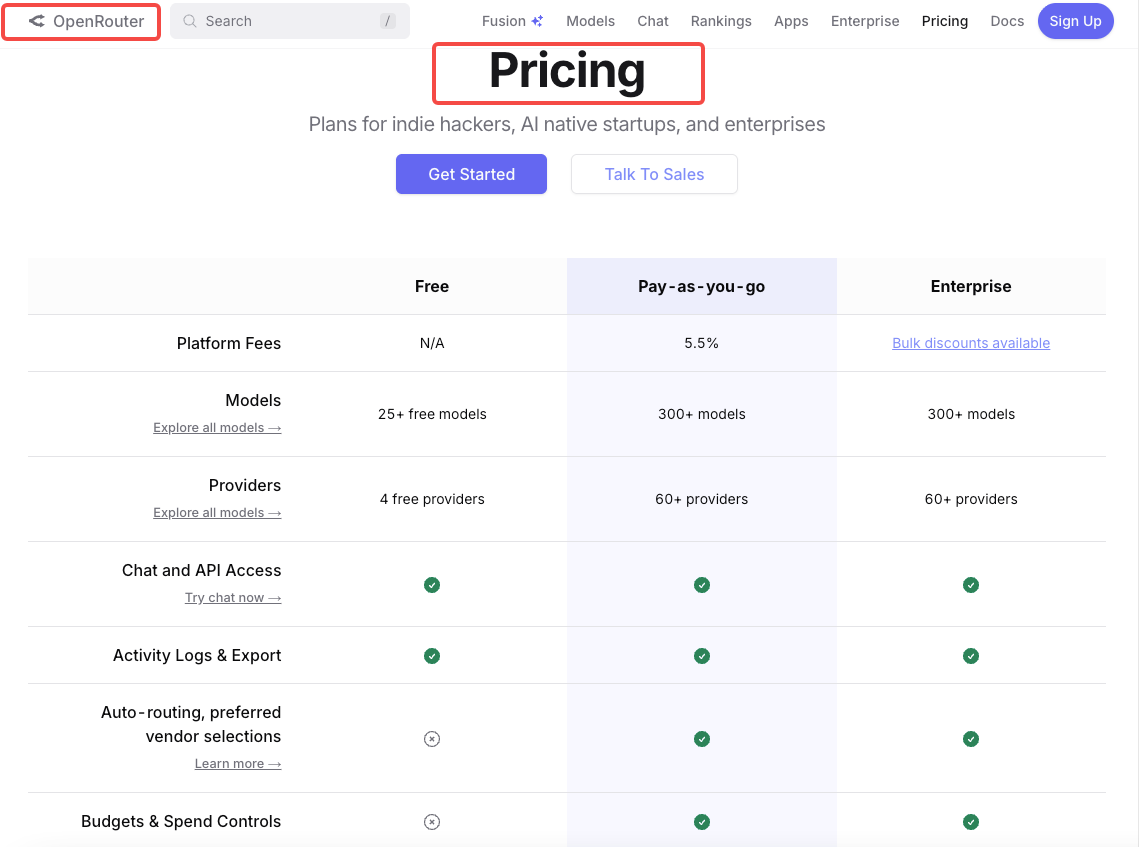

Realitas harga: kamu membayar OpenRouter per token, bukan godmod3

Godmod3 sendiri gratis. Biayamu berasal dari penagihan per token OpenRouter, yang meneruskan harga setiap penyedia pada atau mendekati tarif API langsung. Menjalankan prompt melalui satu model biayanya sama dengan memanggil API model tersebut secara langsung. Menjalankannya melalui sepuluh model biayanya sepuluh kali lipat.

Halaman harga OpenRouter merincikan tarif per token berdasarkan model. Tidak ada biaya bulanan, tidak ada pengeluaran minimum. Kamu menambahkan kredit dan kredit tersebut berkurang saat kamu menggunakannya.

Model gratis di OpenRouter yang bisa kamu gunakan dengan godmod3 hari ini

OpenRouter mempertahankan koleksi model gratis — saat ini sekitar 29 pilihan termasuk DeepSeek R1, Llama 3.3 70B, Qwen3 Coder, dan beberapa varian Gemma. Model gratis memiliki batas rate (biasanya 20 permintaan per menit, 200 per hari) tetapi tidak memerlukan kredit.

Untuk menguji apakah godmod3 cocok untuk workflow-mu sebelum mengeluarkan uang, tier gratis sudah cukup untuk membentuk pendapat.

Apa yang Bukan Godmod3

Bukan backend — riwayat chat hanya ada di browser kamu

Tidak ada akun, tidak ada sinkronisasi cloud, tidak ada penyimpanan sisi server. Hapus data browser-mu dan percakapanmu hilang selamanya. Ganti perangkat dan tidak ada yang mengikutimu. Mode penjelajahan pribadi membuang semuanya saat jendela ditutup.

Ini adalah fitur privasi, bukan keterbatasan — tetapi artinya godmod3 adalah notepad sementara, bukan basis pengetahuan.

Bukan pengganti untuk API produksi

Jika kamu membangun produk yang memanggil LLM, kamu membutuhkan integrasi API langsung dengan logika retry, penanganan error, dan manajemen batas rate. Godmod3 adalah antarmuka penelitian dan evaluasi, bukan infrastruktur produksi. Dokumentasi proyek sendiri jelas tentang ini.

Bukan alat bypass — tujuan Parseltongue dalam penelitian keamanan AI

Perlu diulang: Parseltongue ada untuk mempelajari ketahanan model dalam kondisi terkontrol. Proyek ini memposisikan dirinya dalam lanskap penelitian keamanan AI yang lebih luas bersama kerangka kerja seperti Constitutional AI dan RLHF. Ini menyediakan alat evaluasi waktu inferensi — bukan modifikasi waktu pelatihan. Risiko penggunaan ganda diakui dalam dokumentasi, dan pengguna bertanggung jawab atas kepatuhan terhadap hukum setempat.

Siapa yang Mendapat Nilai Paling Banyak dari Godmod3

Prompt engineer yang membutuhkan perbandingan multi-model cepat

Jika kamu menguji bagaimana sebuah prompt berperforma di Claude, GPT-4o, dan Gemini sebelum berkomitmen pada satu model, godmod3 memampatkan workflow tersebut dari “tiga tab, tiga login, perbandingan manual” menjadi “satu prompt, satu layar, hasil berperingkat.” Itulah nilai utamanya.

Developer yang mengevaluasi LLM mana yang cocok untuk kasus penggunaan mereka sebelum berkomitmen pada API

Sebelum kamu mengintegrasikan API dan membangun di sekitar keunikannya, kamu ingin tahu: apakah model ini menangani kasus penggunaanku dengan baik? Menjalankan prompt uji yang sama melalui 5-10 model secara paralel memberimu matriks perbandingan dalam hitungan menit, bukan hari.

Peneliti yang melakukan studi perilaku LLM terkontrol

Kombinasi AutoTune (variasi parameter), Parseltongue (perturbasi input), dan ULTRAPLINIAN (penilaian lintas model) menciptakan pipeline evaluasi terstruktur. Bagi peneliti akademis atau industri yang mempelajari bagaimana model merespons dalam kondisi berbeda, ini adalah toolkit siap pakai yang tidak memerlukan pembangunan infrastruktur khusus.

FAQ

Apakah godmod3.ai sama dengan G0DM0D3 di GitHub?

Ya. “Godmod3” dan “G0DM0D3” mengacu pada proyek yang sama. Versi hosted di godmod3.ai menjalankan codebase yang sama dengan repositori GitHub. Perbedaan utamanya adalah versi hosted tidak menyertakan fitur pengumpulan dataset opt-in — itu hanya tersedia saat self-hosting dengan server API berbasis Docker penuh.

Apakah saya perlu membayar untuk menggunakan godmod3?

Alatnya sendiri gratis. Kamu membutuhkan API key OpenRouter, dan OpenRouter menagih per token saat menggunakan model berbayar. Kamu bisa menggunakan model gratis di OpenRouter dengan biaya nol, tergantung batas rate. Tidak ada langganan, tidak ada biaya platform dari godmod3.

Apakah API key saya aman di godmod3.ai?

OpenRouter key-mu disimpan di localStorage browser-mu dan dikirim langsung ke API OpenRouter. Ini tidak pernah menyentuh server godmod3. Meski begitu, kamu mempercayai kode sisi klien untuk tidak mengeksfiltrasinya — itulah mengapa codebase open-source penting. Kamu bisa mengauditnya sendiri, atau self-host untuk kontrol penuh.

Bisakah saya menggunakan godmod3 tanpa akun OpenRouter?

Tidak. OpenRouter adalah lapisan routing untuk semua akses model. Kamu membutuhkan akun OpenRouter dan API key. Pembuatan akun gratis dan tidak memerlukan kartu kredit jika kamu hanya menggunakan model gratis.

Apa yang terjadi pada riwayat chat saya jika saya menutup browser?

Itu tetap ada di localStorage sampai kamu menghapus data browser. Tapi tidak ada backup, tidak ada sinkronisasi, tidak ada pemulihan. Jika kamu perlu menyimpan percakapan, salin secara manual sebelum menutup tab.

Saya sudah menggunakan godmod3 selama sekitar sepuluh hari. Ini belum menggantikan langganan Claude atau GPT langsung saya — keduanya masih penting untuk workflow percakapan panjang di mana kontinuitas konteks menjadi penting. Tapi untuk tugas spesifik “model mana yang paling baik menangani prompt ini,” ini memangkas waktu perbandingan saya dari menit menjadi detik.

Itulah yang bisa saya konfirmasi. Sisanya perlu kamu verifikasi sendiri.

Postingan sebelumnya: