Kebocoran GPT-5.4: Yang Perlu Diketahui Developer

GPT-5.4 sempat muncul di repositori OpenAI Codex sebelum dihapus. Inilah apa yang mungkin ditandakan oleh kebocoran tersebut bagi para developer.

Hai, saya Dora. Saya tidak sedang mencari model baru. Saya hanya sedang membersihkan pipeline build ketika melihat sebuah thread yang menyebarkan screenshot commit yang menyebut “GPT 5.4.” Tanpa fanfare, hanya satu baris kecil dalam sebuah pull request. Saya berhenti sejenak, bukan karena butuh akronim baru hari itu, tapi karena petunjuk kecil yang tidak sengaja seringkali bercerita lebih banyak daripada peluncuran yang meriah.

Tersedia di WaveSpeedAI — harga per-token transparan, endpoint kompatibel OpenAI. GPT-5.4 API → · GPT-5.5 API → · Buka Playground →

Selama minggu pertama Maret 2026, saya mengikuti jejak-jejak itu: cached diff, obrolan developer, dan sebuah PR yang sepertinya muncul lalu menghilang. Saya tidak menguji GPT 5.4 (tidak ada yang resmi untuk diuji), tapi saya mengamati dengan cermat apa yang tampaknya direferensikan oleh kode tersebut dan bagaimana kode itu ditangani. Nada dari jejaknya hampir sama pentingnya dengan isinya.

Bagaimana GPT-5.4 Muncul ke Permukaan

Referensi Codex PR

Saya pertama kali melihat penyebutan GPT 5.4 yang terkait dengan perubahan singkat dalam sebuah repositori yang tampaknya menyentuh konteks “Codex”, entah itu penamaan lama atau path internal yang masih menggunakan “codex” sebagai wadah untuk alur coding. Cuplikan yang beredar menampilkan beberapa hal yang biasa Anda temukan seputar routing model dan feature flag, tidak ada yang terlihat seperti “peluncuran,” lebih seperti pipa ledeng. Jika Anda pernah bekerja dengan pergantian model, Anda tahu baris-baris ini biasanya membosankan sekaligus penting.

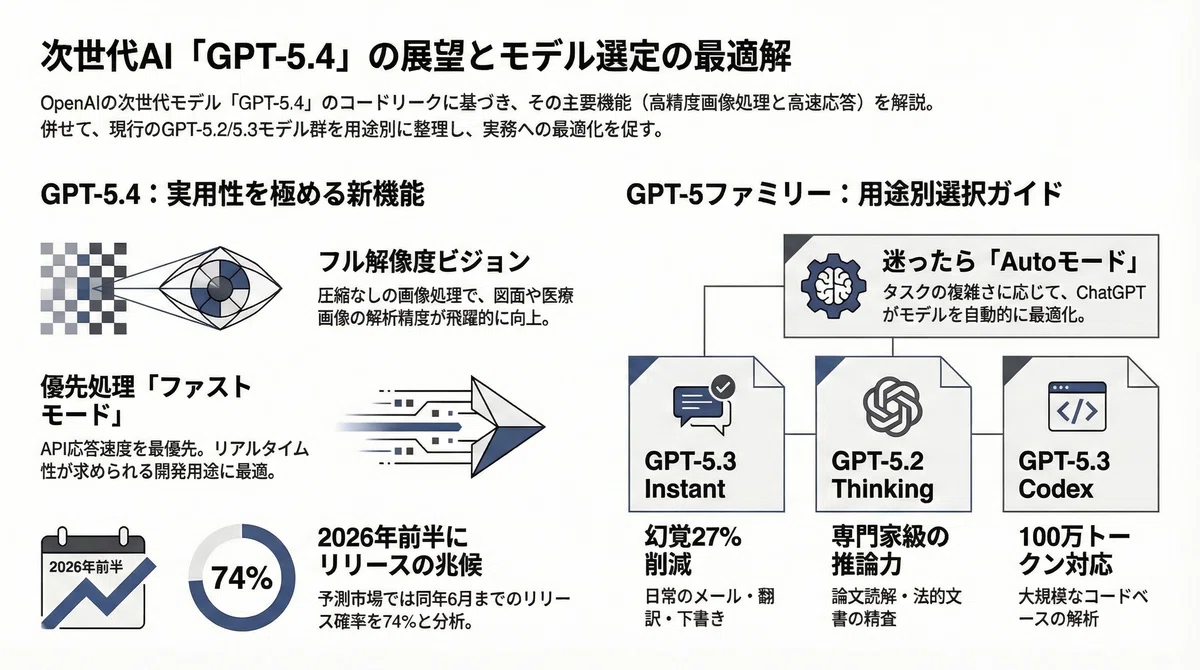

Dua hal yang menonjol dalam cuplikan tersebut: referensi ke switch “/fast” dalam lapisan perintah chat atau agen, dan label kemampuan yang terdengar seperti visi resolusi penuh. Saya menyebutkan ini secara spesifik karena penting. Label tidak selalu sesuai dengan kenyataan, tapi jarang sekali acak.

Mengapa kode tersebut cepat dihapus

Commit itu tidak bertahan lama. Dari apa yang saya lihat, branch-nya ditulis ulang dan diff PR-nya dibersihkan. Itu hal biasa ketika sebuah tim memasukkan referensi terlalu dini atau mencampurkan konfigurasi internal dan eksternal secara tidak sengaja. Dengan kata lain: terlihat seperti pemeliharaan rutin di bawah tekanan, bukan sebuah penghapusan terencana.

Saya pernah melakukan hal yang sama di tim yang lebih kecil, menyadari ada flag yang seharusnya tidak terekspos, melakukan force-push, lalu melanjutkan. Kecepatan koreksinya mengisyaratkan bahwa seseorang di hulu memperhatikan perbincangan dan memutuskan untuk menutup celah tersebut. Bukan skandal. Hanya pengendalian situasi.

Apa yang biasanya ditandai oleh penghapusan force-push

Force-push tidak membuktikan sesuatu yang istimewa. Biasanya menandakan urgensi dan keinginan untuk mengembalikan repositori ke kondisi yang diketahui. Anda dapat membaca pandangan Git sendiri tentang penulisan ulang riwayat dalam dokumentasinya, alat yang berguna dan tajam, mudah melukai diri sendiri jika tidak berhati-hati. Jika Anda melihat force-push di tengah kebocoran, itu sering berarti tim memperlakukan kebocoran tersebut sebagai gangguan, bukan pengungkapan yang terkoordinasi.

Sebagai konteks (bukan bukti), berikut referensi netral: catatan Git tentang force pushing dan penulisan ulang riwayat. Dunia berbeda, pola yang sama.

Apa yang Sebenarnya Ditunjukkan oleh Kode yang Bocor

Perintah mode cepat (/fast)

Baris yang menyebut perintah “/fast” terbaca, bagi saya, seperti override di level pengguna atau agen. Secara praktis, ini menunjukkan mode yang menukar sebagian kedalaman dengan kecepatan, sebuah dial yang familiar dalam router model. Jika ini terkait dengan GPT 5.4, saya akan mengharapkan token pertama yang lebih cepat, mungkin caching yang lebih agresif, mungkin ambang batas pemanggilan tool yang lebih longgar. Tidak ada yang mencolok, tapi berguna ketika Anda berada di dalam loop yang menjalankan puluhan pemeriksaan kecil.

Ini tidak terdengar seperti fitur yang menang di demo. Kedengarannya seperti sesuatu yang akan Anda aktifkan selama deployment atau langkah CI ketika Anda lebih peduli pada latensi daripada keanggunan, katakanlah, normalisasi doc string, refaktor kecil, atau diff skema yang tidak memerlukan prosa sempurna.

Referensi visi resolusi penuh

“Visi full-res” adalah frasa yang penuh makna. Dalam praktiknya, itu bisa berarti batas input yang lebih tinggi, penanganan screenshot UI yang padat lebih baik, atau downscaling yang lebih sedikit agresif sebelum model melihat piksel. Jika akurat, ini condong ke alur kerja di mana kesetiaan penting, membaca kode aktual dalam screenshot, meninjau status UI, atau mengekstrak struktur dari diagram tanpa mengaburkan detailnya.

Saya bekerja dengan banyak catatan produk yang dikemas dalam gambar, mock dengan anotasi kecil, redline, hal-hal semacam itu. Jika GPT 5.4 menangani itu secara native pada resolusi lebih tinggi, itu akan menghilangkan pajak kecil tapi konstan: langkah persiapan di mana saya memotong atau mengenkode ulang gambar agar model bisa melihat apa yang saya lihat.

Sinyal agen coding dalam konteks Codex

Referensi Codex terasa seperti scaffolding untuk agen coding. Bukan keajaiban “buatkan saya sebuah aplikasi,” lebih seperti otot-otot kecil: pemilihan tool, pemanggilan fungsi, kebijakan retry, dan fallback ketika sebuah panggilan mengembalikan sesuatu yang tidak terduga. Petunjuk yang saya lihat mengarah ke lapisan itu, bukan ke judul utama.

Jika pembacaan itu benar, GPT 5.4 mungkin disetel untuk alur coding agentik yang bertahan dalam kekacauan repositori nyata: tes yang tidak lengkap, lingkungan yang tidak stabil, manajer dependensi yang beragam. Lebih sedikit “coder jenius,” lebih banyak “rekan kerja yang andal yang tidak berhenti setelah kesalahan kedua.” Saya bisa bekerja dengan itu.

Untuk Apa GPT-5.4 Kemungkinan Dibangun

Alur kerja coding AI

Saya tidak berpikir GPT 5.4 sedang mengejar hal baru. Jejaknya menunjukkan tangan yang lebih stabil pada loop-loop umum: membaca kode, membuat suntingan kecil, memvalidasi, dan mencoba lagi tanpa drama. Jika Anda merilis fitur di tengah kendala nyata, ritme itu lebih penting daripada kecemerlangan sesekali.

Sebuah tebakan, yang berpijak pada apa yang saya lihat dan apa yang terus muncul di tim-tim yang saya kerjakan: GPT 5.4 mungkin dimaksudkan untuk duduk lebih dekat ke kode, bukan ke slide deck. Ini kemungkinan menarget diff yang cukup cepat, pembaruan doc yang konsisten, refaktor yang lebih aman, dan saran pragmatis yang bertahan di tahap running.

Optimasi loop agen

Loop agen rapuh karena alasan-alasan yang membosankan, timeout, kesalahan tool, pergeseran konteks, dan upaya yang tidak pernah konvergen. Petunjuk “/fast” terbaca seperti cara untuk menjaga loop tetap cepat, sementara referensi visi menunjukkan bahwa agen bisa membaca apa yang sebenarnya disampaikan manusia (screenshot, log, foto terminal) tanpa repot tambahan.

Jika benar, dua keuntungan kualitas hidup bisa muncul:

- Lebih sedikit retry manual: pengetikan error yang lebih jelas dan logika back off yang lebih tenang mengurangi kekacauan.

- Pemanggilan tool yang lebih ketat: lompatan yang lebih murah dan cepat ketika sebuah langkah tidak memerlukan penalaran penuh.

Ini tidak menghemat waktu saya pada awalnya, melacak kebocoran tidak pernah begitu, tapi bentuknya terasa seperti upaya mental yang berkurang bagi tim yang mengotomatiskan bagian-bagian membosankan dari pemeliharaan kode.

Integrasi tooling developer

Cara referensi tersebut tersembunyi dalam petunjuk routing memberi tahu saya bahwa GPT 5.4 mungkin dikemas untuk masuk ke dalam stack developer yang sudah ada. Pikirkan:

- Hook CI/CD yang memilih kecepatan atau kedalaman per langkah.

- Ekstensi editor yang bisa membaca gambar pada fidelitas lebih tinggi tanpa pra-pemrosesan eksternal.

- Framework agen yang lebih sedikit bergantung pada kode glue yang bespoke.

Jika ke sanalah GPT 5.4 menuju, nilainya tidak akan ada dalam demo: melainkan dalam adapter yang lebih sedikit rapuh. Itulah jenis peningkatan yang Anda perhatikan tiga minggu kemudian ketika tidak ada yang rusak, dan Anda menyadari Anda tidak perlu mengawasi agen pada hari Jumat.

Yang Masih Belum Kita Ketahui

Tidak ada benchmark yang dikonfirmasi

Saya belum melihat benchmark yang kredibel terkait GPT 5.4. Tidak ada lembar eval, tidak ada tugas terstandarisasi, tidak ada perbandingan head-to-head dengan model saat ini. Tanpa angka, yang kita miliki hanyalah kesan dan label. Jika dan ketika ini diluncurkan, saya akan mencari terlebih dahulu pengujian kecil yang praktis: waktu-untuk-memperbaiki pada tes yang gagal, akurasi membaca screenshot yang padat, atau jumlah retry per masalah yang diselesaikan.

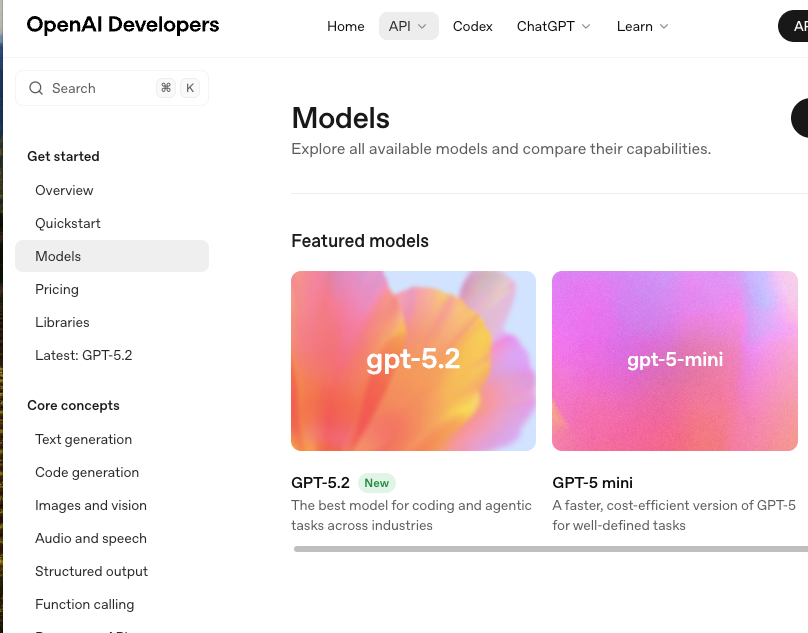

Tidak ada detail harga atau API

Tidak ada yang publik tentang harga atau kuota. Untuk perencanaan, itu lebih penting daripada hype. Model yang bagus tapi sulit dianggarkan tidak masuk ke produksi. Jika Anda memetakan skenario hari ini, simpan placeholder di spreadsheet Anda dan lakukan sanity-check terhadap dokumentasi model OpenAI saat ini daripada label yang bocor.

Timeline rilis tidak jelas

Saya tidak punya tanggal, kuartal, atau bahkan musim. Penghapusan cepat menunjukkan gerakan internal, bukan timing pasar. Jika GPT 5.4 muncul, mungkin akan muncul secara diam-diam dalam tabel routing atau sebagai flag dalam framework agen sebelum ada banner besar apa pun. Atau mungkin berganti nama dan tidak pernah disebut “GPT 5.4” secara publik sama sekali.

Status Saat Ini & Penafian (model belum dirilis secara resmi)

Per awal Maret 2026, GPT 5.4 belum diumumkan atau didokumentasikan. Saya berbagi pengamatan dari referensi kode yang berumur pendek dan cara penanganannya, tidak lebih dari itu. Ini bukan saran untuk merombak arsitektur apa pun. Jika Anda penasaran, perhatikan dokumen yang stabil, bukan screenshot. Dan jika Anda menemukan referensi nyasar lainnya, tarik napas dulu. Sebagian besar kebocoran lebih tenang, dan lebih berguna, daripada yang disarankan oleh judul berita.

Saya akan berhenti di sini: bagian yang menangkap perhatian saya bukan nomor versinya. Itu adalah tanda-tanda kecil kepedulian terhadap loop dan latensi. Jika ke sanalah arah semuanya, saya baik-baik saja dengan lebih sedikit tontonan.