Guide vidéo portrait LTX-2.3 : Workflows 9:16 pour les réseaux sociaux et mobiles (2026)

LTX-2.3 génère nativement des vidéos portrait en 9:16 jusqu'à 1080×1920 — sans recadrage. Voici comment configurer, créer des prompts et produire en masse des clips verticaux prêts pour les réseaux sociaux en 2026.

Bonjour, je suis Dora !

J’attendais un modèle vidéo qui traite le format portrait comme un format de première classe, et non comme une réflexion après coup. La plupart des outils génèrent encore en paysage et vous laissent recadrer. LTX-2.3 change la donne — il génère de la vidéo verticale jusqu’en 1080×1920, entraîné sur des données en orientation portrait, et non recadré depuis le paysage. Pour les équipes sociales travaillant sur TikTok et Reels, cette distinction compte plus qu’il n’y paraît.

Pourquoi le support natif du portrait est important (vs recadrage depuis le paysage)

Ce que signifie “entraîné sur des données portrait” pour la qualité de sortie

Quand un modèle génère en 16:9 et que vous recadrez en 9:16, il ne composait pas pour le vertical. Les sujets se retrouvent décentrés, le ciel remplit le tiers inférieur, et les trajectoires de mouvement semblent inappropriées sur un écran de téléphone.

LTX-2.3 est disponible à la fois comme modèle open-source et via l’API LTX, avec le support portrait intégré dans le pipeline d’entraînement — pas ajouté après coup. Le modèle a vu une composition verticale en premier pendant l’entraînement, ce qui signifie que le placement des sujets, les arcs de mouvement et les déplacements de caméra sont tous calibrés pour une visualisation en cadre vertical.

Le support portrait 9:16 offre une qualité grandement améliorée pour les vidéos portrait verticales, idéale pour les réseaux sociaux et le mobile. Ce n’est pas du langage marketing — c’est une différence structurelle dans la façon dont les poids du modèle gèrent les relations spatiales spécifiques au format.

Paramètres de résolution et de fréquence d’images pour le 9:16

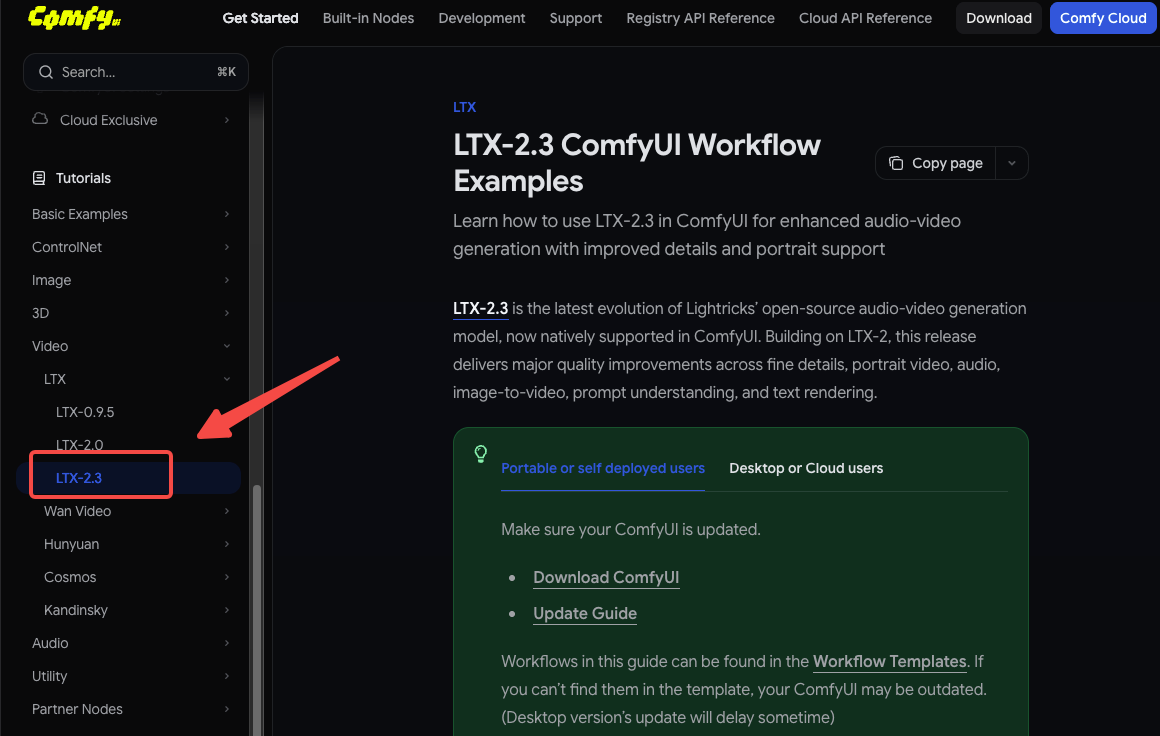

Configuration 1080×1920 dans ComfyUI et via API

La valeur par défaut pratique est 720p (736×1280) pour le 9:16. Si vous disposez d’un GPU puissant comme une RTX 5090 ou mieux, essayez 1088×1920 pour une qualité 1080p complète.

Dans ComfyUI avec les nœuds LTXVideo officiels, réglez votre nœud de résolution sur 768×1280 pour un bon équilibre VRAM/qualité sur une carte 24 Go. Pour les utilisateurs API, la documentation de l’API LTX accepte aspect_ratio: "9:16" en parallèle avec votre paramètre de résolution — calcul manuel des dimensions requis.

Via API (configuration minimale) :

model: ltx-2-3-pro

resolution: 1080p

aspect_ratio: 9:16

fps: 2424 vs 48 FPS pour les plateformes sociales : lequel choisir

LTX-2.3 a introduit 24/48 FPS comme nouvelles options de fréquence d’images aux côtés des 25/50 FPS existants.

Pour les réseaux sociaux : utilisez 24 fps pour la plupart des contenus. TikTok et Reels transcrivent tous deux au téléchargement, et 24 fps vous offre le plus de marge sans gonfler la taille du fichier. Encodez une fois à 48 fps et convertissez en post-production si nécessaire — cela vous donne le plus de flexibilité. Réservez le 48 fps pour les contenus où la fluidité du mouvement est un argument de vente (danse, révélations de produits, émulation au ralenti).

Prompts pour une composition verticale

Langage de cadrage vertical en premier

Le modèle répond au langage de cadrage. Pour une sortie portrait, commencez par des indices d’orientation avant de décrire le sujet :

- ✅

cadre vertical, gros plan portrait, sujet centré dans la moitié supérieure... - ✅

composition écran de téléphone, plan vertical plein corps, espace négatif en bas... - ❌

plan d'ensemble large, panorama paysager...(tire vers une composition horizontale)

Placement du sujet et évitement des sorties biaisées paysage

Même avec un entraînement portrait natif, le modèle peut dériver vers des compositions horizontales lorsqu’il est prompté avec un langage de scène large. Si votre sujet continue de dériver vers le centre-large au lieu du vertical-haut : ajoutez des ancres verticales explicites comme cadre vertical, espace négatif vertical, ou orientation portrait, visage dans le tiers supérieur.

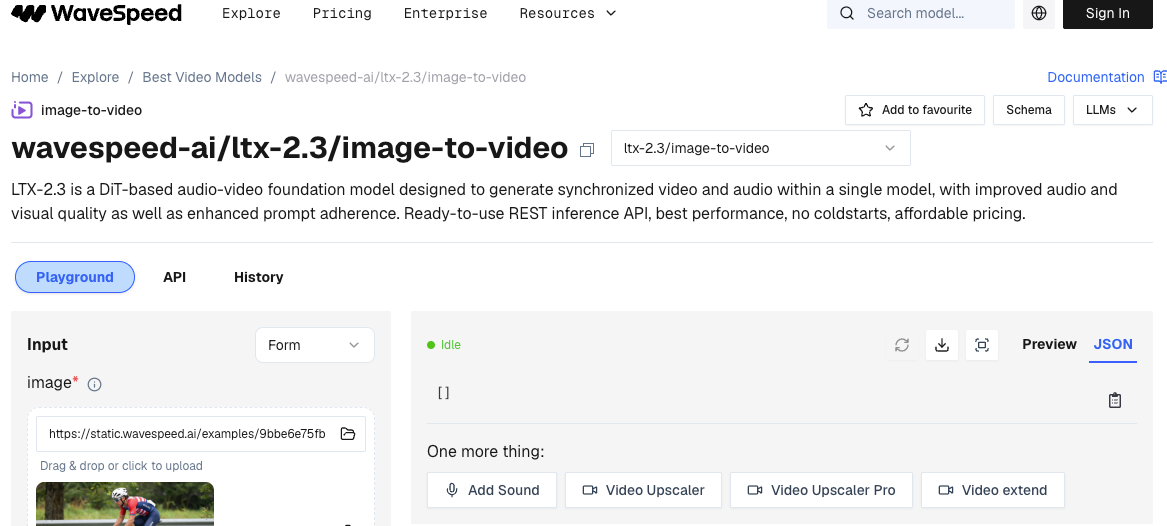

Pour le contenu de type talking-head ou avatar, l’implémentation LTX-2.3 de WaveSpeed note que les clips portrait fonctionnent mieux lorsque vous décrivez le mouvement par rapport à un axe vertical — les inclinaisons de caméra, les panoramiques verticaux et les plans ascendants renforcent tous le cadre vertical.

Audio dans les workflows portrait : ce qu’il faut inclure et ce qu’il faut ignorer

Quand l’audio natif apporte de la valeur pour les réseaux sociaux (ambiant, contenu son activé)

Les effets sonores, les bruits ambiants et les dialogues sont synchronisés dès la génération — un endpoint audio-vers-vidéo dédié vous permet de fournir un clip audio et de générer des visuels correspondants.

Utilisez l’audio natif quand : votre contenu est en son activé (scènes ambiantes, clips nature, énergie de foule). Les améliorations audio de LTX-2.3 rendent le son atmosphérique genuinement utilisable sans post-traitement — artefacts réduits, dialogue plus propre.

Quand ignorer l’audio et l’ajouter en post-production

Ignorez l’audio natif pour les contenus dirigés par voix off, la synchronisation musicale, le son de marque, ou tout ce qui nécessite une édition audio précise. Générez uniquement la vidéo, puis superposez l’audio dans votre NLE. La variante Pro est requise pour les endpoints audio-vers-vidéo, retake et extend — si vous ne générez que de la vidéo pour une piste musicale que vous ajoutez en post-production, la variante Fast économise coût et temps.

Workflow de production en lot pour les équipes sociales

Pipeline story-board vers clip pour une production à volume élevé

Pour les équipes générant plus de 20 clips par jour, le pipeline pratique est :

- Script → storyboard avec des notes de cadrage spécifiques au portrait par plan

- Prompts en lot via l’API LTX — l’API est sans état, donc les requêtes parallèles s’exécutent indépendamment

- Contrôle qualité — signaler les sorties avec dérive du sujet ou biais paysage pour régénération

- Couche audio en post-production si dirigée par la musique

Utiliser la variante Fast pour les brouillons, Pro pour les finaux

Commencez avec Fast pour explorer les compositions rapidement, puis passez à Pro pour le rendu final. Fast est optimisée pour la vitesse et le faible coût — idéale pour le prototypage rapide, le brainstorming, le storyboarding et l’itération rapide. Pro offre une fidélité plus élevée avec une meilleure stabilité du mouvement et des détails visuels.

Modèle de coût de lot typique : exécutez 10 brouillons Fast pour verrouiller la composition et le timing, puis un rendu Pro pour la livraison. Cela réduit le coût d’itération d’environ 60 % par rapport à l’utilisation de Pro tout au long.

Extend-Video pour les séquences plus longues sans régénération

L’endpoint v1/extend étend la durée de la vidéo en générant des images supplémentaires. Pour les séquences portrait de plus de 8 à 10 secondes, étendez plutôt que régénérez — cela préserve la cohérence du sujet sur le clip étendu. Définissez une fenêtre de contexte de 2 à 3 secondes depuis la queue du clip pour la jointure la plus fluide.

Limitations et échecs courants

Dérive du sujet dans les longs clips verticaux

Au-delà de 12 à 15 secondes, les clips portrait peuvent montrer une dérive du sujet — le modèle déplace progressivement la position du sujet vers le cadre central. Atténuation : utilisez Extend-Video en segments plus courts (8s + 8s) plutôt qu’une génération de 16 secondes.

Quand le paysage recadré et affiné surpasse le portrait natif

Le portrait natif n’est pas toujours le bon choix. Pour le contenu d’action large (sports, scènes de foule, plans de véhicules), la génération paysage suivie d’un recadrage intelligent produit encore une meilleure composition horizontale et un mouvement naturel. Le modèle fonctionne mieux avec des formats d’image grand écran comme 16:9 ou 21:9 — les formats portrait peuvent produire des résultats distordus pour certains types de contenu. Testez les deux approches avant de vous engager sur le portrait pour chaque type de contenu.

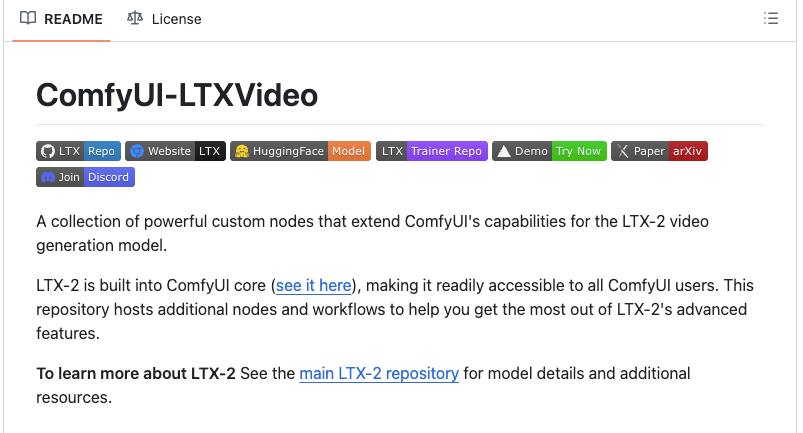

Le dépôt GitHub ComfyUI-LTXVideo inclut des workflows de référence pour les deux approches — utiles pour une comparaison côte à côte sans reconstruire les nœuds depuis zéro.

FAQ

Q1 : Quelle est la résolution maximale pour la sortie portrait de LTX-2.3 ?

LTX-2.3 prend en charge la génération texte-vers-vidéo, image-vers-vidéo et audio-vers-vidéo jusqu’en 1080p, incluant le portrait natif (9:16). En pratique, 1080×1920 est le plafond pour les portraits. Pour la plupart des workflows sociaux, 720p (736×1280) est la valeur par défaut pratique — c’est plus rapide, moins cher, et les plateformes transcrivent de toute façon.

Q2 : Le mode portrait nécessite-t-il des LoRAs différents du paysage ?

Non. LTX-2.3 prend en charge le fine-tuning LoRA, vous permettant de personnaliser le modèle pour des styles, personnages ou cas d’usage spécifiques. Les LoRAs entraînés sur des données paysage se transfèrent généralement à la génération portrait — le comportement de cadrage est contrôlé par votre prompt et vos paramètres de résolution, pas par les poids LoRA eux-mêmes. Cela dit, les LoRAs entraînés sur des données spécifiques au portrait produiront des compositions verticales plus cohérentes.

Q3 : Comment la qualité portrait de LTX-2.3 se compare-t-elle à Kling pour le contenu social ?

Les benchmarks directs varient selon le type de contenu. L’avantage de LTX-2.3 est les poids ouverts, l’accès API et l’entraînement portrait natif — Kling reste uniquement cloud avec moins de transparence sur les données d’entraînement. Pour le contenu portrait ambiant et orienté scène, LTX-2.3 est compétitif en 1080p. Pour les sujets humains très stylisés, le modèle fermé de Kling a encore un avantage dans certaines catégories. Testez sur votre type de contenu spécifique avant de décider.

Q4 : Puis-je générer des clips portrait en lot via API ?

Oui. L’API LTX est conçue pour les charges de travail réelles avec des performances prévisibles à n’importe quel volume — sorties stables, fidélité cohérente et fiabilité de niveau infrastructure. Les requêtes portrait et paysage utilisent le même endpoint. Ajoutez aspect_ratio: "9:16" à votre corps de requête. Consultez le changelog de l’API LTX pour les spécifications actuelles des paramètres.

Q5 : L’application LTX Desktop prend-elle en charge la génération portrait ?

LTX Desktop est un éditeur vidéo complet construit sur le moteur LTX-2.3, fonctionnant localement sur votre matériel avec des poids ouverts et sans dépendance cloud. La génération portrait est prise en charge — réglez la résolution sur un ratio 9:16 dans les paramètres de sortie. Notez que la plateforme fal.ai LTX-2.3 offre une alternative serverless si la VRAM locale est une contrainte pour les rendus portrait 1080p.

Conclusion

Le support portrait natif de LTX-2.3 est un véritable changement au niveau de l’entraînement, pas un contournement par recadrage. Pour les équipes sociales, cela signifie un meilleur placement des sujets, un mouvement plus naturel et moins de corrections de composition au stade de la sortie.

Les règles pratiques sont simples : 720p pour la plupart des livraisons, Fast pour les brouillons et Pro pour les finaux, Extend pour tout ce qui dépasse 12 secondes. Pour le contenu d’action large, paysage-puis-recadrage reste gagnant — utilisez le bon outil pour le plan.

Le pipeline que vous construisez maintenant portera ses fruits. Mettez en place le workflow correctement, et les améliorations de qualité suivront d’elles-mêmes.

Articles précédents :

- Quoi de neuf dans LTX-2.3 (Analyse des mises à jour 2026)

- LTX-2.3 vs Wan 2.2 : Comparaison complète pour les workflows vidéo IA

- Guide des endpoints API LTX-2.3 (Référence complète pour développeurs)

- Comment configurer LTX-2.3 dans ComfyUI (Guide du pipeline en deux étapes)

- Guide d’entraînement LoRA LTX-2.3 (Tutoriel avancé 2026)