HappyHorse-1.0 est-il open source ? Ce que nous pouvons vérifier

HappyHorse-1.0 se revendique open source — mais les liens GitHub et HuggingFace sont actuellement indisponibles. Voici ce qui est vérifié et ce qu'il faut surveiller.

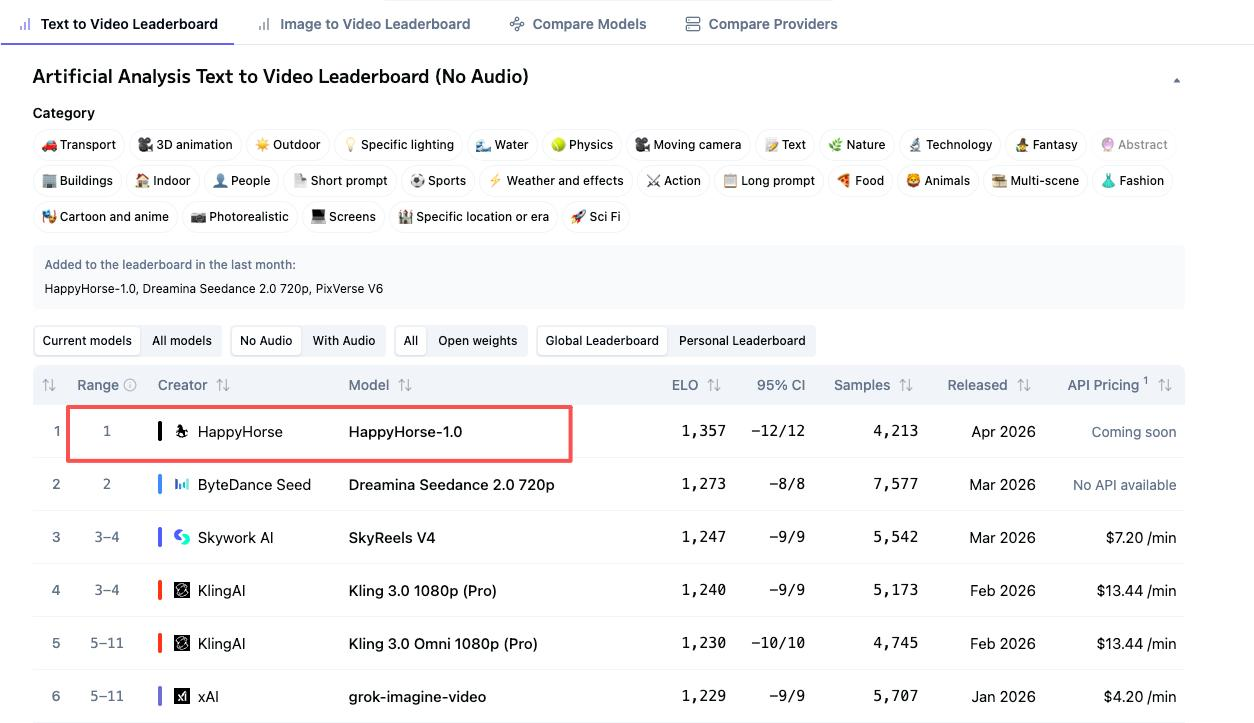

J’étais en train de configurer un pipeline WAN 2.2 local mardi dernier quand un nom que je ne reconnaissais pas est apparu en tête du classement Artificial Analysis Video Arena. HappyHorse-1.0. Elo 1333. Devant Seedance 2.0, devant Kling 3.0, devant tout ce que j’avais testé depuis un mois.

Ma première pensée n’était pas « wow ». C’était « où est le dépôt ? »

Quelqu’un dans un channel Discord que je suis m’a taguée — « Dora, tu as vu celui-là ? » — avec un lien vers le site officiel. J’ai cliqué. J’ai vu la phrase « entièrement open source » en gras. J’ai vu « GitHub — prochainement ». Et ce petit écart entre la promesse et le lien, c’est exactement le genre de chose qui me reste en tête. J’ai passé suffisamment de temps à chercher des boutons de téléchargement qui n’existent pas pour savoir la différence entre un modèle qu’on peut utiliser et un modèle dont on peut lire la description.

J’ai donc passé les heures suivantes à faire ce que je fais habituellement : tirer les fils, vérifier HuggingFace, scanner X pour trouver quelqu’un qui aurait réellement chargé des poids sur une machine locale.

Voici ce que je peux confirmer — et ce que je ne peux pas — au 8 avril 2026.

Ce que HappyHorse-1.0 affirme à propos de l’open source

Le langage sur happyhorses.io est confiant. Le site décrit le modèle comme « entièrement ouvert » et indique que le modèle de base, le modèle distillé, le modèle de super-résolution et le code d’inférence ont tous été publiés. L’architecture revendiquée est un Transformer à auto-attention unifiée de 15 milliards de paramètres sur 40 couches — sans cross-attention — capable de générer conjointement vidéo et audio à partir de texte. Il prendrait en charge sept langues pour la synchronisation labiale et utiliserait la distillation DMD-2 pour ramener le débruitage à huit étapes.

Ce sont des affirmations fortes. Mais voilà le problème : les affirmations et la disponibilité sont deux questions distinctes. Et l’écart entre les deux est exactement là où les développeurs se font piéger.

Il convient également de noter que personne n’a publiquement confirmé qui a construit HappyHorse-1.0. Artificial Analysis lui-même l’a décrit comme un modèle « pseudonyme » lors de son ajout à leur arène. Les spéculations de la communauté sur X ont varié, allant d’une variante de WAN à un concurrent de Seedance, mais rien de vérifié. Un site affilié mentionne une infrastructure ByteDance, bien que je n’aie pas pu le confirmer indépendamment non plus.

Ce qui est réellement vérifiable en ce moment

C’est là que l’histoire devient mince.

GitHub : Le site happyhorses.io possède un lien GitHub. Il indique « prochainement ». À ce jour, il n’existe aucun dépôt public — ni code, ni README, ni fichier de licence. J’ai cherché sur GitHub toute organisation ou fork associé. Rien.

HuggingFace : Même situation. Le lien « Model Hub » sur le site indique également « prochainement ». Aucune fiche de modèle n’existe sur HuggingFace, aucun fichier de poids n’est répertorié, aucun fil de discussion communautaire.

Démo : Une démo live est disponible via le site. Elle génère des clips vidéo à partir de prompts textuels. Les résultats que j’ai vus semblaient genuinement impressionnants — mouvement fluide, cohérence correcte. Mais une démo vous dit que le modèle fonctionne. Elle ne vous dit pas si vous pouvez l’exécuter vous-même, le peaufiner, ou construire dessus.

Conclusion : au moment où j’écris ces lignes, vous ne pouvez pas télécharger HappyHorse-1.0. Vous ne pouvez pas inspecter ses poids, lire sa licence, ni l’exécuter localement. Le label « entièrement open source » n’existe actuellement qu’en tant qu’intention déclarée.

Pourquoi cet écart compte pour les développeurs

Si vous êtes un développeur qui évalue si vous devez intégrer un modèle ouvert dans un pipeline de production, le label importe moins que l’artefact. Et il y a trois termes qui sont constamment confondus dans cet espace :

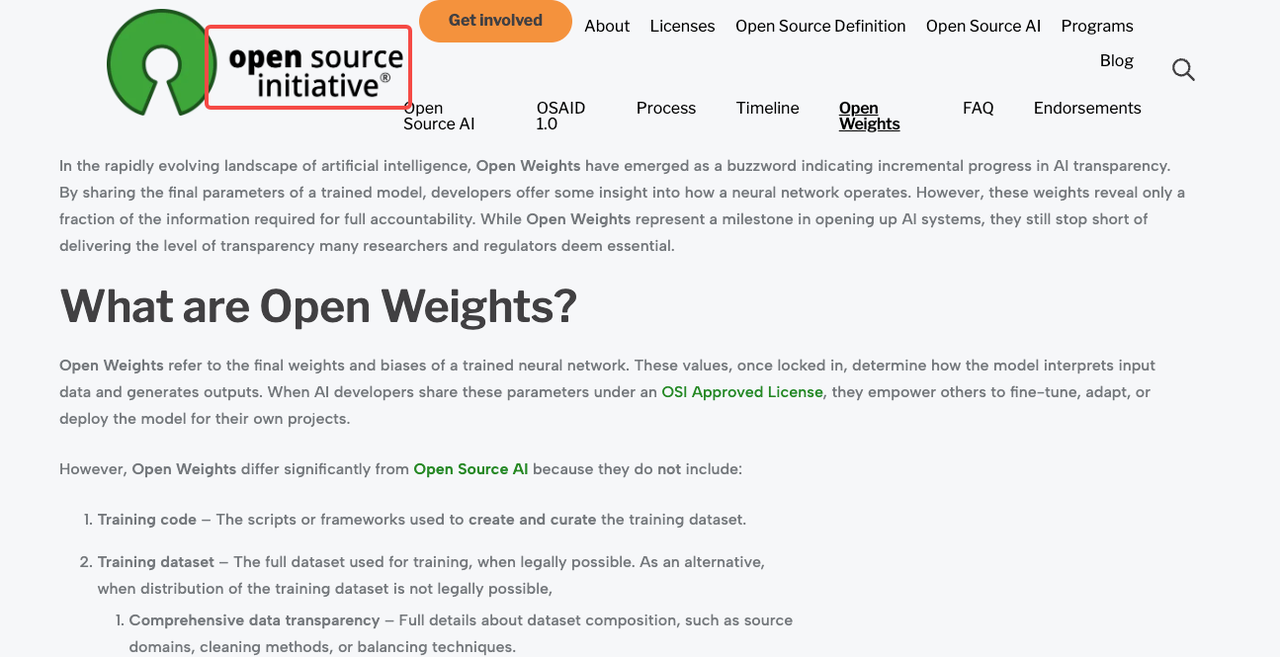

Open source signifie le package complet — poids, code d’entraînement, détails d’architecture, et une licence qui autorise la modification et la redistribution. L’Open Source Initiative a été très claire sur cette distinction : publier uniquement les poids ne suffit pas.

Open weights signifie que les paramètres entraînés sont téléchargeables et utilisables, mais les données d’entraînement, le code et la méthodologie peuvent rester privés. Vous pouvez exécuter l’inférence et affiner le modèle, mais vous ne pouvez pas le reproduire ou l’auditer entièrement.

Open access signifie que vous pouvez utiliser le modèle via une API ou une démo, mais rien n’est téléchargeable. Vous êtes locataire, pas propriétaire.

En ce moment, HappyHorse-1.0 tombe dans la troisième catégorie. Peut-être que ça changera demain. Mais construire un workflow autour d’un modèle non publié est un risque, surtout si votre calendrier dépend d’un déploiement local ou d’un affinage personnalisé.

Comment suivre l’état de publication

Si vous surveillez cet espace — et je pense que ça vaut la peine — voici où regarder :

GitHub : Restez à l’affût d’une nouvelle page d’organisation. Quand (ou si) le code est publié, c’est là qu’il atterrira. Aucun dépôt n’existe actuellement, mais le site suggère qu’un est prévu.

HuggingFace et hubs de modèles : La fiche de modèle sera le signal le plus clair. Une fois les poids publiés là avec un fichier de licence, vous pourrez commencer à évaluer sérieusement. La documentation des fiches de modèles de HuggingFace décrit à quoi ressemble une publication correcte.

Signaux communautaires : La discussion sur X a été active. Des chercheurs et créateurs de vidéos IA comparent déjà les productions de HappyHorse aux autres entrées de l’arène. Reddit et les channels Discord autour de la génération vidéo IA ont tendance à faire remonter rapidement les forks ou uploads non officiels quand ils apparaissent.

Artificial Analysis : Leur classement vidéo est probablement l’endroit le plus objectif pour suivre les performances dans le temps. Les scores Elo évoluent au fur et à mesure que les votes arrivent, donc le classement d’aujourd’hui peut ne pas tenir.

Bilan de l’open source dans la vidéo IA : un cadre de référence

Je trouve utile de comparer avec des modèles qui ont tenu leurs promesses en matière de poids ouverts. Cela vous donne une référence pour savoir à quoi ressemble le « vrai ».

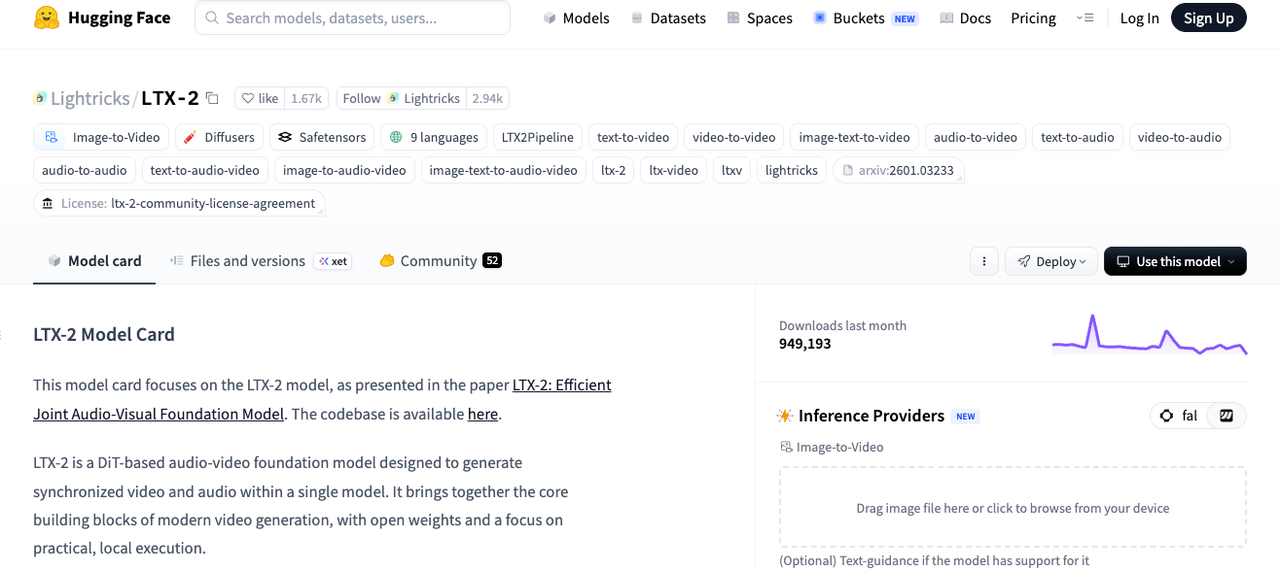

LTX-2 de Lightricks est une bonne référence. Ils ont annoncé l’open source, puis ont suivi : poids complets sur HuggingFace, un dépôt GitHub avec du code d’inférence, une intégration ComfyUI, un framework d’entraînement, et une licence claire. Vous pouvez le télécharger, l’exécuter localement, l’affiner avec des LoRAs, et construire des workflows de production autour de lui. C’est à quoi ressemble une publication crédible de poids ouverts en pratique.

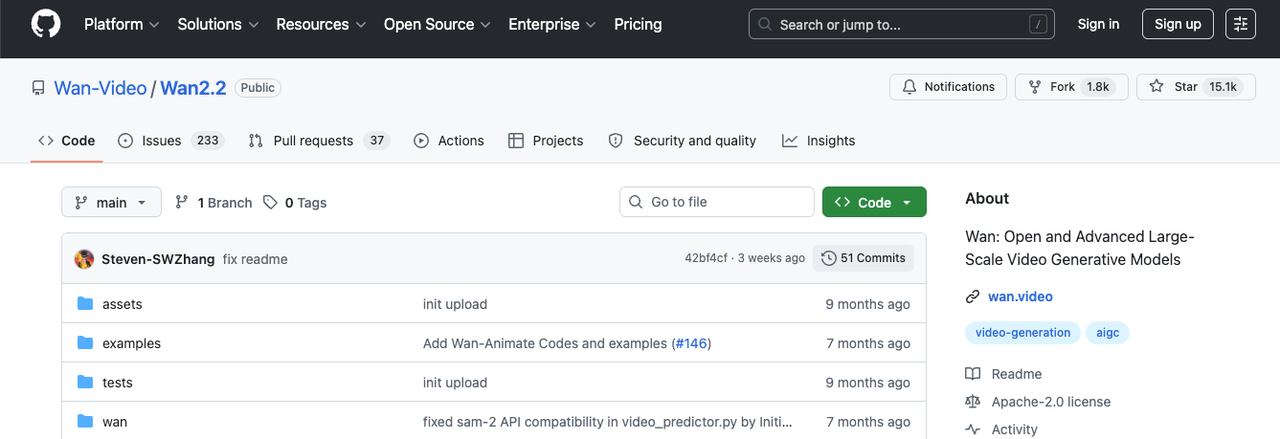

WAN 2.2 en est un autre. L’équipe d’Alibaba a publié plusieurs variantes de modèles sur HuggingFace — texte-vers-vidéo, image-vers-vidéo, une version légère 5B — avec le code d’inférence complet sur GitHub, l’intégration Diffusers, et la licence Apache 2.0. Les contributions de la communauté ont suivi rapidement : wrappers ComfyUI, versions quantifiées, expériences de distillation.

Ce qu’il faut rechercher dans toute publication pour confirmer qu’elle est réellement utilisable :

- Poids disponibles au téléchargement (pas derrière une liste d’attente ou une page « prochainement »)

- Un fichier de licence — Apache 2.0 est le feu vert le plus clair pour un usage commercial, mais même une licence personnalisée vaut mieux que rien

- Du code d’inférence qui s’exécute sans dépendances propriétaires

- Une fiche de modèle avec les détails d’architecture, les limitations et l’usage prévu

HappyHorse-1.0 n’a rien de tout cela aujourd’hui. Ce n’est pas un jugement sur la qualité du modèle — les résultats de l’arène suggèrent qu’il est genuinement solide. C’est un jugement sur son accessibilité actuelle.

FAQ

Puis-je télécharger les poids de HappyHorse-1.0 maintenant ?

Non. Au 8 avril 2026, aucun poids n’est disponible publiquement. Les liens GitHub et Model Hub sur le site officiel affichent tous deux « prochainement ». Je n’ai trouvé aucun upload tiers ni fork communautaire.

HappyHorse-1.0 est-il sur HuggingFace ?

Pas encore. Il n’y a aucune fiche de modèle, aucun fichier de poids, et aucune page organisationnelle sur HuggingFace associée à HappyHorse. Cela pourrait changer à tout moment, donc ça vaut la peine de vérifier périodiquement.

Quelle licence HappyHorse-1.0 utilisera-t-il ?

Inconnu. Le site affilié mentionne « droits d’utilisation commerciale » dans le contexte de leur plateforme hébergée, mais aucune licence de modèle autonome n’a été publiée. Jusqu’à ce qu’un fichier de licence soit livré avec les poids, il n’y a aucun moyen d’évaluer les conditions pour un déploiement auto-hébergé ou commercial.

Est-il prudent de construire des workflows commerciaux autour de HappyHorse-1.0 maintenant ?

J’attendrais. Sans poids téléchargeables, sans licence publiée, et sans même une identité de développeur confirmée, il y a trop d’incertitude pour un usage en production. Si vous avez besoin d’un modèle ouvert pour la génération vidéo commerciale aujourd’hui, LTX-2 et WAN 2.2 sont tous deux disponibles avec une licence claire.

Comment HappyHorse-1.0 se compare-t-il à LTX-2 ou WAN 2.2 sur l’ouverture ?

Sur la qualité des sorties, HappyHorse est compétitif — peut-être en avance sur certaines métriques de l’arène. Sur l’ouverture, il n’est pas dans la même catégorie en ce moment. LTX-2 et WAN 2.2 ont tous deux des poids publiés, des dépôts publics, du code d’inférence, et des licences définies. HappyHorse a une démo et une promesse. Cet écart pourrait se combler, mais ce n’est pas encore le cas.

Je reviendrai probablement sur ce sujet une fois (ou si) le dépôt GitHub est en ligne. Le modèle lui-même semble intéressant — les performances dans l’arène sont difficiles à ignorer. Mais j’ai assez d’expérience pour savoir que des démos impressionnantes et des poids téléchargeables sont deux choses très différentes.

Pour l’instant, j’observe. Je ne construis pas dessus encore.

Essayez HappyHorse-1.0 sur WaveSpeedAI

HappyHorse-1.0 est maintenant disponible sur WaveSpeedAI :

Articles précédents :