SkyReels V4 vs SkyReels V2: ¿Cuánto ha mejorado realmente el modelo?

SkyReels pasó de la generación de video de longitud infinita (V2) a la generación conjunta de audio y video (V4). Aquí te contamos exactamente qué cambió, qué mejoró y para qué sigue siendo mejor cada versión.

Hola, soy Dora. No tenía planeado comparar SkyReels esta semana. Solo quería un clip de fondo en bucle para una maqueta de página de aterrizaje, y mi configuración habitual se sentía más pesada de lo necesario. Ese pequeño peso, hacer clic entre nodos antiguos, esperar vistas previas, adivinar los tiempos del audio, me hizo pausar. Así que puse V2 y V4 uno al lado del otro y ejecuté los mismos prompts en ambos. No para coronar un ganador. Solo para ver dónde el trabajo se sentía más ligero.

Si buscas un veredicto simple, no lo encontrarás aquí. SkyReels V2 y V4 resuelven piezas distintas del rompecabezas. Esta es mi versión de notas de campo de “skyreels v4 vs v2,” escrita tras un puñado de ejecuciones reales entre febrero y marzo de 2026.

Una breve línea de tiempo de la familia SkyReels

V1 (centrada en humanos, feb. 2025) → V2 (longitud infinita) → V3 (experimentos de audio) → V4

Toqué SkyReels por primera vez alrededor de V1 a principios de 2025. Se sentía como un proyecto cuidadoso, con el humano en el bucle, más lento pero constante. V2 llegó y cambió silenciosamente el centro de gravedad: video “infinito” mediante difusión forzada. No infinito en el sentido poético, sino secuencias realmente ilimitadas a las que podías seguir alimentando fotogramas.

V3 experimentó con el audio de forma más seria. Recuerdo una alineación decente en los tiempos del habla, pero seguía sintiéndose como dos trenes compartiendo una vía: el audio en uno, el video en el otro, saludándose a través del espacio.

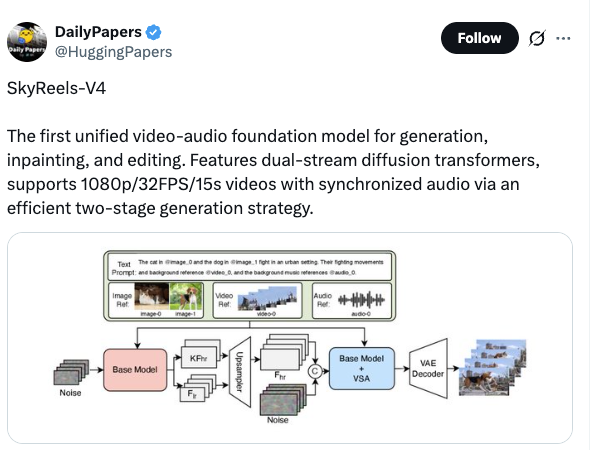

V4 lo ajusta. Diferentes prioridades, diferentes valores predeterminados. No es una actualización lineal tanto como un reinicio de lo que significa “una unidad de salida”. Con V4, un clip se convierte en un artefacto coherente, audio y video producidos juntos, con mayor calidad nativa y un límite en la duración. Ese límite es un intercambio intencional.

Lo que V2 hacía realmente bien

Difusión forzada para video infinito

La primera vez que usé la difusión forzada de V2 para formato largo, me pasé. Lo dejé correr durante el almuerzo y volví con cuatro minutos de movimiento inquietantemente consistente, como un visualizador de música que olvidó detenerse. Esa era tanto la emoción como el riesgo: podías seguir y seguir. En la práctica, aprendí a tratarlo como una cámara rodando hasta tener suficiente movimiento natural para cortar.

Para fondos en bucle, texturas y movimiento abstracto, V2 cargaba el peso. El alivio mental venía de no tener que manejar reinicios ni marcas de tiempo. Establecía una dirección y luego conservaba o recortaba según fuera necesario. Cuando quise un telón de fondo de 45 a 60 segundos para una página de evento el mes pasado, V2 me lo dio en una sola pasada. Sin costuras, sin límites de escena.

Código abierto, compatible con ComfyUI

También aprecié cómo V2 encajaba en mi flujo de trabajo existente. Nodos de ComfyUI, fragmentos de la comunidad, algunos pequeños ajustes personalizados: podía mantener mis plantas en su lugar mientras reorganizaba los muebles. Si tienes un equipo heterogéneo (como yo) y a veces colaboras con personas que traen sus propios flujos de trabajo (también yo), V2 funciona bien. Eso importa más de lo que parece. El tiempo ahorrado no son solo minutos: son menos ramificaciones mentales. Menos “¿dónde fue a parar ese nodo conversor?”

También noté que V2 era indulgente con el hardware. No barato de ejecutar, pero podía reducir la escala sin que todo se derrumbara. Si alguien me enviaba un preset, generalmente “simplemente funcionaba” después de pequeños ajustes. Es una fortaleza aburrida. Me gustan las fortalezas aburridas.

Lo que V4 cambia fundamentalmente

El audio se convierte en ciudadano de primera clase

En V4, el audio no es una idea de último momento. Está integrado. Lo probé generando un breve clip promocional para un avance de podcast el 27 de febrero y de nuevo el 2 de marzo con una base de voz ligeramente diferente. V4 sincronizó el énfasis visual con el bombo y la caja de manera más limpia que cualquier pipeline de V2 que haya ensamblado. No perfecta, pero lo suficientemente natural como para no tener que recurrir a fotogramas clave.

La versión simple: V2 podía adjuntar audio; V4 compone con él. Si tu trabajo depende de visuales sincronizados con el ritmo o de un ritmo guiado por la voz, V4 reduce el esfuerzo manual.

Arquitectura unificada frente a pipelines separados

Lo que esto se sintió: menos cambios de contexto en mi cabeza. En el mundo de V2, pensaba en el “mundo del audio” y el “mundo del video” y dedicaba tiempo a pegar las decisiones entre ellos. En V4, doy un solo resumen y dejo que el modelo lleve el contexto a través de ambos flujos. Cuando ajusté el énfasis del doblaje (una línea más suave, otra más firme), V4 reequilibró los cortes y el movimiento para que coincidieran. Con V2, eso habría significado una reconstrucción parcial.

Beneficio menos visible: menos puntos de transferencia frágiles. La cantidad de archivos que pasaba entre pasos disminuyó. Mi carpeta de proyecto lucía más ordenada: menos exportaciones temporales, menos rituales de nomenclatura. Es pequeño, pero esas pequeñas cosas indican si una herramienta respeta la forma en que la gente realmente trabaja.

Salto en resolución y calidad

El salto visual en V4 se notó más en los bordes y la consistencia del movimiento. Los detalles finos, señalización, texturas de telas, cabello contra una ventana, se mantenían más tiempo antes de difuminarse. En mis ejecuciones, la claridad nativa a 1080p se sentía confiable; las escalas a 4K se mantenían mejor que mi antiguo stack de V2. Aún veía un leve parpadeo en diagonales finas, pero menos de esos fotogramas de “pintura al óleo” que se cuelan en las secuencias largas de V2.

Dos advertencias que anoté:

- La calidad del primer fotograma en V4 es buena, pero puede aparecer un micro-jitter temprano en escenas complejas. Generalmente se estabiliza para el segundo tres o cuatro.

- El color se mantiene mejor en V4, pero los cambios de gradación agresivos a mitad del clip pueden confundir al modelo. Obtuve resultados más limpios gradando después de exportar en lugar de hacerlo en el prompt.

En general, si tu entregable es una pieza corta, pulida con sonido integrado, los valores predeterminados de V4 te llevan ahí con menos desvíos.

En qué V2 sigue ganando

Duración del video (V4 = máx. 15 s, V2 = infinito)

Este es el obvio. V4 tiene un límite de 15 segundos por ahora. Para teasers en redes sociales, intros o bucles de producto, está bien. Para lienzos ambientales, explicaciones largas o paredes de galería, no lo está. El modo “déjalo correr” de V2 sigue teniendo más sentido para cualquier cosa de más de medio minuto. No tengo que planear los límites de escena de antemano. Puedo descubrir el momento en el medio y recortar hacia afuera.

Intenté simular la duración en V4 encadenando salidas. Funcionó técnicamente, pero podía sentir la costura. El flujo cambiaba en cada salto, como empalmar dos canciones en el mismo tono pero con bateristas diferentes.

Mayor soporte de hardware e integración hoy en día

V2 tiene una cola más larga en el mundo real. Más ejemplos, más nodos comunitarios, más publicaciones de personas resolviendo casos límite que tú también encontrarás. Si estás usando máquinas mixtas (a veces alterno entre un equipo de estudio y una laptop de viaje), la tolerancia a la variación de V2 ayuda. Cargué el flujo de trabajo V2 de un compañero de equipo la semana pasada y funcionó después de un parche. El flujo de trabajo equivalente de V4 se sentía más exigente con el entorno y las versiones.

Si tu stack depende de ComfyUI más herramientas aleatorias, V2 hace menos preguntas. Esa puede ser la diferencia entre entregar hoy o explorar una cadena de dependencias durante una tarde.

Guía de decisión: ¿V2 o V4?

Así es como lo enmarcaría después de una semana de ejecuciones alternadas y algunos entregables reales.

Elige V4 si:

- Tu salida dura menos de 15 segundos y necesita sentirse terminada desde el primer momento.

- El audio importa: sincronización con el ritmo, ritmo guiado por la voz o movimiento impulsado por la música.

- Valoras menos piezas en movimiento, aunque signifique menos espacio para experimentos de formato largo.

Elige V2 si:

- Necesitas secuencias de más de 15 segundos sin costuras obvias.

- Tu flujo de trabajo ya es intensivo en ComfyUI y intercambias presets con colaboradores.

- Estás dispuesto a asumir más pulido manual a cambio de duración abierta y mayor compatibilidad.

Lo que me sorprendió

- V4 redujo el desorden de mi proyecto. Menos archivos temporales, menos stems a medio hacer. Eso es un tipo diferente de velocidad: menos cambios de contexto.

- V2 seguía sintiéndose más como arcilla. Podía empujarlo y estirarlo sin que el modelo me empujara de vuelta hacia una mentalidad de “clip corto”.

Por qué esto importa

La mayoría de nosotros no necesitamos otra herramienta. Necesitamos menos pasos y resultados más estables. V4 apunta hacia lo terminado. V2 apunta hacia lo abierto. Ninguno es universalmente mejor. Se trata de la forma de tu día.

Si tienes plazos con formatos cortos, V4 es el camino más tranquilo. Si estás construyendo lienzos ambientales, visuales en vivo o cualquier cosa que respire más allá de los 15 segundos, V2 mantiene tus manos libres.

Esto funcionó para mí; tu experiencia puede variar. Probablemente mantendré ambos instalados. Uno para terminar con sonido, otro para cuando solo quiero que la cámara siga rodando. La pequeña pregunta con la que me quedo: ¿levantará V4 alguna vez el límite sin perder su compostura? Me gustaría que así fuera. Pero no tengo prisa.