Características de SkyReels V4 explicadas: generación de video y audio, inpainting y edición

Una guía en español claro sobre cada característica principal de SkyReels V4, desde la generación conjunta de audio y video hasta el inpainting y la edición, y lo que cada una significa para los creadores reales.

¿Alguna vez te has encontrado con el mismo problema que yo?

Soy Dora. En aquel momento, estaba creando un video explicativo corto, pero me topé con un problema común: la voz en off y las imágenes siempre se desincronizaban durante el proceso de edición. La situación no era grave, solo hacía que todo se sintiera un poco tosco. Con frecuencia veo a personas mencionar “audio sincronizado” y nuevos flujos de trabajo de edición, así que la semana pasada (finales de febrero a principios de marzo de 2026) probé cuidadosamente SkyReels V4.

El siguiente contenido no es una reseña, sino mi relato de primera mano sobre las características de SkyReels V4 que realmente cambiaron mi trabajo diario. Si tú también tienes estos problemas, ¡sigue leyendo!

Característica 1 — Generación conjunta de video + audio

Lo que “audio sincronizado” significa realmente en la práctica

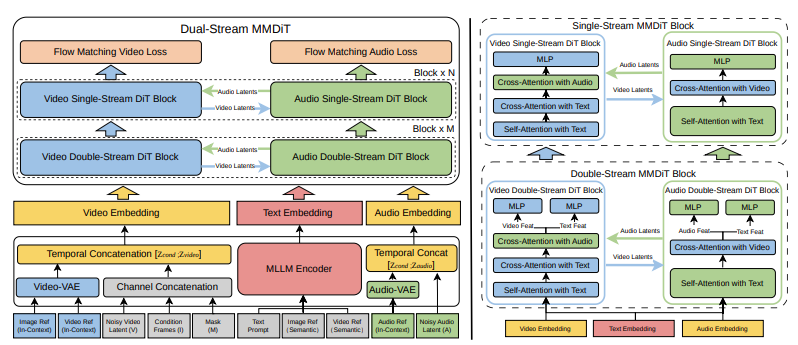

Pensé que esto sería una palabra de moda. No lo fue. SkyReels V4 adopta una arquitectura de Transformador de Difusión Multimodal de doble flujo (MMDiT), donde una rama sintetiza el video y la otra genera audio alineado temporalmente, mientras comparten un potente codificador de texto basado en Modelos de Lenguaje Grande Multimodales (MMLM). Cuando SkyReels genera video y audio juntos, el tiempo parece integrado de forma nativa, no pegado después. En un demo de 20 segundos, el movimiento de la mano en pantalla coincidió con los pequeños golpes percusivos sin que yo tuviera que ajustar los fotogramas clave. No fue una sincronización perfecta de labios (no esperes una película doblada), pero sí redujo las microediciones que normalmente hago para disimular los desfases.

El verdadero cambio: menos saltos entre líneas de tiempo. Normalmente alterno entre un DAW y un editor de video para ajustar milisegundos. Con la generación conjunta, solo hice una ronda de recortes. Esto no ahorró tiempo en la primera ejecución, aprender los prompts tomó un poco, pero para el tercer clip, noté que mi carga mental disminuyó. Menos preocupación por “¿está el audio ligeramente adelantado aquí?” y más atención al ritmo y los textos superpuestos.

Entrada de referencia de audio: cómo funciona

Proporcionar una referencia de audio fue como darle al modelo un metrónomo y un tablero de inspiración al mismo tiempo. Usé una pista lo-fi suave como guía y pedí imágenes de ciudad apagadas con travellings lentos. El resultado respetó el tempo, los cortes cayeron cerca de los tiempos fuertes y el ambiente reflejó la referencia sin copiarla. Lo bueno: mantuvo la curva de energía. Limitación: si la referencia tenía una sección media muy activa, las imágenes a veces sobre-cortaban ahí. Aprendí a elegir referencias más simples o a marcar el segmento que me importaba.

En términos prácticos, usaría referencias de audio cuando tengo una banda sonora definida desde el principio (pista de marca del cliente, sintonía de podcast) y quiero imágenes que dialoguen con ella. Si prefieres elegir la música al final, esta función importa menos.

Característica 2 — Soporte de entrada multimodal

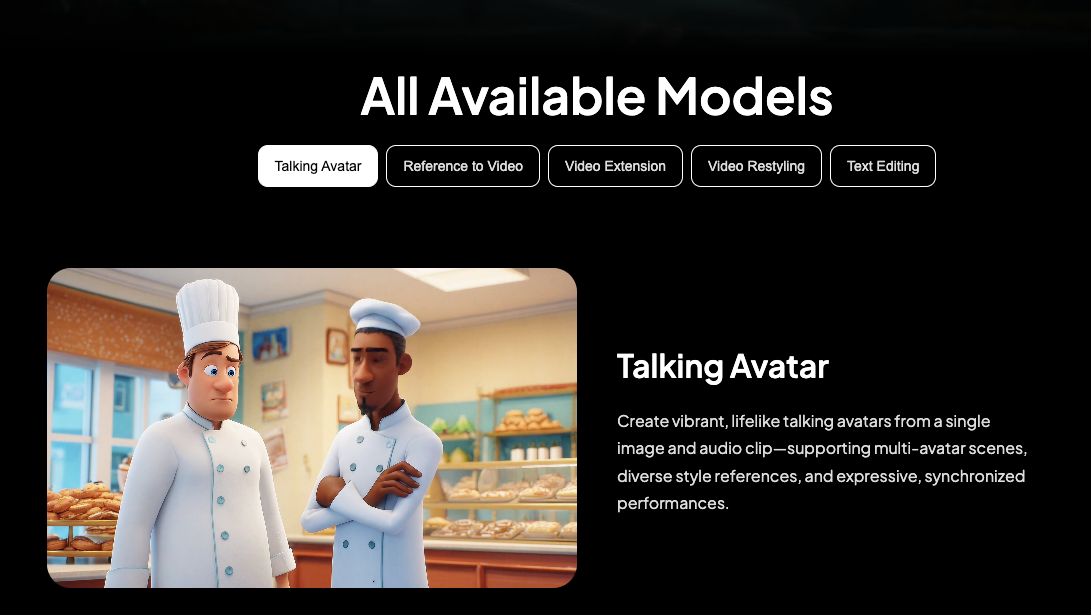

Texto a video

Los prompts de texto funcionaron como boceto rápido. Escribí: “toma cenital de escritorio, páginas de cuaderno pasando, luz cálida de mañana.” El primer resultado tenía un encuadre decente pero accesorios genéricos. Después de un par de ajustes, mencionando el grano del papel y una sensación de obturador lento, el movimiento mejoró y las luces se calmaron. No es un estilista de accesorios: es un definidor de ambiente. Lo trato como miniaturas: bueno para la dirección, no para los detalles.

Imagen a video

SkyReels V4 acepta instrucciones multimodales enriquecidas, incluyendo texto, imágenes, clips de video, máscaras y referencias de audio, lo que permite una guía visual detallada bajo condicionamientos complejos. Imagen a video fue donde SkyReels V4 me sorprendió. Introduje una foto fija de mi escritorio real. El modelo la extendió a unos segundos de movimiento de cámara creíble, con sombras que coincidían con el ángulo de mi lámpara. Noté una deformación menor alrededor de una taza de café en la primera toma. Volver a ejecutar con “mantener rigidez del objeto” ayudó. Si intentas animar fotos de productos o publicaciones en redes sociales sin reconstruir una escena 3D, esto da en el clavo.

Video a video (extensión y edición)

Video a video se sintió como un ahorro de tiempo para la continuidad. Extendí un clip de 7 segundos a 12 segundos manteniendo la misma curva de tono. Ediciones como estabilizar un paneo tembloroso o suavizar luces duras funcionaron bien con instrucciones cortas y claras. Cuando pedí demasiadas cosas a la vez —nuevo movimiento, diferente hora del día y cambio de gradación de color— el resultado titubeó. Mi nota personal: una intención por ejecución. Piensa “extender”, luego “graduar”, luego “limpiar”, en ese orden.

Característica 3 — Interfaz unificada de inpainting y edición

Lo que la concatenación de canales significa para los creadores (sin tecnicismos)

En el lado del video, SkyReels V4 adopta una formulación de concatenación de canales que unifica una amplia gama de tareas de estilo inpainting —como imagen a video, extensión de video y edición de video— bajo una sola interfaz, y se extiende de forma natural al inpainting y edición con referencia visual mediante prompts multimodales. Internamente, SkyReels trata las entradas de edición, máscaras, texto y señales de audio como una conversación compartida en lugar de pasos aislados. Para mí, eso significó que podía borrar un cable suelto, ajustar la pista de movimiento y mantener el mismo contexto de prompt sin recargar los recursos. Menos pérdida de contexto, menos ciclos de exportar e importar. Parece pequeño, pero ahorrarse dos o tres idas y vueltas por clip se acumula.

Inpainting con referencia visual explicado

Probé el inpainting en una fotografía de producto donde el borde de una etiqueta se veía torcido. Pinté una máscara rápida y dirigí el prompt a “usar la textura de la etiqueta existente como fuente.” El relleno respetó la iluminación y el grano mejor que la sensación de sello de clonar que a veces obtengo en otras herramientas. En texto más fino, ocasionalmente suavizaba microdetalles: ejecutar un segundo pase con “preservar bordes tipográficos” ayudó. No dependería de él para correcciones forenses, pero para limpiar fondos y pequeños ajustes de accesorios, se integró más rápido que mi flujo de trabajo manual.

Característica 4 — Calidad de salida cinematográfica

1080p / 32FPS / 15 segundos

Las especificaciones no cuentan toda la historia, pero importan. 1080p a 32FPS por hasta 15 segundos me dio suficiente espacio para explicaciones cortas y teasers. El movimiento se sentía fluido sin el brillo de “efecto telenovela”. Probé una densa escena urbana y vi un ligero desenfoque temporal en movimientos laterales rápidos: añadir “cámara más lenta” y un toque de desenfoque de movimiento lo mejoró. Si necesitas secuencias más largas, seguirás uniendo tomas.

Capacidad multitoma

Las multitomas fueron mi favorita silenciosa. Hice un storyboard con tres momentos —establecimiento, detalle, resolución— y los generé como hermanos con pistas de estilo compartidas. Los cortes coincidieron de forma más limpia que cuando genero escenas por separado. No es un editor completo: piensa en “un conjunto coherente de tomas”, no en una línea de tiempo. Para secuencias en redes sociales o bucles de páginas de destino, fue suficiente. Para documentales o anuncios con líneas habladas, aún pasaría a un NLE tradicional para un control más fino.

Característica 5 — Eficiencia a escala

La estrategia de dos etapas de baja resolución + fotogramas clave explicada simplemente

El motor parece esbozar primero y embellecer después. Elabora un plan de movimiento en baja resolución, luego afina los fotogramas clave e interpola. Lo noté cuando las vistas previas iniciales se veían toscas pero los resultados finales quedaban bien. En la práctica, me permitió tomar decisiones más pronto. Podía descartar una toma en menos de un minuto si el movimiento se sentía mal, en lugar de esperar un renderizado completo. En un lote matutino de seis variaciones, eso me ahorró unos 20 a 25 minutos.

¿Qué características siguen faltando?

Algunos vacíos fueron evidentes:

- Control de forma larga. El límite de 15 segundos te empuja a pensar de forma modular. Bien para redes sociales, complicado para narrativas.

- Ediciones de audio granulares post-generación. El audio conjunto es genial, pero aún quería envolventes de volumen por clip y ajustes a nivel de beat dentro de la herramienta.

- Rastreabilidad de versiones. Mantuve mis propias notas porque vincular las salidas a los cambios de prompt no es tan claro como podría ser.

- Restricciones duras sobre continuidad. Al extender un clip, me gustaría “bloquear” ciertos objetos o colores para que no puedan desviarse.

Por qué importa: las características de SkyReels V4 redujeron mi carga cognitiva en piezas de formato corto. Si ya manejas DAWs, gradación de color y herramientas de movimiento, esto consolida el caótico punto intermedio. Si necesitas un control de marca perfecto al píxel o contenido largo con guion, aún lo combinarás con un editor más potente.

Esto funcionó para mi ritmo, tu experiencia puede variar. Probablemente seguiré usándolo para explicaciones de 10 a 30 segundos y bucles de productos. La pequeña y constante ganancia para mí fue la atención: menos acrobacias en la línea de tiempo, un poco más de tiempo eligiendo lo que realmente importa en pantalla. Y eso es suficiente para mantenerme aquí, al menos por ahora.

Entonces me pregunto —

En tu flujo de trabajo de edición, ¿qué te cuesta más energía: sincronizar el audio y las imágenes, o pulir los pequeños desfases después?

Si has probado herramientas que prometen “audio sincronizado”, ¿realmente redujeron la fricción, o simplemente la trasladaron a otro lugar?

Sigo probando dónde encaja esto en mi conjunto de herramientas. ¿Cuál es el único cuello de botella que eliminarías primero en el tuyo?