MaxClaw Review: Probado en Flujos de Trabajo Reales (Veredicto Honesto)

Probamos MaxClaw en 5 flujos de trabajo reales. Esto es lo que realmente funcionó, lo que nos frustró y si vale la pena tu suscripción en 2026.

Hola, amiga. Soy Dora. Últimamente me seguía tropezando con la misma pequeña fricción: tareas simples de varios pasos que me robaban el foco. Cosas como “revisar tres enlaces, extraer un resumen coherente y enviarlo a un chat de Telegram” o “analizar un PDF de 40 páginas, identificar los riesgos y dejar una nota breve en mis documentos.” Ninguna de estas es difícil. Son simplemente el tipo de tareas que hacen que el día se sienta más pesado de lo necesario.

Así que probé MaxClaw durante dos semanas de trabajo. Quería ver si podía encargarse de esas tareas sin que yo tuviera que supervisarlo constantemente. No estoy aquí para clasificar funciones. Quería sentir si me aligeraba el día. Esa es la vara de medir.

Cómo Probamos MaxClaw (Nuestra Configuración y Casos de Uso)

Usé MaxClaw en macOS (M3 Air), Chrome e iOS. Mi punto de referencia: normalmente ejecuto pequeños flujos tipo agente en Notion + Zapier + un wrapper de la API de Claude cuando es necesario. Me manejo bien configurando webhooks, pero no me gusta mantenerlos.

Mis casos de uso eran ordinarios:

- Captura de investigación: leer 3–6 fuentes, extraer el núcleo “aburrido pero verdadero” y reenviar a un canal de Telegram que mantengo para notas semanales.

- Pegamento de agenda: alinear dos calendarios, proponer horarios y enviar un mensaje de confirmación una vez que algo encaja.

- Lectura de documentos: escanear PDFs largos, extraer decisiones, riesgos y tareas pendientes, y luego redactar un informe breve.

Medí tres cosas:

- Tiempo de configuración: minutos desde el registro hasta la primera ejecución útil.

- Carga de supervisión: número de correcciones o reescrituras por tarea.

- Deriva o memoria: si recordaba las preferencias después de unos días sin indicaciones.

Ejecuté cada flujo de trabajo 5–7 veces para ver si la repetición reducía la fricción. Eso me importa más que una “primera demo” reluciente.

Incorporación y Primeras Impresiones

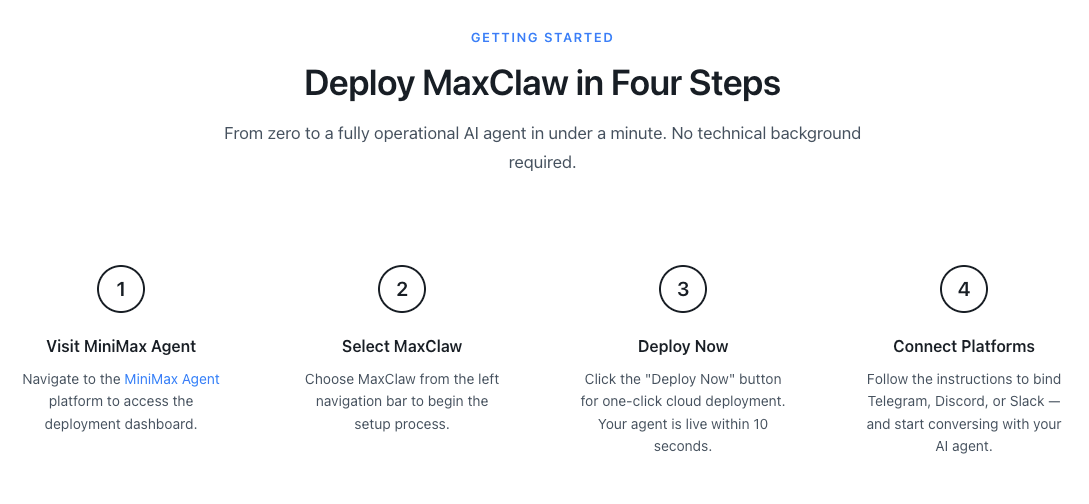

Tiempo desde el registro hasta la primera tarea funcional

El registro fue sencillo. Correo electrónico, verificación, elegir un plan. No lo cronometré con un cronómetro, pero tuve mi primera tarea funcionando en unos 18 minutos. El paso más lento no fue MaxClaw, fui yo decidiendo qué automatizar primero. Empecé con un pequeño flujo de investigación→resumen→notificación en Telegram.

Lo que me sorprendió: las plantillas predeterminadas no eran llamativas. Sin confeti parpadeante, sin el ambiente de “multiplica tu productividad por 10…”. Aprecié la moderación.

Experiencia de integración de plataformas

Telegram requirió un poco de trabajo. Creé un bot a través de BotFather, obtuve el token y lo pegué en MaxClaw. Tuve que configurar el ID del chat manualmente. No es difícil, pero asume que ya lo has hecho antes. Si no es así, los documentos de la API de Telegram Bot son más claros que la mayoría de los tooltips de productos.

La integración del calendario fue más fluida. Autenticó Google rápidamente y mostró los bloques ocupados/disponibles correctamente en el primer intento. No aparecieron calendarios duplicados (pequeño alivio).

Para los documentos, subí una presentación de estrategia de 28 páginas (PDF) y un informe de investigación de 43 páginas (PDF). El análisis fue lo suficientemente rápido como para que no me distrajera con el correo mientras esperaba. Hice una ejecución usando un enlace público: se obtuvo bien, pero me quedé con las cargas directas para evitar problemas de permisos.

Pruebas de Flujo de Trabajo Reales

Prueba 1: Investigación + resumir + enviar por Telegram

Le di 4 fuentes: una publicación de blog, un comunicado de prensa, una nota técnica y un hilo de foro. Mi instrucción: “dame un resumen tranquilo en 6–8 puntos, con fuentes, y luego envíalo a mi canal de Telegram.”

Ejecución 1: Resumió bien, pero escribió en un tono ligeramente exaltado. Ajusté la instrucción de estilo a “simple, no promocional.” Las ejecuciones 2–6 mantuvieron el tono más calmado. Pequeña victoria: empezó a adjuntar títulos de fuentes en lugar de URLs sin procesar en la ejecución 3 (después de corregirlo una vez). Los enlaces no se rompieron en Telegram, lo que a veces sucede cuando las herramientas les dan demasiado formato.

¿Tiempo ahorrado? La primera ejecución no ahorró tiempo: me tomó ~10 minutos corregir el tono y el formato de las fuentes. Para la ejecución 4, había bajado a ~2 minutos de revisión. No es dramático, pero el esfuerzo mental disminuyó. No tuve que mantener la estructura en mi cabeza.

Prueba 2: Tarea de programación en varios pasos

Le pedí que propusiera tres franjas de 45 minutos entre dos calendarios la semana siguiente, priorizando las mañanas, y luego que redactara una nota breve de confirmación una vez que alguien respondiera con su elección. Gestionó las zonas horarias correctamente (yo estoy en UTC+1, la otra persona en ET). No intentó ser demasiado listo: nada de tonterías como “¿qué tal a las 6am?”.

El mensaje de confirmación fue neutral y claro. Me gustó que no diera por sentado “reunión aceptada” antes de que yo presionara enviar. Tuve que aprobar la franja final. Francamente, lo prefiero así. Si un agente bloquea una franja que no tenía intención de confirmar, soy yo quien luego se disculpa.

Prueba 3: Análisis de documentos y generación de informes

Esta fue mi prueba real. Le pedí que leyera un informe de 43 páginas y me diera:

- decisiones clave en lenguaje sencillo,

- tres riesgos con probabilidad e impacto (bajo/medio/alto),

- un resumen de una página que pudiera pegar en mis notas.

La ejecución 1 fue decente pero larga. Me dio dos páginas. Pedí un máximo de 350 palabras y lo cumplió en las ejecuciones posteriores. La evaluación de riesgos fue tranquila, no alarmista. Cuando el PDF tenía tablas, las resumía en lugar de intentar reconstruirlas: buena elección.

Verifiqué dos afirmaciones que me parecían dudosas. En realidad estaban bien: el informe las tenía enterradas en un apéndice. Dicho esto, no le pasaría esto a un cliente sin revisarlo yo primero. Es una herramienta de apoyo al pensamiento, no un redactor final.

Memoria a Largo Plazo — ¿Funciona de Verdad?

Respuesta corta: más o menos, y con eso basta.

Le di a MaxClaw algunas preferencias establecidas el primer día:

- tono: simple, no promocional

- resúmenes de Telegram: 6–8 puntos, fuentes con títulos

- programación: evitar reservas provisionales; preferir mañanas en mi horario

Una semana después, ejecuté las mismas tareas sin volver a indicar esas reglas. Recordó el tono y la longitud del resumen. Olvidó los títulos de las fuentes una vez, pero se recuperó en la siguiente ejecución. La regla sobre reservas provisionales se mantuvo constante. Cuando cambié “preferir mañanas” por “cualquier momento de 9 a 5”, respetó ese cambio de inmediato.

Desglose de Costos

Qué cubre la suscripción

Los precios cambian, así que consulta la página del producto para ver los últimos. El análisis de MaxClaw de WaveSpeed explica que desde hacer clic en “Crear MaxClaw” hasta tener una puerta de enlace de agente en funcionamiento se tarda menos de 20 segundos, con integraciones opcionales que siguen pasos guiados y requieren una configuración mínima. Durante mi período de prueba, la suscripción cubría:

- acceso al agente con integraciones incorporadas (Telegram, calendarios, documentos),

- un grupo de ejecuciones de tareas mensuales y procesamiento de documentos,

- y uso de modelos alojados para que no tuviera que gestionar claves de API.

Para mí, el valor no estaba en tener “ilimitado” de nada. Estaba en no tener que mantener código de conexión. No supervisé webhooks ni me pregunté si algún secreto había expirado. Eso solo ya vale algo si tu tiempo está fragmentado.

Comparado con ejecutar OpenClaw con la API de Claude

No encontré documentación estable y oficial para “OpenClaw.” Si estás pensando en “agente DIY + Claude,” aquí está mi cálculo habitual usando la API de Claude:

- El precio del modelo (p. ej., Claude 3.5 Sonnet) ha rondado pocos dólares por millón de tokens de entrada y más por los de salida. Al momento de escribir esto, Anthropic publica tarifas por millón: consulta su página para conocer los números exactos.

- Una ejecución típica de investigación→resumen me cuesta céntimos, no dólares. Las más pesadas (PDFs largos con múltiples pasadas) se acumulan, pero raramente superan unos pocos dólares al día.

- Costos ocultos: tu tiempo configurando reintentos, alcances de autenticación, manejo de errores, calendarios y los extremos del bot de Telegram. Si disfrutas eso (a veces yo sí), genial. Si no, una suscripción que simplemente funciona puede ser más económica en la práctica.

En Qué Destaca MaxClaw

- Pasa de la idea al flujo funcional rápidamente. No tuve que luchar con una interfaz de creación ni pasar una tarde con “un ajuste más.”

- Gestiona los momentos de transición con elegancia. Redacta un mensaje, espera la aprobación y luego continúa. Esa pequeña pausa me salvó de la sobreautomatización.

- La digestión de documentos es confiable. No alucina tablas ni fuerza estructura donde no existe. Los resúmenes se sentían fundamentados.

- La memoria para pequeñas preferencias es suficientemente buena. El estilo y las reglas pequeñas se mantuvieron durante una semana sin que yo las repitiera.

- Las integraciones de Telegram y calendario fueron estables. Sin publicaciones duplicadas, sin tropiezos con zonas horarias. He aprendido a esperarlos: aquí no los vi.

Dónde Todavía Se Queda Corto

- El tono de la primera ejecución puede desviarse hacia lo positivo. Si quieres algo seco y neutral, dilo explícitamente.

- La memoria es superficial por diseño. Es excelente para el estilo y la configuración recurrente, no para el contexto de proyectos complejos. Aún mantengo los prompts clave en una nota.

- Superficie de depuración limitada. Cuando algo falla (como un título de fuente que falta), los registros son escuetos. Pude corregirlo, pero quería un “por qué” más claro.

- La atribución de fuentes necesita indicaciones. Ocasionalmente infería autores a partir de nombres de sitios. Fácil de corregir, pero vale la pena vigilarlo si compartes resúmenes ampliamente.

Veredicto Final — ¿Quién Debería Usar MaxClaw?

Si tus días están llenos de pequeñas tareas repetibles, resúmenes, notificaciones, programación ligera, y preferirías no tener que mantener bots y scripts, MaxClaw vale la pena probarlo. No te va a deslumbrar, y ese es el punto. Hizo el trabajo sin pedir atención.

A quién le gustará:

- creadores independientes que mantienen un feed tranquilo de notas de investigación en Telegram o Slack,

- operadores y PMs que quieren un pegamento de agenda predecible sin construir un minisistema,

- investigadores que necesitan resúmenes compactos de documentos largos, con suficiente control para mantener el tono estable.

Esta reseña de MaxClaw se reduce a una sensación simple: después del primer día, pasé menos tiempo pensando en el “cómo” y más tiempo leyendo los resultados. Y ese pequeño alivio, menos pestañas, menos microdecisiones, fue la verdadera victoria. Todavía tengo curiosidad por saber cómo se comportará con proyectos más complejos y entre múltiples herramientas. Lo seguiré observando, en silencio.