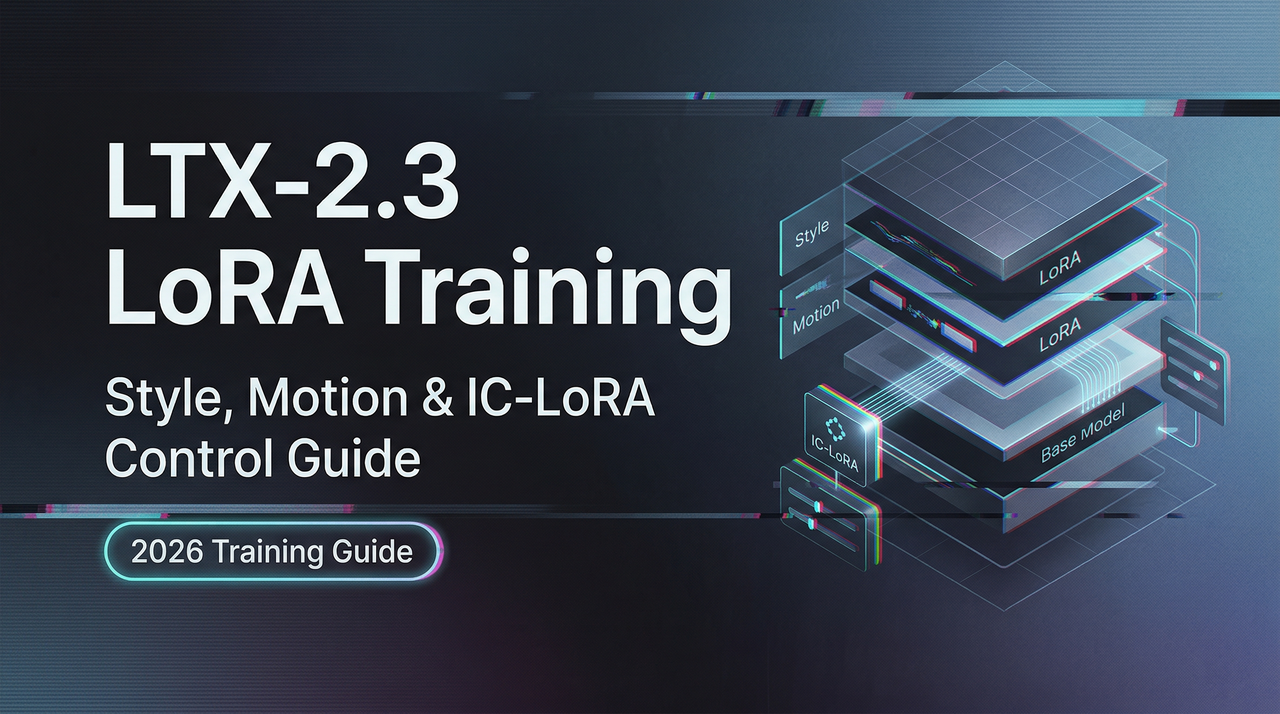

Guía de Entrenamiento LoRA para LTX-2.3: Control de Estilo, Movimiento e IC-LoRA (2026)

Entrena LoRAs personalizados en LTX-2.3 usando el ltx-trainer oficial. Cubre LoRAs de estilo, control estructural IC-LoRA, configuraciones de rango, preparación de datasets y fallos comunes de entrenamiento.

Hola, amigo. Soy Dora.

No tenía planeado pasar una semana entrenando LoRAs. Solo necesitaba que una demo de producto siguiera un patrón de movimiento específico, y los prompts de texto no eran suficientes. Esa pequeña fricción me llevó por el camino del entrenamiento de LTX-2.3, y lo que encontré me sorprendió — no porque sea revolucionario, sino porque resulta silenciosamente práctico una vez que sabes qué configuraciones realmente importan.

Esto no es una referencia exhaustiva. Es lo que aprendí probando flujos de trabajo de control de estilo, movimiento e IC-LoRA en marzo de 2026.

Qué incluye el entrenador oficial de LTX-2.3

El repositorio de GitHub de LTX-2 está organizado como un monorepo con tres paquetes: ltx-core para la implementación del modelo, ltx-pipelines para los flujos de generación, y ltx-trainer para el ajuste fino de LoRA e IC-LoRA. Los ajustes de ancho y alto deben ser divisibles por 32, y el conteo de fotogramas debe seguir la regla 8n+1 — es decir, 1, 9, 17, 25 fotogramas, y así sucesivamente.

Ignoré esto en mi primera sesión de entrenamiento. El entrenador dio error, rellené los fotogramas manualmente, y funcionó. Es una restricción pequeña, pero vale la pena conocerla desde el principio.

Tres tipos de LoRA y cuándo usar cada uno

LoRAs de estilo (apariencia, textura, color)

Las LoRAs de estilo enseñan a LTX-2.3 estéticas visuales — gradación de color, tratamiento de texturas, ambiente de iluminación. Entrené una con fotografía de producto con fondos blancos consistentes y sombras suaves. Para LoRAs de personajes o estilos, 20-50 imágenes suelen ser suficientes para obtener buenos resultados, aunque para sujetos muy específicos he llegado a usar 80-120 imágenes.

Los conjuntos de datos solo con imágenes funcionan bien aquí. Para mis primeras LoRAs, usé fotogramas fijos en lugar de clips de video — es más sencillo de curar, y el modelo aprende la identidad sin necesidad de procesar movimiento.

LoRAs de movimiento / efecto (movimiento, transformación)

Las LoRAs de movimiento se centran en cómo se mueven las cosas en lugar de cómo se ven. Panorámicas de cámara, rotación de objetos, secuencias de transformación. Estas necesitan clips de video cortos y coherentes, no imágenes fijas. Probé una LoRA de movimiento tipo dolly-in con clips de 15 segundos con encuadre consistente, y el modelo captó el patrón de movimiento en distintos sujetos.

Entrenar movimiento se sintió menos estable que el estilo. Más reintentos, resultados más variables.

IC-LoRAs (control estructural: profundidad, pose, borde Canny)

Las IC-LoRA son diferentes. En lugar de enseñar al modelo una nueva estética o movimiento, condicionan la generación a señales de referencia — mapas de profundidad, esqueletos de pose, detecciones de bordes. IC-LoRA permite condicionar la generación de video en fotogramas de video de referencia durante la inferencia, lo que permite un control video-a-video de alta precisión sobre el modelo base de texto a video.

Usé IC-LoRA de profundidad para fijar el movimiento de la cámara mientras cambiaba el contenido visual por completo. La guía oficial de IC-LoRA explica bien los tres modos de control: Canny para la preservación de bordes, Depth para la geometría espacial y de cámara, Pose para la transferencia de movimiento humano.

Reglas de preparación del conjunto de datos

Restricción de conteo de fotogramas (regla 8n+1)

El conteo de fotogramas debe ser divisible por 8 + 1. Esto no es una guía flexible — si tus clips tienen 10 o 15 fotogramas, el entrenador dará error o los rellenará internamente. Procesé mi conjunto de datos por lotes a 17 fotogramas (2 × 8 + 1) antes de subirlos, y el entrenamiento fue sin problemas.

Divisibilidad de resolución (regla de 32 píxeles)

El ancho y el alto deben ser divisibles por 32. Lo aprendí después de redimensionar un lote a 1024×576 y ver cómo el entrenador lo rellenaba silenciosamente a 1024×608. Mejor redimensionar correctamente desde el principio.

Conjuntos de datos de video vs imágenes: cuándo usar cada uno

Los conjuntos de datos solo con imágenes son válidos para el entrenamiento de LoRA en LTX-2.3. Esto es mucho más sencillo que forzar el aprendizaje de movimiento demasiado pronto, especialmente para LoRAs de identidad o estilo. Empecé cada proyecto con imágenes fijas, validé el aspecto visual, y luego añadí clips de video cortos si el movimiento era importante.

Para trabajos con mucho movimiento, los clips cortos y coherentes siguen siendo mejores que los segmentos largos con múltiples escenas.

Configuración base de entrenamiento

Rango 32 como valor predeterminado correcto y cuándo subir

Para LTX-2.3, el rango 32 es el valor predeterminado correcto. Generalmente ofrece suficiente capacidad sin hacer que la LoRA sea demasiado rígida demasiado pronto. Probé el rango 64 en una LoRA de estilo complejo y vi una mejora mínima — la capacidad adicional no ayudó porque mi conjunto de datos no era lo suficientemente grande ni diverso para aprovecharlo.

Punto de partida para la tasa de aprendizaje y cuándo cambiarla

Para el entrenamiento de LoRA en LTX-2.3, 1e-4 es el lugar correcto para comenzar. Este es uno de esos casos donde la respuesta aburrida es la respuesta correcta. No toqué la tasa de aprendizaje en mis primeras cuatro LoRAs, y todas convergieron correctamente.

Conteo de pasos: cómo saber cuándo parar antes

Muchos usuarios pierden tiempo saltando directamente a conteos de pasos altos sin verificar si el checkpoint 250, 500 o 750 ya tiene buen aspecto. Yo muestro en el checkpoint 500, y si la LoRA ya se ve bien, paro ahí. Si una LoRA ya se ve sólida en el checkpoint 750 o 1000, seguir mucho más puede hacerla más frágil.

El sobreajuste se manifiesta cuando el modelo memoriza los datos de entrenamiento en lugar de generalizar. Las muestras de validación empiezan a verse idénticas a los fotogramas de entrenamiento.

IC-LoRA: control de profundidad, pose y borde

En qué se diferencia IC-LoRA de una LoRA de estilo estándar

IC-LoRA separa el movimiento del estilo visual. Diriges el aspecto con texto y LoRAs de estilo, y diriges el movimiento con guías estructuradas. El modelo de control union IC-LoRA de LTX-2.3 admite múltiples señales de control — profundidad, pose, borde — en un único adaptador.

Ejecuté IC-LoRA de profundidad en una secuencia de turntable de producto. El recorrido de la cámara se mantuvo bloqueado al mapa de profundidad de referencia, pero el contenido visual cambió por completo según mi prompt.

Integración del flujo de trabajo IC-LoRA en ComfyUI

El flujo de trabajo RunComfy LTX 2.3 IC-LoRA gestiona automáticamente la extracción de profundidad, pose y borde. Carga un clip de referencia, elige un modo de control, escribe un prompt enfocado en el estilo, y el modelo gestiona el movimiento por separado.

Un detalle que al principio se me pasó: mantén los prompts centrados en la apariencia porque IC-LoRA gestiona el movimiento y la estructura. Intentar describir el movimiento de la cámara en el prompt mientras IC-LoRA lo está controlando crea conflictos.

Fallos comunes de entrenamiento y soluciones

Sangrado de la LoRA en todo (solución DOP)

DOP (Dropout of Prompts) es la primera opción avanzada a la que vale la pena recurrir cuando una LoRA empieza a afectar todo. Entrené una LoRA de estilo de producto que funcionaba bien en elementos similares pero empezó a afectar sujetos no relacionados. Añadir dropout de descripción ayudó a que la LoRA generalizara.

Sobreajuste con conteos de pasos altos

No trates más pasos como una mejora universal de calidad. Llevé una LoRA de movimiento a 2.000 pasos y la vi empezar a reproducir fotogramas de entrenamiento exactos en lugar de aprender el patrón subyacente. Volví al checkpoint 750.

Conflicto entre Caption Dropout y Cache Text Embeddings

Si se está usando caption dropout, Cache Text Embeddings debe mantenerse DESACTIVADO. Esta es una de las pocas configuraciones pequeñas que pueden empeorar silenciosamente el comportamiento del entrenamiento si se usa incorrectamente. Los activé ambos una vez y obtuve resultados inconsistentes — el modelo no podía decidir si depender de los embeddings en caché o manejar las descripciones faltantes.

Verificar tu LoRA antes del despliegue

Realizo tres pruebas de validación antes de dar una LoRA por terminada: el mismo prompt con y sin la LoRA para confirmar que está añadiendo lo que espero, prompts variados para comprobar la generalización, y casos extremos que no estaban en el conjunto de entrenamiento. Si la LoRA solo funciona con prompts que se parecen mucho a las descripciones de entrenamiento, está sobreajustada.

Preguntas frecuentes

¿Puedo entrenar LoRAs en A100 o GPUs más pequeñas?

El entrenamiento de LTX-2.3 apunta oficialmente a GPUs Nvidia H100 con 80 GB+ de VRAM, aunque configuraciones con menos VRAM pueden funcionar con gradient checkpointing y resoluciones reducidas. No he probado el entrenamiento en A100 personalmente, pero la documentación oficial del entrenador señala esto como la base de hardware recomendada.

¿Cuánto tarda en entrenarse una LoRA de estilo en una H100?

Aproximadamente 3-5 horas por LoRA en una sola 4090 para conjuntos de datos de tamaño medio, incluyendo validación y pequeños reinicios, según informes de campo. La H100 debería ser más rápida, aunque no tengo cifras directas.

¿Las LoRAs de LTX-2 funcionan en LTX-2.3 sin reentrenar?

No. LTX-2.3 incluye un VAE completamente rediseñado entrenado con datos de mayor calidad, y la arquitectura del conector de texto cambió. Las LoRAs antiguas de LTX-2 no se transfieren limpiamente — lo probé y obtuve artefactos visuales.

¿Se puede combinar IC-LoRA con LoRAs de estilo?

Sí. Puedes apilar hasta tres adaptadores LoRA simultáneamente, combinando estéticas personalizadas con control estructural. Ejecuté una LoRA de estilo antes del cargador de IC-LoRA y mantuve su peso moderado para que IC-LoRA pudiera mantener la geometría y el ritmo.

¿Está disponible el entrenamiento de LoRA en plataformas en la nube?

Sí. RunComfy AI Toolkit y fal.ai ofrecen entrenamiento basado en navegador sin necesidad de gestionar infraestructura de GPU. Sube tu conjunto de datos, configura los parámetros, descarga la LoRA cuando esté lista.

Entrenar LoRAs para LTX-2.3 no es magia. Es preparación del conjunto de datos, configuraciones base, y saber cuándo parar antes. La regla de fotogramas 8n+1 y la restricción de divisibilidad de 32 píxeles parecen arbitrarias al principio, pero son simplemente los requisitos geométricos del modelo. Trabaja con ellos, no alrededor de ellos.

Lo que me sorprendió no fue la complejidad — fue cuánto tiempo ahorré manteniéndome en rango 32 y tasa de aprendizaje 1e-4 en lugar de ajustar cada parámetro desde el primer intento.

Publicaciones anteriores: