Configuración de LTX-2.3 en ComfyUI: Pipeline de Dos Etapas, Soluciones de VRAM y Encoder Gemma

Configura LTX-2.3 en ComfyUI: ubicación de checkpoints, configuración del encoder Gemma 3 12B, el pipeline de generación en dos etapas y estrategias para VRAM limitada en GPUs de consumo.

Hola a todos. Soy Dora. Saben que no planeaba cambiar. Mi configuración de LTX-2 en ComfyUI funcionaba bien, y no soy de las que cambian “solo porque es nuevo.” Pero la semana pasada (marzo de 2026), seguía viendo pequeñas notas sobre LTX-2.3: mejor coherencia, nuevo codificador de texto (Gemma 3 12B), y una ruta de dos etapas que prometía imágenes más nítidas sin destrozar la VRAM.

Aproveché una mañana tranquila y migré mi flujo de trabajo. Esto es lo que realmente cambió para mí, dónde me encontré con problemas, y las partes que hicieron el trabajo más llevadero. Si estás buscando los pasos de instalación: están aquí, pero lo útil son los compromisos que noté mientras construía un flujo de trabajo de LTX-2.3 en ComfyUI día a día.

Qué tiene de diferente LTX-2.3 en ComfyUI (vs configuración de LTX-2)

LTX-2.3 ComfyUI se siente más como un empuje hacia la fiabilidad que un salto. El modelo espera Gemma 3 12B como codificador de texto, y la ruta recomendada es una pipeline de dos etapas: generar a la mitad de resolución para la coherencia base, luego escalar los latentes con un upsampler específico de LTX. En la práctica, esto cambió dos cosas para mí:

- Los prompts se mantenían mejor con pocos pasos. Noté menos detalles “borrosos” cuando me quedaba dentro de 25–35 pasos en la Etapa 1.

- La VRAM tuvo menos picos de los que temía, siempre que respetara los límites de etapa y no intentara forzar la resolución completa de una sola vez.

También observé que los nodos antiguos de LTX-2 funcionaban en su mayoría, pero LTX-2.3 prefiere sus propios nodos de muestreador/upsampler latente. No bastaba con cambiar solo el checkpoint. Ahí fue donde me tropecé por primera vez.

Archivos necesarios y estructura de carpetas

Esta es la configuración en la que terminé después de varios intentos fallidos. No es complicada: es el mínimo que hizo que desaparecieran los recuadros de error rojos.

Opciones de checkpoint (dev / fp8 / distilled + distilled LoRA)

- dev: Bueno para experimentar. Algo más pesado, pero lo encontré más tolerante cuando los prompts se desviaban.

- fp8: Más ligero en VRAM. Con mi tarjeta de 12GB, fp8 me permitió mantener el tamaño de lote en 1 sin OOM durante la decodificación. Ligera pérdida de calidad, nada dramático para activos de redes sociales o marketing.

- distilled + distilled LoRA: Las salidas más limpias para tomas tipo producto en mis pruebas, pero hay que recordar cargar el LoRA y establecer un peso (0,6–0,8 me funcionó). Sin el LoRA activo, los resultados se parecían más a dev.

Todos los checkpoints estaban en ComfyUI/models/checkpoints. Guardé los LoRAs en ComfyUI/models/loras y los nombré con el mismo nombre base que el checkpoint para poder encontrar el par rápidamente.

Codificador de texto Gemma 3 12B: descarga y ubicación

LTX-2.3 espera el codificador de texto Gemma 3 12B. Dependiendo de tu pila de nodos, usarás un peso PyTorch o un archivo GGUF (para nodos respaldados por llama.cpp). Probé ambos.

- Ruta PyTorch: colocado en ComfyUI/models/clip (algunos nodos lo detectan automáticamente aquí). Si tu nodo pide una carpeta diferente, sigue su documentación, no lo fuerces.

- Ruta GGUF: colocado en ComfyUI/models/llm (o una carpeta text_encoders específica del nodo). Q4_K_M fue el punto óptimo para mí: Q3 ahorraba más memoria pero perdía algo de matiz en prompts largos.

Si tienes dudas, abre la ayuda ”?” del nodo o el README. El nombre de la carpeta importa.

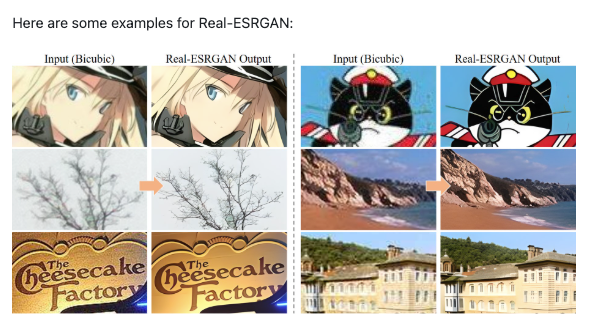

Modelos de upscaling: cuándo incluirlos

No necesitas un upscaler de imágenes externo si usas el upsampler latente de LTX. Dicho esto, mantuve un 4x ESRGAN y un upscaler latente SDXL x2 en ComfyUI/models/upscale_models para imágenes que no son de LTX. Para LTX-2.3, el LTXVLatentUpsampler integrado funcionó mejor que ESRGAN para bordes y formas similares a texto.

La pipeline de dos etapas explicada

Seguía intentando saltarme la Etapa 1. Fue un error. La ruta de dos etapas resultó ser más fácil de entender y más amable con la VRAM.

Etapa 1, coherencia base a media resolución

Genero a la mitad del tamaño objetivo (por ejemplo, 640×384 para un final de 1280×768). Esta etapa establece la composición y los detalles del sujeto. 25–35 pasos, CFG moderado (4–6), tamaño de lote 1. Si algo está mal (manos, disposición, dominante de color), es más barato corregirlo aquí.

Lo que noté: menos “derivas” cuando simplifiqué los prompts y usé uno o dos anclajes de estilo como máximo. LTX-2.3 parece recompensar el lenguaje enfocado.

Etapa 2, upscaling latente para nitidez (LTXVLatentUpsampler)

Luego paso los latentes de la Etapa 1 al LTXVLatentUpsampler. Esto afila los bordes y restaura los detalles finos sin rehacer la composición. Normalmente ejecuto 15–20 pasos para el upsampling. No es un borrador mágico: si la base está mal, el upsampler solo hace que el error se vea más nítido.

Dev + Distilled LoRA vs Full Distilled: cuál usar

- Dev + Distilled LoRA: Mi opción predeterminada cuando estoy explorando un estilo. Algo más flexible. Configuro la intensidad del LoRA alrededor de 0,7 y ajusto si las texturas parecen sobreajustadas.

- Full Distilled: Cuando necesito salidas rápidas y consistentes para un lote. Es más exigente con los prompts pero ahorra energía mental: menos sorpresas de una ejecución a otra.

Si te sientes atascado, prueba dev para la Etapa 1 (más flexible) y distilled para la Etapa 2 (más preciso). Esa combinación me rescató un conjunto de retratos de ambiente sombrío.

Configuración del codificador Gemma 3 12B: gestión de VRAM

Gemma 3 12B es la razón principal por la que esperaba problemas. No fue tan malo, solo necesita algunas restricciones.

Descarga del codificador a CPU/RAM cuando la VRAM es limitada

Con una tarjeta de 12GB, descargué el codificador Gemma a la CPU para el paso de texto. Añadió unos segundos por ejecución pero evitó el OOM durante la Etapa 1. Si tu nodo admite carga en dispositivos mixtos, configura las capas de atención en GPU y el resto en CPU. La sensación: no más rápido, pero más tranquilo; sin bloqueos inesperados en medio de una idea.

Flag —novram y otras correcciones de inicio

Si lanzas ComfyUI con flags de comando, —novram ayudó a suavizar los picos de memoria durante los cambios de modelo. También:

- Deshabilité “mantener cargado” en modelos grandes entre ejecuciones de prueba.

- Configuré torch.set_grad_enabled(False) en un pequeño init personalizado (si tu configuración lo permite) para evitar gradientes innecesarios.

- Usé redes de seguridad más pequeñas: checkpoints de 16 bits o fp8 cuando sabía que iba a apilar LoRAs.

Estrategias para VRAM baja en GPUs de consumo (12GB / 16GB / 24GB)

Lo que funcionó en las tres máquinas que probé (RTX 3060 12GB, 4070 12GB y 4090 24GB):

Modelos cuantizados GGUF: compensaciones entre Q3 y Q4

- Q3: Menor memoria, más rápido de cargar, pero perdí matiz en los prompts y vi más repetición en los descriptores.

- Q4: Algo más pesado, coherencia notablemente mejor. Mi elección para tarjetas de 12–16GB. Para 24GB, omito la cuantización o uso Q5 si está disponible.

Descarga del VAE para reducir picos de memoria

La decodificación es donde más OOM tuve. Descargar el VAE a la CPU o usar un VAE más ligero redujo los picos al final de la Etapa 2. Con 12GB, también configuré la decodificación final en imagen única (sin procesamiento por lotes) aunque los nodos anteriores procesaran por lotes: menos drama.

Otras pequeñas victorias:

- Mantén la resolución modesta en la Etapa 1: escala después.

- Evita apilar múltiples trucos de guía. Un CFG, un LoRA a la vez.

Errores comunes en la primera ejecución y soluciones

Me encontré con los habituales recuadros rojos. Estas fueron las soluciones que funcionaron.

Errores de nodos faltantes después de cargar

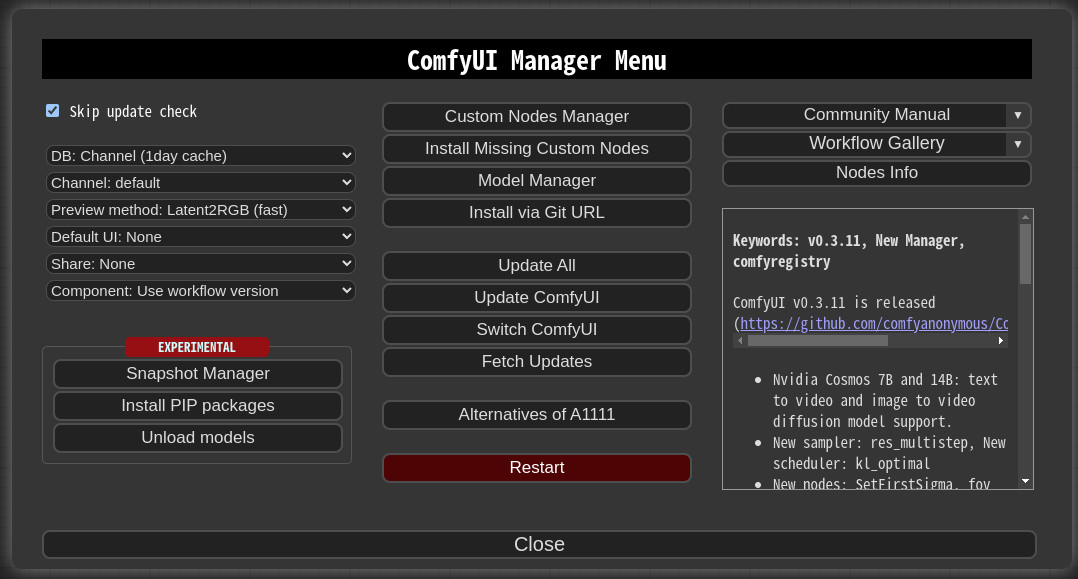

Si ComfyUI no puede encontrar los nodos de LTX-2.3, actualiza tu repositorio de nodos personalizados y reinicia. Algunos nodos LTX también requieren un núcleo de ComfyUI más reciente. Soluccioné un error persistente eliminando la carpeta de caché del nodo y dejando que se reconstruyera al lanzar.

OOM durante la decodificación

Dos ajustes ayudaron de inmediato: cambiar el checkpoint a fp8 o descargar el VAE a la CPU. También reduce el lote de la última etapa a 1. Si sigues teniendo bloqueos, reduce a la mitad la resolución objetivo y deja que un upscaler de imágenes externo termine el trabajo.

Bloqueo del codificador Gemma

Esto generalmente significaba discrepancia de carpeta o un archivo cuantizado que el nodo no aceptaba. Volví a descargar Gemma 3 12B desde la fuente indicada en el README del nodo, verifiqué el checksum y lo coloqué donde el nodo lo espera (clip vs llm). Q4 funcionó: Q3 a veces fallaba al cargar en mi 4070 hasta que actualicé a la última compilación respaldada por llama.cpp.

Preguntas frecuentes

¿Los nodos de LTX-2.3 para ComfyUI necesitan instalarse por separado?

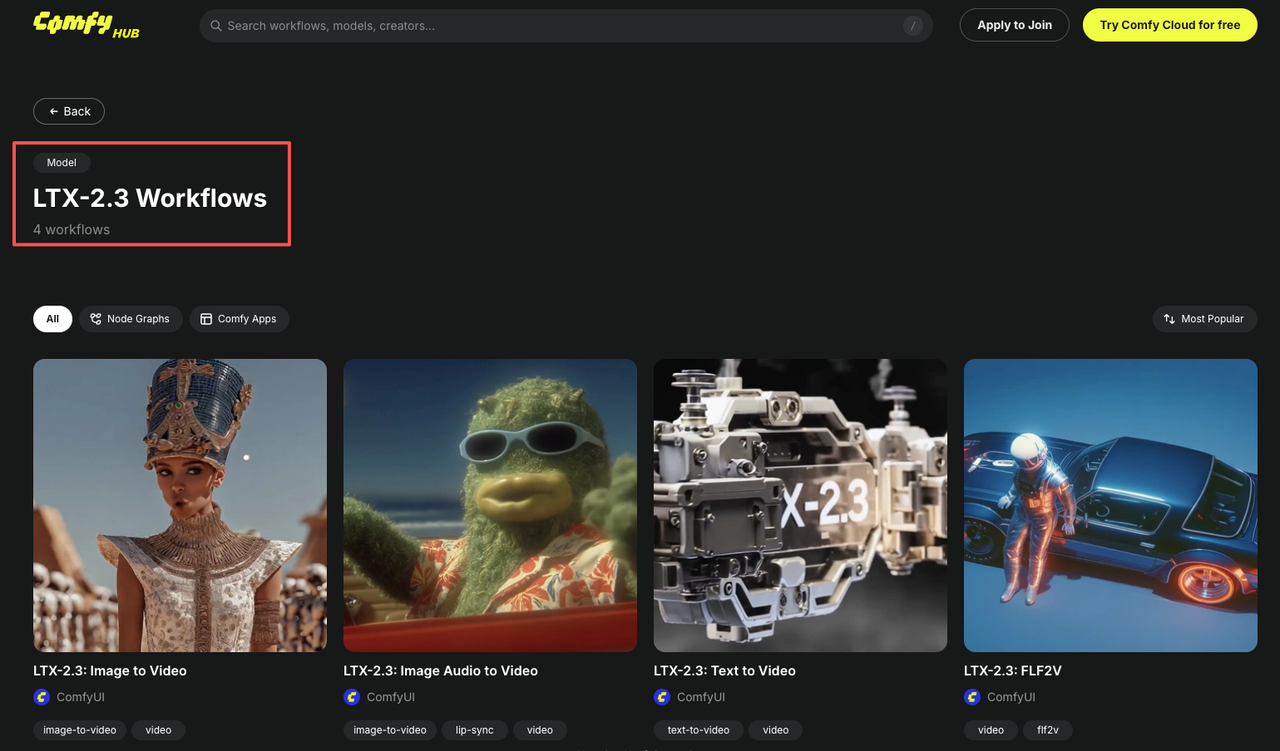

Generalmente sí. Actualizar solo el modelo no es suficiente. Descarga el último repositorio de nodos LTX y reinicia ComfyUI para que registre los nuevos muestreadores y el upsampler latente.

¿Puedo usar flujos de trabajo existentes de LTX-2 con checkpoints de LTX-2.3?

Parcialmente. Pude reutilizar el diseño, pero tuve que cambiar el muestreador de LTX-2.3 y el LTXVLatentUpsampler, y apuntar los prompts a Gemma 3 12B. Después de eso, la mayoría de los controles funcionaron como esperaba.

¿Cuál es la VRAM mínima para ejecutar LTX-2.3 en ComfyUI?

Obtuve ejecuciones de imagen única funcionales con 12GB usando fp8 o GGUF Q4 para el codificador, Etapa 1 a media resolución y VAE descargado. Funciona mejor con 16GB. Con 24GB, puedes quedarte en PyTorch y moverte más rápido.

¿La pipeline de dos etapas es más rápida o más lenta que la de una sola etapa?

El tiempo total puede ser similar, pero se siente más ligero. Paso menos tiempo rehaciendo errores a resolución completa. La Etapa 1 establece la idea; la Etapa 2 la limpia. Con una tarjeta de 12GB, también es la diferencia entre crear y bloquearse.

No terminé “emocionada” con LTX-2.3 ComfyUI. Más bien aliviada. Las imágenes se veían como pedí más rápido, y el flujo de trabajo dejó de pelear con la VRAM. Me quedo con la ruta de dos etapas. Es tranquila, y funciona.

Artículos anteriores: