¿Es HappyHorse-1.0 de código abierto? Lo que podemos verificar

HappyHorse-1.0 afirma ser de código abierto, pero los enlaces de GitHub y HuggingFace no están disponibles actualmente. Esto es lo que está verificado y lo que hay que seguir de cerca.

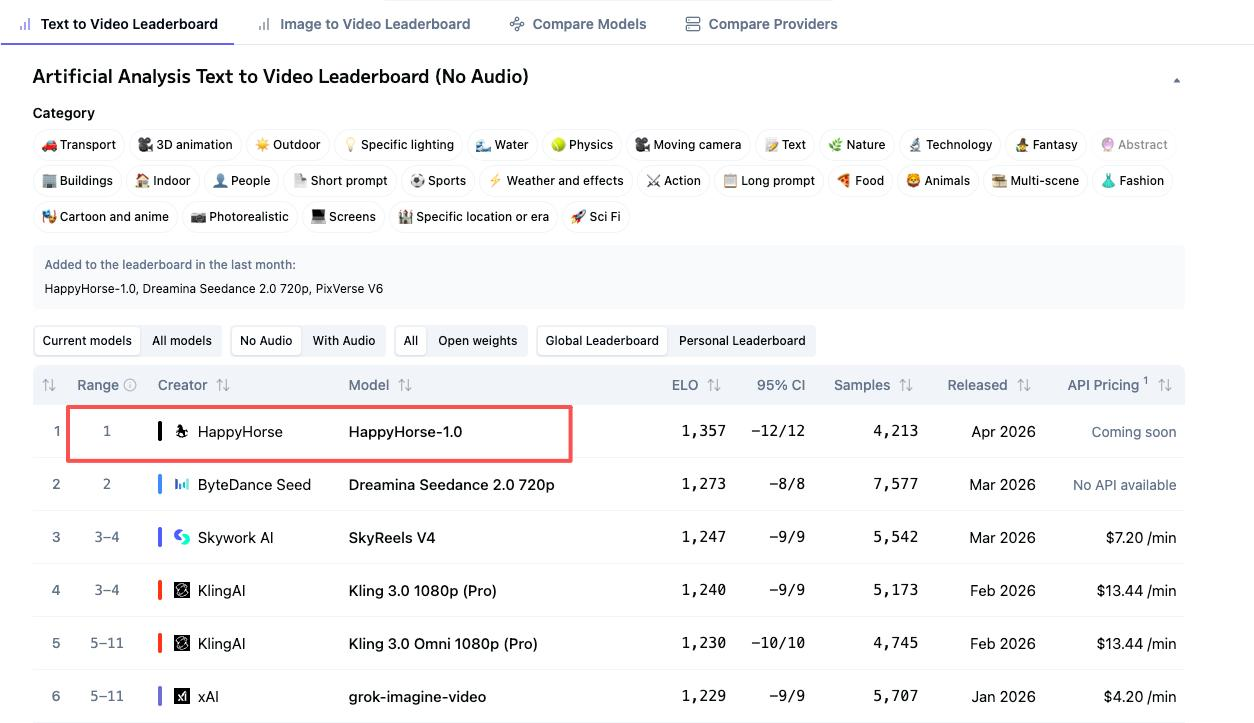

Estaba a mitad de la configuración de un pipeline local de WAN 2.2 el martes pasado cuando un nombre que no reconocía escaló hasta lo más alto del Artificial Analysis Video Arena. HappyHorse-1.0. Elo 1333. Por delante de Seedance 2.0, por delante de Kling 3.0, por delante de todo lo que había estado probando durante el último mes.

Mi primer pensamiento no fue “vaya.” Fue “¿dónde está el repositorio?”

Alguien en un canal de Discord que sigo me etiquetó — “Dora, ¿has visto este?” — y enlazó el sitio oficial. Hice clic. Vi la frase “completamente de código abierto” en negrita. Vi “GitHub — próximamente.” Y esa pequeña brecha entre la afirmación y el enlace es el tipo de cosa que me queda grabada. He pasado suficiente tiempo persiguiendo botones de descarga que no existen como para conocer la diferencia entre un modelo que puedes usar y un modelo del que puedes leer.

Así que pasé las siguientes horas haciendo lo que suelo hacer: tirando de hilos, revisando HuggingFace, escaneando X en busca de alguien que realmente hubiera conseguido los pesos en una máquina local.

Esto es lo que puedo confirmar — y lo que no — al 8 de abril de 2026.

Lo que HappyHorse-1.0 afirma sobre el código abierto

El lenguaje en happyhorses.io es categórico. El sitio describe el modelo como “completamente abierto” y afirma que el modelo base, el modelo destilado, el modelo de súper resolución y el código de inferencia han sido publicados. La arquitectura declarada es un Transformer de atención propia unificado de 40 capas y 15B de parámetros — sin atención cruzada — capaz de generar vídeo y audio de manera conjunta a partir de texto. Supuestamente admite siete idiomas para sincronización de labios y utiliza destilación DMD-2 para reducir el proceso de eliminación de ruido a ocho pasos.

Son afirmaciones sólidas. Pero aquí está la cuestión: las afirmaciones y la disponibilidad son dos preguntas distintas. Y la brecha entre ellas es exactamente donde los desarrolladores se queman.

También vale la pena señalar que nadie ha confirmado públicamente quién construyó HappyHorse-1.0. El propio Artificial Analysis lo describió como un modelo “seudónimo” al añadirlo a su arena. La especulación de la comunidad en X ha ido desde considerarlo una variante de WAN hasta un competidor de Seedance, pero nada verificado. Un sitio afiliado menciona infraestructura de ByteDance, aunque tampoco pude confirmar eso de forma independiente.

Lo que es realmente verificable ahora mismo

Aquí es donde la historia se vuelve escasa.

GitHub: El sitio happyhorses.io tiene un enlace a GitHub. Dice “próximamente.” A fecha de hoy, no existe ningún repositorio público — ni código, ni README, ni archivo de licencia. Busqué en GitHub cualquier organización o fork relacionado. Nada.

HuggingFace: Misma situación. El enlace al “Model Hub” en el sitio también indica “próximamente.” No existe ninguna ficha de modelo en HuggingFace, no hay archivos de pesos listados, ni hilos de discusión de la comunidad.

Demo: Hay una demo en vivo disponible a través del sitio web. Genera clips de vídeo a partir de prompts de texto. Los resultados que vi parecían genuinamente impresionantes — movimiento limpio, coherencia decente. Pero una demo te dice que el modelo funciona. No te dice si puedes ejecutarlo tú mismo, ajustarlo o construir sobre él.

Conclusión: a fecha de este artículo, no se puede descargar HappyHorse-1.0. No puedes inspeccionar sus pesos, leer su licencia ni ejecutarlo localmente. La etiqueta de “completamente de código abierto” existe actualmente solo como una intención declarada.

Por qué esta brecha importa para los desarrolladores

Si eres un desarrollador evaluando si integrar un modelo abierto en un pipeline de producción, la etiqueta importa menos que el artefacto. Y hay tres términos que se confunden constantemente en este espacio:

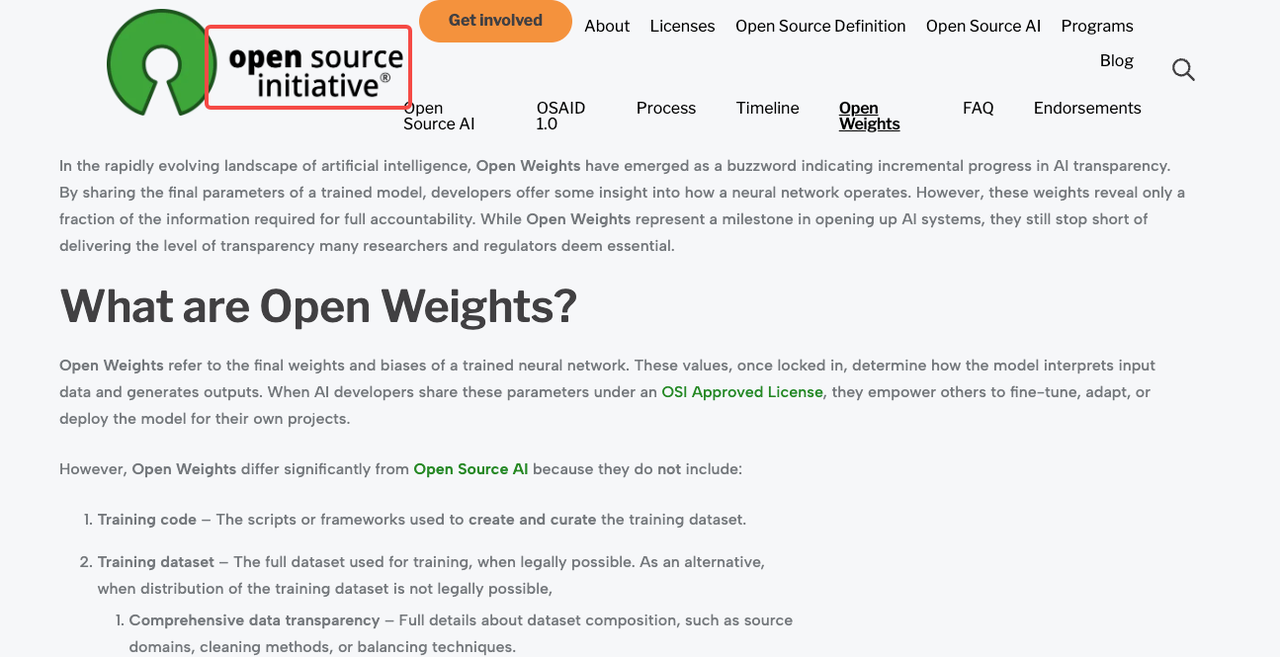

Código abierto significa el paquete completo — pesos, código de entrenamiento, detalles de arquitectura y una licencia que permite la modificación y redistribución. La Open Source Initiative ha sido vocal sobre esta distinción: publicar solo los pesos no califica.

Pesos abiertos significa que los parámetros entrenados son descargables y utilizables, pero los datos de entrenamiento, el código y la metodología pueden mantenerse privados. Puedes ejecutar inferencia y ajustar el modelo, pero no puedes reproducirlo o auditarlo completamente.

Acceso abierto significa que puedes usar el modelo a través de una API o demo, pero nada es descargable. Eres un inquilino, no un propietario.

Ahora mismo, HappyHorse-1.0 cae en la tercera categoría. Quizás eso cambie mañana. Pero construir un flujo de trabajo en torno a un modelo no publicado es un riesgo, especialmente si tu cronograma depende del despliegue local o del ajuste fino personalizado.

Cómo seguir el estado de la publicación

Si estás siguiendo este espacio — y creo que vale la pena seguirlo — aquí es donde mirar:

GitHub: Mantén un ojo en busca de una nueva página de organización. Cuando (o si) el código se publique, ahí será donde aterrice. Actualmente no existe ningún repositorio, pero el sitio sugiere que hay uno planificado.

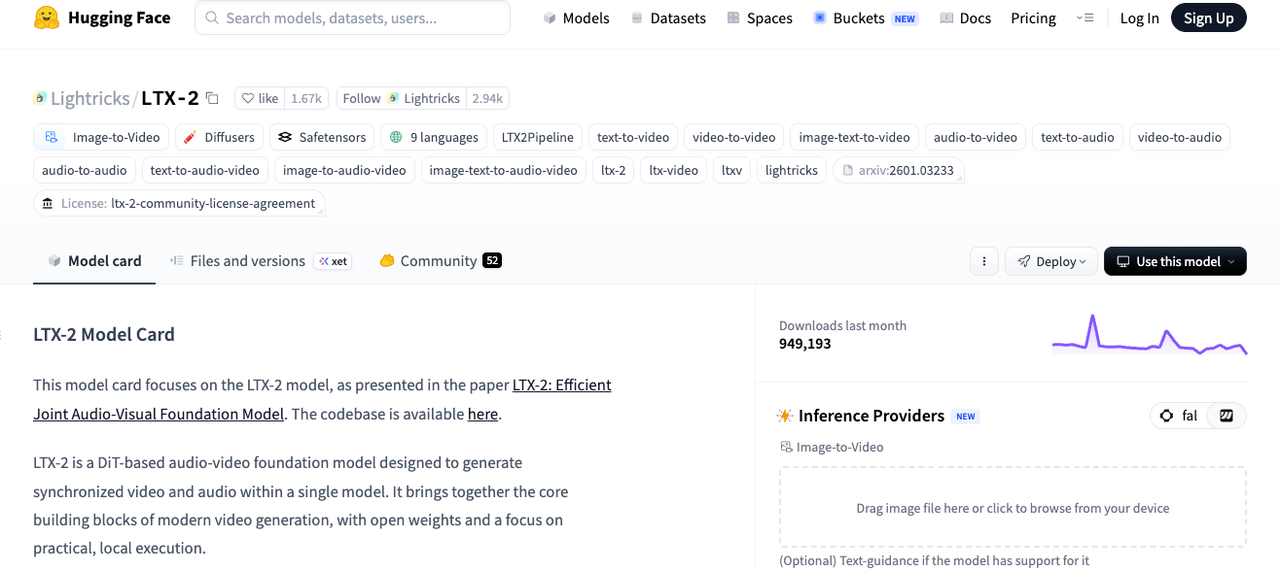

HuggingFace y hubs de modelos: La ficha del modelo será la señal más clara. Una vez que los pesos se publiquen allí con un archivo de licencia, podrás empezar a evaluar en serio. La documentación de fichas de modelos de HuggingFace describe cómo es una publicación adecuada.

Señales de la comunidad: La discusión en X ha sido activa. Investigadores y creadores de vídeo con IA ya están comparando los resultados de HappyHorse con otras entradas de la arena. Los canales de Reddit y Discord sobre generación de vídeo con IA tienden a sacar a la superficie forks o cargas no oficiales rápidamente cuando aparecen.

Artificial Analysis: Su tabla de clasificación de vídeo es probablemente el lugar más objetivo para seguir el rendimiento a lo largo del tiempo. Las puntuaciones Elo cambian a medida que llegan más votos, por lo que la clasificación de hoy puede no mantenerse.

Historial de código abierto en vídeo con IA: un marco de referencia

Me resulta útil comparar con modelos que sí han cumplido sus promesas de pesos abiertos. Te da una referencia de cómo se ve lo “real”.

LTX-2 de Lightricks es una referencia sólida. Anunciaron código abierto y luego lo cumplieron: pesos completos en HuggingFace, un repositorio de GitHub con código de inferencia, integración con ComfyUI, un framework de entrenamiento y una licencia clara. Puedes descargarlo, ejecutarlo localmente, ajustarlo con LoRAs y construir flujos de trabajo de producción sobre él. Así es como se ve una publicación de pesos abiertos creíble en la práctica.

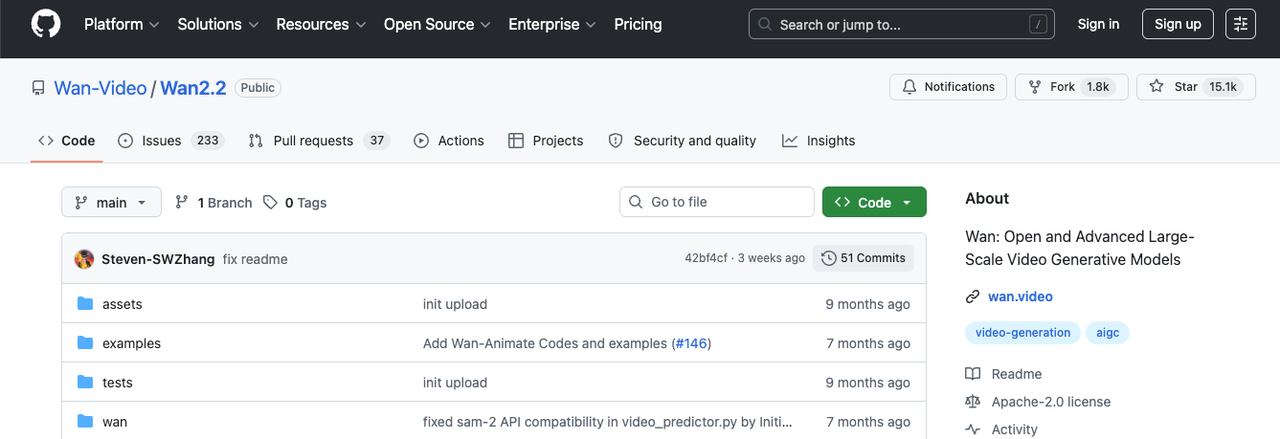

WAN 2.2 es otro ejemplo. El equipo de Alibaba publicó múltiples variantes del modelo en HuggingFace — texto a vídeo, imagen a vídeo, una versión ligera de 5B — junto con código completo de inferencia en GitHub, integración con Diffusers y licencia Apache 2.0. Las contribuciones de la comunidad siguieron rápidamente: wrappers para ComfyUI, versiones cuantizadas, experimentos de destilación.

Qué buscar en cualquier publicación para confirmar que es realmente utilizable:

- Pesos disponibles para descargar (no detrás de una lista de espera o una página de “próximamente”)

- Un archivo de licencia — Apache 2.0 es la señal verde más clara para uso comercial, pero incluso una licencia personalizada es mejor que nada

- Código de inferencia que funcione sin dependencias propietarias

- Una ficha de modelo con detalles de arquitectura, limitaciones y uso previsto

HappyHorse-1.0 no tiene ninguno de estos hoy. Eso no es un juicio sobre la calidad del modelo — los resultados de la arena sugieren que es genuinamente potente. Es un juicio sobre su accesibilidad actual.

Preguntas frecuentes

¿Puedo descargar los pesos de HappyHorse-1.0 ahora mismo?

No. A fecha del 8 de abril de 2026, no hay pesos disponibles públicamente. Tanto el enlace de GitHub como el de Model Hub en el sitio oficial muestran “próximamente.” No he podido encontrar cargas de terceros ni forks de la comunidad.

¿Está HappyHorse-1.0 en HuggingFace?

Todavía no. No hay ficha de modelo, ni archivos de pesos, ni página organizacional en HuggingFace asociada a HappyHorse. Esto podría cambiar en cualquier momento, por lo que vale la pena comprobarlo periódicamente.

¿Qué licencia usará HappyHorse-1.0?

Desconocido. El sitio afiliado menciona “derechos de uso comercial” en el contexto de su plataforma alojada, pero no se ha publicado ninguna licencia de modelo independiente. Hasta que un archivo de licencia se publique con los pesos, no hay forma de evaluar los términos para el despliegue autohospedado o comercial.

¿Es seguro construir flujos de trabajo comerciales en torno a HappyHorse-1.0 ahora mismo?

Esperaría. Sin pesos descargables, una licencia publicada ni siquiera una identidad de desarrollador confirmada, hay demasiada incertidumbre para uso en producción. Si necesitas un modelo abierto para generación de vídeo comercial hoy, LTX-2 y WAN 2.2 están disponibles con licencias claras.

¿Cómo se compara HappyHorse-1.0 con LTX-2 o WAN 2.2 en términos de apertura?

En calidad de resultados, HappyHorse es competitivo — posiblemente por delante en algunas métricas de la arena. En apertura, no está en la misma categoría ahora mismo. LTX-2 y WAN 2.2 tienen pesos publicados, repositorios públicos, código de inferencia y licencias definidas. HappyHorse tiene una demo y una promesa. Esa brecha puede cerrarse, pero todavía no lo ha hecho.

Probablemente revisaré esto cuando (o si) el repositorio de GitHub entre en funcionamiento. El modelo en sí parece interesante — el rendimiento en la arena es difícil de ignorar. Pero llevo suficiente tiempo en esto como para saber que las demos impresionantes y los pesos descargables son dos cosas muy diferentes.

Por ahora, estoy observando. Todavía no construyendo sobre él.

Prueba HappyHorse-1.0 en WaveSpeedAI

HappyHorse-1.0 ya está disponible en WaveSpeedAI:

Artículos anteriores: