HappyHorse-1.0 vs Seedance 2.0: ¿Cuál gana ahora mismo?

HappyHorse-1.0 supera a Seedance 2.0 en T2V e I2V sin audio, pero queda por detrás en audio y no tiene una API estable. Esto es lo que significa para los desarrolladores.

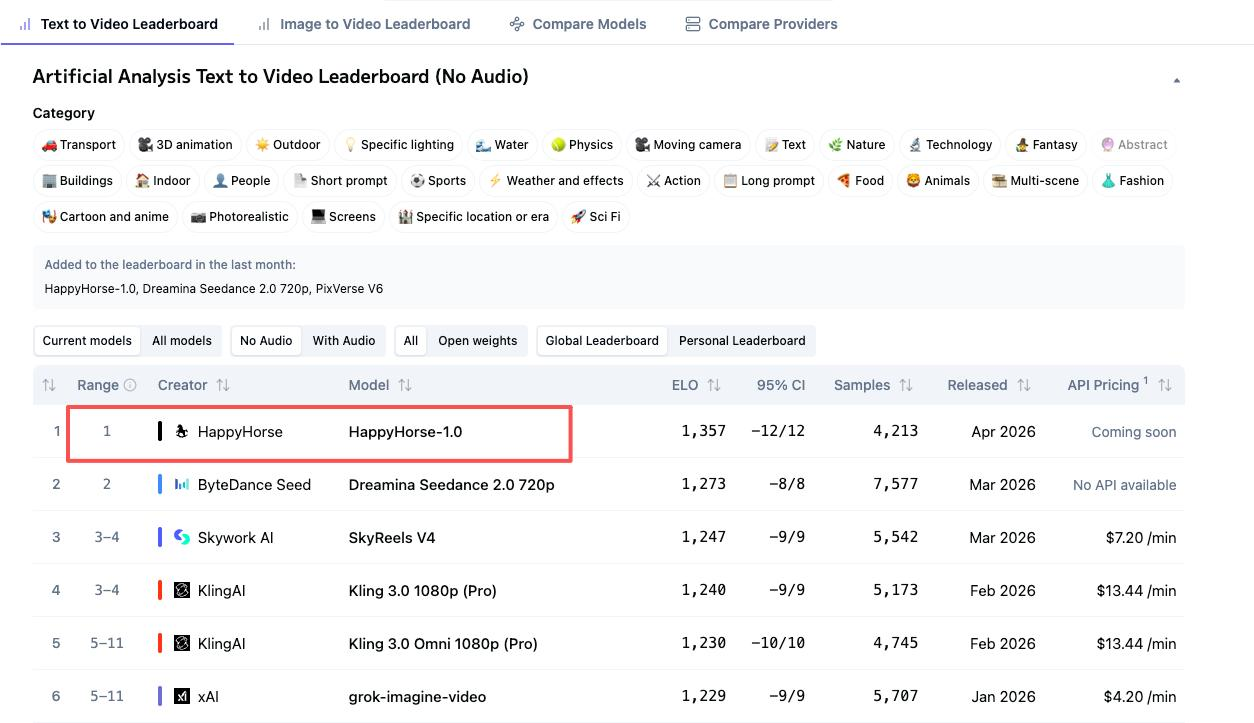

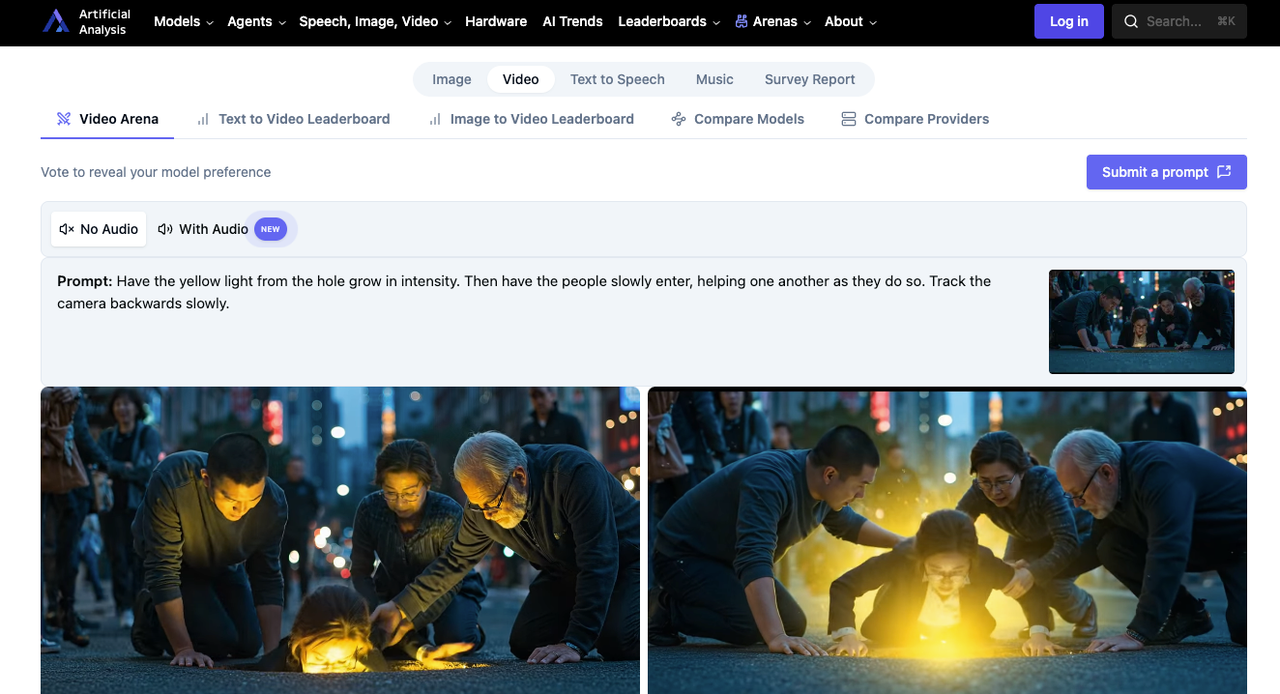

Pasé mucho tiempo actualizando el clasificador del Artificial Analysis Video Arena. ¡Hola, soy Dora! Un modelo del que nunca había oído hablar — HappyHorse-1.0 — había aparecido silenciosamente durante el fin de semana y desplazó a Seedance 2.0 del primer puesto en dos de los cuatro rankings principales. Nadie parecía saber quién lo había construido. El propio Artificial Analysis lo calificó como una entrada “seudónima”. Y mi cronología estaba mitad emocionada, mitad confundida.

Así que revisé los números, rastreé las vías de acceso e intenté responder la única pregunta que realmente importa para cualquiera que esté construyendo con estos modelos ahora mismo: ¿con cuál puedes trabajar hoy?

La respuesta no es tan limpia como parece el clasificador.

Los Cuatro Números del Clasificador que Importan

HappyHorse y Seedance 2.0 ocupan los primeros puestos en cuatro rankings separados de Artificial Analysis. Pero sus posiciones cambian dependiendo de si el audio es parte de la evaluación. Esa distinción importa más de lo que la mayoría de las comparaciones reconocen.

T2V Sin Audio: HappyHorse #1 (Elo 1333) vs Seedance 2.0 #2 (Elo 1273)

Esta es la mejor actuación de HappyHorse. Una brecha Elo de 60 puntos en una arena de votación ciega es significativa — se traduce aproximadamente en que los usuarios prefieren la salida de HappyHorse alrededor del 59% de las veces en enfrentamientos directos. Los votos aquí capturan la calidad del movimiento visual, la adherencia al prompt y la coherencia de la escena sin que ningún audio influya en la percepción.

T2V Con Audio: Seedance 2.0 #1 (Elo 1219) vs HappyHorse #2 (Elo 1205)

Una vez que el audio entra en juego, Seedance toma la delantera por 14 puntos. El Dual-Branch Diffusion Transformer de ByteDance genera video y audio simultáneamente en un solo pase — una rama para fotogramas de video, otra para formas de onda de audio, conectadas mediante atención cruzada. Esa elección arquitectónica da sus frutos cuando los efectos de sonido sincronizados y el diálogo se convierten en parte del juicio.

I2V Sin Audio: HappyHorse #1 (Elo 1392) vs Seedance 2.0 #2 (Elo 1355)

El Elo más alto de HappyHorse en las cuatro categorías. Una ventaja de 37 puntos en imagen a video sin audio sugiere que el modelo es particularmente fuerte para seguir la composición de la imagen de referencia — manteniendo la identidad del sujeto, el encuadre y el estilo visual consistentes mientras genera movimiento. Para los equipos que trabajan en animación de productos o trabajo de concepto a movimiento, este es el número que importa.

I2V Con Audio: Seedance 2.0 #1 (Elo 1162) vs HappyHorse #2 (Elo 1161) — Casi Empatados

Un punto. Eso está dentro de cualquier margen de error razonable. Ningún modelo tiene una ventaja real aquí. Trata esta categoría como un empate hasta que se acumulen significativamente más votos.

Lo que Elo Realmente Mide — y Sus Límites para Decisiones de Producción

Estas puntuaciones Elo provienen de votos ciegos de usuarios en comparaciones lado a lado, usando un modelo Bradley-Terry adaptado de los rankings de ajedrez. Los usuarios ven dos videos generados anónimamente a partir del mismo prompt y eligen el que prefieren. Es lo más cercano a una “prueba de sensación” a escala que tenemos.

Pero Elo no mide la fiabilidad de la API, la velocidad de generación, el costo por clip, la estabilidad del acceso, o si realmente puedes llamar al modelo de forma programática. Un ranking en el clasificador es una señal de calidad, no una decisión de implementación.

Tabla de Comparación Principal

| Dimensión | HappyHorse-1.0 | Seedance 2.0 |

|---|---|---|

| T2V Elo (sin audio) | 1333 (#1) | 1273 (#2) |

| T2V Elo (con audio) | 1205 (#2) | 1219 (#1) |

| I2V Elo (sin audio) | 1392 (#1) | 1355 (#2) |

| I2V Elo (con audio) | 1161 (#2) | 1162 (#1) |

| Generación de audio | Presente, por detrás de Seedance | Más fuerte — sincronización nativa de doble rama |

| Proveedor conocido | No — seudónimo | Sí — ByteDance |

| Arquitectura (declarada) | Transformer de 40 capas de flujo único | Dual-Branch Diffusion Transformer |

| Pesos abiertos | ”Próximamente” según se anuncia | No |

| API estable | Sin API pública disponible | Acceso de consumidor vía Dreamina; API oficial pausada |

| Acceso hoy | Solo sitios de demo | Dreamina, CapCut Pro, apps chinas |

Donde HappyHorse Toma la Delantera

Calidad del movimiento visual sin audio: lo que capturan los votos ciegos

Las brechas Elo en los rankings sin audio — 60 puntos en T2V, 37 en I2V — no son triviales. Los usuarios en comparaciones ciegas eligen consistentemente HappyHorse por lo que la gente describe como un movimiento de cámara más natural, un movimiento corporal más suave y una atmósfera de escena más fuerte. Si tu caso de uso son bucles de producto silenciosos, clips sociales editados con música separada, o imágenes de relleno que se puntúan en postproducción, esto es relevante.

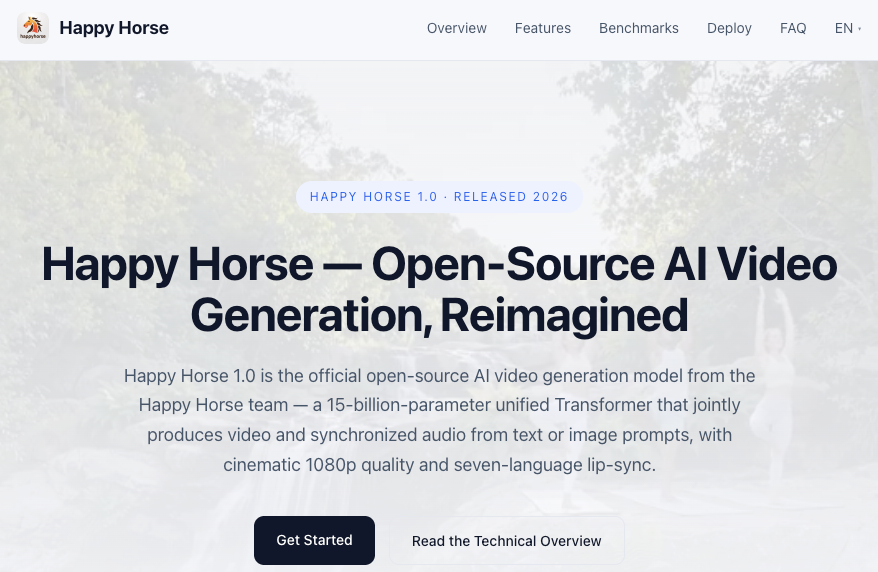

Arquitectura Transformer de flujo único (declarada) vs pipelines de múltiples flujos

Los materiales de marketing de HappyHorse describen un Transformer de auto-atención de 40 capas unificado que procesa tokens de texto, video y audio en una sola secuencia — sin atención cruzada entre ramas separadas. Si es preciso, esto es arquitectónicamente distinto del enfoque de doble rama de Seedance. Las primeras y últimas 4 capas usan supuestamente proyecciones específicas de modalidad mientras que las 32 capas intermedias comparten parámetros en todas las modalidades. Todavía no puedo verificar estas afirmaciones de forma independiente. El GitHub y el hub de modelos están listados como “próximamente”.

Afirmaciones de audio multilingüe

HappyHorse afirma soporte nativo para siete idiomas — inglés, mandarín, cantonés, japonés, coreano, alemán y francés — con sincronización labial de baja tasa de error de palabras. Seedance 2.0 soporta 8+ idiomas para sincronización labial a nivel de fonema. En papel, son competitivos. En la práctica, no he podido someter a prueba de estrés suficiente la salida multilingüe de HappyHorse para confirmar la paridad.

Donde Seedance 2.0 Mantiene la Ventaja

Generación de audio: aún lidera en ambos clasificadores con audio

Seedance ocupa el #1 en T2V e I2V con audio. Su arquitectura de doble rama — una rama generando fotogramas de video, la otra generando formas de onda de audio, conectadas mediante atención cruzada para sincronización a nivel de milisegundos — fue diseñada específicamente para esto. Cuando tu salida necesita diálogo, sonido ambiental o foley preciso al fotograma, la decisión arquitectónica de Seedance de tratar el audio como un ciudadano de primera clase durante la generación (no como un paso de postprocesamiento) le da una ventaja estructural.

Proveedor conocido: ByteDance, identidad estable, ecosistema establecido

Sabes quién hizo Seedance 2.0. El equipo de investigación Seed de ByteDance, liderado por Wu Yonghui (ex Fellow de Google, 17 años en Google incluyendo Google Brain), tiene un linaje documentado desde Pixeldance pasando por Seedance 1.0, 1.5 Pro, hasta 2.0. ¿HappyHorse? A fecha de publicación, nadie ha confirmado públicamente quién lo construyó. Artificial Analysis lo añadió como una entrada seudónima. Múltiples sitios de terceros aparecieron a las pocas horas de su debut en la arena, pero ninguno afirma ser el desarrollador original.

Para decisiones de producción, la procedencia importa. Necesitas saber de quién dependes para actualizaciones del modelo, cumplimiento y continuidad.

Vía de acceso: Dreamina tiene puntos de entrada públicos

Seedance 2.0 es accesible hoy a través de la plataforma Dreamina de ByteDance internacionalmente, con planes de pago a partir de aproximadamente $18/mes. La integración con CapCut Pro se lanzó en mercados seleccionados a finales de marzo de 2026. Los usuarios chinos pueden acceder a través de Jimeng con planes desde aproximadamente 69 RMB/mes (~$9.60 USD).

Dicho esto — la API oficial de Seedance 2.0 permanece pausada desde mediados de marzo de 2026 debido a disputas de derechos de autor reportadas. El acceso de consumidor funciona. El acceso programático a la API a escala de producción requiere verificación antes de que te comprometas con un pipeline alrededor de él. Los proveedores de terceros ofrecen Seedance v1.5 vía API; la disponibilidad de la API de Seedance 2.0 a través de canales oficiales necesita confirmación previa a la producción.

La Brecha de Acceso es el Factor de Decisión Real

HappyHorse: sin API estable, sin pesos públicos, solo demo a fecha de publicación

A pesar de las afirmaciones de lanzamiento de código abierto, el GitHub y el hub de modelos de HappyHorse están ambos listados como “próximamente”. Existen múltiples sitios de demo y wrapper, pero ninguno ofrece endpoints de API documentados con SLAs, límites de tasa o precios alrededor de los cuales podrías construir un producto. No encontré un solo proveedor de API de terceros que actualmente sirva HappyHorse-1.0 a través de un endpoint estable y documentado.

Si estás evaluando para producción, este es el factor más importante. Un modelo al que no puedes llamar de forma fiable no es un modelo que puedes implementar.

Seedance 2.0: accesible vía Dreamina — los detalles necesitan verificación

El acceso de consumidor a través de Dreamina es funcional. La plataforma soporta el conjunto completo de características incluyendo el sistema de referencia @, la edición multi-toma y la generación audiovisual. Pero si tu flujo de trabajo requiere integración a nivel de API, el panorama está menos establecido. La API oficial de BytePlus para Seedance 2.0 ha estado pausada desde marzo. Proveedores de terceros como fal.ai y PiAPI han ofrecido Seedance 1.5; el acceso programático a Seedance 2.0 y su estructura de precios asociada deben confirmarse directamente antes de construir una dependencia de producción.

Por qué “#1 en el clasificador” y “listo para producción” son preguntas diferentes

Sigo volviendo a esto. Elo te dice qué modelo prefieren los usuarios en una comparación controlada. No te dice si puedes pasar 10,000 generaciones a través de él el próximo martes sin un error 503. HappyHorse podría producir genuinamente mejor video silencioso. Pero si no puedes llamarlo de forma fiable, esa ventaja de calidad vive en la arena, no en tu pipeline.

Marco de Decisión

La calidad del audio es innegociable → Seedance 2.0. Lidera en ambos clasificadores con audio y su arquitectura de doble rama genera sonido sincronizado de forma nativa. Si tus clips necesitan diálogo, audio ambiental o efectos de sonido precisos al fotograma, Seedance es la opción más sólida hoy.

La fidelidad del movimiento visual es tu prioridad y estás dispuesto a esperar → Monitorea HappyHorse. Las ventajas Elo sin audio son reales. Si los pesos abiertos y el acceso a la API se materializan como se prometió, HappyHorse podría volverse convincente para flujos de trabajo que priorizan el silencio. Pero “próximamente” no es un SLA.

Necesitas una API de producción hoy → Seedance 2.0 es la apuesta más segura. No porque sea perfecta — la pausa de la API oficial es una restricción real — sino porque Dreamina proporciona una vía de acceso funcional con precios documentados, y los proveedores de terceros están preparando activamente endpoints de Seedance 2.0. HappyHorse no tiene infraestructura equivalente todavía.

Preguntas Frecuentes

¿Es HappyHorse-1.0 realmente mejor que Seedance 2.0?

Depende de lo que estés midiendo. HappyHorse lidera en calidad visual en comparaciones sin audio (Elo 1333 vs 1273 para T2V, 1392 vs 1355 para I2V). Seedance lidera cuando el audio es parte de la evaluación. Ninguno domina las cuatro categorías. “Mejor” solo tiene sentido en relación con tu caso de uso específico y si el audio importa.

¿Por qué HappyHorse lidera sin audio pero va por detrás con audio?

Probablemente arquitectura. HappyHorse afirma un Transformer unificado único que procesa todas las modalidades en una secuencia. Seedance 2.0 usa un diseño de doble rama construido específicamente donde las ramas de video y audio separadas están conectadas por atención cruzada. Esa rama de audio especializada parece dar a Seedance una ventaja cuando la calidad del sonido y la sincronización se juzgan junto a los visuales.

¿Puedo acceder a HappyHorse-1.0 vía API hoy?

No a través de ningún endpoint estable y documentado que pudiera verificar a fecha del 8 de abril de 2026. Múltiples sitios wrapper ofrecen acceso de demo basado en navegador, pero ninguno publica documentación de API, límites de tasa o SLAs de grado de producción. El GitHub oficial y el hub de modelos están ambos listados como “próximamente.”

¿Qué tan fiable es el clasificador de Artificial Analysis para decisiones de producción?

Es la señal crowdsourced más creíble para la calidad de video percibida — votos ciegos, ranking basado en Elo, preferencias humanas reales. Pero mide una cosa: qué salida prefieren los usuarios lado a lado. No tiene en cuenta la velocidad de generación, el costo, la fiabilidad, el tiempo de actividad de la API o la estabilidad del acceso. Úsalo como una entrada de calidad, no como una decisión de adquisición completa.

¿Obtendrá HappyHorse-1.0 mejoras de audio en versiones futuras?

No existe ninguna hoja de ruta pública. El modelo apareció en la arena hace menos de una semana bajo un seudónimo. Si el lanzamiento de código abierto “próximamente” sucede, las contribuciones de la comunidad podrían mejorar la calidad del audio. Pero no hay cronograma, ningún equipo de desarrollo confirmado y ningún plan de v2 anunciado. Cualquier cosa más allá de lo que está actualmente en el clasificador es especulación.

Hay algo interesante ocurriendo en la brecha entre lo que dice un clasificador y lo que un constructor puede realmente usar. Los números de HappyHorse son genuinamente impresionantes — pero los números sin acceso son solo números. Seguiré esperando que ese repositorio de GitHub entre en funcionamiento. Hasta entonces, la comparación no se trata realmente de cuál modelo es mejor. Se trata de cuál modelo está disponible.

Prueba HappyHorse-1.0 en WaveSpeedAI

HappyHorse-1.0 ya está disponible en WaveSpeedAI:

Publicaciones anteriores: