Cómo usar Seedance 2.0 a través de la API: trabajos asíncronos, reintentos y manejo de resultados

Patrones de producción para las APIs de Seedance 2.0: ciclo de vida de trabajos asíncronos, reintentos, idempotencia, observabilidad y controles de costos.

¿Quieres crear videos cinematográficos como Seedance 2.0? Prueba el WaveSpeed Cinematic Video Generator para crear videos cinematográficos al nivel de Seedance 2.0 ahora mismo.

Hola a todos. Dora está aquí. Resulta que seguía revisando una tarea de larga duración en la API de Seedance 2.0 y me pillaba cambiando de ventana para ver si había terminado. No era un fallo, solo una pequeña molestia constante. Durante unos días, ejecuté algunos trabajos reales (transformaciones de contenido y extracciones por lotes) y presté atención a las partes que realmente cambiaban cómo me sentía durante el día.

Lo que sigue son los patrones que hicieron el trabajo más estable: cómo envío, rastro y recojo resultados; cómo empaqueto las entradas; qué reintento (y qué no); y las salvaguardas básicas que evitaron que tropezara con claves, costos y registros. Si ya manejas APIs, esto te resultará familiar, y es intencional.

Ciclo de vida de un trabajo en la API (enviar → estado → resultado)

Intenté mantener la API de Seedance 2.0 simple en mi mente: tres movimientos, enviar, comprobar estado, obtener resultado. Cuando realmente lo traté así, la carga mental disminuyó.

Enviar: mando un trabajo con un payload claro e independiente y una clave de idempotencia generada por el cliente (más sobre eso después). Anoto, en comentarios de código para mí mismo, lo que considero “hecho”. No es algo filosófico: solo la forma exacta del éxito (p. ej., JSON con los campos X, Y, Z; un checksum que coincide; sin parciales).

Estado: dejé de ver el estado como una sola cosa. Lo divido en categorías:

- En progreso (seguro para hacer polling)

- Bloqueado (requiere mi acción, normalmente entrada incorrecta)

- Terminal (completado con éxito o fallido permanentemente)

Esa pequeña distinción cambió cómo comprobaba. Si está en progreso, me retiro y espero. Si está bloqueado, corrijo las entradas. Si es terminal, sigo adelante. No sobreinterpreto las etiquetas intermedias.

Resultado: cuando un trabajo termina, obtengo las salidas en un formato en el que puedo confiar más adelante, normalmente JSON con un esquema estable y un hash de contenido simple. Si la API admite webhooks, sigo manteniendo el polling como alternativa. Los webhooks son geniales hasta que una regla de firewall o un fallo en la cola se traga uno. El polling es aburrido y fiable.

Dos notas de campo breves:

- Las primeras ejecuciones no ahorraron tiempo. Después de algunas iteraciones, noté que ahorraban atención. Menos comprobaciones de “¿terminó eso?”, más “lo veré cuando esté realmente listo.”

- Evito encadenar trabajos dentro de la API cuando puedo. Un trabajo, un resultado. Si necesito lógica de ramificación o dependencias, lo mantengo en mi sistema. Hace que la detección de fallos y los reintentos sean más limpios.

Si estás construyendo alrededor de esto, una máquina de estados simple ayuda. Sin dramatismos, solo unos pocos estados enumerados y transiciones claras. No es elegante, pero absorbe los casos límite sin convertirse en un lío.

Diseño del payload (texto + empaquetado de referencias)

La mayor parte de mi fricción venía de los payloads. No fallos, solo desajustes. Cuando mejoré un poco la estructura, las cosas encajaron.

Dejé de enviar grandes bloques de texto en línea cuando no era necesario. En su lugar:

- Envío instrucciones de texto concisas y parámetros en línea.

- Paso artefactos grandes (documentos, medios, salidas anteriores) por referencia, URLs firmadas o claves de objeto, con identificadores versionados.

Esta división hizo que los reintentos fueran más seguros y redujo la carga de subidas. También hizo que los registros fueran más sensatos: podía ver qué cambió entre ejecuciones sin desplazarme por megabytes de contenido. Si la API de Seedance 2.0 necesita tanto texto como referencias, los mantengo bajo un único objeto “input” con nombres claros. El yo del futuro agradece no tener que buscar campos dispersos.

Validar entradas antes de enviar

Antes de enviar cualquier cosa, ejecuto tres comprobaciones localmente:

- Forma: ¿El payload coincide con mi propio esquema? Campos requeridos presentes, tipos correctos, enums válidos. Uso un validador de JSON Schema para esto.

- Referencias: ¿Las URLs se resuelven y cumplen las reglas de tamaño/tipo? Hago peticiones HEAD de verificación previa y adjunto content-length y checksum cuando están disponibles.

- Expectativas: ¿Los parámetros son coherentes con el tipo de trabajo que solicito? Si digo “resumir”, no paso también “full_transcript=true”. Es una tontería, pero ocurre.

Estas comprobaciones no hacen desaparecer los errores: los mueven al lugar más barato para corregirlos, antes de los saltos de red, antes de los límites de tasa, antes de que esté leyendo registros a medianoche.

Patrones de fiabilidad

Después de una semana de uso constante, la mayoría de mis dolores de cabeza venían de reintentos que no podía razonar. La cura eran patrones simples que podía explicar a un compañero en una frase.

Divido los fallos en dos grupos:

- Seguros para reintentar (problemas de red transitorios, 5xx, timeouts antes de que el servidor comience a trabajar)

- No reintentar ciegamente (errores de validación, cuota excedida, estados desconocidos)

Una vez hecho eso, el resto encajó.

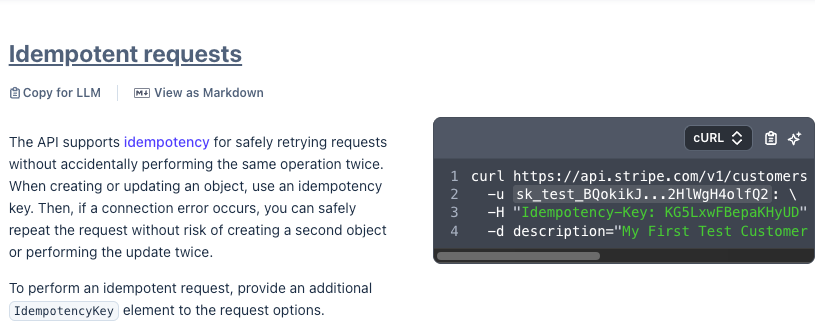

Claves de idempotencia + reintentos seguros

Añado una clave de idempotencia única a cada envío de trabajo. El servidor debería tratar las repeticiones con la misma clave como la misma petición. En la práctica, asumo que puede que no sepa si una petición llegó al servidor. Así que hago que los reintentos sean seguros por diseño.

Lo que ayudó:

- Derivar la clave de entradas estables (p. ej., un UUID más un hash del payload normalizado) para que los duplicados accidentales colisionen a propósito.

- Almacenar la clave y el efecto previsto con un TTL corto de mi parte. Si pierdo una respuesta, puedo reintentar con confianza.

- Tratar las operaciones no idempotentes (como “iniciar y cobrar”) como idempotentes en el límite del cliente. O el servidor lo hace cumplir o evito los reintentos automáticos.

Si quieres un modelo mental sólido, la forma en que las APIs de pagos manejan esto es clara. La documentación de claves de idempotencia de Stripe es concisa y vale la pena leerla, aunque no estés moviendo dinero.

Timeouts, backoff y límites de reintentos

Mantengo tres números a mano: timeout de petición, backoff inicial y máximo de intentos.

Mi configuración predeterminada tiene esta forma:

- Timeouts: conservadores pero no tacaños. Lo suficientemente largos para el trabajo típico del servidor, lo suficientemente cortos para evitar sockets zombie. Si un trabajo es verdaderamente de larga duración, prefiero una llamada de envío rápida y polling separado.

- Backoff: exponencial con jitter. El jitter importa. Sin él, los reintentos sincronizados se comportan como un pequeño DDoS.

- Límites: límites estrictos en el total de reintentos y el tiempo de pared total por trabajo. Después de alcanzar un límite, muestro un error legible por humanos y me detengo. Sin thrashing silencioso.

En la práctica, estos números cambiaron dos veces: una después del primer día (demasiado agresivo) y otra después de ver un patrón de picos cortos alrededor de la hora en punto (añadí más jitter). Nada de eso fue sofisticado. Solo hizo que el sistema se sintiera más tranquilo.

Observabilidad (registros, grupos de fallos, monitoreo de costos)

No busco trazado completo a menos que lo necesite. Para el trabajo con la API de Seedance 2.0, tres vistas fueron suficientes:

- Registros de peticiones con IDs de correlación: etiqueto cada llamada de envío, estado y resultado con el mismo ID de correlación. Cuando algo sale mal, puedo seguir un trabajo de principio a fin sin adivinar. Las convenciones semánticas de OpenTelemetry son una guía útil si estás configurando esto desde cero.

- Grupos de fallos: agrupo los fallos por causa (validación, autenticación, cuota, timeout, 5xx, desajuste de esquema). Los grupos hacen visibles las tendencias. Si “cuota” de repente crece los lunes, planifico en torno a ello en lugar de apagar incendios.

- Lente de costos: registro el costo estimado por trabajo, entradas, salidas y reintentos incluidos, y lo acumulo semanalmente. El objetivo no es la precisión: es sentir la pendiente. Una vista de percentiles simple (P50, P95) muestra si unos pocos valores atípicos están consumiendo silenciosamente el presupuesto.

Una pequeña nota sobre las alertas: las mantengo aburridas. Sin fuegos artificiales, solo umbrales que se mapean a acciones: “grupo de fallos > X durante Y minutos” o “costo P95 sube > Z% semana tras semana.” Prefiero notar tarde que vivir entre falsos positivos. La energía ahorrada compensa en otros lugares.

Conceptos básicos de seguridad y cumplimiento (claves, manejo de contenido de usuarios)

Nada sofisticado aquí, y ese es precisamente el punto. Los conceptos básicos hacen la mayor parte del trabajo.

- Claves: mantengo las claves de API fuera del código y las roto según un calendario. Claves por entorno, mínimo privilegio si existen alcances, y sin compartir entre equipos. Si la API admite tokens de corta duración, los uso.

- Contenido de usuarios: no registro datos de usuario en bruto. Registro hashes, tamaños y referencias. Si necesito muestras para depuración, primero las limpio o redacto, con un temporizador de retención claro.

- Manejo de datos: etiqueto cada trabajo con un ID de inquilino o usuario y llevo esa etiqueta a los registros y el almacenamiento. Es mundano, pero evita que las comprobaciones de acceso se conviertan en folclore.

- Almacenamiento: los resultados aterrizan en un bucket o base de datos con cifrado del lado del servidor y ACLs estrictas. Los registros de auditoría importan más que la elegancia aquí.

- Postura de cumplimiento: si un equipo necesita comodidad con SOC 2 o GDPR, anoto exactamente qué va a dónde, quién puede verlo y por cuánto tiempo. Sin promesas en la oscuridad. En caso de duda, consulto la página de seguridad del proveedor y los términos de procesamiento de datos en lugar de adivinar.

La prueba para mí es simple: ¿podría explicar esta configuración a un colega preocupado por la privacidad sin dar rodeos? Si no, no la he simplificado suficientemente.

Una última nota

Entré buscando velocidad. Lo que obtuve fue estabilidad. La API de Seedance 2.0 no eliminó pasos: los hizo predecibles. Eso fue suficiente para que el trabajo se sintiera más ligero. Sigo observando cómo evolucionan los costos durante un mes y si mis grupos aguantan ante nuevos tipos de trabajo. Preguntas tranquilas, pero buenas. ¿Tú qué opinas?

¿Quieres crear videos cinematográficos como Seedance 2.0? Prueba el WaveSpeed Cinematic Video Generator para crear videos cinematográficos al nivel de Seedance 2.0 ahora mismo.