GPT-5.4 vs GPT-5.3: Qué Podría Cambiar Realmente

Las filtraciones sobre GPT-5.4 apuntan a una inferencia más rápida y mejoras en visión. Así es como podría diferenciarse de GPT-5.3 para los desarrolladores.

Hola, soy Dora. Me di cuenta de que estaba vigilando un bucle de agente de larga duración. Nada dramático, solo esa sensación lenta y nerviosa cuando un modelo sigue pidiendo una llamada de herramienta más, y luego otra. Me recordó cuánto de mi día vive en los bordes: las pausas, los reintentos, los momentos de “¿realmente leyó el documento?”.

Así que pasé la tarde revisando mis notas sobre GPT-5.3 y luego ojeando los primeros rumores sobre GPT-5.4. Algunos de los debates iniciales sobre la fuga de información en torno a la arquitectura del modelo y las pistas de latencia están resumidos en este análisis de la filtración de GPT-5.4. No para perseguir lo próximo grande, sino para responder una pregunta más pequeña: ¿reduciría algo de esto las partes inquietas de mi flujo de trabajo? Este es mi registro continuo de GPT 5.4 vs GPT 5.3, con lo que he medido, lo que parece creíble y donde aún no estoy convencida.

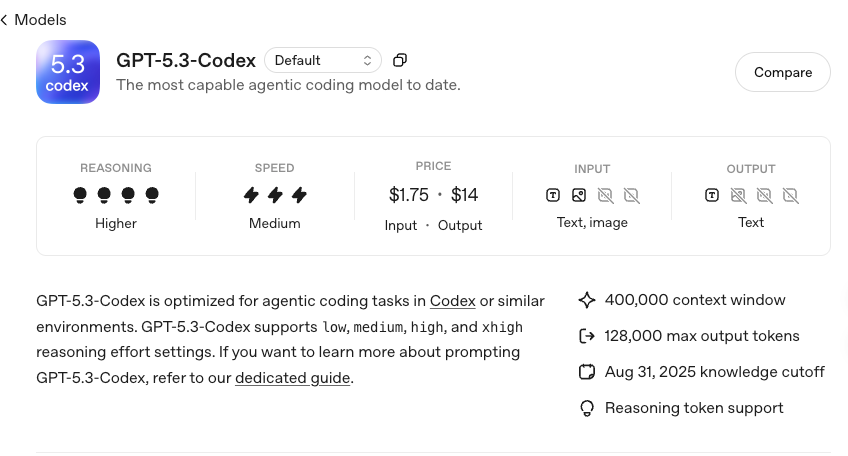

Capacidades de GPT-5.3: La Línea Base Actual

Razonamiento y rendimiento en el uso de herramientas

He estado usando GPT-5.3 desde mediados de enero de 2026 para tres trabajos constantes: resumir investigación de productos, clasificar hilos de soporte y construir andamiajes para scripts pequeños. En resumen: maneja el razonamiento de múltiples pasos bien si le doy una estructura clara. Cuando soy explícita sobre roles, estado y condiciones de terminación, lo sigue sin divagar.

Para el uso de herramientas, las llamadas a funciones han sido estables. Me apoyo en los patrones de llamadas a funciones de OpenAI y los esquemas de herramientas estándar, sin sorpresas. Con herramientas bien definidas (búsqueda, recuperación, una búsqueda vectorial simple), el 5.3 mantiene llamadas ordenadas. En una ejecución de clasificación de 20 correos electrónicos, promedió 1.7 llamadas de herramienta por hilo, frente a 2.4 con mi configuración anterior. Eso redujo las pequeñas pausas de “¿y ahora qué?”. El problema: si las descripciones de mis herramientas se vuelven vagas, intenta compensar con más llamadas.

Lo que más noto es su tolerancia al contexto parcial. Si solo paso el fragmento relevante y un resumen de estado delgado, aún razona bien. Pero si le incluyo muchas notas vagamente relacionadas, empieza a hacer salvedades.

Soporte de codificación y flujo de trabajo de agentes

Para código, el 5.3 es estable en refactorizaciones pequeñas a medianas. Es bueno generando diffs con explicaciones claras y puede mantener un estilo consistente si le proporciono una breve guía de estilo. Donde se ralentiza es en cambios entre archivos que requieren un conocimiento ajustado de dependencias. Suelo cambiar a un patrón de dos pasadas: la primera pasada le pide que describa las ediciones; la segunda las aplica archivo por archivo. Eso evita que toque con exceso de confianza cosas que no debería.

En los flujos de trabajo de agentes, el 5.3 se comporta mejor cuando limito la recursión y registro cada decisión. Me he establecido en un bucle de tres pasos: planificar → llamar herramienta → reflexionar. Más que eso y se vuelve verboso. También lo oriento a emitir JSON compacto para el estado, lo que reduce los errores de análisis. Nada de esto es mágico, son simplemente barreras que hacen que el bucle sea menos dependiente.

Limitaciones conocidas

- Puede duplicar el manejo de instrucciones cuando mezclo reglas del sistema con tareas largas del usuario: he aprendido a reiterar las restricciones clave cerca del final del prompt.

- A veces insiste en volver a resumir entradas que ya he resumido, lo que añade tokens y tiempo.

- En tareas de visión (capturas de pantalla, maquetas de UI), es decente etiquetando y describiendo, pero pierde texto pequeño y lógica de diseño fina. Me ha confundido botones con interruptores más de una vez.

- Bajo presión (tokens ajustados), prefiere generalidades seguras sobre precisión en los bordes. Lo veo cuando evalúo registros de errores: nombra causas probables, pero duda en comprometerse sin más contexto.

Esa es mi imagen de trabajo del 5.3: confiable cuando soy explícita, ligeramente ansioso cuando no lo soy.

Lo que las Señales de GPT-5.4 Sugieren que Ha Cambiado

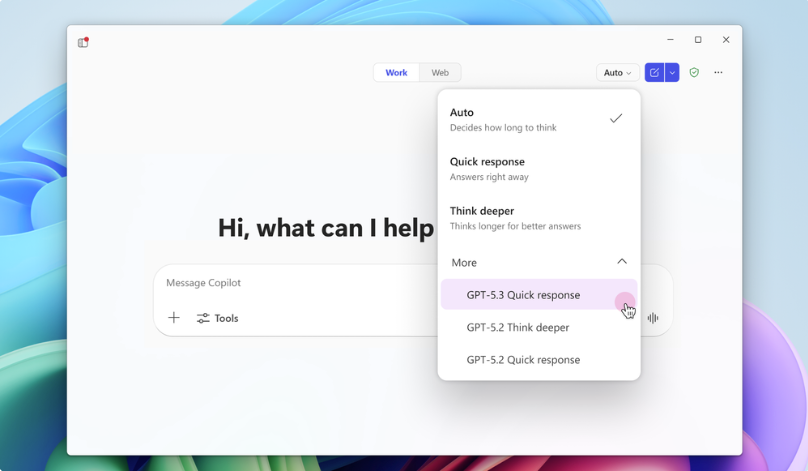

No he tenido acceso directo al 5.4 a partir del 5 de marzo de 2026. Lo que sigue proviene de hilos de filtración tempranos, algunas notas creíbles de desarrolladores en foros privados, y patrones que he aprendido a observar cuando una familia de modelos avanza gradualmente. Marcaré cada punto como apto para observación, basado en filtración, o especulativo.

Velocidad de inferencia, implicaciones del modo rápido

Basado en filtración: varias cuentas mencionan un “modo rápido” o nivel de baja latencia para el razonamiento de formato corto. Si es cierto, eso importa menos por el rendimiento bruto y más por el tempo del agente. Una reducción del 20-30% en la latencia del primer token cambia la sensación de un bucle de pesado a ágil. Los benchmarks que comparan GPT-5 con modelos como DeepSeek y GLM muestran cuánto pueden moldear la latencia y el costo los flujos de trabajo de los desarrolladores en la práctica. En mi configuración con 5.3, la latencia del primer token ronda los 600-900 ms en prompts promedio: recortar incluso 150-200 ms haría que las cadenas de herramientas fueran menos intermitentes. Esperaría que este modo rápido sacrifique algo de profundidad, útil para enrutamiento, clasificación o validación rápida antes de un paso más profundo.

Apto para observación: si el 5.4 realmente añade un nivel de velocidad, probablemente dividiré los flujos de trabajo: clasificación rápida → enrutamiento → pasada profunda. Eso ya es un patrón común: la velocidad solo lo hace más fluido.

Mejoras en el manejo de entradas visuales

Basado en filtración: mejor OCR de texto pequeño y razonamiento de diseño más estable. Las pistas apuntan a un reconocimiento mejorado para texto de UI de bajo contraste y lógica de cuadro delimitador más fina. Si es preciso, esto corregiría dos de mis puntos de fricción con el 5.3: texto pequeño en capturas de pantalla y diferenciación de controles de UI.

Apto para observación: esto ahorraría los vaivenes que hago al validar wireframes de interfaz. Ahora mismo, ejecuto las capturas de pantalla a través de un paso OCR separado cuando el 5.3 se queda en blanco. Si el 5.4 reduce esos desvíos, eliminaré una herramienta de la cadena.

Posible expansión de la ventana de contexto

Especulativo: pequeño aumento en el contexto utilizable o mejor retención en prompts largos. No me refiero a los números del titular: me refiero a la recuperación práctica en la segunda mitad de una conversación larga. Si el 5.4 mantiene las restricciones de tarea más firmemente sin que yo las repita, cambia cómo estructuro el estado. Menos recordatorios, menos impuestos de tokens. Si solo es un aumento en la ventana sin una mejor recuperación, el beneficio es menor.

Me creeré este cuando vea menos “reinterpretaciones” tarde en las ejecuciones. Hasta entonces, soy cautelosa.

Tabla de Comparación Lado a Lado

Prefiero separar lo que he medido de lo que solo he escuchado. Tres tablas rápidas, con el mismo enfoque cada vez.

Capacidades confirmadas

| Área | GPT-5.3 | GPT-5.4 |

|---|---|---|

| Uso de herramientas / llamadas a funciones | Estable con esquemas claros: 1–3 llamadas por tarea típicas en mis ejecuciones | No confirmado |

| Razonamiento bajo presión de tokens | Se degrada en generalidades: se beneficia de restricciones reiteradas | No confirmado |

| Visión (capturas de pantalla de UI) | Pierde texto pequeño: confunde algunos controles | No confirmado |

| Comportamiento en bucle de agente | Funciona mejor con bucles de 2–3 pasos y condiciones de parada explícitas | No confirmado |

| Codificación entre archivos | Necesita estrategia de dos pasadas por seguridad: buenas explicaciones de diff | No confirmado |

Referencias: Sigo los patrones en los docs de llamadas a funciones de OpenAI y las definiciones de herramientas en la referencia de la API. Si tienes curiosidad, los docs oficiales son un buen ancla: OpenAI API: llamadas a funciones y uso de herramientas.

Señales basadas en filtración

| Área | GPT-5.3 | GPT-5.4 (basado en filtración) |

|---|---|---|

| Nivel de velocidad de inferencia | Solo modos estándar | Añade un nivel más rápido y superficial para respuestas de baja latencia |

| OCR de visión | Adecuado, tiene problemas con texto pequeño/de bajo contraste | Mejor precisión de texto pequeño y manejo de diseño |

| Costo por token | Tarifas publicadas actuales | Ligera reducción en el nivel rápido (no verificado) |

Calidad de fuentes: mixta. Algunos detalles se alinean con patrones de versiones anteriores: ninguno está confirmado.

| Área | GPT-5.3 | GPT-5.4 (especulativo) |

|---|---|---|

| Retención de contexto | Necesita recordatorios frecuentes de restricciones | Mantiene las restricciones por más tiempo con menos reiteraciones |

| Eficiencia en uso de herramientas | A veces hace llamadas de más cuando el esquema es vago | Mejor parsimonia de llamadas con prompts similares |

| Planificación a largo horizonte | Duda en comprometerse más allá de 3–4 pasos | Planificación de múltiples pasos ligeramente más estable |

Mejoras especulativas

Por Qué Estos Cambios Importan para los Desarrolladores

Impacto en el diseño de bucles de agentes

Si el “modo rápido” existe, rediseñaría los bucles para cargar anticipadamente la certeza económica. Clasificación rápida, luego ramificación: las tareas simples se completan en modo rápido; las complejas escalan al modelo de profundidad completa. Solo eso puede reducir la supervisión humana. En mi stack actual de 5.3, gasto energía evitando que los bucles se descontrolen. Un nivel de velocidad podría redirigir esa energía hacia un enrutamiento más claro.

Un mejor manejo de la visión simplificaría mi pipeline de análisis de UI. Ahora mismo, uso una cadena de tres pasos para maquetas: descripción básica → pasada OCR → verificación de diseño. Si el 5.4 fusiona los dos primeros, retiraré el salto OCR y solo conservaré el validador de diseño. Eso es una herramienta menos que mantener, y menos lugares para errores.

Si la retención de contexto mejora, reduciré el ritmo constante de recordatorios en los prompts. Mantendría un pequeño bloque de reglas inmutable y confiaría en que el modelo lo llevaría más lejos en la ejecución. Menos andamiaje, menos tokens, los mismos resultados.

Compensaciones entre costo y rendimiento

Un nivel de velocidad generalmente conlleva un impuesto de calidad. Lo trato como una característica, no como un defecto. Úsalo para:

- enrutamiento y validación ligera (¿analizamos la fecha, sí/no?),

- salidas anticipadas (¿es esta una pregunta frecuente conocida?),

- verificaciones de salud en el contexto recuperado (¿este fragmento siquiera menciona la entidad?).

Para todo lo demás, el razonamiento que da forma a los resultados, se paga por la profundidad. Si el nivel rápido del 5.4 es más barato por token, esperaría pequeños ahorros en tareas de alto volumen, pero la ganancia real es la latencia. El costo por tarea puede bajar un poco: la velocidad percibida puede mejorar mucho.

Si no hay cambios en los precios, aún dividiría el trabajo. Incluso con el 5.3, usar un modelo más pequeño/económico para el enrutamiento suele valer la pena. Un nivel rápido nativo solo reduciría el código de conexión.

Consideraciones de migración

- Empieza con pruebas en paralelo. Ejecuta los mismos prompts a través del 5.3 y el 5.4 (cuando esté disponible) y compara los resultados. No cambies el flujo en producción hasta que hayas visto algunas docenas de casos extremos.

- Mantén tus esquemas de herramientas estrictos. Las descripciones vagas inflan el número de llamadas en el 5.3: probablemente harán lo mismo en el 5.4, sea rápido o no.

- Registra la presión de tokens. Muchas “regresiones” son solo prompts más ajustados. Rastrea el uso de la ventana y elimina el texto redundante.

- Versiona los prompts. Mantengo un pequeño registro de cambios en mis mensajes del sistema. Si el 5.4 se comporta mejor con recordatorios más ligeros, querrás un rastro en papel de lo que eliminaste.

- Observa la visión tranquilamente. Si dependes de capturas de pantalla, prueba con texto de bajo contraste, UI apretada y fuentes inusuales. Un buen conjunto de pruebas vale más que una docena de anécdotas.

Si eres un equipo pequeño, el movimiento más seguro es por fases: prueba piloto en un flujo de trabajo estrecho (enrutamiento, clasificación), luego expande.

Para constructores en solitario, probaría un cambio de hábito: añade una puerta de “¿rápido o completo?” al principio de tu cadena de prompts. Aunque el 5.4 no incluya un modo rápido, la disciplina ayuda.

Advertencia Importante (comparación basada en señales de filtración)

Todo lo relacionado con GPT-5.4 aquí es de segunda mano hasta que haya un lanzamiento oficial o documentación. Las partes del 5.4 son una mezcla de señales basadas en filtración y suposiciones cuidadosas a partir de actualizaciones anteriores. Si y cuando el 5.4 sea real, volveré a ejecutar las mismas tareas y actualizaré esto. Por ahora, considera esto un mapa dibujado a lápiz, no con tinta.

Un último pensamiento: incluso pequeñas mejoras de velocidad pueden destensar un flujo de trabajo. Si eso es todo lo que trae el 5.4, lo acepto.