GPT-5.4 para Desarrolladores: Lo que las Señales Filtradas Significan para los Flujos de Trabajo con IA

Modo rápido, mejoras de visión y señales de agente de codificación: esto es lo que las filtraciones de GPT-5.4 podrían significar para los constructores de infraestructura de IA.

Hola, soy Dora. No tenía planeado rastrear GPT‑5.4. Simplemente seguía topándome con pequeños obstáculos en mis flujos de trabajo de agentes, pausas suficientemente largas como para cambiar a mi correo y luego olvidar qué estaba haciendo. Cuando un modelo promete “Modo Rápido” y visión de resolución completa, me pongo alerta, no porque quiera lo más nuevo, sino porque quiero menos de esas pequeñas interrupciones.

Este artículo es para desarrolladores de gpt 5.4, o, más precisamente, para desarrolladores que están decidiendo si y cómo construir alrededor de él. No estoy aquí para vender el modelo. Estoy aquí para compartir dónde podría reducir la fricción, dónde probablemente no lo hará, y qué construir para que el trabajo de hoy sobreviva las notas de lanzamiento de mañana.

Por Qué los Desarrolladores Están Observando GPT-5.4 de Cerca

El cambio hacia el modelo-como-infraestructura

He notado un cambio lento pero real: los modelos se parecen menos a “productos” y más a utilidades por las que enrutas tareas. Hace un año, trataba cada modelo como una personalidad. Ahora los trato como carriles en una autopista: carriles de alta precisión, rápidos y económicos, y trato de cambiar entre ellos sin problemas.

Si GPT‑5.4 estabiliza un patrón de doble carril (rápido/lento o rápido/reflexivo), nos empuja a diseñar agentes en torno al enrutamiento, no a apuestas únicas. Eso suena abstracto hasta que estás depurando una tarea con 12 pasos y te das cuenta de que el paso 3 solo necesita una clasificación rápida, pero el paso 8 necesita una cadena de pensamiento cuidadosa. He cosido esa lógica a mano en los sistemas actuales. Es frágil. Si la infraestructura lo incorpora, tenemos menos puntos donde tropezar.

No me impresionan las versiones: me importa si una versión me permite colapsar pasos o eliminar código de unión. GPT‑5.4, si va hacia donde apuntan las pistas, podría ser uno de esos casos.

Por qué importan las versiones incrementales

Los pequeños saltos de versión parecen aburridos, pero salvan a los equipos de reconstrucciones. Cuando los modelos mantienen las interfaces estables mientras mejoran la latencia o la fidelidad visual, no necesito volver a entrenar a los usuarios (ni a mí mismo). El valor aparece en lugares como: menos reintentos, prompts más precisos, tiempos de espera más cortos.

Reviso la documentación de la API de OpenAI y las páginas de modelos en busca de cambios de forma más que de slogans. Si GPT‑5.4 encaja en los endpoints existentes con valores predeterminados más sensatos y un comportamiento del sistema más claro, eso es una victoria. Menos rotación de código, registros más predecibles. Y para cualquiera que mantenga agentes en producción, la predictibilidad supera a la novedad todos los días.

Modo Rápido — Qué Cambia para los Flujos de Trabajo de Agentes

Costo actual del razonamiento en agentes de múltiples pasos

En mis ejecuciones durante el último mes con modelos de generación actual, un agente típico de múltiples pasos (planificar → recuperar → llamar herramientas → resumir) realiza entre 8 y 15 llamadas al modelo. Cada llamada tiene dos costos: tokens y atención. Los tokens puedes presupuestarlos. La atención es lo que te agota: las pequeñas esperas, los reintentos parciales, los momentos en que te preguntas si se ha bloqueado.

Para mí, una tarea típica de resolución de herramientas internas promedia entre 20 y 45 segundos de extremo a extremo. La mayor parte de eso no es razonamiento pesado: son verificaciones ligeras y formateo. Si el Modo Rápido de GPT‑5.4 recorta la latencia en estos pasos ligeros manteniendo una precisión suficientemente buena, cambia la forma de toda la ejecución. La larga cola de pequeñas esperas se reduce. Eso no parece dramático en papel, pero se siente mejor en el trabajo diario.

Inferencia de doble modo y lógica de enrutamiento

Lo que estoy observando es si el “Modo Rápido” es solo un modelo más pequeño, o verdaderamente un modelo emparejado con un pensador dentro de un mismo límite. Si la API expone una pista clara, digamos un parámetro o una regla de enrutamiento a nivel de herramienta, puedo centralizar la decisión: rápido para clasificación, completo para síntesis. Sin más bifurcaciones específicas en cada paso del agente.

En pruebas con los modelos actuales, he prototipado comportamiento de doble ruta verificando la intención y confianza del paso. Es torpe pero funciona: ruta rápida para patrones conocidos, ruta profunda cuando la incertidumbre es alta. GPT-5.4 probablemente hará lo mismo si la API no enruta automáticamente. Si lo hace automáticamente, el trabajo pasa a escribir barreras de seguridad sensatas y registros, para poder ver cuándo el modelo usa en exceso el carril lento.

De cualquier manera, la lógica es el punto. Una función llamada “Rápida” no ayuda si no puedes saber cuándo se usa. Prefiero un parámetro simple y un buen rastreo antes que la magia.

Implicaciones del bucle de llamadas a herramientas

Aquí es donde importa en el día a día: los bucles de herramientas. Cuando un agente llama a tu calculadora, base de datos o navegador tres veces seguidas, la sobrecarga se acumula. Si el Modo Rápido reduce el costo de ida y vuelta para el análisis de intención y la construcción de argumentos de función, reduces el bucle. Eso libera presupuesto para los pasos que realmente necesitan razonamiento.

Pero hay un inconveniente: si el paso rápido enruta mal incluso el 5–10% de las llamadas, lo recuperas en reintentos y barreras de seguridad. Mi regla general es simple: mide los bucles totales completados por minuto, no la latencia por llamada. Si ese número sube con el Modo Rápido activado, mantenlo. Si baja (más reintentos, más correcciones), desactívalo para ese flujo. No se trata de velocidad, se trata de rendimiento confiable.

Visión de Resolución Completa — Casos de Uso del Mundo Real

Canalizaciones de captura de pantalla a código

Ejecuto una pequeña canalización de captura de pantalla a componente para herramientas internas. Hoy, la visión de baja resolución pierde pequeños espaciados o señales de estado (hover vs. activo). La visión de resolución completa, si es real y accesible a costos de tokens razonables, cambia esto. El modelo puede ver el borde de 1 píxel y la sutil sombra que indica elevación.

En la práctica, lo conectaría así: un paso de alta resolución para etiquetar elementos de UI atómicos, luego un paso rápido solo de texto para ensamblar código usando un mapa de biblioteca. Dos pasos, cada uno bueno en lo suyo. El beneficio no es la magia de “diseño a código”, sino menos correcciones manuales. En un panel simple, eso podría ahorrarme entre 10 y 15 minutos y un par de viajes de regreso a Figma.

Flujos de trabajo de depuración de UI

Un caso tranquilo pero útil: reproducciones de errores. A menudo recibo capturas de pantalla con notificaciones de error a medio cortar o superposiciones modales. La visión de alta resolución ayuda al modelo a razonar sobre z-index y apilamiento de diseño sin que yo lo describa en palabras. El modelo puede notar: el botón de cierre de la notificación se superpone a la navegación: probablemente un problema de apilamiento CSS. Todavía verifico, pero empezar más cerca de la solución es un alivio.

Para los equipos, podría encajar en el triaje: pega una captura de pantalla, obtén una lista de causas probables, más selectores para inspeccionar. Nada mágico, simplemente un bucle más ajustado.

Interpretación de activos de diseño

Los diseñadores me entregan exportaciones con convenciones de nomenclatura que se desvían bajo presión de plazos, sucede. La visión de alta resolución más el contexto sobre el sistema de diseño puede restaurar el orden. El modelo puede mapear tokens visuales (espaciado, radio, contraste de color) a las variables del sistema de diseño más cercanas.

Los límites siguen aplicando. El modelo no conocerá el gusto de tu equipo. Pero puede hacer la parte aburrida: “estos 12 íconos son de 20px, estos 3 son de 16px: probable discrepancia.” Eso no es noticia de primera plana, pero es el tipo de pequeña corrección que se acumula a lo largo de un sprint.

Señales del Agente de Codificación en Contexto

Por qué aparecieron filtraciones en repositorios de Codex

Probablemente hayas visto pistas, commits que hacen referencia a señales de agentes, o configuraciones con indicadores de enrutamiento inexplicables. No leo demasiado en las filtraciones, pero coinciden con lo que los desarrolladores necesitan: señales más claras sobre cuándo el modelo está planificando, actuando o reflexionando. Los repositorios de la era Codex anteriores a menudo simulaban esto con heurísticas en el cliente. Por eso se filtraron las configuraciones: la lógica tenía que vivir fuera del modelo.

Si GPT‑5.4 expone señales de estado más firmes (incluso simples como “planificando” vs “ejecutando”), los programadores pueden sincronizar la UI y los registros sin analizar vibraciones del texto.

Potencial de edición de múltiples archivos

Las ediciones de múltiples archivos son donde los agentes de codificación fallan. Hoy, fragmento el contexto, pido un plan, luego aplico diffs con un linter en el bucle. Funciona hasta que no funciona, generalmente cuando el agente olvida un archivo pequeño o renombra algo a mitad de camino. Un mejor soporte nativo se vería así: proponer un commit con un mapa de archivos, incluir justificación por archivo, y dejarme aceptar cambios por archivo.

Incluso sin nuevas primitivas, el razonamiento mejorado de GPT‑5.4 (si se materializa) más mensajes más estrictos, “muéstrame un conjunto de parches, no prosa”, podría reducir los errores. He tenido algo de éxito forzando un formato de parche y rechazando cualquier otra cosa. Es aburrido. Ayuda.

Mejoras en la navegación de repositorios

Las ventanas de contexto se hicieron más grandes, pero la navegación sigue importando. Las mejores ejecuciones de codificación que he tenido en 2026 usan un indexador rápido que construye un mapa de símbolos y un grafo de dependencias, luego alimenta solo los fragmentos relevantes. Si GPT‑5.4 es mejor leyendo estos mapas, tablas de referencias cruzadas, resúmenes de símbolos, podemos pasar contexto más delgado y preciso.

Una señal práctica a observar: con qué frecuencia el agente solicita un archivo que ya vio. Menos repeticiones generalmente significa que está construyendo un conjunto de trabajo mejor. Lo registro. Si no lo haces, empieza ahora: es una métrica fácil de seguir a través de versiones.

Qué Deberían Construir los Desarrolladores Ahora

Patrones de arquitectura agnósticos al modelo

Intento mantener los modelos detrás de un puerto estrecho. Un intermediario decide el enrutamiento: las herramientas permanecen sin estado y visibles en los registros: los prompts viven en archivos versionados con pruebas. De esa manera, si GPT‑5.4 hace que el Modo Rápido valga la pena, puedo cambiar de carril sin recablear todo.

Dos patrones que me han funcionado bien con el tiempo:

- Esquemas de herramientas tipados con validadores estrictos. Menos conjeturas, menos llamadas erróneas.

- Diseño centrado en el rastreo. Cada paso del agente escribe un rastreo compacto que puedo reproducir. Cuando una actualización del modelo cambia el comportamiento, puedo comparar ejecuciones antiguas con nuevas.

Ninguno es llamativo. Ambos son lo que evita que el envío se detenga cuando los modelos cambian.

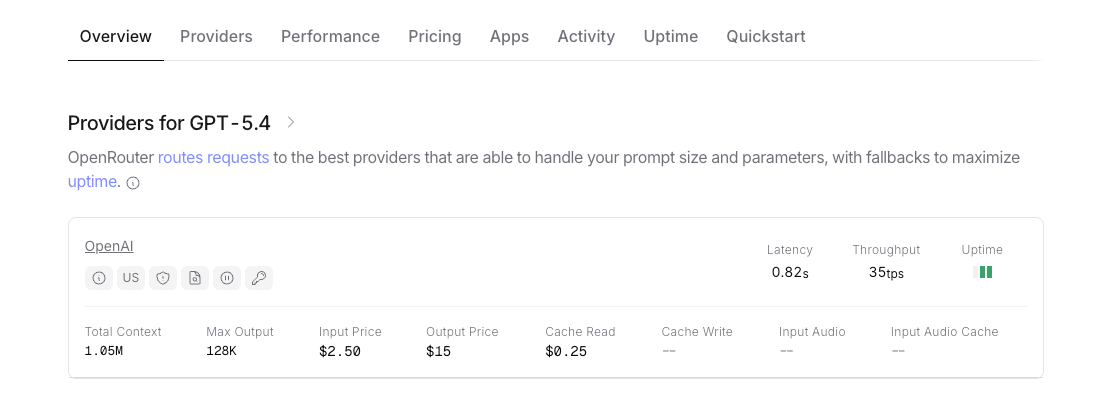

Monitoreo de canales de versiones de modelos

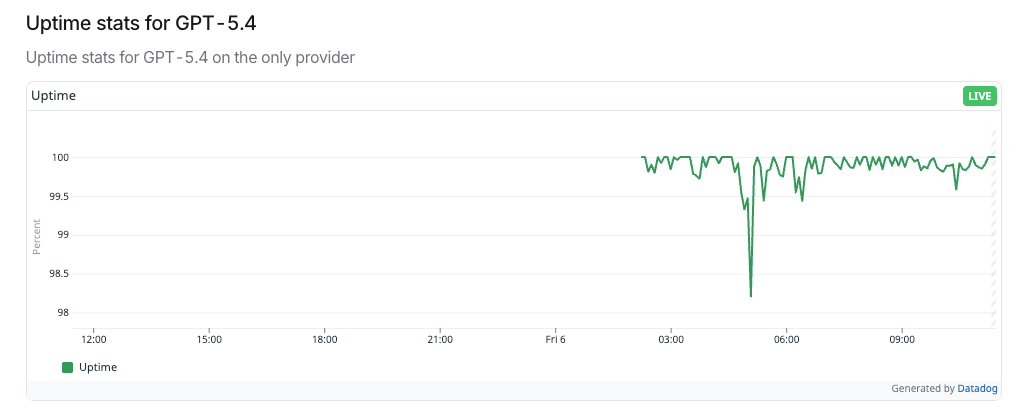

Incluso si no te mueves rápido, observa los canales. Me suscribo a páginas de modelos y reviso la lista de modelos y notas de versión. Marco tres cosas por actualización: pistas de latencia, precios de tokens y cualquier nuevo interruptor a nivel de sistema (modos, enrutamiento, comportamiento de seguridad). Luego vuelvo a ejecutar un pequeño conjunto de referencia, entre 10 y 20 rastreos que representan mis flujos de trabajo reales.

Lleva una hora. Ahorra días después. Si GPT‑5.4 se lanza en fases (generalmente lo hace), verás los casos extremos primero en los rastreos, no en los tickets de soporte. Ese es el punto del monitoreo: detectar la deriva con calma, antes de que se convierta en un incendio.

Aviso de Estado

No me han patrocinado para escribir esto. Tampoco he hecho apuestas de producción en GPT‑5.4 todavía. Mis notas aquí provienen de experimentos adyacentes y patrones que se mantuvieron en actualizaciones de modelos anteriores. Si y cuando la documentación oficial aclare los modos o los detalles de visión, los enlazaré y ajustaré. Hasta entonces, trata esto como notas de campo, útiles, espero, pero provisionales.

Una última cosa en la que todavía estoy reflexionando: si el Modo Rápido hace que las partes silenciosas sean más rápidas, ¿notamos menos, o simplemente nos preocupamos menos? Me conformo con cualquiera de las dos.