GPT-5.4 開發者指南:洩露信號對 AI 工作流程的意義

快速模式、視覺升級與程式代理信號——GPT-5.4 洩露資訊對 AI 基礎設施建構者意味著什麼。

嗨,我是 Dora。我並沒有計劃追蹤 GPT‑5.4。只是在我的 agent 工作流程中不斷撞上一些小阻礙——長到讓我切換去看電子郵件、然後忘記自己在做什麼的停頓。當一個模型承諾「快速模式」和全解析度視覺時,我的耳朵就豎起來了——不是因為我想要最新的東西,而是因為我想要更少這些微小的中斷。

這篇文章是寫給 GPT 5.4 的開發者的,或者更準確地說,是寫給正在決定是否以及如何圍繞它進行開發的開發者。我不是來推銷這個模型的。我是來分享它可能在哪些地方減少摩擦、在哪些地方可能不會,以及應該往哪個方向構建,讓今天的工作在明天的發布說明中仍能存活。

為什麼開發者在密切關注 GPT-5.4

模型作為基礎設施的轉變

我注意到一個緩慢但真實的轉變:模型愈來愈不像「產品」,而更像你將任務路由通過的公用設施。 一年前,我把每個模型當成一種個性。現在我把它們當成高速公路上的車道:高精度、快速和低成本的車道,而我嘗試在它們之間順暢地切換。

如果 GPT‑5.4 穩定了一種雙車道模式(快速/慢速或快速/思考),它就會推動我們圍繞路由設計 agent,而不是單一押注。這聽起來很抽象,直到你在偵錯一個有 12 個步驟的任務時才意識到——步驟 3 只需要快速分類,但步驟 8 需要仔細的思維鏈。我在目前的系統中手動縫合了這種邏輯。很脆弱。如果基礎設施把它內建進去,我們就少了很多絆倒的地方。

我對版本號不感冒:我在乎的是一次發布是否讓我能夠合併步驟或移除黏合代碼。GPT‑5.4,如果它朝著暗示的方向前進,可能就是其中之一。

為什麼漸進式發布很重要

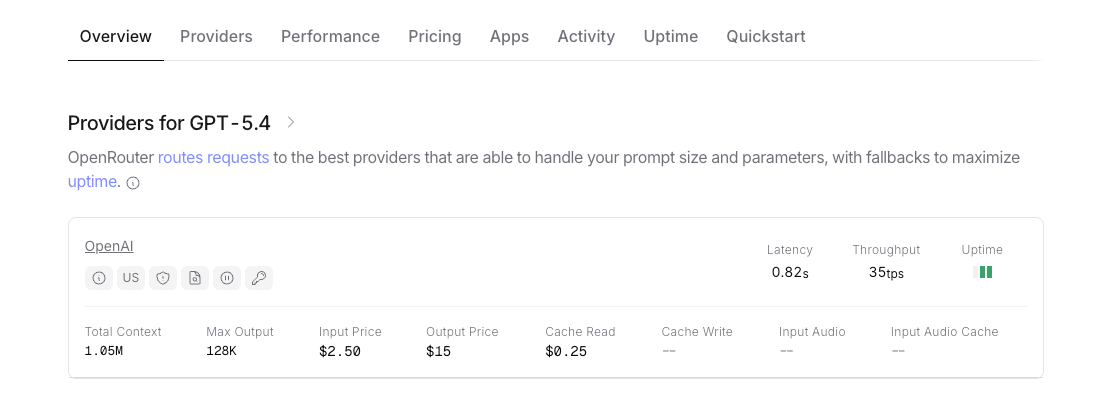

小版本號的提升看起來很無聊,但它讓團隊免於重建。當模型在改善延遲或視覺保真度的同時保持介面穩定,我就不需要重新訓練使用者(或我自己)。這種價值體現在:更少的重試、更精簡的提示詞、更短的逾時時間。

我關注 OpenAI API 文件和模型頁面上的結構變化,而不是口號。如果 GPT‑5.4 能以更合理的預設值和更清晰的系統行為接入現有端點,那就是勝利。更少的代碼變動,更可預測的日誌。對於任何在生產環境中維護 agent 的人來說,可預測性每天都勝過新穎性。

快速模式——它對 Agent 工作流程的改變

多步驟 Agent 中目前的推理成本

在我上個月使用當代模型的運行中,一個典型的多步驟 agent(計劃 → 擷取 → 呼叫工具 → 摘要)需要 8–15 次模型呼叫。每次呼叫消耗兩樣東西:token 和注意力。Token 你可以預算。注意力才是讓你耗盡的——那些小小的等待、部分重試、以及你懷疑是否卡住的時刻。

對我來說,一個常見的內部工具解析任務端到端平均需要 20–45 秒。其中大部分不是繁重的推理:是輕量的檢查和格式化。如果 GPT‑5.4 的快速模式在保持足夠準確度的同時縮短這些輕量步驟的延遲,它就改變了整個運行的形態。微小等待的長尾被削減了。這在紙上看起來不戲劇化,但在日常工作中感覺更好。

雙模式推論與路由邏輯

我在觀察的是「快速模式」究竟只是一個較小的模型,還是真正地在同一個邊界內配對了一個思考器的模型。如果 API 暴露了一個清晰的提示——比如一個參數或工具級別的路由規則——我可以集中化這個決策:分類用快速,合成用完整。不再需要在每個 agent 步驟中自訂分叉。

在今日模型的測試中,我通過檢查步驟意圖和置信度原型設計了雙路由行為。這很笨拙但有效:已知模式走快速路由,不確定性高時走深度路由。GPT-5.4 如果 API 不自動路由,可能也會做同樣的事。如果它確實自動路由,工作就轉移到編寫合理的護欄和日誌記錄,這樣你才能看到模型何時過度使用慢速車道。

無論如何,邏輯才是重點。一個叫做「快速」的功能,如果你無法判斷它何時被使用,就沒有幫助。我寧願要一個普通的參數和良好的追蹤,也不要魔法。

工具呼叫循環的影響

這就是它在日常中重要的地方:工具循環。 當 agent 連續三次呼叫你的計算器、資料庫或瀏覽器時,開銷就會疊加。如果快速模式降低了意圖解析和函數參數構建的往返成本,你就縮短了循環。這為真正需要推理的步驟釋放了預算。

但有一個陷阱:如果快速通道即使只有 5–10% 的呼叫路由錯誤,你就在重試和護欄上付出了代價。我的經驗法則很簡單:測量每分鐘完成的總循環數,而不是每次呼叫的延遲。如果開啟快速模式後這個數字上升,就保留它。如果下降(更多重試、更多糾正),就對那個流程關閉它。重要的不是速度,而是可靠的吞吐量。

全解析度視覺——真實世界的使用案例

截圖轉代碼的流程

我為內部工具執行一個小型的截圖轉元件流程。今日,低解析度視覺會遺漏微小的間距或狀態提示(懸停 vs. 啟用)。全解析度視覺,如果是真實的且以合理的 token 成本可存取,就會改變這一切。模型可以看到 1 像素的邊框和標誌著高度的微妙陰影。

在實踐中,我會這樣連接:高解析度通道來標記原子 UI 元素,然後快速純文字通道使用函式庫映射來組合代碼。兩個通道,各自擅長自己的事。回報不是**「設計轉代碼」的魔法,而是更少的手動修正**。在一個簡單的儀表板上,這可能為我節省 10–15 分鐘和幾趟回到 Figma 的旅程。

UI 偵錯工作流程

一個安靜但有用的案例:bug 重現。我經常收到帶有半截錯誤提示或模態視窗疊加的截圖。高解析度視覺幫助模型推理 z-index 和佈局堆疊,而不需要我用文字描述。模型可以指出:提示的關閉按鈕與導航欄重疊——可能是 CSS 堆疊問題。我仍然驗證,但從更接近修復的地方開始是一種解脫。

對於團隊來說,它可以融入分類流程:貼上截圖,獲得可能原因列表,加上要檢查的選擇器。沒什麼神奇的,只是更緊密的循環。

設計資產解讀

設計師在截止日期壓力下交給我命名規則漂移的導出檔案——這種情況會發生。加上設計系統背景的全解析度視覺可以恢復秩序。模型可以將視覺 token(間距、圓角、色彩對比)映射到最接近的設計系統變數。

限制仍然存在。模型不會了解你們團隊的品味。但它可以完成無聊的部分:「這 12 個圖示是 20px,這 3 個是 16px:可能不匹配。」這不值得上頭條,但它是那種在整個衝刺期間累積起來的小正確性。

上下文中的程式碼 Agent 信號

為何洩漏出現在 Codex 倉庫中

你可能已經看到了一些提示——引用 agent 信號的提交,或帶有無法解釋的路由標誌的配置。我不過度解讀洩漏,但它們符合開發者的需求:更清晰的信號,關於模型何時在計劃、執行或反思。早期的 Codex 時代倉庫通常在客戶端用啟發式方法偽造這些。這就是配置洩漏的原因:邏輯不得不存在於模型之外。

如果 GPT‑5.4 暴露了更穩固的狀態信號(即使是簡單的「計劃中」vs「執行中」),程式設計師就可以在不解析文字語感的情況下同步 UI 和日誌記錄。

多檔案編輯潛力

多檔案編輯是程式碼 agent 崩潰的地方。今日,我分塊上下文,請求計劃,然後在循環中應用帶有 linter 的差異。這有效,直到它不再有效——通常是當 agent 忘記一個小檔案或在中途重命名某些東西時。更好的原生支援應該是這樣的:提出帶有檔案映射的提交,按檔案包含理由,讓我按檔案接受更改。

即使沒有新的原語,GPT‑5.4 改進的推理(如果實現的話)加上更嚴格的訊息——「給我一個補丁集,不要散文」——也可以減少踩雷的機會。我在強制補丁格式並拒絕其他任何東西方面取得了一些成功。很無聊。但有幫助。

倉庫導航改進

上下文視窗變大了,但導航仍然很重要。我在 2026 年最好的程式碼運行使用了一個快速索引器,它建立符號映射和依賴圖,然後只提供相關的切片。如果 GPT‑5.4 更善於讀取這些映射——交叉參考表、符號摘要——我們就可以傳遞更薄、更精準的上下文。

一個值得關注的實際信號:agent 請求它已經看過的檔案的頻率。重複次數更少通常意味著它正在建立更好的工作集。我記錄這個。如果你不記錄,現在開始:這是一個容易跨版本追蹤趨勢的指標。

開發者現在應該朝哪個方向構建

與模型無關的架構模式

我試著把模型放在一個窄端口後面。一個中介者決定路由:工具保持無狀態並在日誌中可見:提示詞存放在帶有測試的版本化檔案中。這樣,如果 GPT‑5.4 讓快速模式值得使用,我可以切換車道而不需要重新接線所有東西。

兩個對我來說經受住時間考驗的模式:

- 帶有嚴格驗證器的類型化工具 schema。更少的猜測,更少的錯誤呼叫。

- 追蹤優先設計。每個 agent 步驟都寫入一個我可以重播的緊湊追蹤。當模型更新改變行為時,我可以對比新舊運行的差異。

這兩者都不閃亮。但它們是在模型轉變時防止發布停滯的東西。

監控模型發布頻道

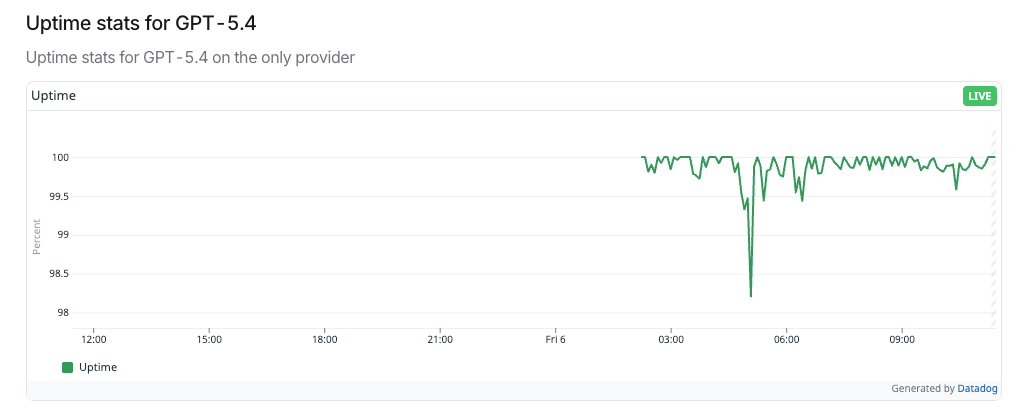

即使你不快速行動,也要關注頻道。我訂閱模型頁面並瀏覽模型列表和發布說明。我在每次更新中標記三件事:延遲提示、token 定價,以及任何新的系統級開關(模式、路由、安全行為)。然後我重新執行一個小型基準測試集——10–20 個代表我真實工作流程的追蹤。

花一個小時。之後節省幾天。如果 GPT‑5.4 分階段推出(通常是這樣),你會先在追蹤中看到邊緣案例,而不是在支援票據中。這就是監控的重點:在問題成為火災之前平靜地捕捉漂移。

狀態免責聲明

我沒有受贊助撰寫這篇文章。我也還沒有在 GPT‑5.4 上押生產賭注。我這裡的筆記來自相鄰的實驗,以及在早期模型更新中持續有效的模式。如果和當官方文件澄清模式或視覺細節時,我會連結它們並調整。在此之前,請將其視為田野筆記——希望有用,但是是暫時性的。

最後一件我還在思考的事:如果快速模式讓安靜的部分更快,我們是注意得更少,還是只是擔心得更少?對我來說兩者都好。