WAN 2.7 与 WAN 2.6:功能差异与升级决策指南

深度对比 WAN 2.7 与 WAN 2.6:新功能、API 层面的变化,以及为已在生产环境中运行 WAN 的团队提供的升级决策指南。

大家好,我是 Dora。我一直在默默关注 WAN 模型家族的版本迭代——不是带着兴奋的心情,而是以审视难以撤销的基础设施决策时应有的专注态度。WAN 2.7 计划于 2026 年 3 月发布,其功能列表足够值得关注,在你对生产环境做出任何改动之前,有必要把变化了什么、哪些保持不变,以及哪些地方仍存在不确定性一一列清楚。

30 秒决策(先读这里)

如果你需要以下功能,请立即升级:

- 在单个片段中同时控制首帧和尾帧(结构性场景控制,而非仅仅是动画锚点)

- 通过 9 宫格布局输入多张图像,实现更丰富的图生视频构图

- 对现有视频进行自然语言指令编辑——无需从头重新生成,即可更换背景、光线或服装

- 最多同时使用 5 个视频参考(2.6 有数量限制;2.7 将其显著扩展)

- 在单次处理中同时使用主体参考和声音参考(R2V 增强版)

如果你需要以下条件,请继续使用 2.6:

- 经过测试、具有稳定生产行为的文档化 API

- 本地部署——WAN 2.7 的开放权重状态尚未确认

- 明确的预算规划——截至本文撰写时,2.7 的定价尚未公布

功能对比表

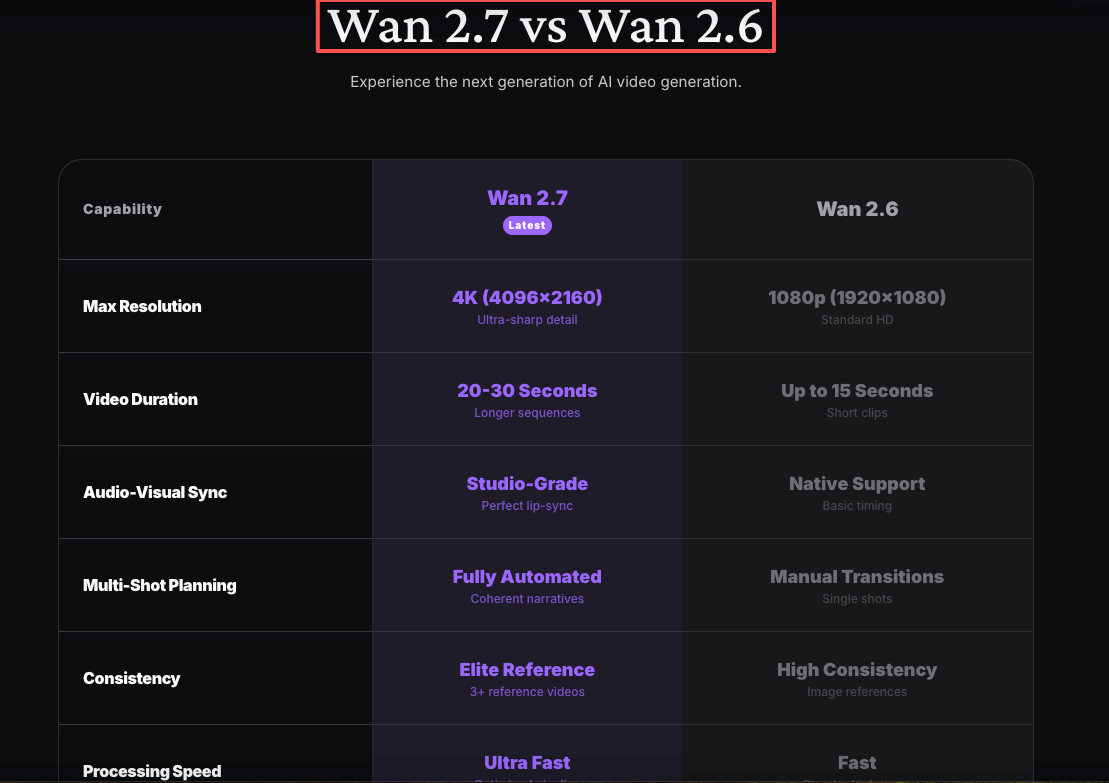

首尾帧控制:2.6 vs 2.7

WAN 2.6 为图生视频引入了基本的首帧锚定功能。 WAN 2.7 在此基础上增加了尾帧控制,这意味着你可以同时定义一个片段的起点和终点。对于构建叙事序列或循环内容的团队而言,这是”描述运动”和”真正编排运动”之间的本质区别。模型会在你设定的两个关键帧之间推断运动轨迹。

这对工作流程有实际影响:不必再生成多个候选片段、希望其中一个恰好符合预期结尾,而是从两端同时约束输出空间。

多图输入图生视频(9 宫格):2.7 新增功能

这是 2.7 中结构上最具创新性的功能。 9 宫格布局不再局限于单张参考图,而是接受 3×3 的图像排列——允许你将多角度参考、连续姿势或场景变体输入到单次图生视频生成中。模型利用这种结构化视觉输入来改善场景构图并减少画面漂移。

这种方式在实践中是否能明显优于经过良好提示的单图图生视频,是我需要直接测试才能确认的问题。其架构值得关注,但实际效果的差异需要实测数据来衡量。

声音参考:从 2.6 的 R2V 到 2.7 的增强版

WAN 2.6 引入了带声音输入的参考生成视频(R2V)功能。WAN 2.7 将其优化为主体与声音参考合一的工作流——在单次流程中同时锚定角色外观和声音方向。对于大规模构建虚拟主播或角色驱动内容的团队而言,这将显著减少流水线步骤。关于支撑该功能家族的更广泛音视频同步架构,你可以在 Alibaba 在 Hugging Face 上发布的 Wan 模型研究 中进一步了解。

指令编辑:2.7 新增功能

这是让 2.7 在质感上区别于纯生成模型的功能。你可以将一段现有视频与一条自然语言指令(“将背景换成被雨水浸湿的街道”、“把夹克换成红色”)一并传入,获得编辑后的输出,而非全新生成的视频。

这在操作层面意义重大:此前需要从头重新生成的迭代流程,现在可以作为轻量级编辑来处理。这也意味着你的提示策略会发生转变——你将撰写编辑指令,而非生成提示词。

输出分辨率与时长

2.6 和 2.7 均支持最高 1080P、最长 15 秒。此项无变化。如果分辨率或时长是你的主要限制,本版本并未扩展这些上限。

视频参考数量(2.7 最多支持 5 个)

WAN 2.6 支持单个或双个视频参考以保持主体一致性。WAN 2.7 将其提升至最多 5 个同时参考,适用于多角色场景或需要在参考资产间严格保持品牌一致性的制作工作流。

面向开发者的 API 层面变化

新参数 / 请求体结构

9 宫格输入和指令编辑几乎可以确定需要新的请求体字段——图像数组结构、edit_instruction 参数,以及可能独立的端点或模式标志。在官方 API 文档正式发布之前,任何第三方的参数猜测都应视为临时性信息。WAN 模型 GitHub 仓库 历来是 Alibaba 团队为开放权重版本记录 schema 变更的第一站。

端点与模型 ID 变化

预计会出现新的模型 ID(例如 wan-2.7-i2v、wan-2.7-edit),与 wan-2.6-i2v 区分开来。提供托管推理服务的平台(如 fal.ai)通常会在官方发布后数日内公布端点可用性——值得直接关注其更新日志。

与 WAN 2.6 工作流的向后兼容性

标准的图生视频和文生视频请求体(单图输入、文本提示、分辨率、时长)在结构上应该是兼容的。新功能看起来是增量添加,而非破坏性变更。 但话说回来,不要假设提示词行为完全相同——指令遵循调优的改变意味着,即使请求体没有任何变化,针对 2.6 调校的提示词在 2.7 中也可能产生不同的结果。

质量与性能:现有证据说明了什么

视觉保真度声明

预发布材料描述了清晰度、色彩准确性和细节保留方面的改进。我不会将这些内容作为事实转述——这正是那类需要基准数据支撑的声明。一旦官方基准数据发布,请结合你自己的代表性提示词进行交叉验证。综合评分很少能捕捉到对特定工作流最关键的边缘案例失败模式。

音频同步改进

WAN 2.5 引入了原生音频生成功能,WAN 2.6 对其进行了优化,WAN 2.7 声称在音视频同步方面进一步提升。fal.ai 关于 WAN 2.5 音频架构的博客 对同步管线的演进提供了有价值的背景信息——在用你自己的测试音频评估 2.7 的声明之前,值得一读。

运动一致性

被描述为比 2.6 更流畅、物理上更合理。这是最难在不运行自己的片段的情况下评估的质量声明。运动一致性在边缘案例中的退化难以预测——异常的摄像机角度、快速运动、复杂背景都可能导致问题。请针对你的具体使用场景进行测试,而非仅依赖通用演示。

升级的成本影响

新功能成本结构

9 宫格图生视频和指令编辑几乎可以确定会有不同于标准图生视频生成的成本结构。多输入推理的计算量更重。请提前做好预算规划,但在定价正式公布之前,不要确定具体预测数字。

计算成本:9 宫格 vs 单图图生视频

9 张参考图与 1 张相比,输入处理量大幅增加。如果你在运行高吞吐量的自动化流水线,请在迁移前将这一假设纳入成本估算:在相同分辨率和时长下,9 宫格的每次生成成本很可能高于单图图生视频。

已在 WAN 2.5/2.6 上运行的团队迁移清单

- 审查现有请求体中硬编码的模型 ID——在 2.7 端点可用时更新

- 在全面迁移前,针对 2.7 重新测试你最常用的 10 个提示词

- 评估指令编辑功能,看其是否适用于当前依赖重新生成进行迭代的工作流

- 对照现有图像处理管线检查 9 宫格输入格式

- 暂缓 ComfyUI 节点迁移,等待社区验证的 2.7 节点发布后再行操作

- 在扩展新功能使用规模之前,向你的推理服务商确认定价

- 在生产环境中确认 2.7 API 稳定性之前,不要废弃 2.6 工作流

常见问题

- 我可以用同一个 API 密钥调用 WAN 2.7 和 WAN 2.6 吗? 如果你使用的是托管推理服务商,几乎可以肯定可以——模型选择是按请求指定的。请向你的具体服务商确认。

- WAN 2.6 的提示词与 2.7 兼容吗? 结构上大概率兼容,但行为上无法保证。版本之间的指令遵循调优会发生变化。将 2.6 的提示词视为起点,而非成品资产。

- 2.7 会改变我为图生视频构建图像输入的方式吗? 标准单图图生视频:可能没有变化。9 宫格:结构全新。在代码库中分别记录这两种路径。

- 我的 WAN 2.5 ComfyUI 工作流会怎样? WAN 2.7 的节点要等社区贡献者在发布后发布才会存在。ComfyUI 博客 历来是最快找到 Wan 新版本经社区验证合作伙伴节点的地方。

- WAN 2.7 支持本地自托管吗? 截至本文撰写时尚不清楚。Wan 家族的发布方式各有不同——有些版本以 Apache 2.0 协议作为开放权重发布,另一些则仅通过专有 API 提供。在围绕 2.7 制定自托管计划之前,请先确认。

结语

如果你的工作涉及迭代、角色一致性或多输入构图,WAN 2.7 是一个有实质意义的版本升级。 指令编辑功能将模型从一个生成工具转变为更接近视频编辑管线的存在——这改变的不仅是你写什么提示词,更是你如何构建整个工作流。

但它不意味着:立刻迁移的理由。API 细节尚未最终确定,定价尚未公布,质量声明需要针对你实际的生产内容进行验证。等文档发布后将 2.7 评估纳入你的迭代计划,与 2.6 并行运行,用数据而非发布日的热情来做出迁移决策。

一旦官方文档上线,我将跟进发布 WAN 2.7 API 快速入门指南——涵盖请求体结构、9 宫格输入格式,以及面向已在生产环境中运行 2.6 的团队的指令编辑工作示例。

往期文章: