WAN 2.7 指令式视频编辑指南

WAN 2.7 新增指令式视频编辑功能。本文介绍其原理、可编辑内容、如何融入生产流程,以及开发者需要了解的关键信息。

大家好,我是 Dora。我使用 AI 视频工具已经有一段时间了,当我第一次听说 WAN 2.7 的基于指令的编辑功能时,我并不立刻相信它会带来多大改变。用文字指令编辑视频听起来像是那种在演示中效果很好、但真正用起来就会崩塌的功能。

我承认我部分错了。

WAN 2.7 中基于指令的视频编辑是什么

你拿一段现有的视频片段,写下你想要修改的内容,模型就会调整那个特定元素,同时保持其他一切不变。不是重新生成,而是编辑。

它与标准文生视频有何不同

文生视频从零开始。你写一个提示词,然后得到输出结果。

指令编辑从已有的内容开始。片段在那里,时序已经确定。你要求模型改变某一部分——替换背景、调整光线、重新给服装上色——而不触碰其他部分。

WaveSpeedAI 的分析指出,这在操作层面上意义重大:以前需要从头重新生成片段的迭代循环,现在可以作为轻量级编辑来处理。因为夹克颜色不对就重新生成,感觉很浪费。只编辑夹克才是正确的做法。

它与视频重创作有何不同

重创作是提取参考视频的运动结构,并将其应用于新的主体或风格。这是运动迁移。

指令编辑是修改。原始片段保持不变,只有你指定的元素发生变化。

模型接收什么作为输入

两样东西:源视频(最长 15 秒,分辨率达 1080P)和一条自然语言指令。

让我惊讶的是:不需要蒙版,不需要图层隔离。只需要片段和那句话。

指令可以编辑和不能编辑的内容

支持的编辑类别

根据测试和 Dzine 平台文档,指令编辑可以处理:

- 背景替换(室内换室外,晴天换雨天)

- 光线调整(黄金时段换蓝调时分)

- 对象级别调整(更换衬衫颜色、添加道具)

- 风格修改(写实换插画风格)

这些之所以有效,是因为它们是有边界的变化。模型知道什么是背景,光线起什么作用。

指令编辑难以处理的内容

复杂的空间重新排列效果不好。“把角色移到左边”没有产生干净的结果。角色要么原地不动,要么构图发生了尴尬的偏移。

涉及身份的场景——特定的面部表情、精细的 Logo 细节——难以编辑。模型可以改变光线,但在改变表情或年龄时难以保持精确的面部特征。

物理变化时好时坏。“让水流得更快”有时有效,有时看起来很卡顿。

编辑粒度

所有编辑都在提示词层面进行。你描述什么发生了变化,模型推断这适用于哪个部分。目前还没有对象级别的精确定位。

我学会了写非常具体的指令。“把夹克改成红色”比”让服装色调更暖”效果更好。

设计有效的编辑指令

什么是好的编辑指令

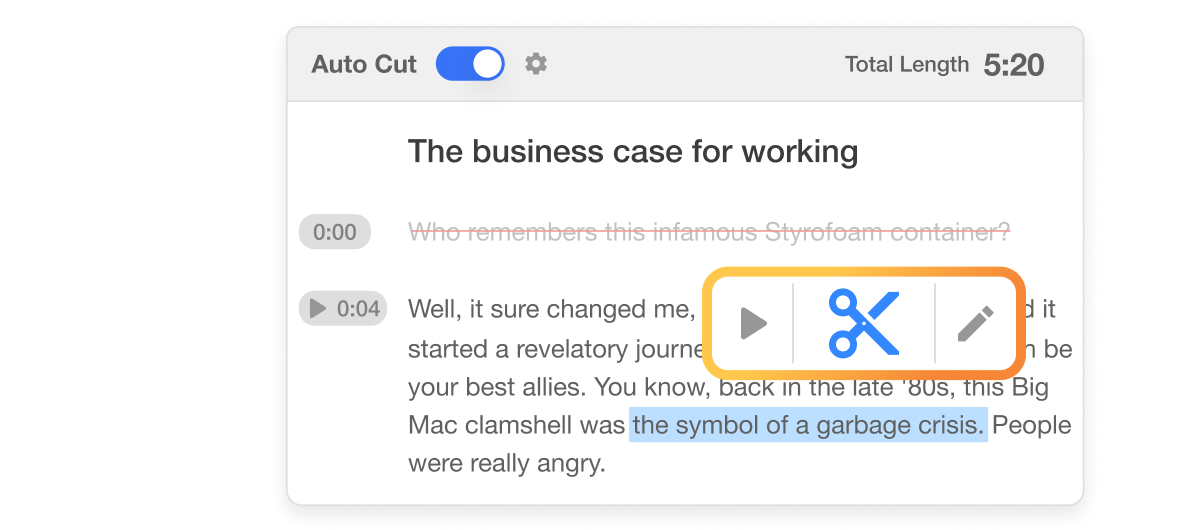

好的指令是具体的、有方向性的、有边界的。这种方式与 Descript 等工具背后的理念相呼应——你可以通过编辑文字来编辑视频,无需任何蒙版或图层隔离。

“把天空改成阴天并加上乌云”一直有效。它指定了什么在变化,变成什么,并添加了细节。

“让它看起来更有戏剧感”则不行。太模糊了。每次模型的解读都不同。

什么是糟糕的指令

与源片段相矛盾的指令会静默失败。对一个以角色为主的镜头下达”从场景中移除这个人”的指令,要么被忽略,要么产生破碎的帧。

包含多个冲突元素的指令很难处理。“把夹克改成蓝色,背景改成森林,再加上下雨”一次尝试了三项编辑。每条指令只做一项编辑效果更好。 这种清晰的提示模式——说明什么在变化并描述目标状态——与 Visla 基于文本的视频编辑中的最佳实践一致,你可以通过直接编辑文字稿来精修素材。

提示词模式

有效的模式是:

- 说明什么在变化

- 描述目标状态

- 保持在 15 个词以内

“把城市背景换成山地景观”——主语清晰,目标清晰,结果干净。

输入要求

源视频规格

源视频:2 到 15 秒,最高 1080P。我测试了 1080P 的 5 秒片段和 720P 的 10 秒片段,两者都有效。

参考对齐

如果你的源视频有严重的运动模糊、快速剪切或极端曝光,编辑结果会下降。模型需要清晰的帧。

快速平移镜头产生了模糊的背景替换效果。静态或缓慢移动的镜头产生了干净的编辑结果。

指令编辑在生产流程中的位置

我没想到会把这个作为主要工具。我以为它只是个新奇玩意。但事实并非如此。

后期生成精修循环

用标准文生视频生成一个片段后,我通常能得到我想要的 80%。运动是对的,构图是对的,但色彩分级感觉不对,或者背景与设计要求不符。

在指令编辑出现之前,这意味着要用调整后的提示词重新生成,然后祈祷好运。成功率:大约 40%。 每次重新生成需要 60-90 秒,我通常要尝试三四次才能得到可用的东西。

现在我生成一次,然后编辑那个不对的特定元素。成功率接近 70%,迭代速度更快。与其三次完整重新生成各需 90 秒(共 4.5 分钟),不如一次生成加一次编辑(大约共 2.5 分钟)。跨多个项目累积下来,节省的时间非常可观。

无需完整重新生成的风格迭代

我通过生成一个角色走在城市街道上的基础片段进行了测试,然后用指令编辑创建了三个风格变体:

- “切换到赛博朋克霓虹美学”

- “改为水彩画风格”

- “做成黑白黑色电影风格”

这三个编辑都保留了原始的运动和构图。只有视觉风格发生了变化。角色的行走循环保持完全相同。摄像机运动没有改变。

这对于客户演示非常有用——你想展示概念选项而不需要三次重新生成整个场景。对于在不消耗大量生成额度的情况下进行广告素材的 A/B 测试也很有用。

我尝试了用重新生成代替编辑的同一流程——写了三个不同的带有风格关键词的提示词。其中两个返回了略有不同的运动时序,这破坏了比较的基础。编辑保持了除我正在测试的风格变量之外的一切可比性。

成本比较:编辑 vs 重新生成

根据 WaveSpeedAI 的成本分析,基于指令的编辑可能与标准生成有不同的成本结构,但确切的定价尚未公布。

从工作流程的角度来看,即使编辑的每秒成本与生成相同,在实践中仍然更便宜,因为你不会丢弃失败的尝试。一次生成加一次精准编辑,胜过三次完整重新生成。

计算方式:如果 1080P 生成成本为**$0.12**/秒(来自 PiAPI 的 WAN 2.6 定价),一个 5 秒片段成本为**$0.60**。三次重新生成成本为**$1.80**。一次生成加一次编辑——即使编辑同样花费 $0.60——总成本只有**$1.20**。仅通过减少浪费就节省了 33%。

如果事实证明编辑比生成更便宜(考虑到它是修改现有帧而不是从头创建新帧,这似乎很可能),节省额还会成倍增加。

API 访问影响

独立端点还是参数标志?

WaveSpeedAI 的分析表明,指令编辑可能需要新的载荷字段——可能是一个 edit_instruction 参数,也可能是一个独立的端点。

在正式 API 文档出来之前,我暂时不会进行生产集成。

Token 和算力成本

多输入推理比单输入生成更重。指令编辑同时处理源视频和编辑指令,意味着更高的算力成本。

请相应地规划预算,但在定价正式发布之前不要最终确定预测。

异步任务注意事项

所有 WAN 操作都是异步运行的。提交请求,获取任务 ID,轮询直至完成。

根据我的测试,一个 5 秒 1080P 编辑的预计等待时间:30 秒到 2 分钟。

常见问题

基于指令的编辑在发布时是否可以通过 WaveSpeed API 使用?

WAN 2.7 将于 2026 年 3 月内发布。指令编辑的 API 可用性尚未得到确认。WaveSpeedAI 通常在官方发布后数天内添加新端点。

编辑时源视频最长可以多长?

最长 15 秒,分辨率达 1080P。 较短的片段(2-5 秒)处理更快,编辑效果更干净。

编辑是否保留原始音频? 取决于编辑内容。 背景更改会保留音频。改变视觉美学的风格调整有时会影响同步。建议逐案测试。

往期文章: