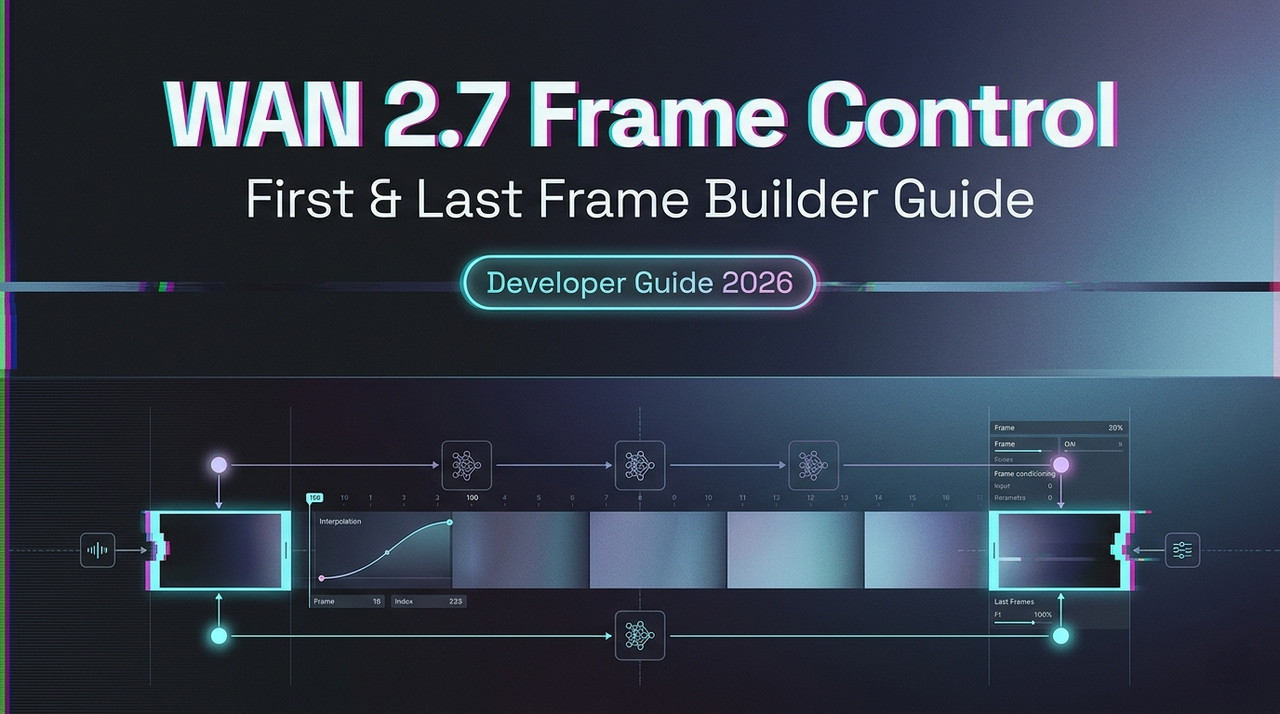

WAN 2.7 首尾帧控制:构建者指南

如何使用 WAN 2.7 的首尾帧控制功能实现可预期的视频生成——涵盖输入准备、API 参数及生产工作流技巧。

嘿,大家好,Dora 来了。我一直看到团队把首帧/尾帧控制描述为”只需上传两张图片”。这就像把异步任务队列描述为”只需等待”一样。原理本身并不难——但输入设计决策才是大多数生产工作流悄然崩溃的地方。

本指南适用于需要可重复输出的开发者,而不仅仅是偶尔成功的演示。

首帧与尾帧控制实际上做了什么

它解决的问题与标准 I2V 的对比

标准图像转视频(I2V)将开头帧作为锚点,然后模型自由发挥。结果就是社区常说的”漂移”——主体、摄像机位置或光照逐渐偏离你心中预设的目标状态。对于需要固定终点的产品演示或叙事序列,后期修复代价高昂。

WAN 的 FLF2V 方案 采用了额外的控制调节机制:首帧和尾帧被视为控制条件,两张图像的语义特征都被注入生成过程。这使得风格、内容和结构在模型动态转换过程中保持一致。

两帧在生成过程中的使用方式

模型并非简单地对像素值进行插值。它使用 CLIP 语义特征和交叉注意力机制来保持视频稳定——这种设计已被证明能比单锚点方法减少视频抖动。你的首帧定义初始状态;你的尾帧约束目标终点。两者之间的运动路径是推断出来的,而非指定的,这既是其强大之处,也是主要的失效模式。

模型如何推断两帧之间的路径

你的文本提示词指导转换如何发生——而不仅仅是发生与否。如果提示词写的是”产品缓慢旋转并展示正面”,这个动作描述会塑造推断出的路径。没有提示词时,模型仍会尝试一个合理的过渡,但你对方向变化、摄像机运动或节奏的控制力会大幅降低。

输入准备

图像规格要求

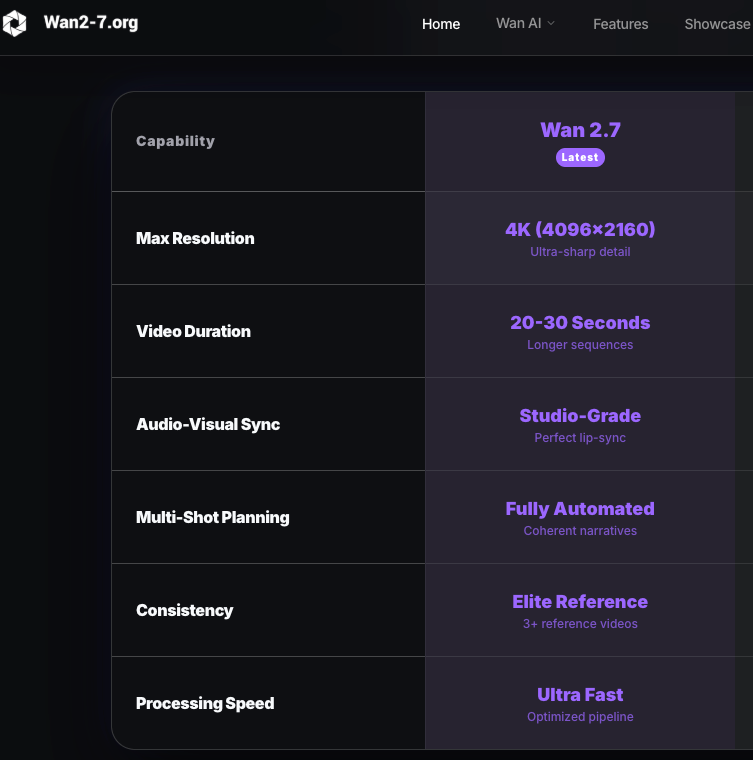

模型会尽可能接近你首帧的宽高比来生成目标输出。对于 3:4 的输入(750×1000),720P 输出设置会产生大约 816×1104 的结果——并非精确的 3:4。如果需要精确比例,计划在后期进行裁剪或加黑边。对于 WAN 系列,720p(1280×720 或竖版等效分辨率)是推荐的高质量输出分辨率;使用较低分辨率是测试迭代的有效策略,但不适用于最终成品。

格式:PNG 或高质量 JPEG。 避免将压缩缩略图用作首帧/尾帧——压缩伪影会引入噪点,而模型会将其解读为有意为之的视觉信息。

有效的帧配对策略

最强的配对共享三个特征:一致的光源方向、匹配的景深特性,以及在两个位置空间上均合理的主体。 在漫射工作室灯光下拍摄的产品图,搭配同一产品略微不同角度的尾帧,效果很好。包装图到生活方式主图的配对,只要布光设置相似同样可行。

对于叙事序列,将配对想象成定义一个动词:打开→关闭,之前→之后,组装→完成。语义关系越清晰,推断出的路径就越连贯。

什么构成糟糕的帧配对

三个常见的罪魁祸首:

光照方向不一致。 如果首帧的主光源在左侧 45°,而尾帧是顶光拍摄的,模型会尝试在两个不同的阴影环境之间过渡。结果通常是片段中间出现光源跳变,看起来像渲染错误。

空间不匹配。 宽景全景图搭配紧凑特写,会迫使模型自行创造摄像机运动。有时这是有意为之;通常并非如此。除非你明确提示缩放或拉远,否则保持焦距大致一致。

景深线索冲突。 首帧有虚化背景,尾帧全部清晰——模型会将此解读为景深变化并尝试为其添加动画。这并不总是错的,但很少是你的本意。

API 实现

以下内容反映了 WAN 系列已记录的 FLF2V 模式。在生产使用前,请在阿里云模型服务灵积文档中验证当前参数名称和端点路径。WAN 2.7 API 的具体细节应在发布时确认。

请求体结构

核心模式涉及两个图像输入——通过公共 URL 或本地文件路径——以 first_frame_url 和 last_frame_url 形式传入,同时附上文本提示词和分辨率设置。

Python 请求模式(伪代码)

# 发布时验证模型名称和端点——名称在不同版本间会有变化

import os

from dashscope import VideoSynthesis

response = VideoSynthesis.async_call(

model="wan2.x-flf2v-<verify-at-launch>", # 确认精确的模型字符串

first_frame_url="https://your-cdn.com/start.png",

last_frame_url="https://your-cdn.com/end.png",

prompt="固定镜头。从第一张图像开始,在最后一张图像结束。[描述运动]",

negative_prompt="闪烁, 扭曲, 模糊",

resolution="720P", # 验证接受的值

# seed 参数:一旦获得满意的结果,锁定此值

)

task_id = response.output.task_id长时任务的异步处理

图像转视频生成任务通常运行 1–5 分钟。API 使用两步异步模式:提交任务,获取任务 ID,然后轮询结果。从一开始就将轮询构建到你的流水线中。即使是测试调用也不要假设同步行为——超时会在简单实现中悄无声息地丢失结果。

生产工作流:草稿到成品的方法

第一步——构建参考配对并运行测试

从单个配对开始。在你看到完整的端到端输出之前,不要批量处理。使用你的目标内容——而非占位用的图库图片——因为空间和光照特性需要代表你实际的素材库。

第二步——批量处理前验证运动路径

以 0.5 倍速完整观看一遍视频片段。 注意:片段中间的抖动、主体在片段 50–70% 处前后的身份漂移(大多数伪影集中在这里),以及光照不连续性。如果你发现这些问题,在修改提示词之前先修复输入配对。

第三步——锁定最佳种子值以保持一致性

一旦获得干净的输出,记录种子值。FLF2V 模型接受可选提示词来引导中间动作和变换逻辑。锁定的种子加上锁定的提示词,能给你一个可重复的生成单元,可应用于相似的输入配对。这使批量生产变得可预测,而非充满随机性。

第四步——扩展到批量生成

将你的批次结构化为:一个作为质量锚点的标准”测试配对”,然后是从同一受控拍摄设置生成的变体配对。WAN FLF2V 的 Hugging Face 模型页面记录了在 API 调用旁边运行本地推理的团队所需的开放权重版本。

此功能适用场景(及不适用场景)

最适合: 终点很重要的产品演示序列(包装图→功能展示)、具有明确前后对比的叙事连续镜头、需要在系列多个片段间保持空间稳定性的受控摄像机路径。

不理想: 带有急剧方向变化的高度动态运动(模型会将其平滑化,往往损失戏剧性)、首尾帧没有清晰语义关系的模糊空间过渡,或需要逐帧精确计时的场景——模型控制节奏,而非你。

常见失败模式及修复方法

片段中间的运动伪影。 通常由输入配对中的空间不匹配引起。模型在早期就”锁定”了一条插值路径,不一致性在中间点显现。修复方法:在修改提示词之前,收紧帧之间的关系。

帧风格不一致。 如果首帧是风格化渲染,尾帧是照片,模型会尝试混合两种视觉风格。这很少产生干净的输出。匹配图像处理方式——都是渲染、都是照片、都是插图。

模型忽略尾帧。 当提示词描述的运动在逻辑上无法在尾帧处终止时,就会发生这种情况。当提示词连贯性与帧附着性冲突时,模型优先考虑前者。写提示词时要着眼于到达尾帧,而不仅仅是离开首帧。

常见问题

- 首帧/尾帧控制可以用于文本转视频,还是只能用于 I2V? FLF2V 模式是 I2V 的扩展。两个帧输入都是必需的。标准 T2V 在设计上不接受尾帧约束。

- 帧输入最适合什么图像格式? PNG 适用于任何需要干净边缘或透明度处理的内容。高质量 JPEG(>90 质量)适用于摄影。如果你的平台未确认支持,请避免使用 WebP。

- 这比标准 I2V 费用更高吗? 定价取决于分辨率——每次生成 720p 的费用大约是 480p 的两倍。FLF2V 本身在已记录的定价中没有额外溢价,但请与你的具体平台确认。

- 如何处理需要急剧方向变化的运动? 将序列分成多个片段,以中间帧作为端点。在后期将它们串联起来,而不是试图让单次生成处理不连续的运动。

- 可以将其与 9 宫格输入模式结合使用吗? 这些是独立的输入模式。WAN 2.7 支持首帧/尾帧控制和 9 宫格图像转视频作为独立功能。目前无法在单次调用中组合使用——如果这一点有变化,请在发布时验证。

结论

首帧/尾帧控制有趣的设计空间不在于 API 调用——而在于输入配对。这才是真正的生产杠杆所在,也是大多数团队投入不足的地方。一个设计良好、具有清晰语义关系的帧配对,将始终优于完美的提示词搭配不匹配的输入。

对于构建批量流水线的团队:将你的输入配对库视为一等资产,而非事后才考虑的东西。一旦你有了锁定的种子和经过验证的配对格式,生成环节就会变成例行公事。ComfyUI 社区详细记录了 WAN FLF2V 工作流配置,如果你在 API 调用旁边也运行本地推理,值得一读——从节点层面深入了解帧条件控制的实际工作原理。

我不断回想到这里有一个安静的洞见:约束本身就是特性。给模型一个目的地,迫使你对自己真正想要什么变得精确。这不是限制——这是一种纪律,往往能产生比开放式生成更好的输出。

继续探索 AI 视频工作流: