WAN 2.7:新功能、API 访问与升级路径

WAN 2.7 是阿里巴巴的重大升级版本,新增首尾帧控制、九宫格图生视频、声音参考和指令编辑功能。构建者必须了解的要点。

大家好,我是 Dora!自 2.1 版本起,我就一直密切关注 Wan 模型家族,主要原因在于:一旦某个模型在生产流水线中获得开源社区的广泛采用,其迭代速度往往会超过相关报道的跟进速度。WAN 2.7 仍在发布倒计时中——计划于 2026 年 3 月内上线——因此本文并非发布评测,而是为已在使用 2.5 版本、需要决定是否调整基础设施或继续等待的团队准备的一份预检清单。

没有炒作,只有已确认的信息、尚不明朗的内容,以及……这一切对你的构建队列意味着什么。如果你还在梳理 Wan 这类模型在生产技术栈中的位置,这篇关于 AI 视频生成工具在实际工作流中的应用 的解析,可以帮助你在深入研究规格参数之前先建立清晰的判断框架。

60 秒速览 WAN 2.7(精简版)

从产品或工程视角来看:WAN 2.7 的定位更像是功能扩展,而非单纯的质量飞跃。 核心亮点不是”视频更好看”,而是”新增了更多可控维度”。画质、音频生成和运动动态均有提升,但更值得关注的是结构性改进:首帧/末帧控制、九宫格多输入图生视频、主体+音色参考,以及基于指令的视频编辑。

相比 2.5,最大的变化不在于基础分辨率的提升,而在于模型在单次调用中所能接受的锚定输入数量。

WAN 2.7 新特性详解

首帧与末帧视频控制

首帧/末帧方法允许用户通过两张图片分别定义视频的起点和终点,由模型自动生成中间帧内容。该功能在早期 Wan 系列版本中曾作为独立模型存在(参见 Wan2.1-FLF2V-14B),但 2.7 将其整合进模型本身,而非作为独立检查点提供。

对于生产团队而言:当你已有明确的关键帧时,这一特性最具价值——例如静止状态下的产品图和运动状态下的产品图——你只需让模型完成过渡插值,无需经历完整的手动动画流程。端点是确定性的,中间过程仍具随机性,但构图层面的约束已然到位。

九宫格图生视频(3×3 多输入)

WAN 2.7 支持 3×3 网格合成方式,即在单次视频生成任务中,最多可提交九张参考图片作为结构化输入。这与单帧图生视频有本质区别。

实际应用场景:如果你需要在不同角度或光照条件下生成角色一致性内容,现在可以提供一组参考图网格……而非单一锚定图。如果你想了解不同工具在多参考一致性方面的表现,这篇关于**支持多人脸与多输入的最佳视频换脸工具指南**展示了现有解决方案仍存在的短板。它能有效降低单次生成的运气成分,从而减少图生视频批量任务的质量检查成本。发布时请确认确切的 API 参数结构——网格输入的端点 Schema 在撰写本文时尚未正式公布。

主体+音色参考

WAN 2.7 支持将视觉主体参考与音色参考相结合,生成角色外观与声音均与输入保持一致的视频。这是对 Wan 2.6 R2V 模型的延伸——该模型允许用户上传同时包含外观和声音的角色参考视频,结合文本提示生成以同一角色为主角的全新场景。

在 2.7 中,预期这一功能将更深度地集成,而非作为独立模型端点存在。对于构建角色驱动短内容或本地化流水线的团队而言,……这是生产 ROI 最为明确的特性——前提是音色参考在重复批量调用下能保持稳定。值得一提的是,这也正是现有 AI 视频换脸流水线在规模化运行时开始出现问题的环节,尤其是在同时要求身份一致性和音色一致性时。

基于指令的视频编辑

WAN 2.7 支持使用自然语言指令编辑现有视频——通过描述所需变化,让模型自动完成背景替换、光照调整或角色服装修改等操作。

这是从生成到编辑的重要转变。对于执行后期制作修正循环的产品团队而言,它为小幅改动提供了一种比手动抠像和合成更轻量的替代方案。关键的未知因素在于:当编辑影响到运动相关元素时(例如运动主体身上的服装),模型在较长片段中的时序一致性表现如何。这正是同类工具历史上最容易出现退化的场景。

阿里云模型服务官方文档已涵盖当前 Wan 系列中相关编辑端点的说明,可为你预判 2.7 的 API 使用模式提供一定参考。

视频复现/复制 [待验证]

该功能——在保留运动结构的同时,对现有视频进行风格或主体替换——已出现在第三方关于 WAN 2.7 的汇总介绍中。截至本文撰写时,该功能尚未在阿里巴巴官方文档中得到独立确认。 在阿里巴巴正式发布说明确认之前,请勿将此功能纳入工作流依赖。如果你现在正在评估升级项目范围,请将其标记为待探索功能。

不变的部分(架构延续自 2.6)

底层 DiT(扩散 Transformer)架构得以延续。Wan 系列基于主流视频 DiT 架构中的 Transformer 组件,采用全注意力机制,能够精准捕捉长程时空依赖关系,确保高度的时序和空间一致性。

这对本地推理团队而言意义重大:GPU 显存占用和量化方式不会发生大幅变化。 如果你的 2.6 推理技术栈已针对性优化(FP8 运算、多 GPU 分片),这些投入可以继续复用,无需期待一套全新的部署架构。

API 访问与可用性——已确认内容与待定内容

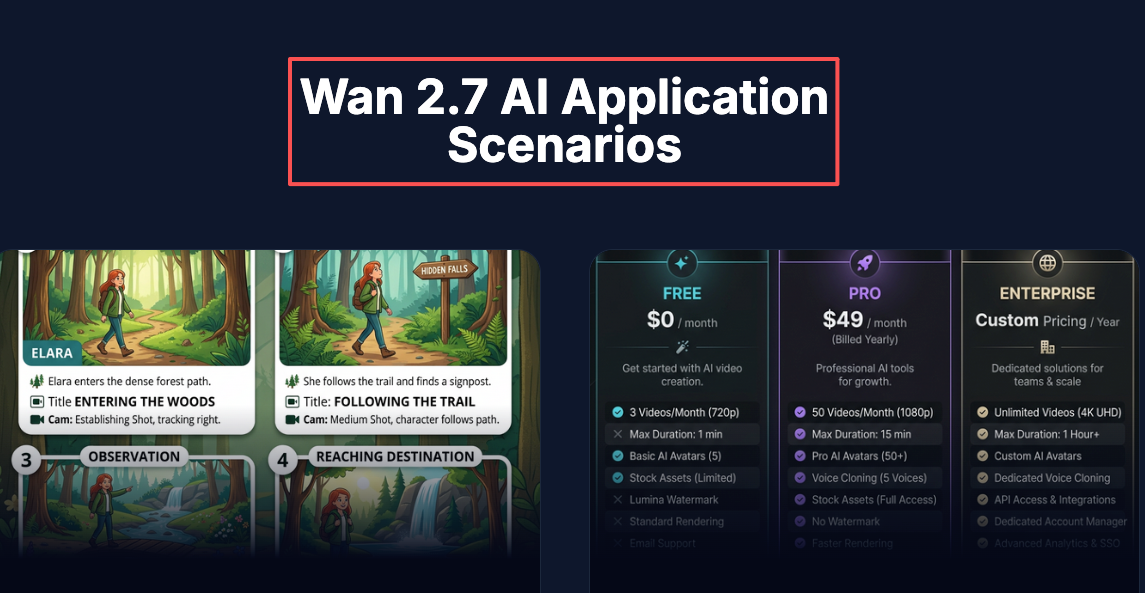

官方访问渠道(DashScope / Wan.video)

此前 Wan 版本的两个已确认官方渠道是:负责 API 密钥配置和模型访问的阿里云 DashScope 平台,以及面向创作者工作流的 Wan.video。两者预计均将在发布时支持 2.7,但区域可用性(尤其是国际账户与中国大陆账户之间的差异)需在发布时确认。

DashScope API 密钥通过 DASHSCOPE_API_KEY 环境变量加载,国际用户访问 dashscope-intl.aliyuncs.com——鉴于既有基础设施,2.7 几乎可以确定沿用相同模式。

第三方 API 可用性

截至本文撰写时,WAN 2.7 尚未在第三方 API 聚合平台上得到确认。基于 2.2 版本以来的规律——Wan 2.1 和 2.2 均在开源模型权重发布当天获得了 ComfyUI 原生支持——如果 2.7 附带公开权重,预计社区集成将迅速跟进。

2.7 是否以开源形式发布本身尚未确认,详见下方常见问题。

哪些团队现在就应该关注 WAN 2.7

从事参考驱动型视频制作的团队

如果你的流水线已依赖跨镜头的角色一致性,并一直通过多轮生成或 ControlNet 变通方案来弥补——那么主体+音色参考与多帧网格输入这两项功能,最能直接降低这部分开销。值得评估升级。

需要多输入图生视频的开发者

单图图生视频在需要一致性时就会捉襟见肘。九宫格输入显著扩展了参考覆盖面。如果你一直在通过批量变通方案来模拟这一效果,2.7 或许可以将多次 API 调用整合为一次。

暂时无需升级 WAN 2.5 的创意团队

如果你的 2.5 工作流运行稳定,且新特性并不对应现有生产瓶颈,则无需急于升级。模型尚在发布阶段,不妨等前两周社区反馈将边缘案例暴露出来,再考虑是否重新调整架构。

常见问题

- WAN 2.7 何时正式通过 API 开放访问? 计划于 2026 年 3 月内发布。各地区 API 的具体开放时间:尚未确认。

- WAN 2.7 像 WAN 2.2 一样开源吗? 尚未确认。Wan 2.2 采用 Apache 2.0 协议发布,支持商业使用和 ComfyUI 集成。2.7 是否沿用相同许可证,在预发布材料中尚未提及。

- WAN 2.7 支持 ComfyUI 吗? 目前尚无确认的集成方案。鉴于此前版本——Wan 2.1 和 2.2 均在发布当天或前后获得 ComfyUI 支持——如果模型权重公开,预计社区节点将迅速跟进。

- 与 WAN 2.5 相比,定价如何? 尚未公布任何定价信息。Wan 模型系列通常通过 DashScope 按秒或按视频计费。请在发布时查阅阿里云模型服务最新定价。

- 现在能通过第三方 API 提供商访问 WAN 2.7 吗? 暂时不行,模型尚未发布。请关注 Wan 官方 GitHub 和 DashScope 文档以获取发布确认,之后再查询各平台的支持情况。

发布后需要持续关注的内容

以下几点值得在 2.7 发布后的头几周持续追踪:

— 指令编辑的时序一致性:基于指令的编辑是最有可能在实际使用中与预发布预期产生落差的功能。请密切关注社区的输出反馈。

— 开源权重发布情况:如果权重公开发布,预计数日内将出现 ComfyUI 工作流、Diffusers 集成和量化变体。如果未公开,DashScope API 将是主要访问渠道——届时区域延迟将成为真实的工作流变量。

— 视频复现功能的状态:这一功能需要官方来源的确认。在阿里巴巴明确官宣之前,请勿将其纳入任何方案规划。