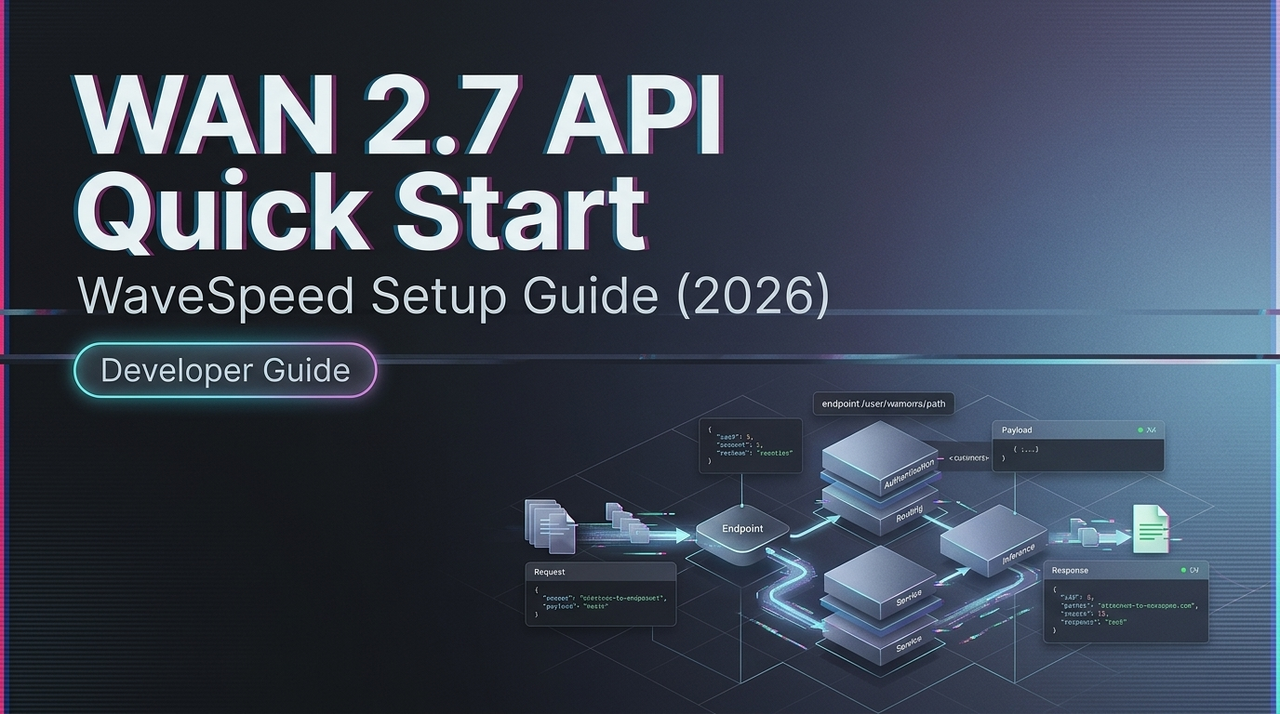

WAN 2.7 API 快速入门指南(2026)

通过 WaveSpeed API 快速运行 WAN 2.7:涵盖身份验证、模型 ID、核心参数,以及文生视频(T2V)、图生视频(I2V)和首末帧任务的首次请求示例。

嘿,大家好,我是 Dora。我一直在拖延这件事。**WAN 2.7 发布了。**我有个项目需要用到它,一直告诉自己等”情况稳定后”再接入。这通常是个错误的直觉。一旦搞清楚版本命名规则,API 接口其实很直接——大部分阻力来自早期做出的一两个决策,这些决策会悄悄影响后续所有环节。

这不是功能展示,而是我第一天真正需要的东西。

WAN 2.7 平台上线情况:模型 ID 与可用性

在写一行代码之前,我花了十分钟确认模型字符串。这听起来很基础,但 WAN 的命名规则确实容易让人踩坑——wan2.5-i2v、wan2.6-i2v、wan2.7-flf2v——使用过期的 ID 会返回一个干净的 404,没有任何有用的错误提示。

**模型目录是第一个要查的地方。**进入视频生成板块,按 2.7 版本筛选,然后复制完整的模型 ID 字符串。不要凭记忆手打。

上线时间也很重要。WAN 2.7 于 2026 年 3 月发布,带来了一批重要的新功能——首尾帧控制、3×3 网格图像转视频合成、最多五个视频参考,以及基于指令的编辑。根据阿里云百炼视频生成概览,新版 WAN 的托管推理端点通常在官方发布后数天内上线——但不一定是同一天,因此在构建任何时间敏感的功能前,请先查看平台状态页面。

鉴权与 API Key 配置

这部分很快。**API Key 放在 Authorization 请求头中,作为 Bearer Token 传入。**Base URL 取决于你注册时选择的地区——新加坡、弗吉尼亚,或中国大陆部署的北京节点。跨区域调用会失败,不会有明显报错,只会返回一个鉴权错误,如果没有预料到这一点,可能会白白浪费二十分钟。

Authorization: Bearer YOUR_API_KEY

Content-Type: application/json我从一开始就会把 API Key 存在环境变量里,绝不硬编码,哪怕是本地测试脚本也不例外。泄露的 Key 会带来意想不到的账单,这种麻烦不值得。

Base URL 结构遵循 IETF RFC 9110(HTTP 语义)定义的标准 REST 规范。如果你用过任何现代 AI API,这套模式会很眼熟——JSON 进,JSON 出,状态码行为符合预期。

核心请求参数

这里我建议你稍微放慢节奏。必填参数很少——模型 ID、提示词、输入类型——但可选参数对输出质量的影响比你预想的要大得多。

必填:

model— 从目录中核实过的精确模型字符串prompt— 文字描述;对于视频而言,具体性比长度更重要- 输入:I2V 用

image_url,T2V 纯文本即可

可选但实际上很重要:

resolution— 接受"480P"、"720P"、"1080P";WAN 2.7 支持原生 1080P 输出,最长 15 秒duration— 2 到 15 秒;时长越长,费用越高,处理时间也越长seed— **找到满意的输出后就锁定这个值。**这是唯一能让你跨次运行得到可复现结果的参数negative_prompt— 用于抑制闪烁、模糊和运动伪影

WAN 2.7 专属参数(待官方文档发布后核实):

first_frame_url+last_frame_url— FLF2V(首尾帧)模式image_grid— 用于更丰富 I2V 构图的 9 宫格输入结构edit_instruction— 对已有视频进行自然语言编辑

后三个是 2.7 的新特性。参数名称可能在预览版和正式发布版之间有所变化。官方 API 参考文档是权威来源——基于预发布参数名进行构建需自担风险。

首次请求示例

文本转视频(最简)

response = VideoSynthesis.async_call(

model="wan2.7-t2v", # 发布时核实精确字符串

prompt="A slow dolly shot through a foggy pine forest at dawn.",

resolution="720P",

duration=5,

seed=42

)

task_id = response.output.task_id标准图像转视频

response = VideoSynthesis.async_call(

model="wan2.7-i2v",

img_url="https://your-cdn.com/input.jpg",

prompt="Camera holds still. Subject turns slowly toward light.",

resolution="720P",

duration=5

)首帧 + 尾帧(FLF2V)

这正是 WAN 2.7 做到了前几个版本无法干净实现的事情。你定义开头帧和结尾帧,模型负责填充中间的运动过程。这不是传统意义上的动画——而是从两个语义端点出发的结构化推理。

response = VideoSynthesis.async_call(

model="wan2.7-flf2v", # 发布时核实精确字符串

first_frame_url="https://your-cdn.com/start.png",

last_frame_url="https://your-cdn.com/end.png",

prompt="Fixed camera. Smooth transition. Natural lighting.",

resolution="720P",

seed=99

)**帧对的质量比提示词更重要。**一对空间关系清晰、匹配良好的帧对,效果会稳定优于在错位输入帧上使用精心打磨的提示词。我已经跑了足够多的测试,可以有把握地说这一点。关于开源版本如何处理帧条件化,Hugging Face WAN 模型仓库对架构有详细说明——即使你只是调用托管 API,也值得参考。

9 宫格图像转视频

9 宫格输入允许你传入一个 3×3 排列的静态图像作为单次生成的构图参考。请在发布时核实精确的 payload 结构——该参数很可能接受一个包含九个图像 URL 的数组,但预发布文档应视为暂定内容。

异步任务处理:提交 → 轮询 → 获取结果

**视频生成永远不是同步的。**即使是短视频,每个任务也需要 1–5 分钟。流程始终一致:提交 → 获取 task_id → 轮询 → 获取结果 URL。

import time

def poll_for_result(task_id, interval=15, timeout=600):

elapsed = 0

while elapsed < timeout:

result = VideoSynthesis.fetch(task_id)

status = result.output.task_status

if status == "SUCCEEDED":

return result.output.video_url

if status == "FAILED":

raise Exception(f"Task failed: {result}")

time.sleep(interval)

elapsed += interval

raise TimeoutError("Job exceeded timeout")轮询间隔:15 秒是阿里巴巴自家 Wan 图像转视频端点 API 参考文档中的推荐值。不要轮询得更频繁——这不会加快速度,反而会消耗速率限制配额。

任务状态流转:PENDING → RUNNING → SUCCEEDED 或 FAILED。结果 URL 在生成后 24 小时内有效。请立即下载并存储——如果错过这个窗口,task ID 也会在 24 小时后失效,后续查询会返回 UNKNOWN。我在第一次批量运行时就吃了这个亏。

错误处理

最常遇到的错误:

| 错误 | 可能原因 | 解决方法 |

|---|---|---|

| 模型 404 | 模型 ID 错误或已过期 | 从目录核实精确字符串 |

| 输入 400 | 图像格式被拒绝或 URL 不可访问 | 使用公开 HTTPS URL;验证格式 |

| 429 Too Many Requests | 触发速率限制 | 指数退避加抖动 |

| UNKNOWN 任务状态 | Task ID 已过期(24 小时窗口) | 尽早轮询;立即下载结果 |

遇到 429 时:退避,加抖动,不要在紧密循环中重试。MDN HTTP 文档中关于 Retry-After 响应头行为的说明解释了标准模式——响应头通常会明确告诉你何时可以重试。

WAN 2.7 的视频任务速率限制与图像生成限制是分开发布的。高分辨率或较长时长的任务通常计入并发任务限制,而不仅仅是每分钟请求数限制。请对照你的账户等级文档进行核实。

费用估算

WAN 2.7 的定价在撰写本文时尚未最终确定。根据 WAN 模型家族的一贯规律,费用在三个维度上递增:

- 分辨率 — 每秒输出,1080P 明显比 720P 贵

- 时长 — 按生成视频的秒数计费

- 输入复杂度 — 多参考输入可能有倍数加成;请在发布时确认

粗略估算公式:

预估费用 = 时长(秒)× 分辨率倍数 × 每秒单价在批量运行之前,先用你计划使用的每种分辨率和时长组合各测试一个片段。阿里云百炼的计费概览页面会在官方 WAN 2.7 费率发布后提供每秒单价。视频生成费用的累积速度比图像生成快得多——分辨率是最大的调节杠杆。

常见问题

WAN 2.7 是否与阿里巴巴官方发布同日上线?

不一定。托管 API 端点通常在开源版本发布后数天内上线,有时是同一天,有时要晚一周。请直接监控平台更新日志。WAN 模型的 GitHub 仓库历来是阿里团队最先记录新开源版本 schema 变更的地方。

WAN 2.5 的 API 调用与 WAN 2.7 兼容吗?

标准 T2V 和单图 I2V 的 payload 结构应该兼容——2.7 的新特性看起来是增量添加而非破坏性变更。但你仍需更新模型 ID 字符串,任何使用 2.5 专属参数的代码在视为直接替换之前都应进行测试。9 宫格和 FLF2V 模式需要全新的 payload 结构。

WAN 2.7 视频任务的速率限制是多少?

请在运行时对照你的账户等级进行核实。作为默认工作策略:以稳定的节奏排队提交任务,而不是集中爆发。用指数退避处理 429。记录每个响应中的 request_id——当出现问题需要追溯时,这是最有用的字段。

这里的机制并不复杂。真正耗时的是构建高质量的输入素材——帧对、参考图像,以及既具体又不过于僵化的提示词。一旦这些素材稳定下来,API 这一侧就会变成例行操作。

等官方 WAN 2.7 参数文档上线,并且我有机会端到端测试 9 宫格格式后,我会更新这篇文章。那是我最好奇的部分。

往期文章: