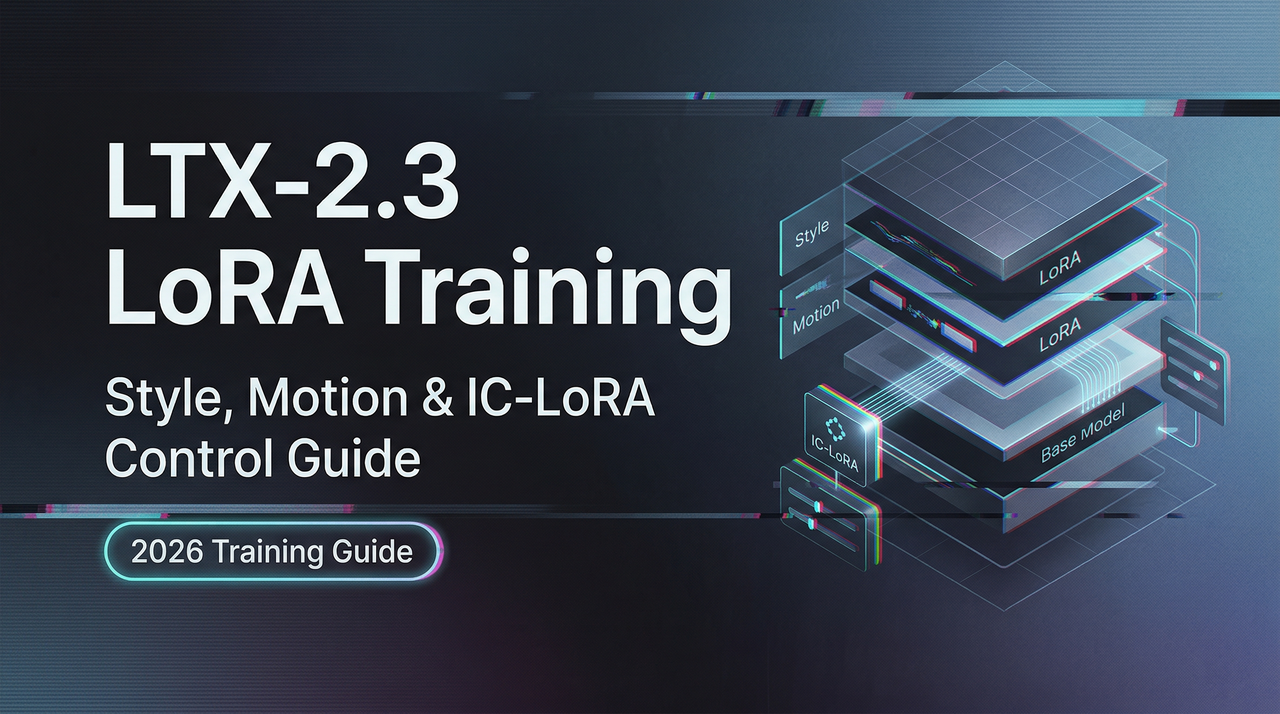

LTX-2.3 LoRA训练指南:风格、动作与IC-LoRA控制(2026)

使用官方ltx-trainer在LTX-2.3上训练自定义LoRA。涵盖风格LoRA、IC-LoRA结构控制、秩设置、数据集准备及常见训练失败问题。

嘿,朋友们。我是 Dora。

我没打算花一周时间训练 LoRA。我只是需要一个产品演示能够遵循特定的动作模式,而文本提示词完全达不到效果。这个小小的摩擦把我引向了 LTX-2.3 训练这条路,而我的发现让我颇感意外——不是因为它有多革命性,而是一旦你了解哪些设置真正重要,它就显得格外务实。

这不是一篇全面的参考指南,而是我在 2026 年 3 月测试风格、动作和 IC-LoRA 控制工作流程时所学到的东西。

LTX-2.3 官方训练器包含哪些内容

LTX-2 GitHub 仓库以 monorepo 形式组织,包含三个软件包:用于模型实现的 ltx-core、用于生成工作流的 ltx-pipelines,以及用于 LoRA 和 IC-LoRA 微调的 ltx-trainer。宽度和高度设置必须能被 32 整除,帧数必须遵循 8n+1 规则——即 1、9、17、25 帧,以此类推。

我在第一次训练时忽略了这一点。训练器报错后,我手动填充了帧数,然后成功运行。这是个小限制,但值得提前了解。

三种 LoRA 类型及其适用场景

风格 LoRA(外观、纹理、色彩)

风格 LoRA 让 LTX-2.3 学习视觉美学——色彩分级、纹理处理、光线氛围。我在具有一致白色背景和柔和阴影的产品摄影上训练了一个。对于角色或风格 LoRA,20-50 张图片通常足以获得稳定的结果,不过对于高度特定的主体,我有时会增加到 80-120 张。

纯图像数据集在这里完全适用。对于我最初的几个 LoRA,我使用了静帧而非视频片段——这样更容易整理,而且模型无需处理动作就能学习身份特征。

动作/效果 LoRA(运动、变换)

动作 LoRA 专注于事物的运动方式,而非外观。镜头平移、物体旋转、变换序列。这些需要简短连贯的视频片段,而非静帧。我用 15 秒的片段测试了一个推进运动 LoRA,保持一致的构图,模型成功在不同主体间捕捉到了运动模式。

训练动作 LoRA 感觉比风格 LoRA 更不稳定,需要更多重试,结果也更多变。

IC-LoRA(结构控制:深度、姿态、Canny 边缘)

IC-LoRA 与众不同。它不是让模型学习新的美学或动作,而是基于参考信号——深度图、姿态骨骼、边缘检测——来条件化生成。IC-LoRA 能够在推理时根据参考视频帧对视频生成进行条件化,从而在文本转视频基础模型之上实现精细的视频到视频控制。

我使用深度 IC-LoRA 锁定了镜头运动,同时完全改变了视觉内容。官方 IC-LoRA 指南很好地解释了三种控制模式:用于边缘保留的 Canny、用于镜头和空间几何的 Depth,以及用于人体动作迁移的 Pose。

数据集准备规则

帧数限制(8n+1 规则)

帧数必须是 8 的倍数加 1。这不是一个软性建议——如果你的片段是 10 帧或 15 帧,训练器要么报错,要么在内部自动填充。我在上传前将数据集批量处理为 17 帧(2 × 8 + 1),训练过程非常顺畅。

分辨率整除性(32 像素规则)

宽度和高度必须能被 32 整除。我是在将一批图像调整为 1024×576 后才发现这一点的,训练器悄悄地将其填充为 1024×608。最好提前正确调整尺寸。

视频 vs 图像数据集:各自的适用场景

纯图像数据集对 LTX-2.3 LoRA 训练完全有效。这比过早强迫学习动作要简单得多,尤其是对于身份或风格 LoRA。我每个项目都从静帧开始,验证外观效果,然后在动作重要时才添加短视频片段。

对于动作密集的工作,简短连贯的片段仍然优于冗长的多场景片段。

基线训练设置

Rank 32 作为正确默认值及何时提高

对于 LTX-2.3,rank 32 是正确的默认值。它通常能提供足够的容量,又不会让 LoRA 过早变得过于僵化。我在一个复杂风格 LoRA 上测试了 rank 64,但收效甚微——额外的容量没有帮助,因为我的数据集规模和多样性都不足以填满它。

学习率起点及何时调整

对于 LTX-2.3 LoRA 训练,1e-4 是正确的起点。这是那种无聊的答案恰好是正确答案的情况。我前四个 LoRA 都没有调整学习率,它们都顺利收敛了。

步数:如何判断何时提前停止

很多用户在检查检查点 250、500 或 750 是否已经看起来不错之前,就直接跳到高步数,白白浪费了时间。我在检查点 500 进行采样,如果 LoRA 已经看起来效果很好,我就在那里停下。如果一个 LoRA 在检查点 750 或 1000 时已经看起来很强,继续推进只会让它变得更脆弱。

过拟合的表现是模型记住了训练数据而非学会泛化。验证样本开始看起来与训练帧完全相同。

IC-LoRA:深度、姿态和边缘控制

IC-LoRA 与标准风格 LoRA 的区别

IC-LoRA 将动作与视觉风格分离。你用文本和风格 LoRA 控制外观,用结构化引导控制运动。LTX-2.3 IC-LoRA 联合控制模型在单个适配器中支持多种控制信号——深度、姿态、边缘。

我在一个产品转台序列上运行了深度 IC-LoRA。镜头路径锁定在参考深度图上,但视觉内容根据我的提示词完全改变了。

ComfyUI IC-LoRA 工作流集成

RunComfy LTX 2.3 IC-LoRA 工作流自动处理深度、姿态和边缘提取。加载参考片段,选择控制模式,编写以风格为重点的提示词,模型会单独处理动作。

我最初忽略了一个细节:将提示词集中在外观上,因为 IC-LoRA 负责处理动作和结构。在 IC-LoRA 控制动作的同时试图在提示词中描述镜头运动,会产生冲突。

常见训练失败及解决方案

LoRA 渗透到所有内容(DOP 解决方案)

当 LoRA 开始渗透到所有内容时,DOP(提示词丢弃)是第一个值得尝试的高级选项。我训练了一个产品风格 LoRA,它在相似物品上效果很好,但开始影响无关的主体。添加标题丢弃有助于 LoRA 学会泛化。

高步数下的过拟合

不要把更多步数当作通用的质量提升手段。我将一个动作 LoRA 训练到 2000 步,却发现它开始复现精确的训练帧,而不是学习底层模式。回滚到了检查点 750。

标题丢弃与缓存文本嵌入的冲突

如果使用了标题丢弃,缓存文本嵌入(Cache Text Embeddings)应保持关闭。这是少数几个小设置之一,如果使用不当会悄悄让训练行为变差。我曾经同时启用两者,得到了不一致的结果——模型无法决定是依赖缓存嵌入还是处理缺失的标题。

部署前验证 LoRA

在确认 LoRA 完成之前,我会进行三个验证测试:使用相同提示词分别在有无 LoRA 的情况下生成,以确认它添加了我期望的内容;使用多种提示词检查泛化能力;以及测试训练集中未包含的边缘情况。如果 LoRA 只在与训练标题高度匹配的提示词下才有效,那就是过拟合了。

常见问题

我可以在 A100 或更小的 GPU 上训练 LoRA 吗?

LTX-2.3 训练官方目标硬件是配备 80GB+ 显存的 Nvidia H100 GPU,不过较低显存的配置可以通过梯度检查点和降低分辨率来实现训练。我自己没有测试过 A100 训练,但官方训练器文档将其作为推荐的硬件基准。

在 H100 上训练一个风格 LoRA 需要多长时间?

根据实际使用报告,在单张 4090 上训练中等规模数据集(包括验证和小幅重启)大约需要 3-5 小时。H100 应该更快,但我没有直接数据。

LTX-2 的 LoRA 无需重新训练就能在 LTX-2.3 上使用吗?

不能。LTX-2.3 搭载了经过完全重新设计的 VAE,该 VAE 在更高质量的数据上进行了训练,文本连接器架构也发生了变化。来自 LTX-2 的旧 LoRA 无法干净地迁移——我测试过这一点,出现了视觉伪影。

IC-LoRA 可以与风格 LoRA 组合使用吗?

可以。你可以同时叠加最多三个 LoRA 适配器,将自定义美学与结构控制相结合。我在 IC-LoRA 加载器之前运行了一个风格 LoRA,并将其权重保持适中,以便 IC-LoRA 能够维持几何形状和时序。

可以通过云平台进行 LoRA 训练吗?

可以。RunComfy AI Toolkit 和 fal.ai 都提供基于浏览器的训练,无需管理 GPU 基础设施。上传数据集,配置参数,训练完成后下载 LoRA 即可。

为 LTX-2.3 训练 LoRA 并不神奇。 关键在于数据集准备、基线设置,以及知道何时提前停止。8n+1 帧规则和 32 像素整除限制乍看之下很随意,但它们只是模型的几何要求。顺应它们,而不是绕过它们。

让我意外的不是复杂性——而是坚持使用 rank 32 和 1e-4 学习率,而不是在第一次训练时就调整每个参数,为我节省了多少时间。

往期文章: